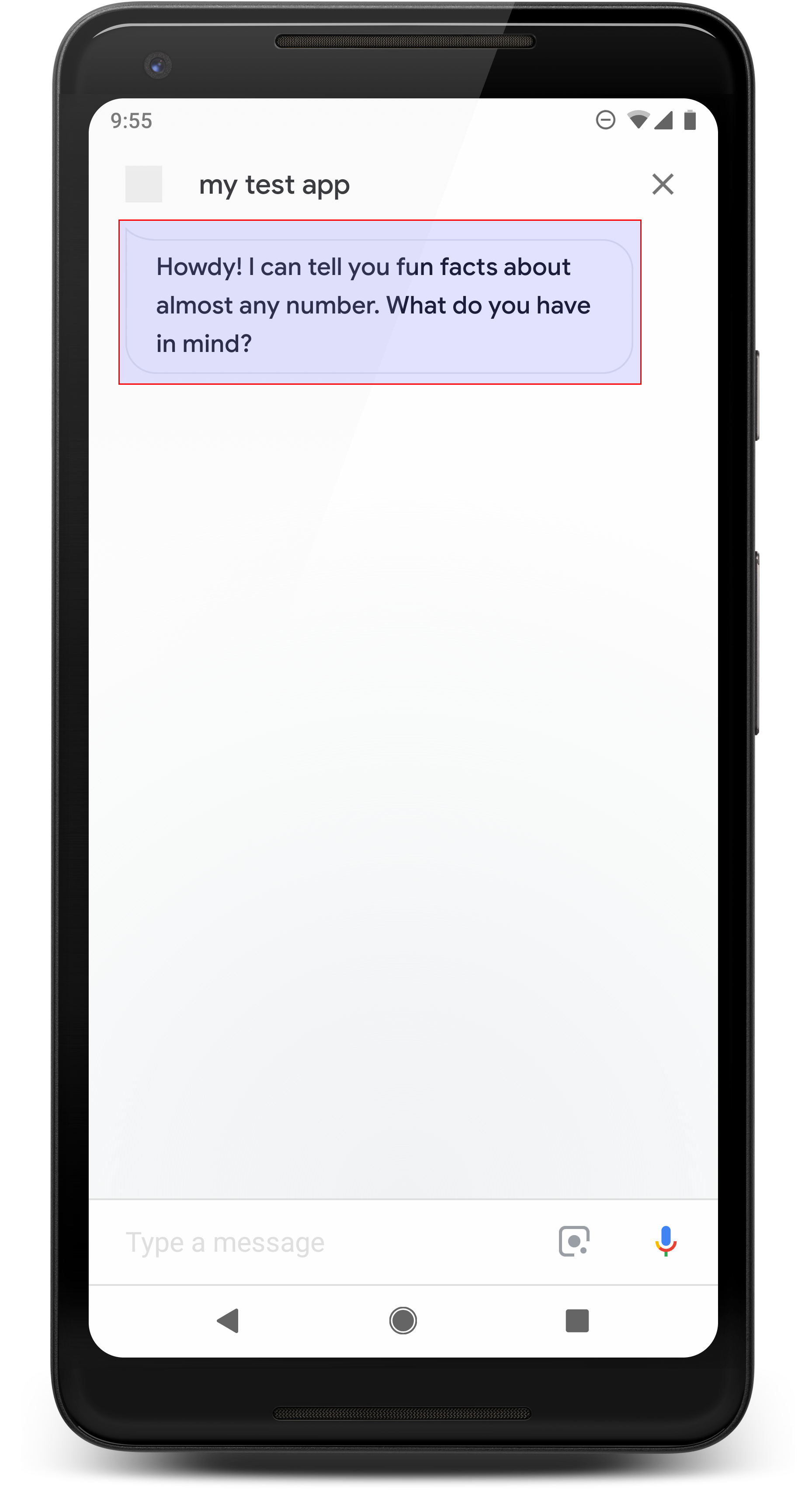

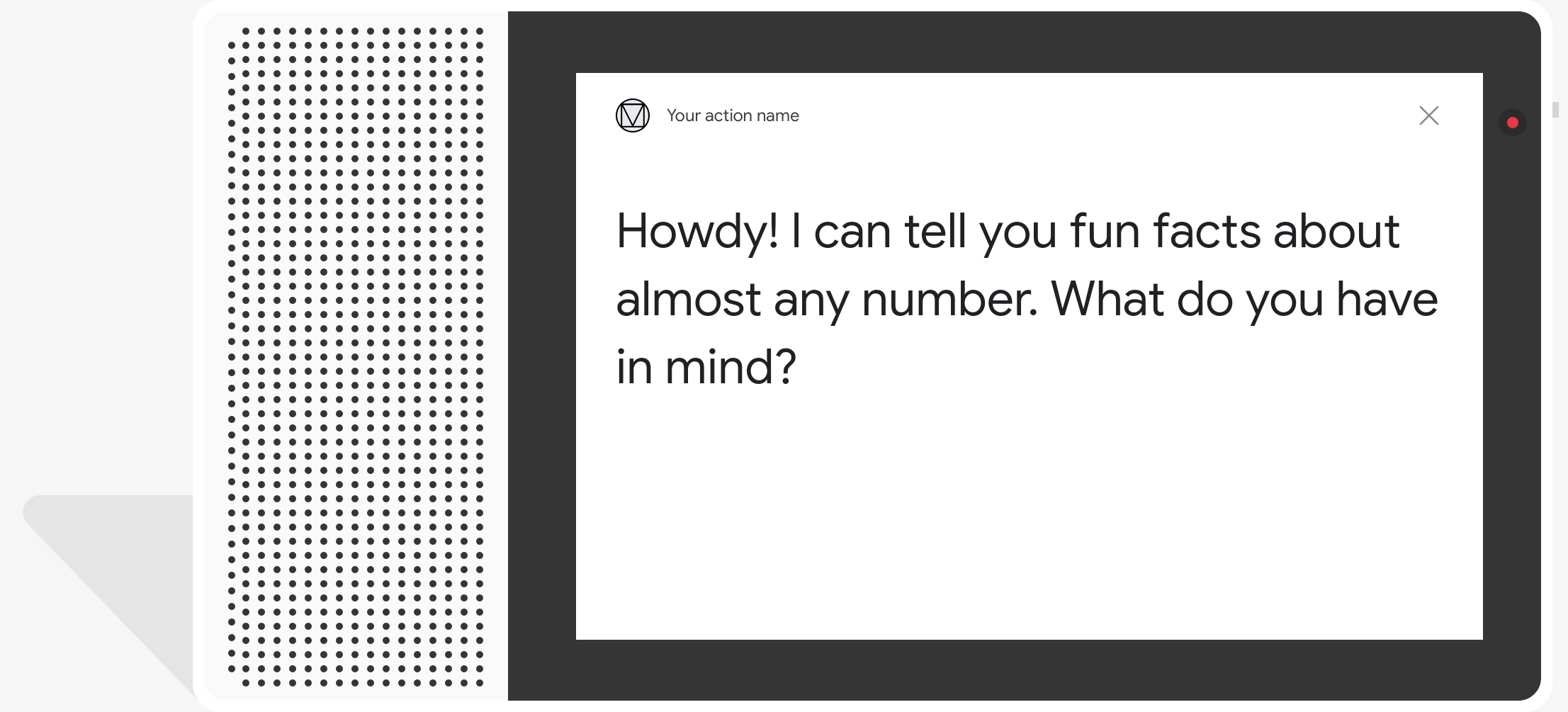

תשובות פשוטות מוצגות בצורת בועת צ'אט באופן חזותי והן כוללות המרת טקסט לדיבור (TTS) (TTS) או שפת סימון דיבור לסינתזת דיבור (SSML) לצלילים. באמצעות שימוש ב-Shorts תשובות פשוטות בשיחה, תוכלו לשמור על רמת העניין של המשתמשים בעזרת תמונות וממשק אודיו שאפשר להתאים לרכיבי שיחה אחרים.

תוכן של בועת צ'אט בתשובה פשוטה חייב להיות קבוצת משנה פונטית או תמונה מלאה תמליל של פלט ה-TTS/SSML. המידע הזה עוזר למשתמשים למפות את הפעולה אומרת ומגבירה את ההבנה בתנאים שונים.

בהנחיה, טקסט שאתם מספקים באובייקטים first_simple ו-last_simple

להשתמש במאפיינים של תגובה פשוטה. Google Assistant שולחת את כל כתובות ה-URL פשוטות

מספקת תשובות לפי הנחיה, ואז שולחת את תגובת החיפוש המתקדמת הסופית בתור ההנחיות.

מאפיינים

סוג התגובה הפשוט כולל את המאפיינים הבאים:

| נכס | סוג | דרישה | תיאור |

|---|---|---|---|

speech |

מחרוזת | אופציונלי | מייצג את המילים שייאמרו למשתמש ב-SSML או בהמרת טקסט לדיבור (TTS).

אם השדה override בהנחיה שמכילה הוא 'true',

אז הדיבור שמוגדר בשדה הזה מחליף את

של הנחיה. |

text |

מחרוזת | אופציונלי |

טקסט להצגה בבועת הצ'אט. מחרוזות שאורכן עולה על 640 תווים נחתכים במעבר המילה הראשונה (או ברווח הלבן) לפני 640 תווים. מומלץ להשתמש בפחות מ-300 תווים כדי למנוע חשיפה אל מעבר למסך, במיוחד כאשר משתמשים בו ביחד עם או רכיב חזותי אחר. אם לא תספקו את הפרמטר הזה, Assistant תעבד גרסת תצוגה של

במקום זאת, השדה |

קוד לדוגמה

YAML

candidates: - first_simple: variants: - speech: This is the first simple response. text: This is the 1st simple response. last_simple: variants: - speech: This is the last simple response. text: This is the last simple response.

JSON

{ "candidates": [ { "first_simple": { "variants": [ { "speech": "This is the first simple response.", "text": "This is the 1st simple response." } ] }, "last_simple": { "variants": [ { "speech": "This is the last simple response.", "text": "This is the last simple response." } ] } } ] }

Node.js

app.handle('Simple', conv => { conv.add(new Simple({ speech: 'This is the first simple response.', text: 'This is the 1st simple response.' })); conv.add(new Simple({ speech: 'This is the last simple response.', text: 'This is the last simple response.' })); });

JSON

{ "responseJson": { "session": { "id": "session_id", "params": {} }, "prompt": { "override": false, "firstSimple": { "speech": "This is the first simple response.", "text": "This is the 1st simple response." }, "lastSimple": { "speech": "This is the last simple response.", "text": "This is the last simple response." } } } }

SSML וצלילים

להשתמש בתשובות ב-SSML ובצלילים כדי ללטש ולשפר את חוויית המשתמש. מידע נוסף זמין במסמכי התיעוד של SSML.

ספריית צלילים

אנחנו מספקים מגוון של קטעי אודיו קצרים וחינמיים בספריית האודיו שלנו. האלה האודיו מתארח אצלכם, ולכן כל מה שצריך לעשות הוא לכלול אותם ב-SSML.