এই পাতায় জেনারেটিভ এআই পরিভাষা তালিকা রয়েছে। সম্পূর্ণ পরিভাষা তালিকার জন্য এখানে ক্লিক করুন ।

একটি

অভিযোজন

টিউনিং বা ফাইন-টিউনিং- এর সমার্থক শব্দ।

এজেন্ট

এমন সফটওয়্যার যা ব্যবহারকারীর দেওয়া তথ্য বিশ্লেষণ করে তার হয়ে বিভিন্ন কাজের পরিকল্পনা ও সম্পাদন করতে পারে।

রিইনফোর্সমেন্ট লার্নিং- এ, এজেন্ট হলো এমন একটি সত্তা যা পরিবেশের বিভিন্ন অবস্থার মধ্যে পরিবর্তনের মাধ্যমে প্রাপ্ত প্রত্যাশিত প্রতিদানকে সর্বাধিক করার জন্য একটি পলিসি ব্যবহার করে।

এজেন্টিক

agent- এর বিশেষণ রূপ। Agentic বলতে এজেন্টদের অধিকারী গুণাবলীকে (যেমন স্বায়ত্তশাসন) বোঝায়।

এজেন্টিক ওয়ার্কফ্লো

একটি গতিশীল প্রক্রিয়া যেখানে কোনো কর্তা একটি লক্ষ্য অর্জনের জন্য স্বতঃস্ফূর্তভাবে কর্মপরিকল্পনা করে এবং তা সম্পাদন করে। এই প্রক্রিয়ায় যুক্তি-তর্ক, বাহ্যিক উপকরণের সাহায্য গ্রহণ এবং নিজের পরিকল্পনা সংশোধন অন্তর্ভুক্ত থাকতে পারে।

এআই স্লপ

একটি জেনারেটিভ এআই সিস্টেমের আউটপুট যা গুণমানের চেয়ে পরিমাণকে বেশি প্রাধান্য দেয়। উদাহরণস্বরূপ, এআই স্লপযুক্ত একটি ওয়েব পেজ সস্তায় উৎপাদিত, এআই-সৃষ্ট, নিম্নমানের কন্টেন্টে পরিপূর্ণ থাকে।

স্বয়ংক্রিয় মূল্যায়ন

সফটওয়্যার ব্যবহার করে কোনো মডেলের আউটপুটের গুণমান বিচার করা।

যখন মডেলের আউটপুট তুলনামূলকভাবে সরল হয়, তখন একটি স্ক্রিপ্ট বা প্রোগ্রাম মডেলের আউটপুটকে একটি গোল্ডেন রেসপন্স- এর সাথে তুলনা করতে পারে। এই ধরনের স্বয়ংক্রিয় মূল্যায়নকে কখনও কখনও প্রোগ্রাম্যাটিক ইভ্যালুয়েশন বলা হয়। ROUGE বা BLEU- এর মতো মেট্রিকগুলো প্রায়শই প্রোগ্রাম্যাটিক ইভ্যালুয়েশনের জন্য উপযোগী হয়।

যখন মডেলের আউটপুট জটিল হয় অথবা এর কোনো একটি সঠিক উত্তর থাকে না , তখন অটোরেটার নামক একটি পৃথক এমএল প্রোগ্রাম কখনও কখনও স্বয়ংক্রিয় মূল্যায়ন সম্পাদন করে।

মানব মূল্যায়নের সাথে তুলনা করুন।

স্বয়ংক্রিয় মূল্যায়ন

একটি জেনারেটিভ এআই মডেলের আউটপুটের গুণমান বিচার করার জন্য একটি হাইব্রিড পদ্ধতি, যা মানুষের মূল্যায়ন এবং স্বয়ংক্রিয় মূল্যায়নকে একত্রিত করে। অটোরেটার হলো মানুষের মূল্যায়নের মাধ্যমে তৈরি ডেটার উপর প্রশিক্ষিত একটি এমএল মডেল। আদর্শগতভাবে, একটি অটোরেটার একজন মানব মূল্যায়নকারীকে অনুকরণ করতে শেখে।আগে থেকে তৈরি অটোরেটার পাওয়া যায়, কিন্তু সেরা অটোরেটারগুলো বিশেষভাবে আপনার মূল্যায়ন করা কাজের জন্য সূক্ষ্মভাবে টিউন করা থাকে।

স্বয়ংক্রিয়-পশ্চাৎগামী মডেল

এমন একটি মডেল যা তার নিজের পূর্ববর্তী ভবিষ্যদ্বাণীর উপর ভিত্তি করে কোনো পূর্বাভাস অনুমান করে। উদাহরণস্বরূপ, অটো-রিগ্রেসিভ ল্যাঙ্গুয়েজ মডেলগুলো পূর্বে পূর্বাভাসিত টোকেনগুলোর উপর ভিত্তি করে পরবর্তী টোকেনের পূর্বাভাস দেয়। সকল Transformer- ভিত্তিক বৃহৎ ল্যাঙ্গুয়েজ মডেলই অটো-রিগ্রেসিভ।

এর বিপরীতে, GAN- ভিত্তিক ইমেজ মডেলগুলো সাধারণত অটো-রিগ্রেসিভ হয় না, কারণ এগুলো ধাপে ধাপে পুনরাবৃত্তিমূলকভাবে নয়, বরং একটিমাত্র ফরোয়ার্ড-পাসে ইমেজ তৈরি করে। তবে, কিছু নির্দিষ্ট ইমেজ জেনারেশন মডেল অটো-রিগ্রেসিভ হয় , কারণ সেগুলো ধাপে ধাপে ইমেজ তৈরি করে।

বি

বেস মডেল

একটি পূর্ব-প্রশিক্ষিত মডেল যা নির্দিষ্ট কাজ বা অ্যাপ্লিকেশনের জন্য সূক্ষ্ম সমন্বয়ের সূচনা বিন্দু হিসেবে কাজ করতে পারে।

আরও দেখুন প্রি-ট্রেইনড মডেল এবং ফাউন্ডেশন মডেল ।

সি

চিন্তার শৃঙ্খলকে প্ররোচিত করা

প্রম্পট ইঞ্জিনিয়ারিং-এর একটি কৌশল যা একটি বৃহৎ ভাষা মডেলকে (LLM) তার যুক্তি ধাপে ধাপে ব্যাখ্যা করতে উৎসাহিত করে। উদাহরণস্বরূপ, নিম্নলিখিত প্রম্পটটি বিবেচনা করুন এবং দ্বিতীয় বাক্যটির প্রতি বিশেষ মনোযোগ দিন:

একটি গাড়ি ৭ সেকেন্ডে ০ থেকে ৬০ মাইল প্রতি ঘণ্টা গতি তুললে এর চালক কত জি-ফোর্স অনুভব করবেন? উত্তরে, সমস্ত প্রাসঙ্গিক গণনা দেখান।

এলএলএম-এর প্রতিক্রিয়া সম্ভবত হবে:

- উপযুক্ত স্থানে ০, ৬০ এবং ৭ মান বসিয়ে পদার্থবিজ্ঞানের সূত্রগুলোর একটি অনুক্রম দেখাও।

- এটি কেন ওই সূত্রগুলো বেছে নিয়েছে এবং বিভিন্ন ভেরিয়েবলগুলোর অর্থ কী, তা ব্যাখ্যা করুন।

চিন্তার ধারাবাহিকতা উদ্রেককারী নির্দেশনা এলএলএম-কে সমস্ত গণনা সম্পাদন করতে বাধ্য করে, যা আরও সঠিক উত্তরের দিকে নিয়ে যেতে পারে। এছাড়াও, চিন্তার ধারাবাহিকতা উদ্রেককারী নির্দেশনা ব্যবহারকারীকে এলএলএম-এর ধাপগুলো পরীক্ষা করে দেখতে সক্ষম করে যে উত্তরটি যৌক্তিক কি না।

চ্যাট

একটি এমএল সিস্টেমের (সাধারণত একটি বৃহৎ ল্যাঙ্গুয়েজ মডেল ) সাথে কথোপকথনের বিষয়বস্তু। চ্যাটের পূর্ববর্তী আলাপচারিতা (আপনি কী টাইপ করেছেন এবং বৃহৎ ল্যাঙ্গুয়েজ মডেলটি কীভাবে প্রতিক্রিয়া জানিয়েছে) চ্যাটের পরবর্তী অংশগুলোর প্রেক্ষাপট হয়ে ওঠে।

চ্যাটবট হলো একটি বৃহৎ ভাষা মডেলের প্রয়োগ।

প্রসঙ্গযুক্ত ভাষা অন্তর্ভুক্তি

এমন একটি এমবেডিং যা সাবলীল মানব বক্তাদের মতো করে শব্দ ও বাক্যাংশ 'বুঝতে' পারে। প্রসঙ্গ-নির্ভর ভাষা এমবেডিং জটিল বাক্য গঠন, শব্দার্থ এবং প্রেক্ষাপট বুঝতে পারে।

উদাহরণস্বরূপ, ইংরেজি শব্দ ‘cow’- এর এমবেডিংগুলো বিবেচনা করুন। word2vec- এর মতো পুরোনো এমবেডিংগুলো ইংরেজি শব্দগুলোকে এমনভাবে উপস্থাপন করতে পারে যে, এমবেডিং স্পেসে ‘cow’ থেকে ‘bulle’- এর দূরত্ব, ‘ewe’ (স্ত্রী ভেড়া) থেকে ‘ram’ (পুরুষ ভেড়া) বা ‘female’ থেকে ‘male’- এর দূরত্বের অনুরূপ হয়। প্রসঙ্গ-নির্ভর ভাষার এমবেডিংগুলো আরও এক ধাপ এগিয়ে যেতে পারে এই বিষয়টি শনাক্ত করার মাধ্যমে যে, ইংরেজিভাষীরা কখনও কখনও অনানুষ্ঠানিকভাবে ‘cow’ শব্দটি গরু বা ষাঁড় উভয় অর্থেই ব্যবহার করে থাকেন।

প্রসঙ্গ উইন্ডো

একটি মডেল একটি নির্দিষ্ট প্রম্পটে যতগুলো টোকেন প্রসেস করতে পারে। কনটেক্সট উইন্ডো যত বড় হবে, মডেলটি প্রম্পটের সুসংগত এবং সামঞ্জস্যপূর্ণ প্রতিক্রিয়া প্রদানের জন্য তত বেশি তথ্য ব্যবহার করতে পারবে।

কথোপকথনমূলক কোডিং

সফটওয়্যার তৈরির উদ্দেশ্যে আপনার এবং একটি জেনারেটিভ এআই মডেলের মধ্যে একটি পুনরাবৃত্তিমূলক কথোপকথন। আপনি কোনো সফটওয়্যারের বর্ণনা দিয়ে একটি নির্দেশ দেন। তারপর, মডেলটি সেই বর্ণনা ব্যবহার করে কোড তৈরি করে। এরপর, আপনি আগের নির্দেশে বা তৈরি করা কোডের ত্রুটিগুলো সমাধানের জন্য একটি নতুন নির্দেশ দেন এবং মডেলটি হালনাগাদ করা কোড তৈরি করে। তৈরি করা সফটওয়্যারটি যথেষ্ট ভালো না হওয়া পর্যন্ত আপনারা দুজন এইভাবেই আদান-প্রদান চালিয়ে যান।

কথোপকথন কোডিং মূলত ভাইব কোডিং- এর মূল অর্থ।

স্পেসিফিকেশনাল কোডিং-এর সাথে বৈসাদৃশ্য দেখান।

ডি

সরাসরি প্ররোচনা

জিরো-শট প্রম্পটিং -এর সমার্থক শব্দ।

পাতন

একটি মডেলের (যা টিচার নামে পরিচিত) আকার কমিয়ে একটি ছোট মডেলে (যা স্টুডেন্ট নামে পরিচিত) পরিণত করার প্রক্রিয়া, যা মূল মডেলের পূর্বাভাসকে যথাসম্ভব বিশ্বস্ততার সাথে অনুকরণ করে। ডিস্টিলেশন উপকারী, কারণ বড় মডেলটির (টিচার) তুলনায় ছোট মডেলটির দুটি প্রধান সুবিধা রয়েছে:

- দ্রুততর ইনফারেন্স সময়

- স্মৃতিশক্তি এবং শক্তির ব্যবহার হ্রাস পেয়েছে

তবে, শিক্ষার্থীর ভবিষ্যদ্বাণী সাধারণত শিক্ষকের ভবিষ্যদ্বাণীর মতো ভালো হয় না।

ডিস্টিলেশন পদ্ধতিতে স্টুডেন্ট ও টিচার মডেলের প্রেডিকশনের আউটপুটের পার্থক্যের উপর ভিত্তি করে একটি লস ফাংশন সর্বনিম্ন করার জন্য স্টুডেন্ট মডেলকে প্রশিক্ষণ দেওয়া হয়।

পাতন প্রক্রিয়ার সাথে নিম্নলিখিত পদগুলোর তুলনা ও বৈসাদৃশ্য দেখাও:

আরও তথ্যের জন্য মেশিন লার্নিং ক্র্যাশ কোর্সে LLMs: ফাইন-টিউনিং, ডিস্টিলেশন এবং প্রম্পট ইঞ্জিনিয়ারিং দেখুন।

ই

মূল্যায়ন

মূলত এলএলএম মূল্যায়নের সংক্ষিপ্ত রূপ হিসেবে ব্যবহৃত হয়। আরও বিস্তৃত অর্থে, 'ইভ্যালস' হলো যেকোনো ধরনের মূল্যায়নের সংক্ষিপ্ত রূপ।

মূল্যায়ন

কোনো মডেলের গুণমান পরিমাপ করার বা বিভিন্ন মডেলের মধ্যে তুলনা করার প্রক্রিয়া।

একটি সুপারভাইজড মেশিন লার্নিং মডেল মূল্যায়ন করতে, সাধারণত এটিকে একটি ভ্যালিডেশন সেট এবং একটি টেস্ট সেটের সাথে তুলনা করে বিচার করা হয়। একটি এলএলএম (LLM) মূল্যায়নে সাধারণত আরও ব্যাপক গুণমান এবং নিরাপত্তা যাচাই অন্তর্ভুক্ত থাকে।

এফ

বাস্তবতা

এমএল জগতে, এটি এমন একটি মডেলের বৈশিষ্ট্য যার আউটপুট বাস্তবতার উপর ভিত্তি করে তৈরি। বাস্তবতা একটি ধারণা, কোনো পরিমাপক নয়। উদাহরণস্বরূপ, ধরুন আপনি একটি বৃহৎ ল্যাঙ্গুয়েজ মডেলে নিম্নলিখিত প্রম্পটটি পাঠালেন:

খাবার লবণের রাসায়নিক সংকেত কী?

বাস্তবতাকে সর্বোত্তম করার লক্ষ্যে একটি মডেল উত্তর দেবে:

NaCl

এটা ধরে নেওয়া স্বাভাবিক যে সমস্ত মডেলই বাস্তবতার উপর ভিত্তি করে তৈরি হওয়া উচিত। তবে, নিম্নলিখিতগুলির মতো কিছু নির্দেশ একটি জেনারেটিভ এআই মডেলকে বাস্তবতার পরিবর্তে সৃজনশীলতাকে অপ্টিমাইজ করতে উৎসাহিত করে।

আমাকে একজন মহাকাশচারী ও একটি শুঁয়োপোকাকে নিয়ে একটি লিমেরিক বলো।

ফলস্বরূপ লিমেরিকটি বাস্তবতার উপর ভিত্তি করে রচিত হওয়ার সম্ভাবনা কম।

বাস্তবিকতার সাথে বৈসাদৃশ্য দেখান।

দ্রুত ক্ষয়

এলএলএম- এর কর্মক্ষমতা উন্নত করার একটি প্রশিক্ষণ কৌশল। ফাস্ট ডিকে-তে প্রশিক্ষণের সময় লার্নিং রেট দ্রুত কমানো হয়। এই কৌশলটি মডেলকে প্রশিক্ষণ ডেটার সাথে ওভারফিটিং হওয়া থেকে রক্ষা করে এবং জেনারালাইজেশন উন্নত করে।

অল্প-শট প্রম্পটিং

এমন একটি প্রম্পট যাতে একাধিক (বা কয়েকটি) উদাহরণ থাকে, যা দেখায় যে বৃহৎ ল্যাঙ্গুয়েজ মডেলটির কীভাবে প্রতিক্রিয়া জানানো উচিত। উদাহরণস্বরূপ, নিম্নলিখিত দীর্ঘ প্রম্পটটিতে দুটি উদাহরণ রয়েছে যা একটি বৃহৎ ল্যাঙ্গুয়েজ মডেলকে দেখায় কীভাবে একটি কোয়েরির উত্তর দিতে হয়।

| একটি প্রম্পটের অংশ | নোট |

|---|---|

| নির্দিষ্ট দেশটির সরকারি মুদ্রা কোনটি? | যে প্রশ্নের উত্তর আপনি এলএলএম-এর কাছে চান। |

| ফ্রান্স: ইউরো | একটি উদাহরণ। |

| যুক্তরাজ্য: জিবিপি | আরেকটি উদাহরণ। |

| ভারত: | প্রকৃত কোয়েরি। |

সাধারণত, জিরো-শট প্রম্পটিং এবং ওয়ান-শট প্রম্পটিং-এর তুলনায় ফিউ-শট প্রম্পটিং আরও কাঙ্ক্ষিত ফলাফল দেয়। তবে, ফিউ-শট প্রম্পটিং-এর জন্য অপেক্ষাকৃত দীর্ঘ প্রম্পটের প্রয়োজন হয়।

ফিউ-শট প্রম্পটিং হলো প্রম্পট-ভিত্তিক শিখনে প্রয়োগকৃত ফিউ-শট লার্নিং- এর একটি রূপ।

আরও তথ্যের জন্য মেশিন লার্নিং ক্র্যাশ কোর্সে প্রম্পট ইঞ্জিনিয়ারিং দেখুন।

সূক্ষ্ম সমন্বয়

একটি পূর্ব-প্রশিক্ষিত মডেলের প্যারামিটারগুলোকে কোনো নির্দিষ্ট ব্যবহারের জন্য পরিমার্জন করতে তার উপর দ্বিতীয়, কার্য-নির্দিষ্ট প্রশিক্ষণ পর্যায় সম্পাদন করা হয়। উদাহরণস্বরূপ, কিছু বৃহৎ ভাষা মডেলের সম্পূর্ণ প্রশিক্ষণ ক্রমটি নিম্নরূপ:

- প্রাক-প্রশিক্ষণ: একটি বিশাল সাধারণ ডেটাসেটের উপর একটি বৃহৎ ভাষা মডেলকে প্রশিক্ষণ দিন, যেমন ইংরেজি ভাষার উইকিপিডিয়ার সমস্ত পৃষ্ঠা।

- ফাইন-টিউনিং: একটি নির্দিষ্ট কাজ সম্পাদনের জন্য প্রি-ট্রেইনড মডেলকে প্রশিক্ষণ দেওয়া, যেমন চিকিৎসা সংক্রান্ত প্রশ্নের উত্তর দেওয়া। ফাইন-টিউনিং-এ সাধারণত নির্দিষ্ট কাজটিকে কেন্দ্র করে শত শত বা হাজার হাজার উদাহরণ ব্যবহার করা হয়।

আরেকটি উদাহরণ হিসেবে, একটি বৃহৎ চিত্র মডেলের সম্পূর্ণ প্রশিক্ষণ ক্রমটি নিম্নরূপ:

- প্রাক-প্রশিক্ষণ: উইকিমিডিয়া কমন্সের সমস্ত ছবির মতো একটি বিশাল সাধারণ ছবির ডেটাসেটের উপর একটি বৃহৎ ইমেজ মডেলকে প্রশিক্ষণ দিন।

- ফাইন-টিউনিং: পূর্ব-প্রশিক্ষিত মডেলকে একটি নির্দিষ্ট কাজ সম্পাদনের জন্য প্রশিক্ষণ দেওয়া, যেমন অর্কার ছবি তৈরি করা।

সূক্ষ্ম সমন্বয়ের জন্য নিম্নলিখিত কৌশলগুলোর যেকোনো সংমিশ্রণ ব্যবহার করা যেতে পারে:

- পূর্ব-প্রশিক্ষিত মডেলের বিদ্যমান সমস্ত প্যারামিটার পরিবর্তন করা। একে কখনও কখনও সম্পূর্ণ ফাইন-টিউনিং বলা হয়।

- প্রি-ট্রেইনড মডেলের বিদ্যমান প্যারামিটারগুলোর মধ্যে শুধু কয়েকটি পরিবর্তন করা (সাধারণত, আউটপুট লেয়ারের সবচেয়ে কাছের লেয়ারগুলো), এবং অন্যান্য প্যারামিটারগুলো অপরিবর্তিত রাখা (সাধারণত, ইনপুট লেয়ারের সবচেয়ে কাছের লেয়ারগুলো)। প্যারামিটার-দক্ষ টিউনিং দেখুন।

- সাধারণত আউটপুট লেয়ারের সবচেয়ে কাছে থাকা বিদ্যমান লেয়ারগুলোর উপরে আরও লেয়ার যোগ করা হয়।

ফাইন-টিউনিং হলো ট্রান্সফার লার্নিং- এর একটি রূপ। সেই হিসেবে, ফাইন-টিউনিং-এর ক্ষেত্রে প্রি-ট্রেইনড মডেলকে প্রশিক্ষণ দিতে ব্যবহৃত লস ফাংশন বা মডেলের ধরনের চেয়ে ভিন্ন কোনো লস ফাংশন বা মডেল টাইপ ব্যবহার করা হতে পারে। উদাহরণস্বরূপ, আপনি একটি প্রি-ট্রেইনড লার্জ ইমেজ মডেলকে ফাইন-টিউন করে এমন একটি রিগ্রেশন মডেল তৈরি করতে পারেন, যা একটি ইনপুট ইমেজে পাখির সংখ্যা নির্ণয় করতে পারে।

নিম্নলিখিত পরিভাষাগুলোর সাথে ফাইন-টিউনিং-এর তুলনা ও বৈসাদৃশ্য দেখান:

আরও তথ্যের জন্য মেশিন লার্নিং ক্র্যাশ কোর্সে ফাইন-টিউনিং দেখুন।

ফ্ল্যাশ মডেল

গতি এবং কম ল্যাটেন্সির জন্য অপ্টিমাইজ করা তুলনামূলকভাবে ছোট জেমিনি মডেলগুলির একটি সিরিজ। ফ্ল্যাশ মডেলগুলি এমন বিস্তৃত পরিসরের অ্যাপ্লিকেশনের জন্য ডিজাইন করা হয়েছে যেখানে দ্রুত প্রতিক্রিয়া এবং উচ্চ থ্রুপুট অত্যন্ত গুরুত্বপূর্ণ।

ভিত্তি মডেল

একটি বিশাল ও বৈচিত্র্যময় প্রশিক্ষণ সেটের উপর প্রশিক্ষিত একটি অত্যন্ত বৃহৎ পূর্ব-প্রশিক্ষিত মডেল । একটি ভিত্তি মডেল নিম্নলিখিত উভয় কাজই করতে পারে:

- বিভিন্ন ধরনের অনুরোধে ভালোভাবে সাড়া দিন।

- অতিরিক্ত সূক্ষ্ম সমন্বয় বা অন্যান্য কাস্টমাইজেশনের জন্য একটি ভিত্তি মডেল হিসাবে কাজ করে।

অন্য কথায়, একটি ভিত্তি মডেল সাধারণ অর্থে ইতিমধ্যেই বেশ সক্ষম, কিন্তু একটি নির্দিষ্ট কাজের জন্য এটিকে আরও উপযোগী করে তোলার জন্য আরও কাস্টমাইজ করা যেতে পারে।

সাফল্যের ভগ্নাংশ

একটি এমএল মডেলের তৈরি করা টেক্সট মূল্যায়নের একটি মেট্রিক। সফলতার অনুপাত হলো, সফলভাবে তৈরি করা টেক্সটের সংখ্যাকে মোট তৈরি করা টেক্সটের সংখ্যা দিয়ে ভাগ করে পাওয়া মান। উদাহরণস্বরূপ, যদি একটি বড় ল্যাঙ্গুয়েজ মডেল ১০টি কোড ব্লক তৈরি করে, যার মধ্যে পাঁচটি সফল হয়, তাহলে সফলতার অনুপাত হবে ৫০%।

যদিও পরিসংখ্যানের ক্ষেত্রে সফলতার অনুপাত ব্যাপকভাবে উপযোগী, এমএল-এর ক্ষেত্রে এই মেট্রিকটি মূলত কোড জেনারেশন বা গাণিতিক সমস্যার মতো যাচাইযোগ্য কাজগুলো পরিমাপের জন্য ব্যবহৃত হয়।

জি

মিথুন

গুগলের সবচেয়ে উন্নত এআই নিয়ে গঠিত ইকোসিস্টেম। এই ইকোসিস্টেমের উপাদানগুলো হলো:

- বিভিন্ন জেমিনি মডেল ।

- জেমিনি মডেলের ইন্টারেক্টিভ কথোপকথনমূলক ইন্টারফেস। ব্যবহারকারীরা নির্দেশ টাইপ করেন এবং জেমিনি সেই নির্দেশ অনুযায়ী সাড়া দেয়।

- বিভিন্ন জেমিনি এপিআই।

- জেমিনি মডেলের উপর ভিত্তি করে বিভিন্ন ব্যবসায়িক পণ্য; উদাহরণস্বরূপ, জেমিনি ফর গুগল ক্লাউড ।

জেমিনি মডেল

গুগলের অত্যাধুনিক ট্রান্সফরমার -ভিত্তিক মাল্টিমোডাল মডেল । জেমিনি মডেলগুলো বিশেষভাবে এজেন্টের সাথে সমন্বিত হওয়ার জন্য ডিজাইন করা হয়েছে।

ব্যবহারকারীরা ইন্টারেক্টিভ ডায়ালগ ইন্টারফেস এবং এসডিকে-সহ বিভিন্ন উপায়ে জেমিনি মডেলগুলোর সাথে যোগাযোগ করতে পারেন।

জেমা

জেমিনি মডেলগুলো তৈরিতে ব্যবহৃত একই গবেষণা ও প্রযুক্তি দিয়ে নির্মিত হালকা ও উন্মুক্ত মডেলের একটি পরিবার। বিভিন্ন ধরনের জেমা মডেল পাওয়া যায়, যার প্রত্যেকটি ভিশন, কোড এবং নির্দেশনা অনুসরণের মতো ভিন্ন ভিন্ন বৈশিষ্ট্য প্রদান করে। বিস্তারিত জানতে জেমা দেখুন।

GenAI বা genAI

জেনারেটিভ এআই- এর সংক্ষিপ্ত রূপ।

তৈরি করা টেক্সট

সাধারণত, এটি হলো সেই টেক্সট যা একটি এমএল মডেল আউটপুট হিসেবে দেয়। বড় ল্যাঙ্গুয়েজ মডেল মূল্যায়ন করার সময়, কিছু মেট্রিক তৈরি করা টেক্সটকে রেফারেন্স টেক্সটের সাথে তুলনা করে। উদাহরণস্বরূপ, ধরুন আপনি নির্ধারণ করার চেষ্টা করছেন যে একটি এমএল মডেল ফরাসি থেকে ডাচ ভাষায় কতটা কার্যকরভাবে অনুবাদ করে। এই ক্ষেত্রে:

- তৈরি হওয়া টেক্সটটি হলো এমএল মডেলের আউটপুট করা ডাচ অনুবাদ।

- রেফারেন্স টেক্সট হলো ডাচ অনুবাদ যা কোনো মানব অনুবাদক (বা সফটওয়্যার) তৈরি করে।

উল্লেখ্য যে, কিছু মূল্যায়ন কৌশলে রেফারেন্স টেক্সট অন্তর্ভুক্ত থাকে না।

জেনারেটিভ এআই

এটি একটি উদীয়মান ও রূপান্তরমূলক ক্ষেত্র, যার কোনো আনুষ্ঠানিক সংজ্ঞা নেই। তবে, বেশিরভাগ বিশেষজ্ঞই একমত যে জেনারেটিভ এআই মডেল এমন কন্টেন্ট তৈরি করতে পারে, যার মধ্যে নিম্নলিখিত সব বৈশিষ্ট্যই বিদ্যমান:

- জটিল

- সুসংগত

- আসল

জেনারেটিভ এআই-এর উদাহরণগুলো হলো:

- বৃহৎ ভাষা মডেল , যা উন্নতমানের মৌলিক পাঠ্য তৈরি করতে এবং প্রশ্নের উত্তর দিতে পারে।

- চিত্র তৈরির মডেল, যা অনন্য চিত্র তৈরি করতে পারে।

- অডিও এবং সঙ্গীত তৈরির মডেল, যা মৌলিক সঙ্গীত রচনা করতে বা বাস্তবসম্মত বক্তৃতা তৈরি করতে পারে।

- ভিডিও তৈরির মডেল, যা মৌলিক ভিডিও তৈরি করতে পারে।

এলএসটিএম (LSTM) এবং আরএনএন (RNN) -সহ কিছু পুরোনো প্রযুক্তিও মৌলিক এবং সুসংহত বিষয়বস্তু তৈরি করতে পারে। কিছু বিশেষজ্ঞ এই পুরোনো প্রযুক্তিগুলোকে জেনারেটিভ এআই হিসেবে দেখেন, আবার অন্যরা মনে করেন যে সত্যিকারের জেনারেটিভ এআই-এর জন্য ঐ পুরোনো প্রযুক্তিগুলোর উৎপাদিত আউটপুটের চেয়ে আরও জটিল আউটপুট প্রয়োজন।

প্রেডিক্টিভ এমএল- এর সাথে তুলনা করুন।

সোনালী প্রতিক্রিয়া

একটি ভালো প্রতিক্রিয়া হিসেবে পরিচিত। উদাহরণস্বরূপ, নিম্নলিখিত নির্দেশটি দেওয়া হলে:

২ + ২

আশা করা যায়, আদর্শ উত্তরটি হলো:

৪

জিপিটি (জেনারেটিভ প্রি-ট্রেইনড ট্রান্সফরমার)

ওপেনএআই দ্বারা বিকশিত ট্রান্সফরমার -ভিত্তিক বৃহৎ ভাষা মডেলগুলোর একটি পরিবার।

GPT-এর বিভিন্ন সংস্করণ একাধিক পদ্ধতিতে প্রযোজ্য হতে পারে, যার মধ্যে অন্তর্ভুক্ত রয়েছে:

- ছবি তৈরি (উদাহরণস্বরূপ, ImageGPT)

- টেক্সট থেকে ছবিতে রূপান্তর (উদাহরণস্বরূপ, DALL-E )।

এইচ

বিভ্রম

একটি জেনারেটিভ এআই মডেলের এমন ফলাফল তৈরি করা, যা বাস্তব জগৎ সম্পর্কে কোনো দাবি করার ভান করে এবং যা আপাতদৃষ্টিতে বিশ্বাসযোগ্য মনে হলেও প্রকৃতপক্ষে ভুল। উদাহরণস্বরূপ, একটি জেনারেটিভ এআই মডেল যদি দাবি করে যে বারাক ওবামা ১৮৬৫ সালে মারা গিয়েছিলেন, তবে সেটি আসলে বিভ্রমের শিকার ।

মানুষের মূল্যায়ন

এমন একটি প্রক্রিয়া যেখানে মানুষ একটি এমএল মডেলের আউটপুটের গুণমান বিচার করে; উদাহরণস্বরূপ, দ্বিভাষী ব্যক্তিদের দিয়ে একটি এমএল অনুবাদ মডেলের গুণমান বিচার করানো। যেসব মডেলের কোনো একটিমাত্র সঠিক উত্তর নেই, সেগুলোর বিচার করার জন্য মানব মূল্যায়ন বিশেষভাবে উপযোগী।

স্বয়ংক্রিয় মূল্যায়ন এবং স্ব-মূল্যায়নকারী মূল্যায়নের সাথে তুলনা করুন।

মানব সম্পৃক্ততা (HITL)

একটি অস্পষ্টভাবে সংজ্ঞায়িত বাগধারা যার অর্থ নিম্নলিখিত দুটির যেকোনো একটি হতে পারে:

- জেনারেটিভ এআই আউটপুটকে সমালোচনামূলক বা সংশয়পূর্ণ দৃষ্টিতে দেখার নীতি।

- একটি মডেলের আচরণকে রূপদান, মূল্যায়ন এবং পরিমার্জন করতে মানুষের সাহায্য নিশ্চিত করার একটি কৌশল বা ব্যবস্থা। এই প্রক্রিয়ায় মানুষকে অন্তর্ভুক্ত রাখলে একটি এআই যন্ত্রীয় বুদ্ধিমত্তা এবং মানবীয় বুদ্ধিমত্তা উভয় থেকেই উপকৃত হতে পারে। উদাহরণস্বরূপ, এমন একটি ব্যবস্থা যেখানে একটি এআই কোড তৈরি করে এবং পরে সফটওয়্যার ইঞ্জিনিয়াররা তা পর্যালোচনা করেন, সেটি একটি ‘হিউম্যান-ইন-দ্য-লুপ’ ব্যবস্থা।

আমি

প্রাসঙ্গিক শিক্ষা

few-shot prompting- এর সমার্থক শব্দ।

অনুমান

প্রচলিত মেশিন লার্নিং-এ, লেবেলবিহীন উদাহরণের উপর একটি প্রশিক্ষিত মডেল প্রয়োগ করে পূর্বাভাস দেওয়ার প্রক্রিয়াকে বলা হয় সুপারভাইজড লার্নিং। এ বিষয়ে আরও জানতে ইন্ট্রো টু এমএল কোর্সের সুপারভাইজড লার্নিং অংশটি দেখুন।

বৃহৎ ভাষা মডেলের ক্ষেত্রে, ইনফারেন্স হলো একটি প্রশিক্ষিত মডেল ব্যবহার করে কোনো ইনপুট প্রম্পটের প্রতিক্রিয়া তৈরি করার প্রক্রিয়া।

পরিসংখ্যানে অনুমানের অর্থ কিছুটা ভিন্ন। বিস্তারিত জানতে পরিসংখ্যানগত অনুমান বিষয়ে উইকিপিডিয়ার নিবন্ধটি দেখুন।

নির্দেশনা টিউনিং

ফাইন-টিউনিং- এর একটি রূপ যা একটি জেনারেটিভ এআই মডেলের নির্দেশাবলী অনুসরণ করার ক্ষমতাকে উন্নত করে। ইনস্ট্রাকশন টিউনিং-এর মধ্যে একটি মডেলকে ধারাবাহিক নির্দেশনামূলক প্রম্পটের উপর প্রশিক্ষণ দেওয়া হয়, যা সাধারণত বিভিন্ন ধরণের কাজকে অন্তর্ভুক্ত করে। এর ফলে প্রাপ্ত ইনস্ট্রাকশন-টিউনড মডেলটি তখন বিভিন্ন ধরণের কাজে জিরো-শট প্রম্পটের প্রতি কার্যকর প্রতিক্রিয়া তৈরি করতে সক্ষম হয়।

এর সাথে তুলনা ও বৈসাদৃশ্য দেখান:

এল

বৃহৎ ভাষা মডেল

ন্যূনতমপক্ষে, খুব বেশি সংখ্যক প্যারামিটারযুক্ত একটি ল্যাঙ্গুয়েজ মডেল । আরও সহজভাবে বললে, যেকোনো Transformer- ভিত্তিক ল্যাঙ্গুয়েজ মডেল, যেমন Gemini বা GPT ।

আরও তথ্যের জন্য মেশিন লার্নিং ক্র্যাশ কোর্সে লার্জ ল্যাঙ্গুয়েজ মডেল (এলএলএম) দেখুন।

লেটেন্সি

একটি মডেলের ইনপুট প্রক্রিয়াকরণ করে প্রতিক্রিয়া তৈরি করতে যে সময় লাগে। একটি উচ্চ বিলম্বের প্রতিক্রিয়া তৈরি হতে একটি নিম্ন বিলম্বের প্রতিক্রিয়ার চেয়ে বেশি সময় লাগে।

বৃহৎ ভাষা মডেলের লেটেন্সিকে প্রভাবিত করে এমন উপাদানগুলোর মধ্যে রয়েছে:

- ইনপুট এবং আউটপুট টোকেনের দৈর্ঘ্য

- মডেলের জটিলতা

- যে পরিকাঠামোর উপর মডেলটি চলে

রেসপন্সিভ ও ব্যবহারকারী-বান্ধব অ্যাপ্লিকেশন তৈরির জন্য ল্যাটেন্সি অপ্টিমাইজ করা অত্যন্ত গুরুত্বপূর্ণ।

এলএলএম

বৃহৎ ভাষা মডেলের সংক্ষিপ্ত রূপ।

এলএলএম মূল্যায়ন (ইভাল)

বৃহৎ ভাষা মডেল (এলএলএম)-এর কর্মক্ষমতা মূল্যায়নের জন্য একগুচ্ছ মেট্রিক ও বেঞ্চমার্ক। মোটা দাগে, এলএলএম মূল্যায়নগুলো হলো:

- গবেষকদের এলএলএম-এর উন্নতির ক্ষেত্রগুলো চিহ্নিত করতে সাহায্য করুন।

- বিভিন্ন এলএলএম-এর তুলনা করতে এবং কোনো নির্দিষ্ট কাজের জন্য সেরা এলএলএম শনাক্ত করতে এগুলো সহায়ক।

- এলএলএম-এর ব্যবহার নিরাপদ ও নৈতিক তা নিশ্চিত করতে সাহায্য করুন।

আরও তথ্যের জন্য মেশিন লার্নিং ক্র্যাশ কোর্সে লার্জ ল্যাঙ্গুয়েজ মডেল (এলএলএম) দেখুন।

লোরা

নিম্ন-স্তরের অভিযোজনযোগ্যতার সংক্ষিপ্ত রূপ।

নিম্ন-স্তরের অভিযোজনযোগ্যতা (LoRA)

ফাইন টিউনিং -এর জন্য একটি প্যারামিটার-দক্ষ কৌশল, যা মডেলের প্রি-ট্রেইনড ওয়েটগুলোকে "স্থির" করে দেয় (যাতে সেগুলো আর পরিবর্তন করা না যায়) এবং তারপর মডেলে অল্প কিছু ট্রেইনযোগ্য ওয়েট যুক্ত করে। এই ট্রেইনযোগ্য ওয়েটের সেটটি (যা "আপডেট ম্যাট্রিক্স" নামেও পরিচিত) বেস মডেলের চেয়ে যথেষ্ট ছোট হয় এবং তাই এটিকে ট্রেইন করতে অনেক কম সময় লাগে।

LoRA নিম্নলিখিত সুবিধাগুলি প্রদান করে:

- যে ডোমেইনে ফাইন টিউনিং প্রয়োগ করা হয়, সেই ডোমেইনের জন্য মডেলের পূর্বাভাসের গুণমান উন্নত করে।

- যেসব কৌশলে একটি মডেলের সমস্ত প্যারামিটার সূক্ষ্মভাবে সমন্বয় করার প্রয়োজন হয়, তার চেয়ে এটি দ্রুততর সমন্বয় করে।

- একই বেস মডেল ব্যবহার করে একাধিক বিশেষায়িত মডেলকে যুগপৎভাবে পরিবেশন করার সুযোগ দিয়ে এটি ইনফারেন্সের গণনাগত খরচ কমিয়ে আনে।

এম

মেশিন অনুবাদ

সফটওয়্যার (সাধারণত, একটি মেশিন লার্নিং মডেল) ব্যবহার করে এক মানব ভাষা থেকে অন্য মানব ভাষায় পাঠ্য রূপান্তর করা, উদাহরণস্বরূপ, ইংরেজি থেকে জাপানি ভাষায়।

k-তে গড় নির্ভুলতা (mAP@k)

একটি ভ্যালিডেশন ডেটাসেট জুড়ে থাকা সমস্ত 'k-তে গড় নির্ভুলতা' (average precision at k) স্কোরের পরিসংখ্যানগত গড়। 'k-তে গড় নির্ভুলতা'-র একটি ব্যবহার হলো কোনো সুপারিশ সিস্টেম দ্বারা তৈরি সুপারিশগুলোর মান বিচার করা।

যদিও 'মিন অ্যাভারেজ' শব্দগুচ্ছটি পুনরাবৃত্তিমূলক শোনায়, মেট্রিকটির নামটি যথাযথ। সর্বোপরি, এই মেট্রিকটি k সংখ্যক মানে একাধিক গড় নির্ভুলতার গড় নির্ণয় করে।

বিশেষজ্ঞদের মিশ্রণ

একটি প্রদত্ত ইনপুট টোকেন বা উদাহরণ প্রক্রিয়াকরণের জন্য নিউরাল নেটওয়ার্কের প্যারামিটারগুলোর শুধুমাত্র একটি উপসেট (যা বিশেষজ্ঞ নামে পরিচিত) ব্যবহার করে এর কার্যকারিতা বৃদ্ধি করার একটি পদ্ধতি। একটি গেটিং নেটওয়ার্ক প্রতিটি ইনপুট টোকেন বা উদাহরণকে যথাযথ বিশেষজ্ঞ(দের) কাছে প্রেরণ করে।

বিস্তারিত জানতে নিচের যেকোনো একটি গবেষণাপত্র দেখুন:

- অত্যন্ত বৃহৎ নিউরাল নেটওয়ার্ক: স্পার্সলি-গেটেড মিক্সচার-অফ-এক্সপার্টস লেয়ার

- বিশেষজ্ঞদের মিশ্রণ এবং বিশেষজ্ঞ পছন্দের রাউটিং

এমএমআইটি

মাল্টিমোডাল ইনস্ট্রাকশন-টিউনড- এর সংক্ষিপ্ত রূপ।

মডেল ক্যাসকেডিং

এমন একটি সিস্টেম যা একটি নির্দিষ্ট অনুমানমূলক কোয়েরির জন্য আদর্শ মডেলটি নির্বাচন করে।

একদল মডেলের কথা কল্পনা করুন, যেগুলোর মধ্যে খুব বড় (অনেক প্যারামিটারযুক্ত ) থেকে শুরু করে অনেক ছোট (অনেক কম প্যারামিটারযুক্ত) মডেলও রয়েছে। খুব বড় মডেলগুলো ছোট মডেলের তুলনায় ইনফারেন্সের সময় বেশি কম্পিউটেশনাল রিসোর্স ব্যবহার করে। তবে, খুব বড় মডেলগুলো সাধারণত ছোট মডেলের চেয়ে বেশি জটিল অনুরোধ ইনফার করতে পারে। মডেল ক্যাসকেডিং ইনফারেন্স কোয়েরির জটিলতা নির্ধারণ করে এবং তারপর ইনফারেন্স সম্পাদনের জন্য উপযুক্ত মডেলটি বেছে নেয়। মডেল ক্যাসকেডিংয়ের মূল উদ্দেশ্য হলো সাধারণত ছোট মডেল নির্বাচন করে এবং শুধুমাত্র আরও জটিল কোয়েরির জন্য একটি বড় মডেল নির্বাচন করে ইনফারেন্সের খরচ কমানো।

ধরুন, একটি ছোট মডেল ফোনে চলছে এবং সেই মডেলেরই একটি বড় সংস্করণ একটি রিমোট সার্ভারে চলছে। ভালো মডেল ক্যাসকেডিং ছোট মডেলটিকে সাধারণ অনুরোধগুলো সামলাতে এবং শুধুমাত্র জটিল অনুরোধগুলো সামলানোর জন্য রিমোট মডেলটিকে কল করার সুযোগ দিয়ে খরচ ও ল্যাটেন্সি কমিয়ে আনে।

মডেল রাউটারও দেখুন।

মডেল রাউটার

মডেল ক্যাসকেডিং- এ ইনফারেন্সের জন্য আদর্শ মডেল নির্ধারণকারী অ্যালগরিদম। একটি মডেল রাউটার সাধারণত নিজেই একটি মেশিন লার্নিং মডেল, যা একটি প্রদত্ত ইনপুটের জন্য সেরা মডেলটি কীভাবে বেছে নিতে হয় তা ধীরে ধীরে শেখে। তবে, একটি মডেল রাউটার কখনও কখনও একটি সরল, নন-মেশিন লার্নিং অ্যালগরিদমও হতে পারে।

শিক্ষা মন্ত্রণালয়

বিশেষজ্ঞদের মিশ্রণের সংক্ষিপ্ত রূপ।

এমটি

যন্ত্রানুবাদ এর সংক্ষিপ্ত রূপ।

এন

ন্যানো

ডিভাইসে ব্যবহারের জন্য ডিজাইন করা একটি তুলনামূলকভাবে ছোট জেমিনি মডেল । বিস্তারিত জানতে জেমিনি ন্যানো দেখুন।

কোনো একটি সঠিক উত্তর নেই (নোরা)

এমন একটি প্রশ্ন যার একাধিক সঠিক উত্তর আছে। উদাহরণস্বরূপ, নিম্নলিখিত প্রশ্নটির কোনো একটি সঠিক উত্তর নেই:

আমাকে হাতিদের নিয়ে একটা মজার কৌতুক বলো।

যেসব প্রশ্নের কোনো একটি সঠিক উত্তর নেই, সেগুলোর প্রতিক্রিয়া মূল্যায়ন করা সাধারণত একটি সঠিক উত্তরযুক্ত প্রশ্নের মূল্যায়নের চেয়ে অনেক বেশি ব্যক্তিনিষ্ঠ হয়। উদাহরণস্বরূপ, একটি হাতির কৌতুক কতটা মজার, তা মূল্যায়ন করার জন্য একটি পদ্ধতিগত উপায়ের প্রয়োজন হয়।

নোরা

কোনো একটি সঠিক উত্তর না থাকার সংক্ষিপ্ত রূপ।

নোটবুক এলএম

জেমিনি-ভিত্তিক একটি টুল যা ব্যবহারকারীদের ডকুমেন্ট আপলোড করতে এবং তারপর প্রম্পট ব্যবহার করে সেই ডকুমেন্টগুলো সম্পর্কে প্রশ্ন জিজ্ঞাসা করতে, সারসংক্ষেপ করতে বা সাজাতে সক্ষম করে। উদাহরণস্বরূপ, একজন লেখক কয়েকটি ছোট গল্প আপলোড করে নোটবুক এলএম-কে সেগুলোর সাধারণ বিষয়বস্তু খুঁজে বের করতে অথবা কোনটি দিয়ে সেরা চলচ্চিত্র তৈরি করা যাবে তা শনাক্ত করতে বলতে পারেন।

ও

একটি সঠিক উত্তর (ওআরএ)

এমন একটি নির্দেশ যার একটিমাত্র সঠিক উত্তর থাকে। উদাহরণস্বরূপ, নিম্নলিখিত নির্দেশটি বিবেচনা করুন:

সত্য না মিথ্যা: শনি মঙ্গলের চেয়ে বড়।

একমাত্র সঠিক উত্তরটি হলো 'সত্য' ।

এর বিপরীতে , কোনো একটি সঠিক উত্তর নেই ।

এক-শট প্রম্পটিং

একটি প্রম্পট যাতে একটি উদাহরণ থাকে, যা দেখায় যে বৃহৎ ল্যাঙ্গুয়েজ মডেলটির কীভাবে প্রতিক্রিয়া জানানো উচিত। উদাহরণস্বরূপ, নিম্নলিখিত প্রম্পটটিতে একটি উদাহরণ রয়েছে যা দেখায় যে একটি বৃহৎ ল্যাঙ্গুয়েজ মডেলকে কীভাবে একটি কোয়েরির উত্তর দিতে হবে।

| একটি প্রম্পটের অংশ | নোট |

|---|---|

| নির্দিষ্ট দেশটির সরকারি মুদ্রা কোনটি? | যে প্রশ্নের উত্তর আপনি এলএলএম-এর কাছে চান। |

| ফ্রান্স: ইউরো | একটি উদাহরণ। |

| ভারত: | প্রকৃত কোয়েরি। |

নিম্নলিখিত পরিভাষাগুলোর সাথে ওয়ান-শট প্রম্পটিং-এর তুলনা ও বৈসাদৃশ্য দেখান:

ওরা

একটি সঠিক উত্তরের সংক্ষিপ্ত রূপ।

পি

প্যারামিটার-দক্ষ টিউনিং

সম্পূর্ণ ফাইন-টিউনিংয়ের চেয়ে আরও দক্ষতার সাথে একটি বৃহৎ প্রি-ট্রেইনড ল্যাঙ্গুয়েজ মডেল (PLM) ফাইন-টিউন করার জন্য ব্যবহৃত কৌশলগুলির একটি সেট। প্যারামিটার-দক্ষ টিউনিং সাধারণত সম্পূর্ণ ফাইন-টিউনিংয়ের চেয়ে অনেক কম প্যারামিটার ফাইন-টিউন করে, তবুও এটি সাধারণত এমন একটি বৃহৎ ল্যাঙ্গুয়েজ মডেল তৈরি করে যা সম্পূর্ণ ফাইন-টিউনিং থেকে তৈরি একটি বৃহৎ ল্যাঙ্গুয়েজ মডেলের মতোই (বা প্রায় ততটাই) ভালো পারফর্ম করে।

প্যারামিটার-দক্ষ টিউনিং-এর সাথে নিম্নলিখিত বিষয়গুলোর তুলনা ও বৈসাদৃশ্য দেখান:

প্যারামিটার-দক্ষ টিউনিং প্যারামিটার-দক্ষ ফাইন-টিউনিং নামেও পরিচিত।

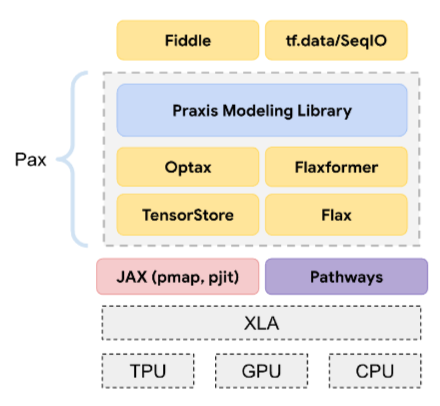

প্যাক্স

একটি প্রোগ্রামিং ফ্রেমওয়ার্ক যা এমন বৃহৎ আকারের নিউরাল নেটওয়ার্ক মডেল প্রশিক্ষণের জন্য ডিজাইন করা হয়েছে, যা একাধিক টিপিইউ অ্যাক্সিলারেটর চিপ স্লাইস বা পড জুড়ে বিস্তৃত থাকে।

Pax তৈরি হয়েছে Flax-এর উপর, যা আবার JAX-এর উপর নির্মিত।

পিএলএম

Abbreviation for pre-trained language model .

post-trained model

Loosely-defined term that typically refers to a pre-trained model that has gone through some post-processing, such as one or more of the following:

pre-trained model

Although this term could refer to any trained model or trained embedding vector , pre-trained model now typically refers to a trained large language model or other form of trained generative AI model.

See also base model and foundation model .

pre-training

The initial training of a model on a large dataset . Some pre-trained models are clumsy giants and must typically be refined through additional training. For example, ML experts might pre-train a large language model on a vast text dataset, such as all the English pages in Wikipedia. Following pre-training, the resulting model might be further refined through any of the following techniques:

প্রো

A Gemini model with fewer parameters than Ultra but more parameters than Nano . See Gemini Pro for details.

দ্রুত

Any text entered as input to a large language model to condition the model to behave in a certain way. Prompts can be as short as a phrase or arbitrarily long (for example, the entire text of a novel). Prompts fall into multiple categories, including those shown in the following table:

| প্রম্পট বিভাগ | উদাহরণ | নোট |

|---|---|---|

| প্রশ্ন | How fast can a pigeon fly? | |

| নির্দেশনা | Write a funny poem about arbitrage. | A prompt that asks the large language model to do something. |

| উদাহরণ | Translate Markdown code to HTML. For example: Markdown: * list item HTML: <ul> <li>list item</li> </ul> | The first sentence in this example prompt is an instruction. The remainder of the prompt is the example. |

| ভূমিকা | Explain why gradient descent is used in machine learning training to a PhD in Physics. | The first part of the sentence is an instruction; the phrase "to a PhD in Physics" is the role portion. |

| Partial input for the model to complete | The Prime Minister of the United Kingdom lives at | A partial input prompt can either end abruptly (as this example does) or end with an underscore. |

A generative AI model can respond to a prompt with text, code, images, embeddings , videos…almost anything.

prompt-based learning

A capability of certain models that enables them to adapt their behavior in response to arbitrary text input ( prompts ). In a typical prompt-based learning paradigm, a large language model responds to a prompt by generating text. For example, suppose a user enters the following prompt:

Summarize Newton's Third Law of Motion.

A model capable of prompt-based learning isn't specifically trained to answer the previous prompt. Rather, the model "knows" a lot of facts about physics, a lot about general language rules, and a lot about what constitutes generally useful answers. That knowledge is sufficient to provide a (hopefully) useful answer. Additional human feedback ("That answer was too complicated." or "What's a reaction?") enables some prompt-based learning systems to gradually improve the usefulness of their answers.

prompt design

Synonym for prompt engineering .

দ্রুত প্রকৌশল

The art of creating prompts that elicit the desired responses from a large language model . Humans perform prompt engineering. Writing well-structured prompts is an essential part of ensuring useful responses from a large language model. Prompt engineering depends on many factors, including:

- The dataset used to pre-train and possibly fine-tune the large language model.

- The temperature and other decoding parameters that the model uses to generate responses.

Prompt design is a synonym for prompt engineering.

See Introduction to prompt design for more details on writing helpful prompts.

prompt set

A group of prompts for evaluating a large language model . For example, the following illustration shows a prompt set consisting of three prompts:

Good prompt sets consist of a sufficiently "wide" collection of prompts to thoroughly evaluate the safety and helpfulness of a large language model.

See also response set .

prompt tuning

A parameter efficient tuning mechanism that learns a "prefix" that the system prepends to the actual prompt .

One variation of prompt tuning—sometimes called prefix tuning —is to prepend the prefix at every layer . In contrast, most prompt tuning only adds a prefix to the input layer .

আর

reference text

An expert's response to a prompt . For example, given the following prompt:

Translate the question "What is your name?" from English to French.

An expert's response might be:

Comment vous appelez-vous?

Various metrics (such as ROUGE ) measure the degree to which the reference text matches an ML model's generated text .

প্রতিফলন

A strategy for improving the quality of an agentic workflow by examining (reflecting on) a step's output before passing that output to the next step.

The examiner is often the same LLM that generated the response (though it could be a different LLM). How could the same LLM that generated a response be a fair judge of its own response? The "trick" is to put the LLM in a critical (reflective) mindset. This process is analogous to a writer who uses a creative mindset to write a first draft and then switches to a critical mindset to edit it.

For example, imagine an agentic workflow whose first step is to create text for coffee mugs. The prompt for this step might be:

You are a creative. Generate humorous, original text of less than 50 characters suitable for a coffee mug.

Now imagine the following reflective prompt:

You are a coffee drinker. Would you find the preceding response humorous?

The workflow might then only pass text that receives a high reflection score to the next stage.

Reinforcement Learning from Human Feedback (RLHF)

Using feedback from human raters to improve the quality of a model's responses . For example, an RLHF mechanism can ask users to rate the quality of a model's response with a 👍 or 👎 emoji. The system can then adjust its future responses based on that feedback.

প্রতিক্রিয়া

The text, images, audio, or video that a generative AI model infers . In other words, a prompt is the input to a generative AI model and the response is the output .

প্রতিক্রিয়া সেট

The collection of responses a large language model returns to an input prompt set .

role prompting

A prompt , typically beginning with the pronoun you , that tells a generative AI model to pretend to be a certain person or a certain role when generating the response . Role prompting can help a generative AI model get into the right "mindset" in order to generate a more useful response. For example, any of the following role prompts might be appropriate depending on the kind of response you are seeking:

You have a PhD in computer science.

You are a software engineer who enjoys giving patient explanations about Python to new programming students.

You are an action hero with a very particular set of programming skills. Assure me that you will find a particular item in a Python list.

এস

soft prompt tuning

A technique for tuning a large language model for a particular task, without resource intensive fine-tuning . Instead of retraining all the weights in the model, soft prompt tuning automatically adjusts a prompt to achieve the same goal.

Given a textual prompt, soft prompt tuning typically appends additional token embeddings to the prompt and uses backpropagation to optimize the input.

A "hard" prompt contains actual tokens instead of token embeddings.

specificational coding

The process of writing and maintaining a file in a human language (for example, English) that describes software. You can then tell a generative AI model or another software engineer to create the software that fulfills that description.

Automatically-generated code generally requires iteration. In specificational coding, you iterate on the description file. By contrast, in conversational coding , you iterate within the prompt box. In practice, automatic code generation sometimes involves a combination of both specificational coding and conversational coding.

টি

তাপমাত্রা

A hyperparameter that controls the degree of randomness of a model's output. Higher temperatures result in more random output, while lower temperatures result in less random output.

Choosing the best temperature depends on the specific application and or string values.

ইউ

আল্ট্রা

The Gemini model with the most parameters . See Gemini Ultra for details.

ভি

শীর্ষবিন্দু

Google Cloud's platform for AI and machine learning. Vertex provides tools and infrastructure for building, deploying, and managing AI applications, including access to Gemini models.ভাইব কোডিং

Prompting a generative AI model to create software. That is, your prompts describe the software's purpose and features, which a generative AI model translates into source code. The generated code doesn't always match your intentions, so vibe coding usually requires iteration.

Andrej Karpathy coined the term vibe coding in this X post . In the X post, Karpathy describes it as "a new kind of coding...where you fully give in to the vibes..." So, the term originally implied an intentionally loose approach to creating software in which you might not even examine the generated code. However, the term has rapidly evolved in many circles to now mean any form of AI-generated coding.

For a more detailed description of vibe coding, seeWhat is vibe coding? .

In addition, compare and contrast vibe coding with:

জেড

zero-shot prompting

A prompt that does not provide an example of how you want the large language model to respond. For example:

| Parts of one prompt | নোট |

|---|---|

| What is the official currency of the specified country? | The question you want the LLM to answer. |

| ভারত: | The actual query. |

The large language model might respond with any of the following:

- রুপি

- ভারতীয় রুপি

- ₹

- ভারতীয় রুপি

- রুপি

- ভারতীয় রুপি

All of the answers are correct, though you might prefer a particular format.

Compare and contrast zero-shot prompting with the following terms: