Bu sayfa, Resim Modelleri sözlük terimleri içermektedir. Tüm sözlük terimleri için burayı tıklayın.

CEVAP

artırılmış gerçeklik

Bilgisayar tarafından oluşturulmuş bir görüntüyü kullanıcının gerçek dünyaya bakışının üzerine bindirerek birleşik bir görünüm sunan teknoloji.

otomatik kodlayıcı

Girişten en önemli bilgileri çıkarmayı öğrenen bir sistem. Otomatik kodlayıcılar, kodlayıcı ve kod çözücü kombinasyonundan oluşur. Otomatik kodlayıcılar aşağıdaki iki adımlı süreci kullanır:

- Kodlayıcı, girişi (tipik olarak) kayıplı düşük boyutlu (orta) bir biçime eşler.

- Kod çözücü, düşük boyutlu biçimi orijinal daha yüksek boyutlu giriş biçimiyle eşleyerek orijinal girişin kayıplı bir sürümünü oluşturur.

Otomatik kodlayıcılar, kod çözücünün orijinal girişi kodlayıcının ara biçiminden mümkün olduğunca yakından yeniden oluşturmaya çalışmasıyla uçtan uca eğitilir. Ara biçim, orijinal biçimden daha küçük (düşük boyutlu) olduğundan, otomatik kodlayıcı girişteki hangi bilgilerin gerekli olduğunu öğrenmeye zorlanır ve çıktı, girişle tamamen aynı olmaz.

Örneğin:

- Girdi verileri grafikse tam olmayan kopya, orijinal grafiğe benzese de biraz değiştirilmiş olur. Tam olmayan kopya, orijinal grafikteki gürültüyü giderebilir veya bazı eksik pikselleri doldurabilir.

- Giriş verileri metinse otomatik kodlayıcı, orijinal metni taklit eden (ancak onunla aynı olmayan) yeni metin oluşturur.

Ayrıca çeşitli otomatik kodlayıcılar bölümünü inceleyin.

otomatik regresif model

Bir tahminde kendi önceki tahminlerine göre sonuç veren bir model. Örneğin, otomatik regresif dil modelleri, önceden tahmin edilen jetonlara dayanarak bir sonraki jetonu tahmin eder. Transformer tabanlı tüm büyük dil modelleri otomatik regresiftir.

Buna karşılık, GAN tabanlı görüntü modelleri ise görüntüyü adımlar halinde yinelemeli olarak değil, tek bir ileri geçişte oluşturdukları için genellikle otomatik regresif değildir. Ancak belirli görüntü oluşturma modelleri, birkaç adımda bir görüntü oluşturdukları için otomatik regresif olur.

B

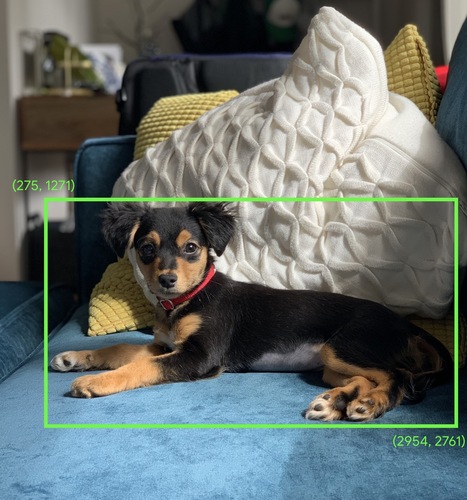

sınırlayıcı kutu

Bir resimde, aşağıdaki resimde bulunan köpek gibi bir alanın etrafındaki dikdörtgenin (x, y) koordinatları.

C

konvolüsyon

Matematikte, normal ifade etmek gerekirse iki işlevin karışımıdır. Makine öğreniminde, bir evrim, ağırlıkları eğitmek için evrimsel filtre ile giriş matrisini karıştırır.

Makine öğrenimindeki "kıvrım" terimi, genellikle evrimsel işlem veya evrimsel katman için kullanılan kısa bir ifadedir.

Konvolüsyonlar olmasaydı makine öğrenimi algoritmasının büyük bir tensördeki her hücre için ayrı bir ağırlık öğrenmesi gerekirdi. Örneğin, 2.000 x 2.000 görüntü üzerinde eğitilen bir makine öğrenimi algoritmasının 4 milyon ayrı ağırlık bulması gerekir. Konvolüsyonlar sayesinde, bir makine öğrenimi algoritmasının yalnızca evrimsel filtredeki her hücre için ağırlıkları bulması yeterli olur. Böylece, modeli eğitmek için gereken bellek önemli ölçüde azalır. Kıvrımlı filtre uygulandığında, filtreler hücreler arasında kolayca çoğaltılır ve her biri filtreyle çarpılır.

kıvrımlı filtre

Bir evrimsel operasyontaki iki oyuncudan biri. (Diğer aktör, giriş matrisinin bir dilimidir.) Kıvrımlı filtre, girdi matrisiyle aynı sıralamaya sahip ancak daha küçük bir şekle sahip bir matristir. Örneğin, 28x28 boyutlarında bir giriş matrisi söz konusu olduğunda filtre, 28x28'den daha küçük herhangi bir 2D matris olabilir.

Fotoğrafik manipülasyonda, kıvrımlı bir filtredeki tüm hücreler genellikle sabit bir ve sıfır desenine ayarlanır. Makine öğreniminde, evrimsel filtreler genellikle rastgele sayılarla başlatılır ve ardından ağ, ideal değerleri etirir.

kıvrımlı katman

Bir giriş matrisinden evrimsel filtrenin geçtiği bir derin sinir ağı katmanı. Örneğin, aşağıdaki 3x3 evrimsel filtreyi ele alalım:

![Şu değerlere sahip 3x3 bir matris: [[0,1,0], [1,0,1], [0,1,0]]](https://developers.google.cn/static/machine-learning/glossary/images/ConvolutionalFilter33.svg?authuser=7&hl=tr)

Aşağıdaki animasyonda, 5x5 giriş matrisini içeren 9 evrişimsel işlemden oluşan kıvrımlı bir katman gösterilmektedir. Her evrişimsel işlemin giriş matrisinin 3x3'lük farklı bir bölümünde çalıştığına dikkat edin. Ortaya çıkan 3x3 matris (sağda), 9 evrimsel işlemin sonuçlarından oluşur:

![İki matrisin gösterildiği bir animasyon. İlk matris 5x5

matrisidir: [[128,97,53,201,198], [35,22,25,200,195],

[37,24,28,197,182], [33,28,92,170]1717,17.17.17.

İkinci matris 3x3 boyutundaki matristir:

[[181,303,618], [115,338,605], [169,351,560]].

İkinci matris, 5x5 matrisin farklı 3x3 alt kümelerinde evrişimsel filtre [[0, 1, 0], [1, 0, 1], [0, 1, 0]] uygulanarak hesaplanır.](https://developers.google.cn/static/machine-learning/glossary/images/AnimatedConvolution.gif?authuser=7&hl=tr)

konvolüsyonel nöral ağ

En az bir katmanın evrimsel katman olduğu bir nöral ağ. Tipik bir evrişimsel nöral ağ, aşağıdaki katmanların bir miktar kombinasyonundan oluşur:

Konvolüsyonel nöral ağlar, görüntü tanıma gibi belirli problem türlerinde çok başarılı olmuştur.

konvolüsyonel işlem

Aşağıdaki iki adımlı matematik işlemi:

- Evrimsel filtrenin ve bir giriş matrisi diliminin öğe bazında çarpımı. (Giriş matrisinin dilimi, kıvrımlı filtre ile aynı sıralamaya ve boyuta sahiptir.)

- Ortaya çıkan ürün matrisindeki tüm değerlerin toplamı.

Örneğin, aşağıdaki 5x5 giriş matrisini ele alalım:

![5x5 matrisi: [[128,97,53,201,198], [35,22,25,200,195],

[37,24,28,197,182], [33,28,92,75,179], [10,0]](https://developers.google.cn/static/machine-learning/glossary/images/ConvolutionalLayerInputMatrix.svg?authuser=7&hl=tr)

Şimdi aşağıdaki 2x2 kıvrımlı filtresini düşünün:

![2x2 matrisi: [[1, 0], [0, 1]]](https://developers.google.cn/static/machine-learning/glossary/images/ConvolutionalLayerFilter.svg?authuser=7&hl=tr)

Her evrişimsel işlem, giriş matrisinin 2x2'lik tek bir dilimini içerir. Örneğin, giriş matrisinin sol üst kısmında 2x2'lik dilimi kullandığımızı varsayalım. Dolayısıyla, bu dilimdeki evrişim işlemi aşağıdaki gibi görünür:

![[[128,97], [35,22]] olan giriş matrisinin sol üstteki 2x2 bölümüne kıvrımlı filtre [[1, 0], [0, 1]] uygulanıyor.

Konvolüsyonel filtre, 128 ve 22 değerlerini olduğu gibi bırakır ancak 97 ve 35 değerlerini sıfırlar. Sonuç olarak, evrişim işlemi 150 (128+22) değerini verir.](https://developers.google.cn/static/machine-learning/glossary/images/ConvolutionalLayerOperation.svg?authuser=7&hl=tr)

Dönüşlü katman, her biri giriş matrisinin farklı bir dilimi üzerinde hareket eden bir dizi kıvrımlı işlemden oluşur.

D

veri genişletme

Ek örnekler oluşturmak için mevcut örnekleri dönüştürerek eğitim örneklerinin kapsamını ve sayısını yapay olarak artırma. Örneğin, görüntülerin özelliklerinizden biri olduğunu ancak veri kümenizin, modelin faydalı ilişkilendirmeleri öğrenmesi için yeterli resim örneği içermediğini varsayalım. İdeal olarak, modelinizin düzgün bir şekilde eğitilmesi için veri kümenize yeterli sayıda etiketli görüntü eklemeniz gerekir. Bu mümkün değilse veri genişletme, orijinal resmin birçok varyantını üretmek için her resmi döndürebilir, genişletebilir ve yansıtabilir. Bu da, mükemmel bir eğitim için muhtemelen yeterli miktarda etiketli veri sağlayabilir.

derinlik olarak ayrılabilir konvolüsyonel nöral ağ (sepCNN)

Inception'ı temel alan, ancak Inception modüllerinin derinlemesine ayrılabilen evrimlerle değiştirildiği bir evrimsel nöral ağ mimarisi. Xception olarak da bilinir.

Derinle ayrılabilir konvolüsyon (ayrılabilir konvolüsyon olarak da kısaltılır), standart bir 3D evrimi, işlem açısından daha verimli olan iki ayrı evrişim işlemine dahil eder. Birincisi, derinlik olarak 1 derinlikte (n, uzunlukta ve derinlikte 1, yok 1 acağını 1 nokta şeklinde) ve sonra ikinci olarak, bir nokta şeklinde, bir derinlik olarak evrim

Daha fazla bilgi için Xception: Depthwise Reparable Convolutions ile Derin Öğrenme bölümüne bakın.

aşağı örnekleme

Aşağıdakilerden biri olabilen aşırı yüklenmiş terim:

- Bir modeli daha verimli bir şekilde etirmek için bir özellikteki bilgi miktarını azaltma. Örneğin, bir görüntü tanıma modelini eğitmeden önce, yüksek çözünürlüklü görüntülerin daha düşük çözünürlüklü bir biçimde örneklemesi kullanılabilir.

- Yeterince temsil edilmeyen sınıflarda model eğitimini iyileştirmek için yeterince temsil edilmeyen sınıf örneklerinden orantısız şekilde düşük oranda eğitim. Örneğin, sınıf dengesiz bir veri kümesinde modeller, çoğunluk sınıfı hakkında çok fazla bilgi edinme eğilimindedir ancak azınlık sınıfı hakkında yeterli bilgi vermez. Aşağı örnekleme, çoğunluk ve azınlık sınıflarıyla ilgili eğitim miktarını dengelemeye yardımcı olur.

F

ince ayar

Önceden eğitilmiş bir model üzerinde gerçekleştirilen göreve özel ikinci bir eğitim kartı, modelin parametrelerini belirli bir kullanım alanına göre hassaslaştırır. Örneğin, bazı büyük dil modelleri için tam eğitim sırası aşağıdaki gibidir:

- Ön eğitim: İngilizce dilindeki tüm Wikipedia sayfaları gibi büyük bir genel veri kümesinde büyük bir dil modelini eğitin.

- Hassas ayar: Önceden eğitilmiş modeli tıbbi sorgulara yanıt verme gibi belirli bir görevi gerçekleştirecek şekilde eğitin. İnce ayarlar genellikle belirli bir göreve odaklanan yüz veya binlerce örnek içerir.

Başka bir örnek olarak, büyük resim modeli için tam eğitim sırası aşağıdaki gibidir:

- Ön eğitim: Wikimedia Commons'daki tüm resimler gibi büyük bir genel görüntü veri kümesinde büyük bir görüntü modelini eğitin.

- Hassas ayarlama: Önceden eğitilmiş modeli, orkaların görüntülerini oluşturma gibi belirli bir görevi gerçekleştirecek şekilde eğitin.

Hassas ayarlamalar için aşağıdaki stratejilerin herhangi bir kombinasyonu gerekebilir:

- Önceden eğitilmiş modelin mevcut parametrelerinin tümünü değiştirme. Bu bazen tam ince ayar olarak da adlandırılır.

- Önceden eğitilmiş modelin mevcut parametrelerinden sadece bazılarını değiştirirken (genellikle çıkış katmanına en yakın katmanlarda değişiklik yaparken) diğer mevcut parametreleri değiştirmeyin (tipik olarak, katmanlar giriş katmanına en yakın olanı yapın). Parametre açısından verimli ayarlama bölümünü inceleyin.

- Genellikle çıkış katmanına en yakın mevcut katmanların üzerine daha fazla katman ekleme.

Hassas ayarlama, bir öğrenme aktarma biçimidir. Bu nedenle ince ayarda, önceden eğitilmiş modeli eğitmek için kullanılanlardan farklı bir kayıp işlevi veya farklı bir model türü kullanılabilir. Örneğin, bir giriş görüntüsündeki kuş sayısını döndüren bir regresyon modeli oluşturmak için, önceden eğitilmiş büyük bir görüntü modelinde ince ayar yapabilirsiniz.

İnce ayarları aşağıdaki terimlerle karşılaştırın:

G

üretken yapay zeka

Resmi tanımı olmayan, dönüştürücü bir alan. Bununla birlikte, çoğu uzman, üretken yapay zeka modellerinin aşağıdakilerin tümünü barındıran içerikler oluşturabileceği konusunda hemfikirdir:

- karmaşık

- tutarlı

- orijinal

Örneğin, üretken yapay zeka modeli karmaşık makaleler veya görseller oluşturabilir.

LSTM ve RNN'ler gibi önceki bazı teknolojiler orijinal ve tutarlı içerik oluşturabilir. Bazı uzmanlar bu eski teknolojileri üretken yapay zeka olarak görürken diğerleri gerçek üretken yapay zekanın önceki teknolojilerin üretebileceğinden daha karmaşık çıktılar gerektirdiğini düşünüyor.

Tahmine dayalı makine öğrenimi ile kontrast oluşturun.

İ

resim tanıma

Bir resimdeki nesneleri, desenleri veya kavramları sınıflandıran işlem. Görüntü tanıma, görüntü sınıflandırma olarak da bilinir.

Daha fazla bilgi için ML Pratiği: Görüntü Sınıflandırma bölümüne bakın.

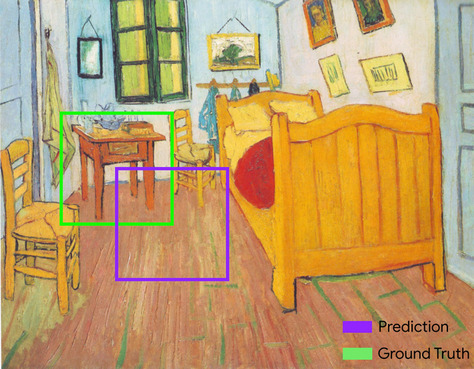

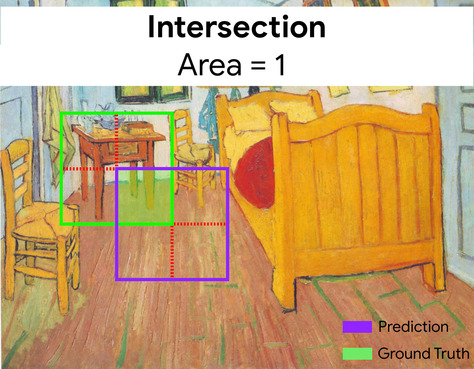

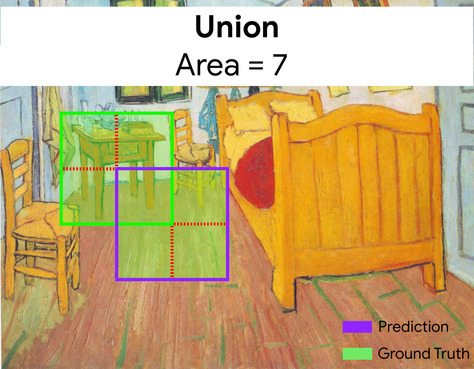

birden fazla kavşak (IoU)

İki kümenin kesişiminin birleşimine bölümü. Makine öğrenimi görüntü algılama görevlerinde IoU, modelin tahmin edilen sınırlayıcı kutusunun kesin referans sınırlayıcı kutusuna göre doğruluğunu ölçmek için kullanılır. Bu durumda, iki kutunun IoU'su, çakışan alan ile toplam alan arasındaki orandır ve değeri 0 (tahmin edilen sınırlayıcı kutu ve kesin referans sınır kutusu çakışmaz) ile 1 (tahmin edilen sınırlayıcı kutu ve kesin referans sınır kutusu tam olarak aynı koordinatlara sahiptir) arasında değişir.

Örneğin, aşağıdaki resimde:

- Tahmin edilen sınırlayıcı kutu (modelin, boyadaki komodinin konumunu tahmin ettiği koordinatlar) mor renkle gösterilir.

- Kesin referans sınırlayıcı kutusu (resimdeki gece masasının gerçekte bulunduğu yeri sınırlayan koordinatlar) yeşil renkle gösterilmiştir.

Burada, tahmin ve kesin referans için sınırlayıcı kutuların (soldan altında) kesişimi 1'dir. Tahmin ile kesin referans için sınırlayıcı kutuların birleşimi (sağda) 7'dir. Dolayısıyla IoU \(\frac{1}{7}\)'dir.

K

önemli noktalar

Bir resimdeki belirli özelliklerin koordinatları. Örneğin, çiçek türlerini ayırt eden bir görüntü tanıma modeli için anahtar noktalar her bir yaprağın merkezi, sapı, erkegi vb. olabilir.

L

önemli noktalar

keypoints ile eş anlamlı.

M

MNIST

LeCun, Cortes ve Burges tarafından derlenen, herkese açık bir veri kümesi olan ve 60.000 görüntü içeren bu görüntülerin her biri, bir insanın 0'dan 9'a kadar belirli bir basamağı nasıl manuel olarak yazdığını göstermektedir. Her görüntü, 28x28'lik bir tam sayı dizisi olarak depolanır. Burada her tam sayı, 0 ile 255 arasında (ikisi de dahil) gri tonlamalı bir değerdir.

MNIST, genellikle yeni makine öğrenimi yaklaşımlarını test etmek için kullanılan standart makine öğrenimi veri kümesidir. Ayrıntılar için MNIST El Yazısı Rakamlar Veritabanı'na göz atın.

P

havuz açma

Daha önceki bir evrimsel katman tarafından oluşturulan bir matrisin (veya matrislerin) daha küçük bir matrise indirgenmesi. Havuz işlemi genellikle havuz alanındaki maksimum veya ortalama değerin alınmasını içerir. Örneğin, aşağıdaki 3x3 matrise sahip olduğumuzu varsayalım:

![3x3 matrisi [[5,3,1], [8,2,5], [9,4,3]].](https://developers.google.cn/static/machine-learning/glossary/images/PoolingStart.svg?authuser=7&hl=tr)

Havlama işlemleri, tıpkı kıvrımlı işlemlerde olduğu gibi, bu matrisi dilimlere böler ve ardından bu kıvrımlı işlemi adımlarla kaydırır. Örneğin, havuzlama işleminin kıvrımlı matrisi 1x1 adımla 2x2 dilimlere böldüğünü varsayalım. Aşağıdaki diyagramda gösterildiği gibi, dört havuz oluşturma işlemi gerçekleşir. Her havuzlama işleminin ilgili dilimdeki dört maksimum değeri seçtiğini düşünün:

![Giriş matrisi, [[5,3,1], [8,2,5], [9,4,3]] değerleriyle 3x3 boyutundadır.

Giriş matrisinin sol üstteki 2x2 boyutundaki alt matrisi [[5,3], [8,2]]'dir. Bu nedenle sol üstteki havuzlama işlemi, 8 değerini verir (maksimum 5, 3, 8 ve 2). Giriş matrisinin sağ üstteki 2x2 boyutundaki alt matrisi [[3,1], [2,5]] olduğundan sağ üstteki havuzlama işlemi 5 değerini verir. Giriş matrisinin sol alttaki 2x2 boyutundaki alt matrisi [[8,2], [9,4]] olduğundan sol alt havuzlama işlemi 9 değerini verir. Giriş matrisinin sağ alttaki 2x2 boyutundaki alt matrisi [[2,5], [4,3]] olduğundan, sağ alt havuzlama işlemi 5 değerini verir. Özetle, havuz oluşturma işlemi 2x2 boyutunda matrisi verir [[8,5], [9,5]].](https://developers.google.cn/static/machine-learning/glossary/images/PoolingConvolution.svg?authuser=7&hl=tr)

Havuzlama, giriş matrisinde çeviri değişmezliğinin uygulanmasına yardımcı olur.

Görüntü uygulamaları için havuzlama, daha resmi olarak uzamsal havuz olarak bilinir. Zaman serisi uygulamalarında, havuz oluşturmaya genellikle geçici havuz oluşturma adı verilir. Daha az resmi olarak, havuzlamaya genellikle alt örnekleme veya aşağı örnekleme denir.

önceden eğitilmiş model

Eğitilmiş modeller veya model bileşenleri (yerleştirme vektörü gibi). Bazen bir nöral ağa, önceden eğitilmiş yerleştirilmiş vektörleri beslersiniz. Diğer durumlarda modeliniz, önceden eğitilmiş yerleştirmelere dayanmak yerine, yerleştirme vektörlerini kendileri eğitir.

Önceden eğitilmiş dil modeli terimi, ön eğitim almış büyük bir dil modelini ifade eder.

ön eğitim

Büyük bir veri kümesi üzerinde bir modelin ilk eğitimi. Önceden eğitilmiş bazı modeller sakar devlerdir ve genellikle ek eğitimle iyileştirilmesi gerekir. Örneğin, makine öğrenimi uzmanları Vikipedi'deki tüm İngilizce sayfalar gibi çok geniş bir metin veri kümesinde büyük bir dil modelini önceden eğitebilir. Ön eğitimin ardından ortaya çıkan model, aşağıdaki tekniklerden herhangi biri kullanılarak daha da hassaslaştırılabilir:

R

dönme varyansı

Bir resim sınıflandırma probleminde, resmin yönü değişse bile algoritmanın resimleri başarıyla sınıflandırabilmesidir. Örneğin algoritma, tenis raketinin yukarı, yan veya aşağı bakma durumunu tespit etmeye devam edebilir. Dönme sabitliğinin her zaman istenmediğini unutmayın. Örneğin, ters dönmüş 9, 9 olarak sınıflandırılmamalıdır.

Ayrıca çeviri değişmezliği ve boyut sabitliği konularına da bakın.

S

boyut sapması

Bir resim sınıflandırma probleminde, bir algoritmanın resmin boyutu değişse bile görüntüleri başarıyla sınıflandırabilmesidir. Örneğin, algoritma yine de 2 milyon piksel veya 200 bin piksel tüketen bir kediyi tanımlayabilir. En iyi görüntü sınıflandırma algoritmalarının bile boyut değişmezliğiyle ilgili pratik sınırları olduğunu unutmayın. Örneğin, bir algoritmanın (veya insanın) yalnızca 20 piksel görüntü alan bir kedi resmini doğru şekilde sınıflandırma ihtimali pek yoktur.

Ayrıca çeviri değişmezliği ve döngüsel değişkenlik konularına da bakın.

mekansal havuzlama

Havuz alma bölümünü inceleyin.

stride

Konvolüsyonel işlem veya havuzlamada, sonraki giriş dilimi serisinin her bir boyutundaki delta. Örneğin, aşağıdaki animasyonda kıvrımlı bir işlem sırasında bir (1,1) adım gösterilmektedir. Bu nedenle, bir sonraki giriş dilimi, önceki giriş diliminin sağında bir konumdan başlar. İşlem sağ kenara ulaştığında, bir sonraki dilim sola doğru bir konum aşağıya doğru ilerler.

Yukarıdaki örnekte iki boyutlu bir adım gösterilmektedir. Giriş matrisi üç boyutluysa adım da üç boyutlu olur.

alt örnekleme

Havuz alma bölümünü inceleyin.

T

sıcaklık

Bir model çıkışının rastgelelik derecesini kontrol eden hiperparametre. Yüksek sıcaklıklar daha fazla rastgele çıkışla, düşük sıcaklıklar ise daha az rastgele çıkışla sonuçlanır.

En iyi sıcaklığın seçilmesi uygulamaya ve model çıktısının tercih edilen özelliklerine bağlıdır. Örneğin, reklam öğesi çıktısı üreten bir uygulama oluştururken muhtemelen sıcaklığı yükseltirsiniz. Buna karşılık, modelin doğruluğunu ve tutarlılığını iyileştirmek için resimleri veya metni sınıflandıran bir model oluştururken muhtemelen sıcaklığı düşürürsünüz.

Sıcaklık genellikle softmax ile kullanılır.

çevrimsel değişkenlik

Bir görüntü sınıflandırma probleminde, bir algoritmanın resim içindeki nesnelerin konumu değişse bile görüntüleri başarılı bir şekilde sınıflandırma yeteneği. Örneğin, çerçevenin ortasında veya karenin sol ucunda olsa da algoritma bir köpeği tanımlayabilir.

Ayrıca, boyut sabitliği ve döngüsel değişkenlik bölümlerini de inceleyin.