Halaman ini berisi istilah glosarium Model Gambar. Untuk semua istilah glosarium, klik di sini.

A

augmented reality

Teknologi yang menempatkan gambar buatan komputer pada tampilan pengguna tentang dunia nyata, sehingga memberikan tampilan komposit.

autoencoder

Sistem yang mempelajari cara mengekstrak informasi yang paling penting dari input. Autoencoder adalah kombinasi dari encoder dan decoder. Autoencoder mengandalkan proses dua langkah berikut:

- Encoder memetakan input ke format (biasanya) dengan dimensi lebih rendah (perantara) yang mengalami derau.

- Dekoder membuat versi lossy dari input asli dengan memetakan format dimensi yang lebih rendah ke format input dimensi yang lebih tinggi.

Autoencoder dilatih secara menyeluruh dengan meminta decoder untuk merekonstruksi input asli dari format perantara encoder sesecara mungkin. Karena format perantara lebih kecil (dimensi lebih rendah) daripada format asli, autoencoder dipaksa untuk mempelajari informasi apa yang penting dalam input, dan output tidak akan sama persis dengan input.

Contoh:

- Jika data input adalah grafik, salinan yang tidak sama persis akan mirip dengan grafik asli, tetapi sedikit dimodifikasi. Mungkin salinan yang tidak sama menghapus derau dari gambar asli atau mengisi beberapa piksel yang hilang.

- Jika data input adalah teks, autoencoder akan menghasilkan teks baru yang meniru (tetapi tidak identik dengan) teks asli.

Lihat juga autoencoder variasional.

model autoregresif

Model yang menyimpulkan prediksi berdasarkan prediksi sebelumnya. Misalnya, model bahasa autoregresif memprediksi token berikutnya berdasarkan token yang diprediksi sebelumnya. Semua model bahasa besar berbasis Transformer bersifat autoregresif.

Sebaliknya, model gambar berbasis GAN biasanya tidak bersifat autoregresif karena menghasilkan gambar dalam satu penerusan maju dan tidak secara iteratif dalam langkah-langkah. Namun, model pembuatan gambar tertentu adalah autoregresif karena membuat gambar secara bertahap.

B

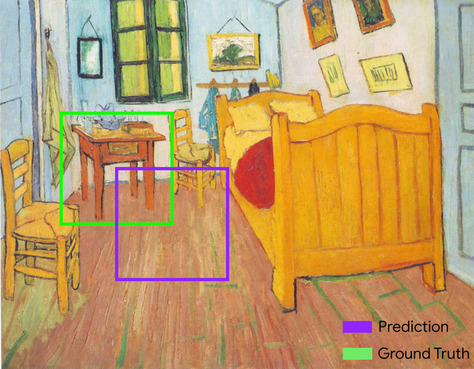

kotak pembatas

Dalam gambar, koordinat (x, y) persegi panjang di sekitar area yang diinginkan, seperti dalam gambar di bawah.

C

konvolusi

Dalam matematika, secara umum, campuran dari dua fungsi. Dalam machine learning, konvolusi mencampur filter konvolusi dan matriks input untuk melatih bobot.

Istilah "konvolusi" dalam machine learning sering kali merupakan cara singkat untuk mengacu pada operasi konvolusi atau lapisan konvolusi.

Tanpa konvolusi, algoritma machine learning harus mempelajari bobot terpisah untuk setiap sel dalam tensor besar. Misalnya, pelatihan algoritma machine learning pada gambar 2K x 2K akan dipaksa untuk menemukan 4 juta bobot terpisah. Berkat konvolusi, algoritma machine learning hanya harus menemukan bobot untuk setiap sel dalam filter konvolusi, yang secara drastis mengurangi memori yang diperlukan untuk melatih model. Saat filter konvolusi diterapkan, filter tersebut hanya direplikasi di seluruh sel sehingga setiap filter dikalikan dengan filter.

Lihat Memperkenalkan Jaringan Neural Konvolusi dalam kursus Klasifikasi Gambar untuk mengetahui informasi selengkapnya.

filter konvolusi

Salah satu dari dua komponen dalam operasi konvolusi. (Aktor lainnya adalah slice matriks input.) Filter konvolusi adalah matriks yang memiliki urutan yang sama dengan matriks input, tetapi bentuknya lebih kecil. Misalnya, dengan matriks input 28x28, filter dapat berupa matriks 2D yang lebih kecil dari 28x28.

Dalam manipulasi fotografi, semua sel dalam filter konvolusi biasanya disetel ke pola konstan dari angka satu dan nol. Dalam machine learning, filter konvolusi biasanya diisi dengan angka acak, lalu jaringan melatih nilai ideal.

Lihat Konvolusi dalam kursus Klasifikasi Gambar untuk mengetahui informasi selengkapnya.

lapisan konvolusi

Lapisan jaringan neural dalam tempat filter konvolusi diteruskan di sepanjang matriks input. Misalnya, pertimbangkan filter konvolusi 3x3 berikut:

![Matriks 3x3 dengan nilai berikut: [[0,1,0], [1,0,1], [0,1,0]]](https://developers.google.cn/static/machine-learning/glossary/images/ConvolutionalFilter33.svg?authuser=8&hl=id)

Animasi berikut menunjukkan lapisan konvolusi yang terdiri dari 9 operasi konvolusi yang melibatkan matriks input 5x5. Perhatikan bahwa setiap operasi konvolusi bekerja pada potongan 3x3 yang berbeda dari matriks input. Matriks 3x3 yang dihasilkan (di sebelah kanan) terdiri dari hasil 9 operasi konvolusi:

![Animasi yang menampilkan dua matriks. Matriks pertama adalah matriks 5x5: [[128,97,53,201,198], [35,22,25,200,195],

[37,24,28,197,182], [33,28,92,195,179], [31,40,100,192,177]].

Matriks kedua adalah matriks 3x3:

[[181,303,618], [115,338,605], [169,351,560]].

Matriks kedua dihitung dengan menerapkan filter konvolusi [[0, 1, 0], [1, 0, 1], [0, 1, 0]] di seluruh subkumpulan 3x3 yang berbeda dari matriks 5x5.](https://developers.google.cn/static/machine-learning/glossary/images/AnimatedConvolution.gif?authuser=8&hl=id)

Lihat Lapisan Fully Connected di kursus Klasifikasi Gambar untuk mengetahui informasi selengkapnya.

jaringan neural konvolusional

Jaringan neural yang setidaknya satu lapisannya adalah lapisan konvolusi. Jaringan saraf konvolusi biasanya terdiri dari beberapa kombinasi lapisan berikut:

Jaringan neural konvolusi telah meraih kesuksesan besar dalam jenis masalah tertentu, seperti pengenalan gambar.

operasi konvolusi

Operasi matematika dua langkah berikut:

- Perkalian berbasis elemen dari filter konvolusi dan potongan dari matriks input. (Potongan matriks input memiliki peringkat dan ukuran yang sama dengan filter konvolusi.)

- Penjumlahan semua nilai dalam matriks produk yang dihasilkan.

Misalnya, pertimbangkan matriks input 5x5 berikut:

![Matriks 5x5: [[128,97,53,201,198], [35,22,25,200,195],

[37,24,28,197,182], [33,28,92,195,179], [31,40,100,192,177]].](https://developers.google.cn/static/machine-learning/glossary/images/ConvolutionalLayerInputMatrix.svg?authuser=8&hl=id)

Sekarang, bayangkan filter konvolusi 2x2 berikut:

![Matriks 2x2: [[1, 0], [0, 1]]](https://developers.google.cn/static/machine-learning/glossary/images/ConvolutionalLayerFilter.svg?authuser=8&hl=id)

Setiap operasi konvolusi melibatkan satu slice 2x2 dari matriks input. Misalnya, kita menggunakan slice 2x2 di kiri atas matriks input. Jadi, operasi konvolusi pada slice ini terlihat seperti berikut:

![Menerapkan filter convolutional [[1, 0], [0, 1]] ke bagian 2x2 kiri atas

matriks input, yaitu [[128,97], [35,22]].

Filter konvolusi membiarkan 128 dan 22 tetap utuh, tetapi meniadakan

97 dan 35. Akibatnya, operasi konvolusi menghasilkan

nilai 150 (128+22).](https://developers.google.cn/static/machine-learning/glossary/images/ConvolutionalLayerOperation.svg?authuser=8&hl=id)

Lapisan konvolusi terdiri dari serangkaian operasi konvolusi, masing-masing bekerja pada potongan matriks input yang berbeda.

D

augmentasi data

Secara artifisial, meningkatkan rentang dan jumlah contoh pelatihan dengan mengubah contoh yang ada untuk membuat contoh tambahan. Misalnya, anggaplah gambar adalah salah satu fitur Anda, tetapi set data Anda tidak berisi contoh gambar yang memadai bagi model untuk mempelajari asosiasi yang berguna. Idealnya, tambahkan gambar berlabel yang memadai ke set data Anda agar model Anda dapat dilatih dengan benar. Jika tindakan tersebut tidak memungkinkan, pengayaan data dapat memutar, melebarkan, dan mencerminkan setiap gambar untuk memproduksi berbagai variasi dari gambar aslinya, yang mungkin menghasilkan data berlabel yang memadai agar dapat melakukan pelatihan yang sangat baik.

jaringan neural konvolusi yang dapat dipisahkan secara mendalam (sepCNN)

Arsitektur jaringan saraf konvolusi berdasarkan Inception, tetapi modul Inception diganti dengan konvolusi yang dapat dipisahkan secara mendalam. Juga dikenal sebagai Xception.

Konvolusi yang dapat dipisahkan secara mendalam (juga disingkat sebagai konvolusi yang dapat dipisahkan) memfaktorkan konvolusi 3D standar menjadi dua operasi konvolusi terpisah yang lebih efisien secara komputasi: pertama, konvolusi kedalaman, dengan kedalaman 1 (n ✕ n ✕ 1), lalu kedua, konvolusi titik, dengan panjang dan lebar 1 (1 ✕ 1 ✕ n).

Untuk mempelajari lebih lanjut, lihat Xception: Deep Learning dengan Konvolusi Depthwise Separable.

penurunan/pengurangan sampel

Istilah yang memiliki lebih dari satu makna:

- Mengurangi jumlah informasi dalam fitur untuk melatih model secara lebih efisien. Misalnya, sebelum melatih model pengenalan gambar, downsampling gambar resolusi tinggi ke format resolusi lebih rendah.

- Melatih contoh class yang terlalu banyak direpresentasikan dengan persentase rendah dan tidak proporsional untuk meningkatkan pelatihan model pada class yang kurang direpresentasikan. Misalnya, dalam set data yang tidak seimbang berdasarkan class, model cenderung mempelajari banyak hal tentang class mayoritas dan tidak cukup mempelajari class minoritas. Penurunan/pengurangan sampel membantu menyeimbangkan jumlah pelatihan pada kelas mayoritas dan minoritas.

Lihat Set data: Set data tidak seimbang di Kursus Singkat Machine Learning untuk mengetahui informasi selengkapnya.

F

penyesuaian

Lulusan pelatihan kedua khusus tugas yang dilakukan pada model terlatih untuk meningkatkan parameternya untuk kasus penggunaan tertentu. Misalnya, urutan pelatihan lengkap untuk beberapa model bahasa besar adalah sebagai berikut:

- Prapelatihan: Melatih model bahasa besar pada set data umum yang luas, seperti semua halaman Wikipedia bahasa Inggris.

- Penyesuaian: Melatih model terlatih untuk melakukan tugas tertentu, seperti merespons kueri medis. Penyesuaian biasanya melibatkan ratusan atau ribuan contoh yang berfokus pada tugas tertentu.

Sebagai contoh lain, urutan pelatihan lengkap untuk model gambar besar adalah sebagai berikut:

- Prapelatihan: Melatih model gambar besar pada set data gambar umum yang luas, seperti semua gambar di Wikimedia commons.

- Penyesuaian: Melatih model terlatih untuk melakukan tugas tertentu, seperti membuat gambar paus orca.

Penyesuaian dapat mencakup kombinasi strategi berikut:

- Mengubah semua parameter yang ada pada model terlatih. Hal ini terkadang disebut penyesuaian penuh.

- Hanya mengubah beberapa parameter yang ada dari model terlatih (biasanya, lapisan yang paling dekat dengan lapisan output), sambil mempertahankan parameter lain yang ada agar tidak berubah (biasanya, lapisan yang paling dekat dengan lapisan input). Lihat parameter-efficient tuning.

- Menambahkan lebih banyak lapisan, biasanya di atas lapisan yang ada dan paling dekat dengan lapisan output.

Penyesuaian adalah bentuk pemelajaran transfer. Dengan demikian, penyesuaian mungkin menggunakan fungsi loss yang berbeda atau jenis model yang berbeda dari yang digunakan untuk melatih model terlatih. Misalnya, Anda dapat menyetel model gambar besar terlatih untuk menghasilkan model regresi yang menampilkan jumlah burung dalam gambar input.

Bandingkan dan bedakan penyesuaian halus dengan istilah berikut:

Lihat Penyesuaian di Kursus Singkat Machine Learning untuk mengetahui informasi selengkapnya.

G

Gemini

Ekosistem yang terdiri dari AI tercanggih Google. Elemen ekosistem ini meliputi:

- Berbagai model Gemini.

- Antarmuka percakapan interaktif ke model Gemini. Pengguna mengetik perintah dan Gemini merespons perintah tersebut.

- Berbagai Gemini API.

- Berbagai produk bisnis berdasarkan model Gemini; misalnya, Gemini untuk Google Cloud.

Model Gemini

Model multimodal berbasis Transformer mutakhir dari Google. Model Gemini dirancang khusus untuk berintegrasi dengan agen.

Pengguna dapat berinteraksi dengan model Gemini dengan berbagai cara, termasuk melalui antarmuka dialog interaktif dan melalui SDK.

AI generatif

Bidang transformatif yang baru muncul tanpa definisi formal. Meskipun demikian, sebagian besar pakar setuju bahwa model AI generatif dapat membuat ("menghasilkan") konten yang merupakan semua hal berikut:

- kompleks

- koheren

- asli

Misalnya, model AI generatif dapat membuat esai atau gambar yang canggih.

Beberapa teknologi sebelumnya, termasuk LSTM dan RNN, juga dapat menghasilkan konten yang orisinal dan koheren. Beberapa pakar memandang teknologi sebelumnya ini sebagai AI generatif, sementara yang lain merasa bahwa AI generatif sejati memerlukan output yang lebih kompleks daripada yang dapat dihasilkan teknologi sebelumnya.

Berbeda dengan ML prediktif.

I

pengenalan gambar

Suatu proses yang mengklasifikasikan objek, pola, atau konsep dalam suatu gambar. Pengenalan gambar juga dikenal sebagai klasifikasi gambar.

Untuk informasi selengkapnya, lihat Praktikum ML: Klasifikasi Gambar.

Lihat kursus Praktikum ML: Klasifikasi Gambar untuk mengetahui informasi selengkapnya.

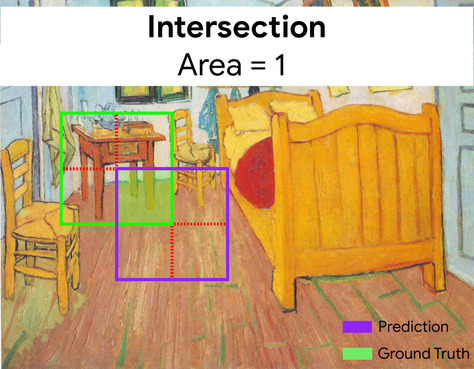

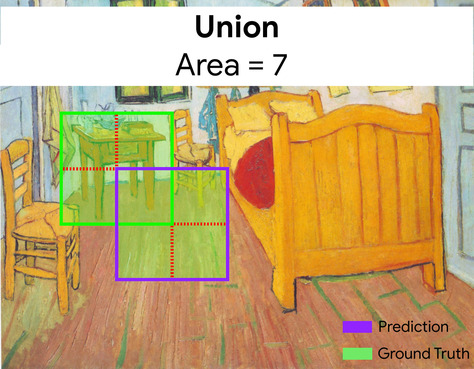

intersection over union (IoU)

Persimpangan dua set yang dibagi dengan gabungannya. Dalam tugas deteksi gambar machine learning, IoU digunakan untuk mengukur akurasi kotak pembatas yang diprediksi model sehubungan dengan kotak pembatas kebenaran dasar. Dalam hal ini, IoU untuk dua kotak adalah rasio antara area tumpang-tindih dan area total, dan nilainya berkisar dari 0 (tidak ada tumpang-tindih antara kotak pembatas yang diprediksi dan kotak pembatas kebenaran dasar) hingga 1 (kotak pembatas yang diprediksi dan kotak pembatas kebenaran dasar memiliki koordinat yang sama persis).

Misalnya, pada gambar di bawah:

- Kotak pembatas yang diprediksi (koordinat yang membatasi tempat model memprediksi lokasi meja malam dalam lukisan) digarisbawahi dengan warna ungu.

- Kotak pembatas ground truth (koordinat yang membatasi lokasi meja samping dalam lukisan yang sebenarnya) digarisbawahi dengan warna hijau.

Di sini, perpotongan kotak pembatas untuk prediksi dan kebenaran dasar (kiri bawah) adalah 1, dan gabungan kotak pembatas untuk prediksi dan kebenaran dasar (kanan bawah) adalah 7, sehingga IoU-nya adalah \(\frac{1}{7}\).

K

keypoint

Koordinat fitur tertentu dalam gambar. Misalnya, untuk model pengenalan gambar yang membedakan spesies bunga, titik kunci mungkin adalah pusat setiap kelopak, batang, stamen, dan sebagainya.

L

tempat terkenal

Sinonim dari titik kunci.

M

MMIT

Singkatan dari multimodal instruction-tuned.

MNIST

Set data domain publik yang dikompilasi oleh LeCun, Cortes, dan Burges yang berisi 60.000 gambar, setiap gambar menunjukkan cara manusia secara manual menulis digit tertentu dari 0–9. Setiap gambar disimpan sebagai array bilangan bulat berukuran 28x28, yang mana setiap bilangan bulat adalah nilai hitam putih antara 0 dan 255, inklusif.

MNIST adalah set data kanonis untuk machine learning, yang sering digunakan untuk menguji pendekatan machine learning baru. Untuk mengetahui detailnya, lihat Database MNIST untuk Digit Tulisan Tangan.

MOE

Singkatan dari mixture of experts.

P

penggabungan

Mengurangi satu atau beberapa matriks yang dibuat oleh lapisan konvolusi sebelumnya ke matriks yang lebih kecil. Penggabungan biasanya melibatkan pengambilan nilai maksimum atau rata-rata di seluruh area gabungan. Misalnya, kita memiliki matriks 3x3 berikut:

![Matriks 3x3 [[5,3,1], [8,2,5], [9,4,3]].](https://developers.google.cn/static/machine-learning/glossary/images/PoolingStart.svg?authuser=8&hl=id)

Operasi penggabungan, seperti operasi konvolusi, membagi matriks tersebut menjadi beberapa potongan, lalu menggeser operasi konvolusi tersebut dengan langkah. Misalnya, operasi penggabungan membagi matriks konvolusi menjadi slice 2x2 dengan langkah 1x1. Seperti yang digambarkan diagram berikut, empat operasi penggabungan terjadi. Bayangkan setiap operasi penggabungan memilih nilai maksimum dari empat nilai dalam slice tersebut:

![Matriks input adalah 3x3 dengan nilai: [[5,3,1], [8,2,5], [9,4,3]].

Submatriks 2x2 kiri atas dari matriks input adalah [[5,3], [8,2]], sehingga

operasi penggabungan kiri atas menghasilkan nilai 8 (yang merupakan

maksimum dari 5, 3, 8, dan 2). Submatriks 2x2 kanan atas dari matriks

input adalah [[3,1], [2,5]], sehingga operasi penggabungan kanan atas menghasilkan

nilai 5. Submatriks 2x2 kiri bawah dari matriks input adalah

[[8,2], [9,4]], sehingga operasi penggabungan kiri bawah menghasilkan nilai

9. Submatriks 2x2 kanan bawah dari matriks input adalah

[[2,5], [4,3]], sehingga operasi penggabungan kanan bawah menghasilkan nilai

5. Singkatnya, operasi penggabungan menghasilkan matriks 2x2

[[8,5], [9,5]].](https://developers.google.cn/static/machine-learning/glossary/images/PoolingConvolution.svg?authuser=8&hl=id)

Penggabungan membantu menerapkan invariansi translasi dalam matriks input.

Pengelompokan untuk aplikasi visi dikenal secara lebih formal sebagai pengelompokan spasial. Aplikasi deret waktu biasanya menyebut penggabungan sebagai penggabungan temporal. Secara tidak resmi, penggabungan sering disebut subsampling atau downsampling.

model pasca-pelatihan

Istilah yang didefinisikan secara longgar yang biasanya mengacu pada model terlatih yang telah melalui beberapa pemrosesan pasca, seperti satu atau beberapa hal berikut:

model terlatih

Biasanya, model yang telah dilatih. Istilah ini juga dapat berarti vektor penyematan yang telah dilatih sebelumnya.

Istilah model bahasa terlatih biasanya mengacu pada model bahasa besar yang telah dilatih.

pra-pelatihan

Pelatihan awal model pada set data besar. Beberapa model terlatih adalah model besar yang canggung dan biasanya harus ditingkatkan melalui pelatihan tambahan. Misalnya, pakar ML mungkin melakukan pra-pelatihan model bahasa besar pada set data teks yang luas, seperti semua halaman bahasa Inggris di Wikipedia. Setelah pra-pelatihan, model yang dihasilkan dapat lebih ditingkatkan lagi melalui salah satu teknik berikut:

R

invariansi rotasional

Dalam masalah klasifikasi gambar, kemampuan algoritma untuk berhasil mengklasifikasikan gambar meskipun orientasi gambar berubah. Misalnya, algoritme tetap dapat mengidentifikasi raket tenis, baik yang mengarah ke atas, ke samping, maupun ke bawah. Perhatikan bahwa invariansi rotasional tidak selalu diinginkan; misalnya, 9 terbalik seharusnya tidak diklasifikasikan sebagai 9.

Lihat juga invariansi translasi dan invariansi ukuran.

S

invariansi ukuran

Dalam masalah klasifikasi gambar, kemampuan algoritma untuk berhasil mengklasifikasikan gambar meskipun ukuran gambar berubah. Misalnya, algoritme tetap dapat mengidentifikasi kucing, baik yang menggunakan 2 juta piksel maupun 200 ribu piksel. Perhatikan bahwa bahkan algoritma klasifikasi gambar terbaik masih memiliki batas praktis pada invarian ukuran. Misalnya, algoritme (atau manusia) tidak mungkin mengklasifikasikan gambar kucing yang hanya menggunakan 20 piksel dengan benar.

Lihat juga invariansi translasi dan invariansi rotasi.

penggabungan spasial

Lihat penggabungan.

langkah

Dalam operasi konvolusi atau penggabungan, delta di setiap dimensi rangkaian berikutnya dari slice input. Misalnya, animasi berikut menunjukkan langkah (1,1) selama operasi konvolusi. Oleh karena itu, slice input berikutnya dimulai satu posisi di sebelah kanan slice input sebelumnya. Saat operasi mencapai tepi kanan, slice berikutnya akan berada di sebelah kiri, tetapi satu posisi ke bawah.

Contoh sebelumnya menunjukkan langkah dua dimensi. Jika matriks input tiga dimensi, stride juga akan tiga dimensi.

subsampling

Lihat penggabungan.

S

suhu

Hyperparameter yang mengontrol tingkat keacakan output model. Suhu yang lebih tinggi menghasilkan output yang lebih acak, sedangkan suhu yang lebih rendah menghasilkan output yang lebih acak.

Memilih suhu terbaik bergantung pada aplikasi tertentu dan properti yang diinginkan dari output model. Misalnya, Anda mungkin akan menaikkan suhu saat membuat aplikasi yang menghasilkan output materi iklan. Sebaliknya, Anda mungkin akan menurunkan suhu saat membuat model yang mengklasifikasikan gambar atau teks untuk meningkatkan akurasi dan konsistensi model.

Suhu sering digunakan dengan softmax.

invariansi translasi

Dalam masalah klasifikasi gambar, kemampuan algoritma untuk berhasil mengklasifikasikan gambar meskipun posisi objek dalam gambar berubah. Misalnya, algoritme tetap dapat mengidentifikasi gambar, meskipun tersebut berada di tengah bingkai atau di ujung kiri bingkai.

Lihat juga invariansi ukuran dan invariansi rotasi.