이 페이지에는 언어 평가 용어집 용어가 포함되어 있습니다. 모든 용어집 용어에 대해 여기를 클릭하세요.

A

Attention,

신경망에서 사용되는 메커니즘으로, 특정 단어 또는 단어의 중요성을 나타냅니다. 시선 감지 모델이 다음 토큰/단어를 예측하는 데 필요한 정보의 양입니다. 일반적인 주목 메커니즘은 입력 세트에 대한 가중치가 적용된 합계로, 각 입력의 가중치는 학습합니다.

셀프 어텐션 및 멀티 헤드 셀프 어텐션(multi-head self-Attention)으로 Transformer의 빌딩 블록과 일치합니다.

자동 인코더

데이터에서 가장 중요한 정보를 추출하는 방법을 학습하여 있습니다. 자동 인코더는 인코더와 디코더. 자동 인코더는 다음과 같은 2단계 프로세스에 의존합니다.

- 인코더는 일반적으로 손실이 있는 저차원에 입력을 매핑합니다. (중급) 형식으로 표시됩니다.

- 디코더는 인코더-디코더를 매핑하여 원본 입력의 손실 버전을 낮은 차원의 형식을 고차원 형식으로 원본으로 입력 형식을 사용합니다.

자동 인코더는 디코더가 자체 캡션 데이터 세트를 인코더의 중간 형식에서 원본 입력을 최대한 가깝게 하고 있습니다. 중간 형식이 더 작기 때문에 인코더가 원래 형식보다 (저차원)일 경우 자동 인코더가 어떤 정보가 중요한지 학습하기만 하면 출력은 입력과 완전히 동일할 것입니다.

예를 들면 다음과 같습니다.

- 입력 데이터가 그래픽인 경우 완전하지 않은 사본은 다음과 유사합니다. 원본 그래픽이지만 약간 수정되었습니다. 아마도 정확하게 일치하지 않는 카피는 원본 그래픽에서 노이즈를 제거하거나 일부 누락된 픽셀이 있습니다.

- 입력 데이터가 텍스트이면 오토인코더는 원본 텍스트와 유사하지만 동일하지는 않습니다.

변분 자동 인코더도 참조하세요.

자동 회귀 모델

자체적인 이전 정보를 바탕으로 예측을 추론하는 모델 학습합니다. 예를 들어 자동 회귀 언어 모델은 token을 실행합니다. 모든 Transformer 기반 대규모 언어 모델은 자동 회귀적입니다.

반면에 GAN 기반 이미지 모델은 일반적으로 자동 회귀적이지 않습니다. 이미지를 하나의 정방향 패스로 생성하고 학습합니다. 하지만 특정 이미지 생성 모델은 자동 회귀적을 수행합니다. 단계별로 이미지를 생성합니다.

B

단어 집합

구문이나 구절에서 단어를 표현한 것입니다. 를 사용합니다. 예를 들어 단어 집합은 다음 세 구문이 동일합니다.

- 개가 점프합니다

- 개를 점프해요

- 개가 점프하는

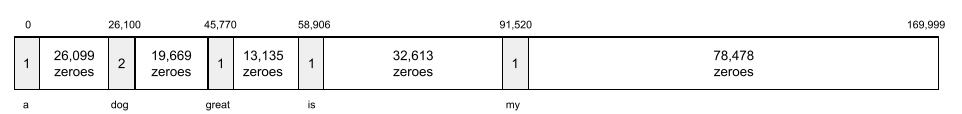

각 단어는 희소 벡터의 색인에 매핑됩니다. 여기서 벡터는 어휘의 모든 단어에 대한 색인을 갖습니다. 예를 들어 개가 점프라는 문구는 0이 아닌 특성 벡터에 매핑됩니다. the, dog, 점프. 0이 아닌 값은 다음 중 하나일 수 있습니다.

- 1은 단어가 있음을 나타냅니다.

- 모음에 단어가 나타나는 횟수입니다. 예를 들어 구문이 적갈색 강아지는 적갈색 털이 있는 강아지인 경우 둘 다 maroon 및 dog는 2로 표시되고 다른 단어는 1로 표현됩니다.

- 다른 값(예: 선형 회귀의 수의 여러 번 반복할 수 있습니다.

BERT (양방향 인코더) Transformer의 표현)

텍스트 표현을 위한 모델 아키텍처 교육을 이수한 BERT 모델은 텍스트 분류를 위한 더 큰 모델의 일부로 ML 작업에 사용할 수 있습니다

BERT에는 다음과 같은 특징이 있습니다.

- Transformer 아키텍처를 사용하므로 (셀프 어텐션)

- Transformer의 인코더 부분을 사용합니다. 인코더의 작업 좋은 텍스트 표현을 생성하기 위한 것입니다. 분류와 같은 태스크에 해당합니다.

- 양방향입니다.

- 다음에 마스킹을 사용합니다. 비지도 학습입니다.

BERT의 변종은 다음과 같습니다.

를 통해 개인정보처리방침을 정의할 수 있습니다.오픈소스 BERT: 자연어를 위한 최첨단 사전 학습'을 참조하세요. 처리 중 BERT의 개요를 살펴봅니다

양방향

두 단어 앞에 있는 텍스트를 평가하는 시스템을 설명하는 데 사용되는 용어 텍스트의 타겟 섹션 뒤에 표시됩니다. 반면에 단방향 시스템만 텍스트의 대상 섹션 앞에 있는 텍스트를 평가합니다.

예를 들어 다음과 같은 마스크 언어 모델이 있다고 가정해 보겠습니다. 에서 밑줄을 나타내는 단어에 대한 확률을 다음 질문에 답해야 합니다.

당신에게 어떤 _____이(가) 있습니까?

단방향 언어 모델은 확률만 기반으로 하면 되며 'What', 'is', 'the'라는 단어에 의해 제공되는 맥락에 관해 자세히 알아보겠습니다. 반면 양방향 언어 모델은 'with'에서 컨텍스트를 획득할 수도 있습니다. '귀하', 모델이 더 나은 예측을 생성하는 데 도움이 될 수 있습니다.

양방향 언어 모델

특정 단어가 될 확률을 판단하는 언어 모델 특정 위치에 주어진 토큰의 텍스트 발췌 부분을 앞 및 뒤 텍스트에 있습니다.

Bigram

N=2인 N-그램입니다.

BLEU (이중 언어 평가 연구)

번역의 품질을 나타내는 0.0에서 1.0 사이의 점수입니다. 있습니다 (예: 영어와 러시아어). BLEU 1.0은 완벽한 번역을 나타냅니다. BLEU 점수가 0.0이면 끔찍한 번역이네요.

C

인과 언어 모델

단방향 언어 모델의 동의어입니다.

다음 내용은 양방향 언어 모델을 참고하세요. 언어 모델링의 다양한 방향성 접근 방식을 대조해 봅니다.

생각의 연쇄 프롬프팅

프롬프트 엔지니어링 기법은 대규모 언어 모델 (LLM)을 사용해 차근차근 살펴보겠습니다 예를 들어 다음과 같은 프롬프트를 살펴보겠습니다. 두 번째 문장에 특히 주의하세요.

자동차에서 운전자가 경험하는 g 힘은 0에서 60 사이입니다. 7초 만에 시속 마일을 얻을 수 있을까? 답변에서 모든 관련 계산을 표시합니다.

LLM의 응답은 다음과 같을 것입니다.

- 0, 60, 7 값을 연결하여 물리학 공식 표시 배치해야 합니다.

- 그 공식을 선택한 이유와 다양한 변수의 의미를 설명하십시오.

생각 체인 프롬프팅은 LLM이 모든 계산을 수행하도록 더 정확한 답이 될 수 있습니다 또한 사용자는 프롬프팅을 통해 LLM의 단계를 검토하여 답이 말이 되지 않습니다

채팅

ML 시스템과 주고받는 대화의 내용은 일반적으로 대규모 언어 모델을 지원합니다. 이전 채팅 대화 (입력한 내용 및 대규모 언어 모델이 응답한 방식)이 컨텍스트를 제공합니다.

챗봇은 대규모 언어 모델을 적용한 애플리케이션입니다.

혼돈

할루시네이션의 동의어입니다.

컨퍼런스는 아마도 할루시네이션보다 기술적으로 더 정확한 용어일 것입니다. 하지만 할루시네이션이 먼저 인기를 끌었습니다.

선거구 파싱

문장을 더 작은 문법적 구조('구성성')로 나누는 것을 말합니다. ML 시스템의 후반부인 자연어 이해 모델 더 쉽게 구성요소들을 파싱할 수 있습니다. 예를 들어 다음 문장을 생각해 보세요.

제 친구가 고양이 두 마리를 입양했어요.

선거구 파서는 이 문장을 다음과 같이 나눌 수 있습니다. 2가지 구성요소:

- Myfriend는 명사구입니다.

- adopted two cats는 동사구입니다.

이러한 성분은 더 작은 성분으로 더 세분화될 수 있습니다. 예를 들어 동사구는

고양이 두 마리를 입양했습니다.

다음으로 더 세분화할 수 있습니다

- adopted는 동사입니다.

- two cats는 또 다른 명사구입니다.

컨텍스트화된 언어 임베딩

'이해'에 가까운 임베딩 단어 이해할 수 있도록 돕는 것입니다. 상황별 언어 임베딩은 복잡한 구문, 시맨틱, 컨텍스트를 이해할 수 있습니다.

예를 들어 영어 단어 cow의 임베딩을 고려해 보세요. 이전 임베딩 word2vec는 영어를 나타낼 수 있습니다. 임베딩 공간 내 거리가 소에서 황소까지의 거리는 ewe (암양)에서 다음까지의 거리와 비슷합니다. 양 (수컷 수) 또는 암컷에서 수컷으로 변경합니다. 상황별 언어 임베딩이 한 걸음 더 나아갈 수 있으며, 영어 사용자가 종종 간단히 소를 사용하여 소나 황소를 의미합니다.

컨텍스트 윈도우

주어진 시간 동안 모델이 처리할 수 있는 토큰 수 프롬프트. 컨텍스트 윈도우가 클수록 더 많은 정보 모델이 일관되고 일관된 응답을 제공하는 데 사용할 수 있는 생성합니다.

중의적 구문

모호한 의미를 가진 문장이나 구입니다. 자연스러운 현상은 중요한 문제를 야기한다. 학습합니다. 예를 들어 광고 제목 Red Tape Holds Up Skyscraper는 이는 NLU 모델이 헤드라인을 문자 그대로 해석하거나 비유적으로 말이죠.

D

decoder

일반적으로 처리되고 밀집된 또는 학습 데이터에서 변환되는 모든 ML 시스템은 보다 원시적이고 희소하거나 외부 표현으로 변환할 수 있습니다.

디코더는 종종 대규모 모델의 구성요소이지만, 인코더와 페어링됩니다.

시퀀스-시퀀스 작업에서 디코더는 인코더가 생성한 내부 상태로 시작하여 시퀀스입니다.

내부에서 디코더의 정의는 Transformer를 참조하세요. 살펴보겠습니다

노이즈 제거

자기 지도 학습의 일반적인 접근 방식 여기에서

노이즈 제거를 통해 라벨이 지정되지 않은 예시로부터 학습할 수 있습니다. 원래 데이터 세트는 대상 또는 대상 label 및 노이즈가 있는 데이터를 입력으로 사용할 수 있습니다.

일부 마스크된 언어 모델은 노이즈 제거 기능을 방법은 다음과 같습니다.

- 노이즈는 텍스트 중 일부를 마스킹하여 라벨이 지정되지 않은 문장에 생성합니다.

- 모델은 원래 토큰을 예측하려고 시도합니다.

직접 프롬프팅

제로샷 프롬프팅의 동의어입니다.

E

거리 수정

두 텍스트 문자열이 서로 얼마나 비슷한지를 측정한 값입니다. 머신러닝에서 거리 수정은 컴퓨팅을 지원하며, 두 문자열을 비교하는 효과적인 방법을 주어진 문자열과 비슷한 문자열을 찾습니다.

편집 거리에는 여러 가지 정의가 있으며 각각 다른 문자열을 사용합니다. 작업을 수행할 수 있습니다 예를 들어 <ph type="x-smartling-placeholder"></ph> 레벤슈타인 거리 가장 적은 삭제, 삽입, 대체 작업을 고려합니다.

예를 들어, '하트'라는 단어 사이의 레벤슈타인 거리입니다. 및 'darts' 다음 세 번의 수정은 한 단어를 바꾸는 데 가장 적게 변경되기 때문에 3번입니다. 다음과 같습니다.

- 하트 → 디아트('h'를 'd'로 대체)

- deart → dart('e' 삭제)

- 다트 → 다트('s' 삽입)

임베딩 레이어

인코더-디코더에서 학습하는 특별한 히든 레이어는 고차원 범주형 특성을 사용하여 점진적으로 저차원 임베딩 벡터를 학습합니다. 임베딩 레이어를 사용하면 신경망이 더 효율적으로 사용하는 것이 좋습니다.

예를 들어 지구는 현재 약 73,000종의 수종을 지원합니다. 가정

수종은 모델의 특성이므로 모델의 특성은

원-핫 벡터 73,000을 포함하는 입력 레이어

요소의 긴 편입니다.

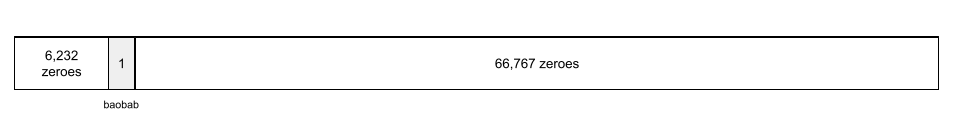

예를 들어 baobab는 다음과 같이 표현할 수 있습니다.

요소 73,000개의 배열은 매우 깁니다. 임베딩 레이어를 추가하지 않는 경우 모델을 학습시키는 데 시간이 오래 걸리면 72,999개의 0을 곱합니다. 임베딩 레이어를 사용하여 12개 차원으로 이루어져 있습니다. 결과적으로 임베딩 레이어는 새로운 임베딩 벡터를 만들었습니다.

특정 상황에서는 해싱이 합리적인 대안입니다. 임베딩 레이어에 있습니다

임베딩 공간

고차원에서 특징이 나타나는 d차원 벡터 공간 매핑된 것입니다. 이상적으로 임베딩 공간에는 의미 있는 수학적 결과를 산출하는 구조 예를 들어 임베딩 덧셈 및 뺄셈 단어 비유 작업을 해결할 수 있습니다.

내적 두 임베딩의 유사성 척도입니다.

임베딩 벡터

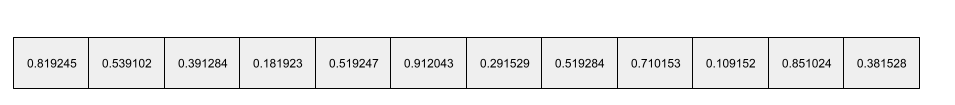

일반적으로 모든 히든 레이어는 해당 히든 레이어에 관한 입력을 설명합니다. 임베딩 벡터는 학습한 부동 소수점 수의 배열인 경우가 많으며 임베딩 레이어입니다 예를 들어 임베딩 레이어가 임베딩 벡터를 생성합니다. 아마도 다음 배열은 바오밥 나무의 임베딩 벡터입니다.

임베딩 벡터는 난수의 집합이 아닙니다. 임베딩 레이어 이러한 값을 결정하는데 이는 모델 학습과 유사하게 신경망은 학습 중에 다른 가중치를 학습합니다. 이 배열은 수종의 일부 특성에 따른 평가입니다. 대상 요소는 어떤 수종의 나무 종인지 특성은 무엇인가요? 진짜 힘들어 인간이 결정할 수 있는 것이죠.

임베딩 벡터의 수학적으로 주목할 부분은 항목은 비슷한 부동 소수점 숫자 집합을 가지고 있습니다. 예를 들어, 수종이 다른 나무보다 더 유사한 부동 소수점 수 안 됩니다. 삼나무와 세쿼이아는 서로 관련된 나무종이지만 따라서 다른 셀보다 코코넛 야자수죠. 임베딩 벡터의 숫자는 모델을 재학습시킨 경우에도 모델을 재학습시킬 때마다 변경 동일한 입력 값을 사용합니다.

인코더

일반적으로 원시 데이터, 희소 데이터 또는 외부 데이터 세트에서 변환되는 모든 ML 시스템은 보다 처리되고 밀도가 높거나 내부적 표현으로 변환할 수 있습니다.

인코더는 종종 대규모 모델의 구성요소이지만, 디코더로 페어링됩니다. 일부 Transformer는 인코더와 디코더를 페어링하지만, 다른 Transformer는 인코더만 사용하여 디코더만 반환합니다.

일부 시스템은 인코더의 출력을 분류 또는 입력 문장의 입력으로 회귀 신경망입니다.

시퀀스-시퀀스 작업에서 인코더는 는 입력 시퀀스를 취하고 내부 상태 (벡터)를 반환합니다. 그런 다음 디코더는 이 내부 상태를 사용하여 다음 시퀀스를 예측합니다.

인코더 정의는 Transformer를 살펴보겠습니다

F

퓨샷 프롬프팅

둘 이상의 예('몇 개')가 포함된 프롬프트 대규모 언어 모델이 응답해야 합니다 예를 들어 다음과 같은 긴 프롬프트에는 쿼리에 답하는 방법을 대규모 언어 모델의 예입니다.

| 프롬프트 구성 요소 | 참고 |

|---|---|

| 지정된 국가의 공식 통화는 무엇인가요? | LLM이 답변할 질문입니다. |

| 프랑스: EUR | 한 가지 예시입니다. |

| 영국: GBP | 또 다른 예로 |

| 인도: | 실제 쿼리입니다. |

퓨샷 프롬프팅은 일반적으로 다른 모델보다 제로샷 프롬프팅 및 원샷 프롬프팅. 하지만 퓨샷 프롬프팅은 더 긴 프롬프트가 필요합니다

퓨샷 프롬프팅은 퓨샷 학습의 한 형태임 이는 프롬프트 기반 학습에 적용됩니다.

바이올린

Python 중심 구성 라이브러리로, 함수와 클래스의 값을 암호화할 수 있습니다. Pax 및 기타 ML 코드베이스의 경우 이러한 함수와 클래스는 모델과 학습을 나타냅니다. 초매개변수

Fiddle 머신러닝 코드베이스가 일반적으로 다음과 같이 나뉩니다.

- 레이어와 옵티마이저를 정의하는 라이브러리 코드

- 데이터 세트 '글루' 코드를 사용하여 라이브러리를 호출하고 모든 것을 함께 연결합니다.

Fiddle은 평가되지 않은 상태로 글루 코드의 호출 구조를 있습니다.

미세 조정

두 번째 작업별 학습 패스는 선행 학습된 모델을 사용하여 특정 세그먼트의 매개변수를 미세 조정합니다. 구체적인 사용 사례를 알아보겠습니다 예를 들어 일부 모델의 전체 학습 시퀀스는 대규모 언어 모델은 다음과 같습니다.

- 사전 학습: 방대한 일반 데이터 세트로 대규모 언어 모델을 학습시킵니다. 모든 영어 위키백과 페이지와 같은 데이터를 예로 들 수 있습니다

- 미세 조정: 선행 학습된 모델을 학습시켜 특정 작업을 수행합니다. 의료 질문에 답하는 등의 기능을 예로 들 수 있습니다 미세 조정에는 일반적으로 특정 태스크에 초점을 맞춘 수백, 수천 개의 예시를 제공합니다.

또 다른 예로, 대형 이미지 모델의 전체 학습 시퀀스는 다음과 같습니다.

- 사전 학습: 방대한 일반 이미지로 대형 이미지 모델을 학습시킵니다. Wikimedia Commons의 모든 이미지와 같은 데이터 세트에 데이터를 추가할 수 있습니다

- 미세 조정: 선행 학습된 모델을 학습시켜 특정 작업을 수행합니다. 예를 들어 범고래 이미지를 생성하는 것입니다.

미세 조정에는 다음과 같은 전략의 조합이 수반될 수 있습니다.

- 선행 학습된 모델의 기존 모델을 모두 수정 매개변수로도 지정할 수 있습니다. 이를 전체 미세 조정이라고도 합니다.

- 선행 학습된 모델의 기존 매개변수 중 일부만 수정 (일반적으로 출력 레이어에 가장 가까운 레이어) 다른 기존 매개변수는 변경하지 않고 (일반적으로 레이어는 (입력 레이어에 가장 가까움). 자세한 내용은 매개변수 효율적인 조정입니다.

- 일반적으로 출력 레이어입니다.

미세 조정은 전이 학습의 한 형태입니다. 따라서 미세 조정에는 다른 손실 함수 또는 다른 모델을 사용할 수 있습니다. 사전 학습된 모델 학습에 사용된 것보다 훨씬 더 높은 유형입니다 예를 들어 선행 학습된 대형 이미지 모델을 미세 조정하여 는 입력 이미지의 새 수를 반환합니다.

미세 조정을 다음 용어와 비교 및 대조합니다.

플랙스

고성능 오픈소스 라이브러리 JAX를 기반으로 구축된 딥 러닝입니다. Flax는 다양한 신경망 학습에도 사용할 수 있습니다. 실적을 평가하는 방법이 될 수 있습니다.

Flaxformer

오픈소스 Transformer 라이브러리 주로 자연어 처리를 위해 설계된 Flax를 기반으로 빌드됨 연구하고 싶었습니다.

G

생성형 AI의

공식적인 정의가 없는 새로운 혁신 분야 그렇지만 대부분의 전문가들은 생성형 AI 모델이 콘텐츠를 생성('생성')하는 데 사용됩니다.

- 복잡함

- 일관성

- 원본

예를 들어 생성형 AI 모델은 정교한 에세이 또는 이미지일 수 있습니다.

LSTMs을 비롯한 일부 초기 기술 RNN도 마찬가지로 일관성 있는 콘텐츠를 제공하세요 일부 전문가들은 이러한 초기 기술이 진정한 생성형 AI에는 더 복잡한 작업이 필요하다고 생각하는 더 높은 수준의 결과물을 얻을 수 있습니다.

예측 ML과 대비되는 개념입니다.

GPT (생성형 선행 학습된 Transformer)

Transformer 기반 제품군 Google Cloud에서 개발한 대규모 언어 모델 OpenAI가 있습니다.

GPT 변형은 다음과 같은 여러 모달리티에 적용할 수 있습니다.

- 이미지 생성 (예: ImageGPT)

- 텍스트 이미지 변환 생성 (예: DALL-E)를 사용합니다.

H

할루시네이션

타당해 보이지만 실제로는 잘못된 출력의 생성을 생성형 AI 모델을 만들어 주장하지 않습니다. 예를 들어 버락 오바마가 1865년에 사망했다고 주장하는 생성형 AI 모델 할루시네이션하는 콘텐츠입니다.

I

컨텍스트 내 학습

퓨샷 프롬프팅의 동의어입니다.

L

LaMDA (대화형 애플리케이션을 위한 언어 모델)

Transformer 기반 Google이 개발한 대규모 언어 모델 대규모 대화 데이터 세트를 학습합니다.

LaMDA: Google의 획기적인 대화 기술을 참고하시기 바랍니다.

언어 모델

토큰의 확률을 예측하는 모델 더 긴 토큰 시퀀스에서 발생하는 토큰의 시퀀스입니다.

대규모 언어 모델

엄격한 정의가 없는 비공식적 용어로, 일반적으로 많은 수의 언어 모델을 매개변수로 지정합니다. 일부 대규모 언어 모델에는 1,000억 개가 넘는 매개변수가 포함되어 있습니다.

잠재 공간

임베딩 공간의 동의어입니다.

LLM

large language model의 약어입니다.

LoRA

Low-Rank Adaptability(저순위 적응성)의 약어입니다.

낮은 순위 적응성 (LoRA)

인코더-디코더 아키텍처를 매개변수 효율적인 조정을 통해 미세 조정은 음악의 하위 집합일 뿐입니다. 대규모 언어 모델의 매개변수를 조정해야 합니다. LoRA는 다음과 같은 이점을 제공합니다.

- 모델의 모든 속성을 미세 조정해야 하는 기술보다 빠르게 미세 조정 매개변수입니다.

- 추론의 계산 비용을 미세 조정된 모델입니다.

LoRA로 조정된 모델은 예측의 품질을 유지하거나 개선합니다.

LoRA는 모델의 여러 특수 버전을 지원합니다.

M

마스킹된 언어 모델

다음 문장의 확률을 예측하는 언어 모델 후보 토큰을 사용하여 시퀀스에서 공백을 채울 수 있습니다. 예를 들어 마스크된 언어 모델은 후보 단어의 확률을 계산할 수 있음 다음 문장의 밑줄을 대체합니다.

모자 속 ____가 돌아왔습니다.

문헌에서는 일반적으로 문자열 'MASK'를 사용합니다. 를 사용하세요. 예를 들면 다음과 같습니다.

'MASK' 돌아왔습니다.

대부분의 최신 마스킹된 언어 모델은 양방향입니다.

메타 러닝

학습 알고리즘을 발견하거나 개선하는 머신러닝의 하위 집합입니다. 메타 러닝 시스템은 새로운 스킬을 빠르게 학습하도록 모델을 학습시키는 것을 목표로 할 수도 있습니다. 소량의 데이터 또는 이전 작업에서 얻은 경험에서 얻은 작업에서 비롯됩니다. 메타 러닝 알고리즘은 일반적으로 다음을 달성하려고 합니다.

- 직접 엔지니어링한 기능 (예: 이니셜라이저 또는 옵티마이저).

- 데이터 효율과 컴퓨팅 효율성을 높입니다.

- 일반화 개선

메타 러닝은 퓨샷 학습과 관련이 있습니다.

modality

상위 수준의 데이터 카테고리입니다. 예를 들어 숫자, 텍스트, 이미지, 동영상 및 오디오는 다섯 가지 형식이 있습니다.

모델 동시 로드

하나의 다른 부분을 배치하는 학습 또는 추론을 확장하는 방법 model, 즉 다른 기기에서 찾을 수 없습니다. 모델 동시 로드 는 단일 기기에 맞추기에는 너무 큰 모델을 지원합니다.

모델 동시 로드를 구현하기 위해 시스템은 일반적으로 다음을 실행합니다.

- 모델을 더 작은 부분으로 분할 (분할)합니다.

- 이러한 작은 부분의 학습을 여러 프로세서에 분산합니다. 각 프로세서는 모델의 자체 부분을 학습시킵니다.

- 결과를 결합하여 단일 모델을 만듭니다.

모델 동시 로드로 인해 학습 속도가 느려집니다.

데이터 동시 로드를 참조하세요.

다중 헤드 셀프 어텐션

Self-attention의 확장으로 셀프 어텐션 메커니즘을 각 위치에 대해 여러 번 반복하는 것입니다.

트랜스포머는 멀티 헤드 셀프 어텐션을 도입했습니다.

멀티모달 모델

입력 또는 출력에 둘 이상이 포함된 모델입니다. 모달리티입니다. 예를 들어 인코더-디코더 아키텍처를 이미지 및 텍스트 캡션 (두 가지 형식)을 특성으로 제공 텍스트 캡션이 이미지에 얼마나 적절한지 나타내는 점수를 출력합니다. 따라서 이 모델의 입력은 멀티모달이고 출력은 유니모달입니다.

N

자연어 이해

사용자가 입력하거나 말한 내용에 따라 사용자의 의도를 파악합니다. 예를 들어, 검색엔진은 자연어 이해를 사용하여 사용자가 입력하거나 말한 내용에 따라 검색하는 내용을 파악할 수 있습니다.

N-그램

N 단어의 순서 시퀀스입니다. 예를 들어 truly madly는 2-그램입니다. 왜냐하면 madly who는 truly madly와 다른 2-그램입니다.

| N | 이 종류의 N-그램에 대한 이름 | 예 |

|---|---|---|

| 2 | 바이그램 또는 2-그램 | 이동, 가기, 점심 식사, 저녁 식사 |

| 3 | 트라이그램 또는 3-그램 | 맹인 쥐 세 마리를 너무 많이 먹어서 |

| 4 | 4-그램 | 공원을 걷고, 바람에 먼지가 덮여 있어, 소년이 렌틸콩을 먹었습니다 |

많은 자연어 이해 모델은 N-그램을 사용하여 사용자가 입력할 다음 단어를 예측합니다. 또는 다음과 같이 말하세요. 예를 들어 사용자가 three bla를 입력했다고 가정해 보겠습니다. 트라이그램을 기반으로 하는 NLU 모델은 사용자는 다음으로 mice를 입력합니다.

N-그램을 다음과 같은 단어 집합과 대조하세요. 단어 집합일 수 있습니다.

NLU

Natural Language의 약어 에 대해 자세히 알아보세요.

O

원샷 프롬프팅

애플리케이션이 대규모 언어 모델이 응답해야 합니다. 예를 들어 다음 프롬프트에는 대규모 언어 모델에서 데이터 기반 의사 결정을 내리는 방법을 쿼리에 답변해야 합니다

| 프롬프트 구성 요소 | 참고 |

|---|---|

| 지정된 국가의 공식 통화는 무엇인가요? | LLM이 답변할 질문입니다. |

| 프랑스: EUR | 한 가지 예시입니다. |

| 인도: | 실제 쿼리입니다. |

원샷 프롬프팅을 다음 용어와 비교 및 대조하세요.

P

매개변수 효율적인 조정

대규모 광고 항목을 미세 조정하기 위한 선행 학습된 언어 모델 (PLM) 완전한 미세 조정보다 더 효율적입니다. 매개변수 효율적 미세 조정은 일반적으로 전체 매개변수보다 훨씬 적은 매개변수를 미세 조정합니다. 미세 조정이지만 일반적으로 작업을 수행하는 대규모 언어 모델 완전 관리형 플랫폼에서 빌드한 대규모 언어 모델로서 미세 조정 등이 있습니다

매개변수 효율적인 조정의 비교 및 대조:

매개변수 효율적인 조정을 매개변수 효율적인 미세 조정이라고도 합니다.

파이프라인

모델 동시 로드의 한 형태이며, 모델의 처리는 연속 단계로 나뉘며 각 단계는 로그인해서는 안 됩니다. 단계에서 하나의 배치를 처리하는 동안 이전 다음 배치에서 작동할 수 있습니다.

단계적 학습도 참고하세요.

PLM

선행 학습된 언어 모델의 약어입니다.

위치 인코딩

시퀀스에서 토큰의 위치에 대한 정보를 추가하여 임베딩을 얻습니다 Transformer 모델은 서로 다른 부분 사이의 관계를 더 잘 이해할 수 있도록 시퀀스입니다.

위치 인코딩의 일반적인 구현은 정현파 함수를 사용합니다. (구체적으로는 정현파 함수의 주파수와 진폭은 시퀀스에서 토큰의 위치에 따라 결정됩니다.) 이 기법은 Transformer 모델이 학습하여 머신러닝의 순서를 결정합니다.

선행 학습된 모델

모델 또는 모델 구성요소 (예: 임베딩 벡터)로 변환할 수 있습니다. 때로는 선행 학습된 임베딩 벡터를 신경망입니다. 또 다른 경우에는 모델이 임베딩 벡터 자체를 빌드할 수도 있습니다.

선행 학습된 언어 모델이라는 용어는 대규모 언어 모델을 빌드하고 사전 학습.

사전 학습

대규모 데이터 세트에 대한 모델의 초기 학습입니다. 일부 선행 학습된 모델 엉뚱한 거인이며 일반적으로 추가 훈련을 통해 다듬어야 합니다. 예를 들어 ML 전문가는 대규모 언어 모델을 학습시키고, 예를 들어 위키백과에 있는 모든 영어 페이지와 같은 내용을 볼 수 있습니다 사전 학습을 진행한 후 결과 모델은 다음 중 하나를 통해 더욱 세분화할 수 있습니다. 기술:

프롬프트

대규모 언어 모델에 입력으로 입력된 모든 텍스트 모델을 특정 방식으로 동작하도록 조건부를 지정할 수 있습니다. 프롬프트는 임의의 길이입니다 (예: 소설의 전체 텍스트). 프롬프트 다음 표에 표시된 카테고리를 포함하여 여러 카테고리로 분류됩니다.

| 프롬프트 카테고리 | 예 | 참고 |

|---|---|---|

| 질문 | 비둘기는 얼마나 빨리 날 수 있나요? | |

| 안내 | 광고용 사이트에 관한 재미있는 시를 써 줘 | 대규모 언어 모델에 무언가 수행하도록 요청하는 프롬프트 |

| 예 | 마크다운 코드를 HTML로 변환합니다. 예를 들면 다음과 같습니다.

마크다운: * 목록 항목 HTML: <ul> <li>목록 항목</li> </ul> |

이 예시 프롬프트의 첫 번째 문장은 안내입니다 프롬프트의 나머지 부분은 예시입니다. |

| 역할 | 경사하강법이 머신러닝 학습에 사용되는 이유를 설명하여 물리학 박사 학위를 받았습니다. | 문장의 첫 부분은 지시입니다. 구문 "물리학 박사 학위 취득" 역할 부분입니다. |

| 완료할 모델의 부분 입력 | 영국 총리는 | 부분 입력 프롬프트는 이 예시처럼 갑자기 끝날 수도 있습니다. 밑줄로 끝나야 합니다. |

생성형 AI 모델은 프롬프트에 텍스트, 코드, 이미지, 임베딩, 동영상 등 거의 모든 것을 의미합니다.

프롬프트 기반 학습

적응할 수 있도록 하는 특정 모델의 기능 임의의 텍스트 입력 (프롬프트)에 대한 응답으로 동작합니다. 일반적인 프롬프트 기반 학습 패러다임에서는 대규모 언어 모델은 프롬프트에 생성하는 것입니다. 예를 들어 사용자가 다음 프롬프트를 입력한다고 가정해 보겠습니다.

뉴턴의 운동 제3법칙 요약

프롬프트 기반 학습을 할 수 있는 모델은 특정 질문에 대답하도록 특별히 훈련되지 않았음 확인할 수 있습니다 오히려 모델은 물리학에 대한 많은 사실을 일반적인 언어 규칙과 일반적인 언어 규칙의 구성 요소 및 도움이 될 것입니다. 이 지식만으로도 있습니다. 사람의 추가 피드백('답변이 너무 복잡함' 또는 '반응이란 무엇인가?')를 통해 일부 프롬프트 기반 학습 시스템은 점진적으로 답변의 유용성을 높일 수 있습니다.

프롬프트 설계

프롬프트 엔지니어링의 동의어입니다.

프롬프트 엔지니어링

원하는 응답을 유도하는 프롬프트를 만드는 기술 대규모 언어 모델에서 추출하는 방법을 학습합니다. 프롬프트를 실행하는 인간 살펴봤습니다 체계적인 프롬프트를 작성하는 것은 유용한 응답을 생성합니다. 프롬프트 엔지니어링은 다음과 같은 다양한 요인이 존재합니다.

- 사전 학습에 사용되는 데이터 세트(가능한 경우) 대규모 언어 모델을 미세 조정합니다.

- temperature 및 기타 디코딩 매개변수는 생성하는 데 사용됩니다.

자세한 내용은 프롬프트 설계 소개 를 참고하세요.

프롬프트 설계는 프롬프트 엔지니어링의 동의어입니다.

프롬프트 조정

매개변수 효율적인 조정 메커니즘 '프리픽스'를 학습하는 시스템에서 실제 프롬프트.

프롬프트 조정의 한 가지 변형(프리픽스 조정이라고도 함)은 모든 레이어 앞에 접두사를 추가합니다. 반면에 대부분의 프롬프트 조정은 입력 레이어에 접두사를 추가합니다.

R

역할 프롬프팅

타겟층을 식별하는 프롬프트의 부분(선택사항) (생성형 AI 모델 응답). 역할 없음 대규모 언어 모델이 제공하는 응답에 유용할 수도 있고 아닐 수도 있습니다 질문할 수 있습니다. 역할 프롬프트를 사용하면 질문에 더 적절하고 도움이 되는 방식으로 대답할 수 있는 확인할 수 있습니다 예를 들어 프롬프트는 굵은 글씨로 표시됩니다.

- 경제학 박사 학위 취득 경우 이 문서를 요약해 주세요.

- 10살짜리에게 조수의 원리를 설명해 줘.

- 2008년 금융 위기를 설명합니다. 어린아이에게 말하듯이 골든 리트리버 등이죠

S

셀프 어텐션 (셀프 어텐션 계층이라고도 함)

일련의 시퀀스를 변환하는 신경망 레이어 임베딩 (예: 토큰 임베딩) 다른 시퀀스로 변환합니다 출력 시퀀스의 각 임베딩은 입력 시퀀스 요소의 정보를 통합하여 생성 어텐션 메커니즘을 통해 전달됩니다.

self-attention의 self 부분은 이해하는 것이 중요합니다. 셀프 어텐션은 Transformer의 빌딩 블록이며 사전 조회를 사용합니다. '검색어', '키', '값'과 같은 용어가 포함됩니다.

셀프 어텐션 레이어는 첫 번째 입력 표현의 시퀀스인 확인할 수 있습니다 단어에 대한 입력 표현은 단순할 수 있고 있습니다. 입력 시퀀스의 각 단어에 대해 신경망은 전체 시퀀스에서 모든 요소와 단어의 관련성 점수를 산정합니다. 학습합니다. 관련성 점수는 단어의 최종 표현 정도를 다른 단어의 표현을 통합합니다.

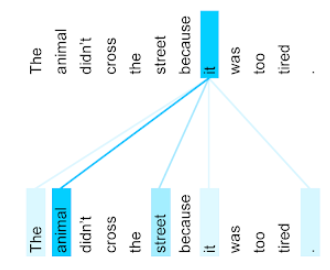

예를 들어 다음 문장을 생각해 보세요.

동물은 너무 피곤해서 길을 건너지 않았습니다.

다음 그림( Transformer: 언어를 위한 새로운 신경망 아키텍처 이해) 대명사 it에 대한 셀프 어텐션 레이어의 주의 패턴을 보여줍니다. 각 단어가 단어의 의미에 얼마나 기여하는지를 나타내는 각 선의 어두움 나타냅니다.

셀프 어텐션 레이어는 '그것'과 관련된 단어를 강조 표시합니다. 이 어텐션 레이어는 선호하는 데 도움이 될 만한 단어를 동물에 가장 높은 가중치를 할당하는 것을 말합니다.

n개의 토큰 시퀀스에 대해 자체 어텐션은 n번의 임베딩을 시퀀스의 각 위치에서 한 번씩 분할합니다.

주의 및 멀티 헤드 셀프 어텐션.

감정 분석

통계 또는 머신러닝 알고리즘을 사용하여 그룹의 서비스, 제품, 서비스에 대한 전반적인 태도(긍정적 또는 부정적)를 구성할 수 있습니다 예를 들어 자연어 이해 텍스트 피드백에 대한 감정 분석을 수행하여 수강할 학생의 학위를 결정하기 위해 전반적으로 좋아하거나 싫어한 과정

시퀀스-투-시퀀스(Seq2Seq) 태스크

tokens의 입력 시퀀스를 출력으로 변환하는 작업 토큰의 시퀀스입니다. 예를 들어 널리 사용되는 두 가지 시퀀스-투-시퀀스(Seq2Seq) 모델과 태스크는 다음과 같습니다.

- 번역사:

<ph type="x-smartling-placeholder">

- </ph>

- 샘플 입력 시퀀스: '사랑해'

- 샘플 출력 시퀀스: 'Je t'aime'

- 질의 응답:

<ph type="x-smartling-placeholder">

- </ph>

- 샘플 입력 시퀀스: '뉴욕시에서 내 차가 필요한가요?'

- 샘플 출력 시퀀스: '아니요. 차는 집에 두시기 바랍니다."

skip-gram

원본에서 단어를 생략 (또는 '건너뛰기')할 수 있는 n-그램 즉, N 단어가 원래 인접하지 않았을 수 있습니다. 더보기 정확히 말해 'k-skip-n-gram' 최대 k개의 단어를 가질 수 있는 건너뛰었습니다.

예: '빠른 갈색 여우' 에는 다음과 같은 2-그램이 있습니다.

- '빠른'

- "빠른 갈색"

- '갈색 여우'

'1-skip-2-gram' 사이에 최대 1개의 단어가 있는 단어 쌍입니다. '빠른 갈색 여우'는 다음과 같은 1-건너뛰기 2-그램이 있습니다.

- 'the brown'

- "빠른 여우"

또한 모든 2-그램은 또한 1-skip-2-gram입니다. 건너뛸 수 있습니다.

건너뛰기-그램은 단어 주변 컨텍스트를 더 많이 이해하는 데 유용합니다. 이 예에서는 'fox'가 사용됩니다. '빠른' 검색어와 인코더-디코더 1-skip-2-gram이지만 2-gram 세트에는 포함되지 않음.

학습에 도움이 되는 건너뛰기-그램 단어 임베딩 모델입니다.

소프트 프롬프트 조정

대규모 언어 모델을 조정하는 기술 리소스를 많이 쓰지 않고도 특정 태스크에 맞게 미세 조정 모든 머신러닝 프로세스를 모델의 가중치, 소프트 프롬프트 조정 동일한 목표를 달성하기 위해 프롬프트를 자동으로 조정합니다.

텍스트 프롬프트에 따른 소프트 프롬프트 조정 일반적으로 프롬프트에 추가 토큰 임베딩을 추가하고 역전파를 통해 입력을 최적화할 수 있습니다.

'어려움' 프롬프트에는 토큰 임베딩 대신 실제 토큰이 포함됩니다.

희소 특성

대부분의 값이 0이거나 비어 있는 특성입니다. 예를 들어 하나의 값 1개와 백만 개의 0 값을 포함하는 특성은 희소. 반대로 밀집 특성은 대부분의 경우 0이 아니거나 비어 있습니다.

머신러닝에서 희소 특성은 놀라울 정도로 많습니다. 범주형 특성은 일반적으로 희소 특성입니다. 예를 들어, 한 숲에서 300종의 수목 중에서 단풍나무만 식별할 수도 있습니다. 또는 수백만 개의 가장 가능성이 높은 동영상을 찾는다면 한 가지 예를 통해 '카사블랑카'만 입력하면 됩니다.

모델에서는 일반적으로 희소 특성을 원-핫 인코딩. 원-핫 인코딩이 큰 경우에는 임베딩 레이어를 레이어의 원-핫 인코딩을 사용해 효율성을 높입니다.

희소 표현

희소 지형지물에 0이 아닌 요소의 위치만 저장합니다.

예를 들어 species라는 범주형 특성이

볼 수 있습니다. 또한 각

example은 단일 종만 식별합니다.

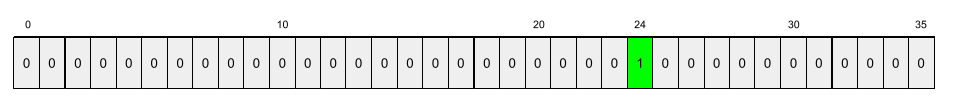

원-핫 벡터를 사용하여 각 예에서 수종을 나타낼 수 있습니다.

원-핫 벡터에는 단일 1(

35개의 0 (해당 예의 특정 수종)

이 예에서는 없는 수종 35종). 즉, 원-핫 표현은

maple의 상태는 다음과 같을 수 있습니다.

반면에 희소 표현은 단순히 주어진 요소의 위치를 식별합니다.

찾을 수 있습니다. maple이 위치 24에 있으면 희소 표현입니다.

maple의 관계는 다음과 같습니다.

24

희소 표현은 원-핫보다 훨씬 간결하다는 것을 알 수 있습니다. 나타냅니다.

단계적 학습

불연속 단계의 시퀀스로 모델을 학습시키는 전략입니다. 목표는 즉, 학습 프로세스 속도를 높이거나 모델 품질을 향상시키는 데 사용할 수 있습니다

다음은 점진적 스태킹 접근 방식을 보여주는 그림입니다.

- 1단계에는 3개의 히든 레이어가 있고, 2단계에는 6개의 히든 레이어가 있습니다. 3단계에는 12개의 히든 레이어가 있습니다.

- 2단계에서는 3개의 히든 레이어에서 학습된 가중치로 학습을 시작 구현해 보겠습니다. 3단계에서는 6단계에서 학습한 가중치로 학습을 시작합니다. 2단계의 히든 레이어로 구성됩니다.

파이프라이닝도 참고하세요.

하위 단어 토큰

언어 모델에서 토큰 단어의 하위 문자열이며 전체 단어일 수 있습니다.

예를 들어 'itemize'와 같은 단어는 '항목'이라는 단어의 조각으로 (어근) 및 'ize' (접미사)로, 각 접미어는 토큰입니다. 일반적이지 않은 단어를 하위 단어라고 하는 이러한 조각으로 나누면 단어의 더 일반적인 구성 부분에서 작동하기 위해 접두사 및 접미어를 예로 들 수 있습니다

반대로 '가는'와 같은 일반적인 단어는 분할되지 않을 수도 있고 단일 토큰으로 표현됩니다.

T

T5

텍스트 간 전이 학습 모델 도입 2020년 Google AI. T5는 인코더-디코더-디코더 모델로, 초대형 대규모 데이터 세트에서 학습된 Transformer 아키텍처 데이터 세트로 그룹화됩니다. 다양한 자연어 처리 태스크에 효과적이므로 텍스트 생성, 언어 번역, 질문에 답하기 등의 작업은 대화하는 방식으로 이루어집니다.

T5는 '텍스트 간 전송 Transformer'의 5가지 T에서 이름을 따왔습니다.

T5X

이를 위해 설계된 머신러닝 오픈소스 프레임워크 대규모 자연어 처리를 빌드하고 학습하는 데 모델을 학습시키는 작업도 반복해야 합니다 T5는 T5X 코드베이스( JAX 및 Flax에서 빌드됩니다.

기온

무작위성의 수준을 제어하는 초매개변수 출력됩니다. 온도가 높을수록 출력이 더 무작위이고 온도가 낮을수록 무작위 출력이 줄어듭니다.

최적의 온도를 선택하는 것은 특정 용도와 사용 방법에 따라 선호되는 속성을 정의합니다. 예를 들어 애플리케이션 개발 단계에서 CPU 사용률이 창의적인 결과물을 생성합니다. 반대로 온도가 낮아지면 성능을 개선하기 위해 이미지나 텍스트를 분류하는 모델을 빌드할 때 모델의 정확성과 일관성이 유지되어야 합니다.

온도는 소프트맥스와 함께 자주 사용됩니다.

텍스트 범위

텍스트 문자열의 특정 하위 섹션과 연관된 배열 색인 스팬입니다.

예를 들어 Python 문자열 s="Be good now"의 good 단어가

3~6 사이의 텍스트를 사용합니다.

토큰

언어 모델에서 모델이 나타내는 원자 단위 예측을 수행하는 방법을 알아봅니다 토큰은 일반적으로 있습니다.

- 단어(예: '개 같은 고양이)' 세 단어로 구성됨 토큰: 'dogs', 'like', 'cats'입니다.

- 문자(예: '자전거 물고기' 문구) 9개의 합니다. 공백은 토큰 중 하나로 계산됩니다.

- 하위 단어입니다. 여기서 한 단어는 단일 토큰 또는 여러 토큰이 될 수 있습니다. 하위 단어는 어근, 접두사 또는 접미어로 구성됩니다. 예를 들어 하위 단어를 토큰으로 사용하는 언어 모델은 'dogs'라는 단어를 두 개의 토큰 (근 단어 'dog' 및 복수형 접미사 's')으로 표현됩니다. 같은 거 '더 큰'이라는 단일 단어를 두 개의 하위 단어( 루트 단어 'tall' 뒤에 접미사 'er')를 입력합니다.

언어 모델 외부의 도메인에서 토큰은 분자 단위로 나눌 수 있습니다 예를 들어 컴퓨터 비전에서 토큰은 예로 들 수 있습니다

Transformer

Google에서 개발한 신경망 아키텍처는 셀프 어텐션 메커니즘을 사용하여 일련의 입력 임베딩 시퀀스를 출력 시퀀스에 컨볼루션 또는 순환 신경망(RNN). Transformer는 셀프 어텐션 계층의 스택으로 볼 수 있습니다

Transformer에는 다음 중 하나가 포함될 수 있습니다.

인코더는 임베딩 시퀀스를 새로운 시퀀스로 변환합니다. 같은 길이여야 합니다. 인코더에는 동일한 레이어 N개가 있으며, 각 레이어에는 살펴보겠습니다 이 두 개의 하위 레이어가 입력의 각 위치에 적용됩니다. 임베딩 시퀀스를 사용해 시퀀스의 각 요소를 새로운 있습니다. 첫 번째 인코더 하위 레이어는 입력 시퀀스입니다. 두 번째 인코더 하위 레이어는 출력 임베딩으로 변환할 수 있습니다.

디코더는 입력 임베딩 시퀀스를 시퀀스의 시퀀스로 변환합니다. 출력 임베딩에 대해 학습합니다. 또한 디코더는 3개의 하위 레이어가 있는 N개의 동일한 레이어. 그 중 2개는 인코더 하위 레이어가 있습니다. 세 번째 디코더 하위 레이어는 인코더를 빌드하고 셀프 어텐션 메커니즘을 거기서 정보를 수집할 수 있습니다.

Transformer: 언어를 위한 새로운 신경망 아키텍처 이해 Transformer를 소개하겠습니다

트라이그램

N=3인 N-그램입니다.

U

단방향

대상 텍스트 섹션 앞에 오는 텍스트만 평가하는 시스템입니다. 반면에 양방향 시스템은 텍스트의 대상 섹션 앞과 뒤에 오는 텍스트 자세한 내용은 양방향을 참고하세요.

단방향 언어 모델

특정 단어만을 기준으로 확률을 기반으로 하는 언어 모델 tokens는 대상 토큰 뒤가 아닌 앞에 표시됩니다. 양방향 언어 모델과 대비되는 개념입니다.

V

변이 자동 인코더 (VAE)

불일치를 활용하는 자동 인코더 유형 수정된 입력 버전을 생성합니다. 변분 자동 인코더는 생성형 AI에 유용합니다.

VAE는 변이 추론을 기반으로 합니다. 변이 추론은 매개변수입니다.

W

단어 임베딩

안에 설정된 단어의 각 단어를 대표하는 것은 임베딩 벡터 즉, 각 단어를 0.0~1.0 사이의 부동 소수점 값 벡터입니다. 유사한 단어 의미가 다른 단어보다 더 유사한 표현입니다. 예를 들어 당근, 셀러리, 오이는 모두 유사한 표현을 사용할 수 있는데, 이는 인코더-디코더 아키텍처를 사용한 비행기, 선글라스, 치약을 묻지 않아도 됩니다.

Z

제로샷 프롬프팅

원하는 방법의 예시를 제공하지 않는 프롬프트 대규모 언어 모델을 사용하여 응답합니다 예를 들면 다음과 같습니다.

| 프롬프트 구성 요소 | 참고 |

|---|---|

| 지정된 국가의 공식 통화는 무엇인가요? | LLM이 답변할 질문입니다. |

| 인도: | 실제 쿼리입니다. |

대규모 언어 모델은 다음과 같이 응답할 수 있습니다.

- 루피 기호

- INR

- ₹

- 인도 루피

- 루피

- 인도 루피

모든 답변이 정확하지만 특정 형식을 선호할 수도 있습니다.

제로샷 프롬프팅을 다음 용어와 비교 및 대조하세요.