يحدّد هذا المسرد مصطلحات التعلم الآلي.

A

الاستئصال

تقنية لتقييم أهمية ميزة أو مكوّن من خلال إزالته مؤقتًا من نموذج بعد ذلك، يمكنك إعادة تدريب النموذج بدون تلك الميزة أو المكوّن، وإذا كان أداء النموذج الذي تمت إعادة تدريبه أسوأ بكثير، فمن المحتمل أنّ الميزة أو المكوّن الذي تمت إزالته كانا مهمّين.

على سبيل المثال، لنفترض أنّك درّبت نموذج تصنيف على 10 ميزات وحقّقت دقة بنسبة% 88 على مجموعة الاختبار. للتحقّق من أهمية الميزة الأولى، يمكنك إعادة تدريب النموذج باستخدام الميزات التسع الأخرى فقط. إذا كان أداء النموذج الذي تمّت إعادة تدريبه أسوأ بكثير (على سبيل المثال، دقة أقل من% 55)، من المحتمل أنّ الميزة التي تمت إزالتها كانت مهمة. في المقابل، إذا كان النموذج الذي تمّت إعادة تدريبه يؤدي بشكل جيد بنفس القدر، فمن المحتمل أنّ هذه الميزة لم تكن مهمة.

يمكن أن تساعد عملية الاستئصال أيضًا في تحديد أهمية ما يلي:

- المكوّنات الأكبر حجمًا، مثل نظام فرعي كامل من نظام تعلُّم آلي أكبر

- العمليات أو الأساليب، مثل خطوة المعالجة المُسبقة للبيانات

في كلتا الحالتين، ستلاحظ كيف يتغيّر أداء النظام (أو لا يتغيّر) بعد إزالة المكوّن.

اختبار A/B

يشير ذلك المصطلح إلى طريقة إحصائية لمقارنة أسلوبَين (أو أكثر)، وهما أ وب. عادةً، يكون أ أسلوبًا حاليًا، وب أسلوبًا جديدًا. لا يحدّد اختبار A/B الأسلوب الأفضل أداءً فحسب، بل يحدّد أيضًا ما إذا كان الفرق ذا دلالة إحصائية.

عادةً ما تقارن اختبارات أ/ب مقياسًا واحدًا بين أسلوبَين، مثل مقارنة دقة النموذج بين أسلوبَين. ومع ذلك، يمكن أن تقارن اختبارات A/B أيضًا أي عدد محدود من المقاييس.

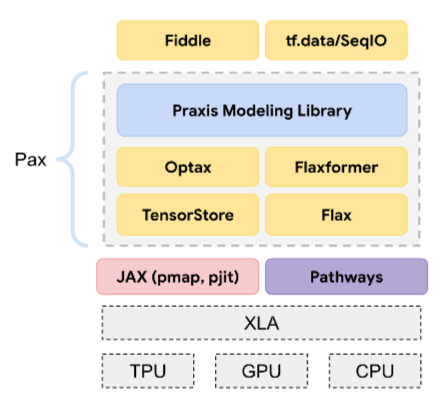

شريحة تسريع

فئة من مكوّنات الأجهزة المتخصّصة المصمَّمة لإجراء العمليات الحسابية الأساسية اللازمة لخوارزميات التعلّم العميق

يمكن أن تؤدي شرائح المعالجة السريعة (أو المعالجات السريعة باختصار) إلى زيادة سرعة وكفاءة مهام التدريب والاستدلال بشكل كبير مقارنةً بوحدة المعالجة المركزية للأغراض العامة. وهي مثالية لتدريب الشبكات العصبية والمهام المشابهة التي تتطلب قدرة حاسوبية عالية.

تشمل أمثلة شرائح المعالجة السريعة ما يلي:

- وحدات معالجة الموتّرات (TPU) من Google مع أجهزة مخصّصة للتعليم المعمّق

- وحدات معالجة الرسومات من NVIDIA، والتي تم تصميمها في البداية لمعالجة الرسومات، تم تصميمها لتمكين المعالجة المتوازية، ما يمكن أن يؤدي إلى زيادة كبيرة في سرعة المعالجة.

الدقة

عدد التوقّعات الصحيحة للتصنيف مقسومًا على إجمالي عدد التوقّعات والمقصود:

على سبيل المثال، إذا قدّم نموذج 40 توقّعًا صحيحًا و10 توقّعات غير صحيحة، ستكون دقة النموذج كما يلي:

يقدّم التصنيف الثنائي أسماء محدّدة لمختلف فئات التوقعات الصحيحة والتوقعات غير الصحيحة. وبالتالي، تكون صيغة الدقة للتصنيف الثنائي كما يلي:

where:

- TP هو عدد الحالات الموجبة الصحيحة (التوقّعات الصحيحة).

- TN هو عدد الحالات السالبة الصحيحة (التوقعات الصحيحة).

- FP هو عدد الحالات الموجبة الخاطئة (التوقعات غير الصحيحة).

- FN هو عدد الحالات السالبة الخاطئة (التوقعات غير الصحيحة).

تحديد أوجه التشابه والاختلاف بين الدقة والضبط والاسترجاع

يمكنك الاطّلاع على التصنيف: الدقة والاسترجاع والضبط والمقاييس ذات الصلة في "دورة تدريبية مكثّفة حول تعلُّم الآلة" للحصول على مزيد من المعلومات.

إجراء

في التعلّم التعزيزي، هي الآلية التي ينتقل بها العنصر بين الحالات الخاصة بالبيئة. يختار الوكيل الإجراء باستخدام سياسة.

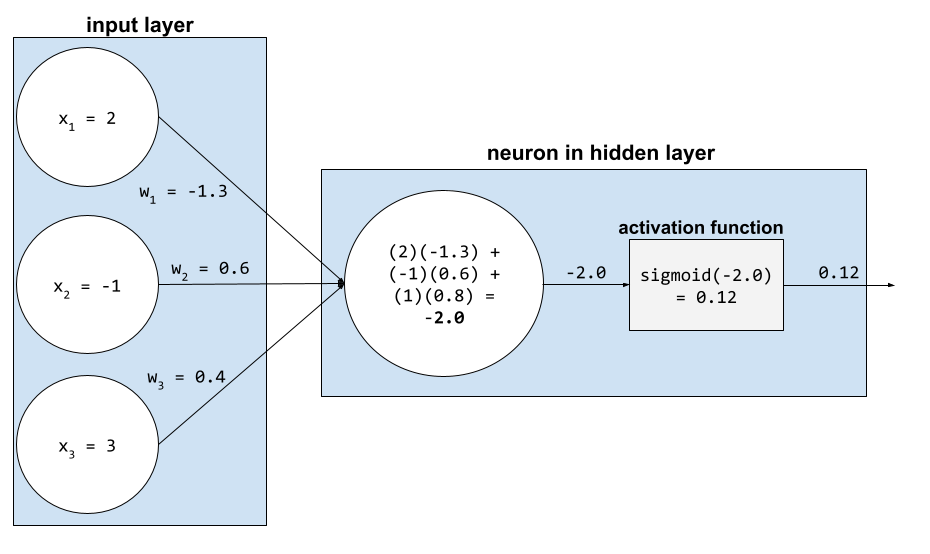

دالّة التفعيل

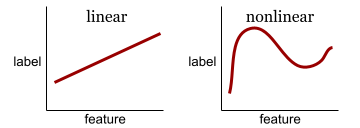

هي دالة تتيح للشبكات العصبية التعرّف على العلاقات غير الخطية (المعقّدة) بين الميزات والتصنيف.

تشمل دوال التنشيط الشائعة ما يلي:

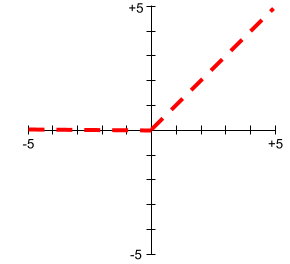

لا تكون رسومات دوال التنشيط البيانية أبدًا خطوطًا مستقيمة مفردة. على سبيل المثال، يتألف رسم دالة التنشيط ReLU من خطين مستقيمين:

يبدو الرسم البياني لدالة التنشيط السينية على النحو التالي:

لمزيد من المعلومات، يُرجى الاطّلاع على الشبكات العصبية: دوال التنشيط في "الدورة التدريبية المكثّفة حول تعلُّم الآلة".

التعلّم النشط

التدريب هو أسلوب يتيح للخوارزمية اختيار بعض البيانات التي تتعلّم منها. يكون التعلّم النشط مفيدًا بشكل خاص عندما تكون الأمثلة المصنّفة نادرة أو مكلفة. بدلاً من البحث بشكل عشوائي عن مجموعة متنوعة من الأمثلة المصنّفة، تبحث خوارزمية التعلّم النشط بشكل انتقائي عن مجموعة الأمثلة المحدّدة التي تحتاجها للتعلّم.

AdaGrad

خوارزمية متطورة لانحدار التدرّج تعمل على إعادة قياس تدرّجات كل مَعلمة، ما يمنح كل مَعلمة معدّل تعلّم مستقلاً. للحصول على شرح كامل، يُرجى الاطّلاع على Adaptive Subgradient Methods for Online Learning and Stochastic Optimization.

التكيّف

مرادف لكلمة "ضبط" أو ضبط دقيق

وكيل

برنامج يمكنه تحليل مدخلات المستخدم المتعددة الوسائط من أجل التخطيط وتنفيذ الإجراءات نيابةً عن المستخدم.

في التعلّم التعزيزي، يكون العامل هو الكيان الذي يستخدم سياسة لتحقيق أقصى عائد متوقّع من الانتقال بين الحالات الخاصة بالبيئة.

التجميع من الأسفل إلى الأعلى

راجِع مقالة التجميع الهرمي.

رصد القيم الشاذة

عملية تحديد القيم الشاذة على سبيل المثال، إذا كان المتوسط لـ ميزة معيّنة هو 100 مع انحراف معياري يبلغ 10، يجب أن ترصد ميزة "رصد القيم الشاذة" القيمة 200 كقيمة مشبوهة.

الواقع المعزّز

اختصار الواقع المعزّز

المساحة تحت منحنى الدقة والاستدعاء

اطّلِع على المساحة تحت منحنى الدقة والاسترجاع.

المساحة تحت منحنى ROC

اطّلِع على المساحة تحت منحنى ROC (AUC).

الذكاء الاصطناعي العام

آلية غير بشرية تُظهر مجموعة واسعة من القدرات على حل المشاكل والإبداع والتكيّف. على سبيل المثال، يمكن لبرنامج يوضّح الذكاء الاصطناعي العام ترجمة النصوص وتأليف السيمفونيات والتفوق في الألعاب التي لم يتم ابتكارها بعد.

الذكاء الاصطناعي

برنامج أو نموذج غير بشري يمكنه حلّ المهام المعقّدة على سبيل المثال، يندرج ضمن الذكاء الاصطناعي برنامج أو نموذج يترجم النصوص، أو برنامج أو نموذج يحدّد الأمراض من صور الأشعة.

تعلُّم الآلة هو حقل فرعي من الذكاء الاصطناعي. مع ذلك، بدأت بعض المؤسسات في السنوات الأخيرة تستخدم مصطلحَي الذكاء الاصطناعي وتعلُّم الآلة بالتبادل.

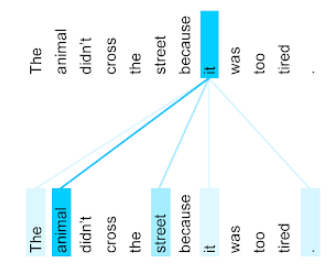

تنبيه

آلية مستخدَمة في الشبكة العصبية تشير إلى أهمية كلمة معيّنة أو جزء من كلمة. تؤدي آلية الانتباه إلى تقليل كمية المعلومات التي يحتاجها النموذج لتوقّع الرمز المميز/الكلمة التالية. قد تتألف آلية الانتباه النموذجية من مجموع مرجّح على مجموعة من المدخلات، حيث يتم احتساب الوزن لكل مدخل من خلال جزء آخر من الشبكة العصبية.

يُرجى الرجوع أيضًا إلى الاهتمام الذاتي والاهتمام الذاتي المتعدد الرؤوس، وهما اللبنات الأساسية في المحوّلات.

يمكنك الاطّلاع على النماذج اللغوية الكبيرة: ما المقصود بالنموذج اللغوي الكبير؟ في "الدورة التدريبية المكثّفة حول تعلُّم الآلة" لمزيد من المعلومات حول الانتباه الذاتي.

السمة

مرادف ميزة

في سياق عدالة تعلُّم الآلة، تشير السمات غالبًا إلى الخصائص المتعلقة بالأفراد.

أخذ عيّنات من السمات

أسلوب لتدريب غابة القرارات، حيث لا تأخذ كل شجرة قرارات في الاعتبار سوى مجموعة فرعية عشوائية من الميزات المحتملة عند تعلُّم الشرط. بشكل عام، يتم أخذ عيّنة من مجموعة فرعية مختلفة من الميزات لكل عقدة. في المقابل، عند تدريب شجرة قرارات بدون أخذ عيّنات من السمات، يتم أخذ جميع الميزات المحتملة في الاعتبار لكل عقدة.

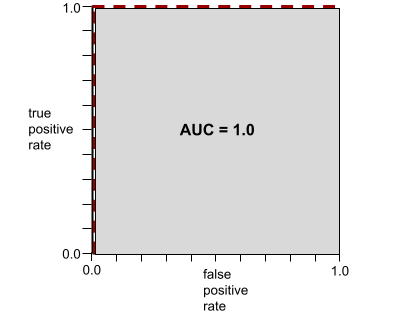

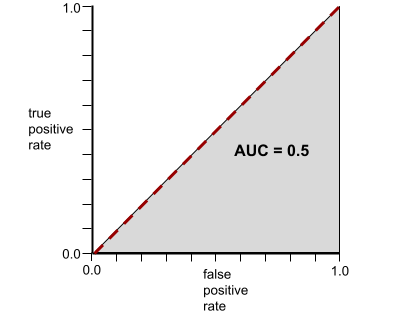

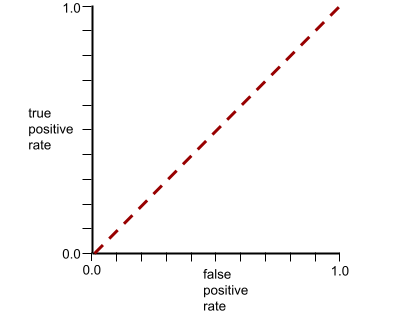

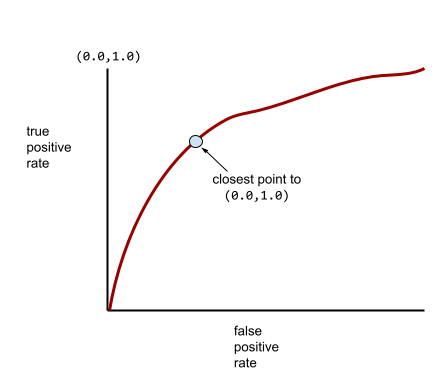

المساحة تحت منحنى ROC

رقم يتراوح بين 0.0 و1.0 يمثّل قدرة نموذج التصنيف الثنائي على فصل الفئات الإيجابية عن الفئات السلبية. كلما اقتربت قيمة AUC من 1.0، كانت قدرة النموذج على فصل الفئات عن بعضها البعض أفضل.

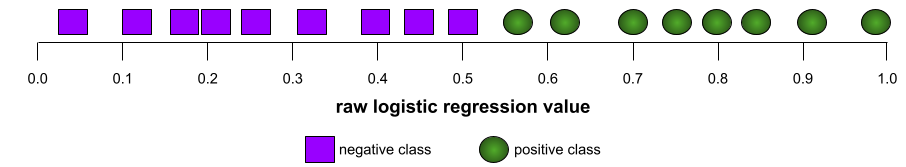

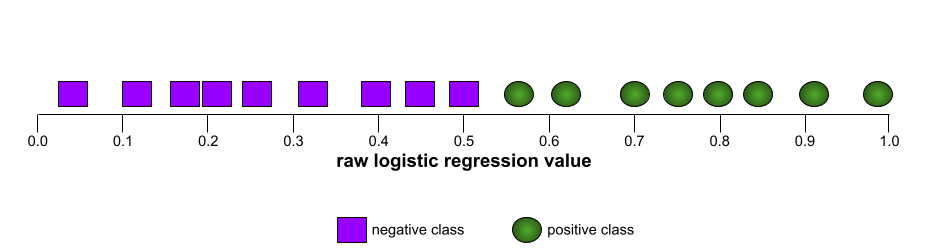

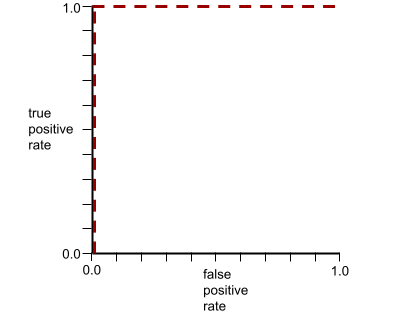

على سبيل المثال، توضّح الصورة التالية نموذج تصنيف يفصل تمامًا بين الفئات الإيجابية (الدوائر الخضراء) والفئات السلبية (المستطيلات الأرجوانية). يحتوي هذا النموذج المثالي بشكل غير واقعي على قيمة AUC تبلغ 1.0:

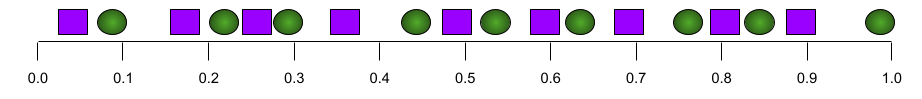

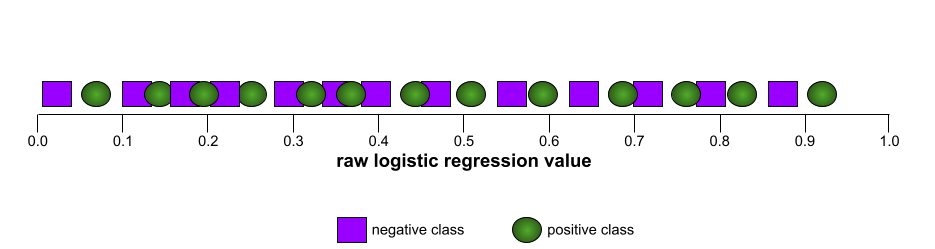

في المقابل، يوضّح الرسم التوضيحي التالي نتائج نموذج تصنيف أنشأ نتائج عشوائية. يحتوي هذا النموذج على قيمة AUC تبلغ 0.5:

نعم، النموذج السابق لديه قيمة AUC تبلغ 0.5، وليس 0.0.

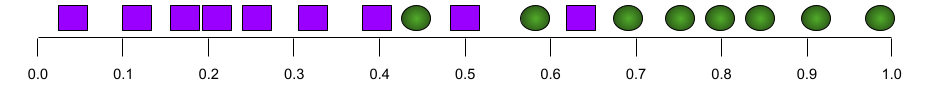

وتقع معظم النماذج في مكان ما بين هذين الحدّين. على سبيل المثال، يفصل النموذج التالي بين القيم الإيجابية والسلبية إلى حد ما، وبالتالي يكون لديه قيمة AUC تتراوح بين 0.5 و1.0:

تتجاهل مقياس AUC أي قيمة تحدّدها لحدّ التصنيف. بدلاً من ذلك، تأخذ المساحة تحت منحنى ROC في الاعتبار جميع عتبات التصنيف الممكنة.

يمكنك الاطّلاع على التصنيف: منحنى ROC ومقياس AUC في "دورة مكثّفة عن تعلُّم الآلة" للحصول على مزيد من المعلومات.

الواقع المعزّز

هي تكنولوجيا تفرض صورة من إنشاء الكمبيوتر على رؤية المستخدم للعالم الحقيقي، ما يوفّر بالتالي عرضًا مركّبًا.

autoencoder

نظام يتعلّم استخراج المعلومات الأكثر أهمية من البيانات التي يتم إدخالها. تتألف برامج الترميز التلقائي من برنامج ترميز وبرنامج فك ترميز. تعتمد برامج الترميز التلقائي على العملية التالية المكوّنة من خطوتَين:

- يربط برنامج الترميز الإدخال بتنسيق (وسيط) منخفض الأبعاد (عادةً ما يكون مضغوطًا).

- ينشئ برنامج الترميز نسخة مضغوطة من الإدخال الأصلي من خلال ربط التنسيق المنخفض الأبعاد بتنسيق الإدخال الأصلي العالي الأبعاد.

يتم تدريب برامج الترميز التلقائي بشكل شامل من خلال جعل برنامج فك الترميز يحاول إعادة إنشاء الإدخال الأصلي من التنسيق الوسيط لبرنامج الترميز بأقرب شكل ممكن. بما أنّ التنسيق الوسيط أصغر (أقل أبعادًا) من التنسيق الأصلي، يتم إجبار الترميز التلقائي على التعرّف على المعلومات الأساسية في الإدخال، ولن يكون الإخراج مطابقًا تمامًا للإدخال.

على سبيل المثال:

- إذا كانت بيانات الإدخال عبارة عن رسم، سيكون النسخ غير المطابق مشابهاً للرسم الأصلي، ولكن مع بعض التعديلات. ربما تزيل النسخة غير المطابقة الضوضاء من الرسم الأصلي أو تملأ بعض وحدات البكسل الناقصة.

- إذا كانت بيانات الإدخال نصًا، سينشئ الترميز التلقائي نصًا جديدًا يحاكي النص الأصلي (ولكنه ليس مطابقًا له).

راجِع أيضًا المشفّرات التلقائية المتغيرة.

التقييم التلقائي

استخدام برامج للحكم على جودة نتائج النموذج

عندما يكون ناتج النموذج بسيطًا نسبيًا، يمكن لنص برمجي أو برنامج مقارنة ناتج النموذج بالردّ المثالي. يُطلق على هذا النوع من التقييم التلقائي أحيانًا اسم التقييم الآلي. غالبًا ما تكون مقاييس مثل ROUGE أو BLEU مفيدة للتقييم الآلي.

عندما تكون نتائج النموذج معقّدة أو لا تتضمّن إجابة صحيحة واحدة، يتم أحيانًا إجراء التقييم التلقائي من خلال برنامج منفصل للتعلم الآلي يُعرف باسم المقيّم التلقائي.

يختلف ذلك عن التقييم من جانب المستخدمين.

الانحياز للاقتراحات الآلية

عندما يفضّل صانع القرار البشري الاقتراحات التي تقدّمها أنظمة آلية لاتخاذ القرارات على المعلومات التي يتم جمعها بدون استخدام أنظمة آلية، حتى عندما ترتكب هذه الأنظمة أخطاءً

لمزيد من المعلومات، يُرجى الاطّلاع على الإنصاف: أنواع التحيز في "الدورة التدريبية المكثّفة حول تعلُّم الآلة".

AutoML

أي عملية مبرمَجة لإنشاء نماذج تعلُّم آلة يمكن لـ AutoML تنفيذ مهام مثل ما يلي تلقائيًا:

- ابحث عن النموذج الأنسب.

- اضبط المعلَمات الفائقة.

- إعداد البيانات (بما في ذلك إجراء هندسة الميزات)

- انشر النموذج الناتج.

تُعدّ AutoML مفيدة لعلماء البيانات لأنّها يمكن أن توفّر لهم الوقت والجهد في تطوير مسارات تعلُّم الآلة وتحسين دقة التوقّعات. وهي مفيدة أيضًا لغير الخبراء، إذ تتيح لهم تنفيذ مهام معقّدة تتضمّن تعلُّم الآلة.

تتضمّن مكتبات AutoML في Google AI Flow Studio وPyGlove.لمزيد من المعلومات، يمكنك الاطّلاع على تعلُّم الآلة المبرمَج (AutoML) في "دورة مكثّفة عن تعلُّم الآلة".

تقييم Autorater

آلية مختلطة لتقييم جودة نتائج نماذج الذكاء الاصطناعي التوليدي تجمع بين التقييم البشري والتقييم الآلي. أداة التقييم التلقائي هي نموذج لتعلُّم الآلة تم تدريبه على بيانات تم إنشاؤها من خلال التقييم البشري. من المفترض أن يتعلّم نظام التقييم الآلي محاكاة أداء المقيِّم البشري.تتوفّر أدوات تقييم تلقائي جاهزة، ولكن أفضلها هي تلك التي تم ضبطها بدقة لتناسب المهمة التي يتم تقييمها.

نموذج الانحدار التلقائي

نموذج يستنتج توقّعًا استنادًا إلى توقّعاته السابقة. على سبيل المثال، تتوقّع نماذج اللغة ذات الانحدار الذاتي الرمز المميز التالي استنادًا إلى الرموز المميزة التي تم توقّعها سابقًا. جميع النماذج اللغوية الكبيرة المستندة إلى بنية Transformer هي نماذج ذات انحدار تلقائي.

في المقابل، لا تكون نماذج الصور المستندة إلى الشبكات العدائية التوليدية (GAN) عادةً ذات انحدار تلقائي، لأنّها تنشئ صورة في تمريرة واحدة للأمام وليس بشكل متكرّر على خطوات. ومع ذلك، فإنّ بعض نماذج إنشاء الصور تكون ذات انحدار تلقائي لأنّها تنشئ صورة على عدة خطوات.

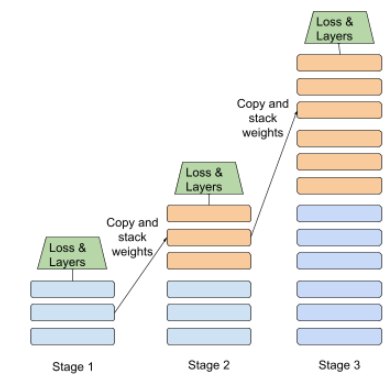

الخسارة الإضافية

دالة الخسارة: تُستخدَم مع دالة الخسارة الرئيسية للنموذج للشبكة العصبونية، وتساعد في تسريع عملية التدريب أثناء التكرارات الأولى عندما يتم ضبط الأوزان عشوائيًا.

تدفع دوال الفقدان المساعدة التدرجات الفعالة إلى الطبقات السابقة. يسهّل ذلك عملية التقارب أثناء التدريب من خلال معالجة مشكلة التدرّج المتلاشي.

متوسط الدقة عند k

مقياس لتلخيص أداء نموذج بشأن طلب واحد يؤدي إلى إنشاء نتائج مرتبة، مثل قائمة مرقّمة باقتراحات كتب متوسط الدقة عند k هو، حسنًا، متوسط قيم الدقة عند k لكل نتيجة ذات صلة. وبالتالي، فإنّ صيغة متوسط الدقة عند k هي:

\[{\text{average precision at k}} = \frac{1}{n} \sum_{i=1}^n {\text{precision at k for each relevant item} } \]

where:

- تمثّل السمة\(n\) عدد العناصر ذات الصلة في القائمة.

يختلف هذا المقياس عن الاسترجاع عند k.

شرط محاذاة المحور

في شجرة القرارات، شرط

يتضمّن ميزة واحدة فقط. على سبيل المثال، إذا كانت area

سمة، يكون الشرط التالي متوافقًا مع المحور:

area > 200

قارِن ذلك بالشرط المائل.

B

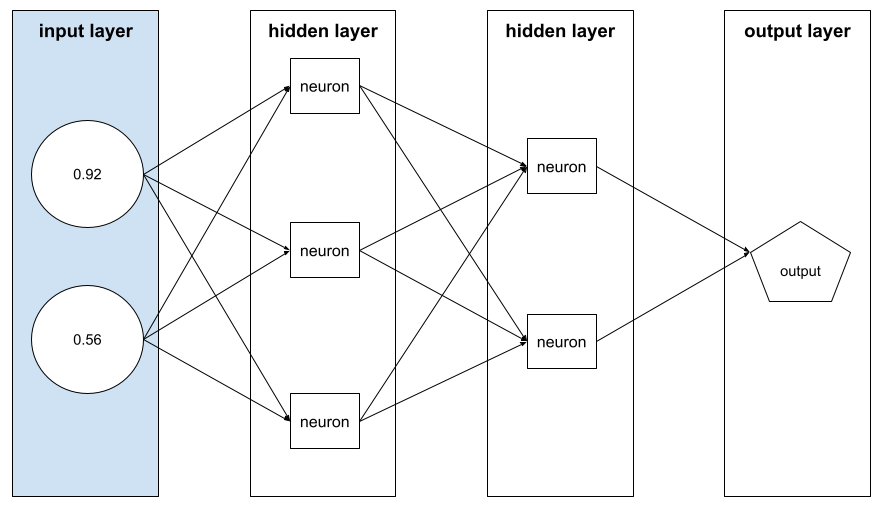

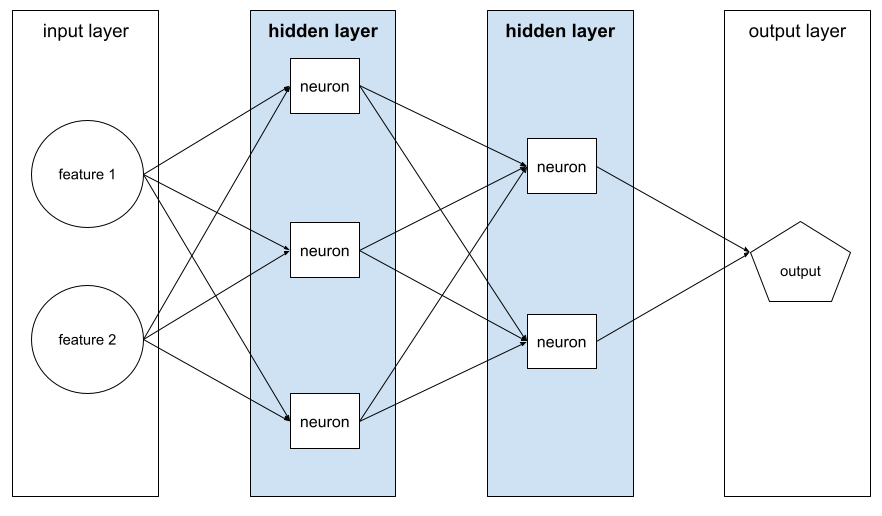

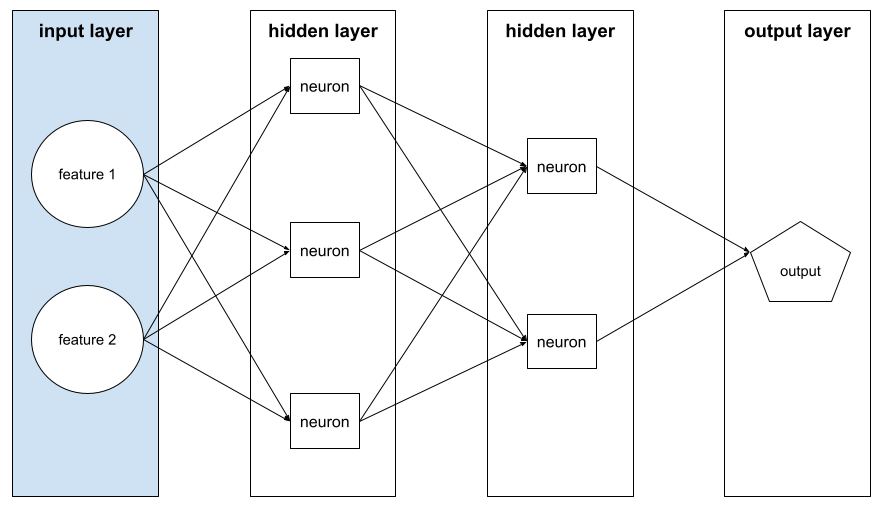

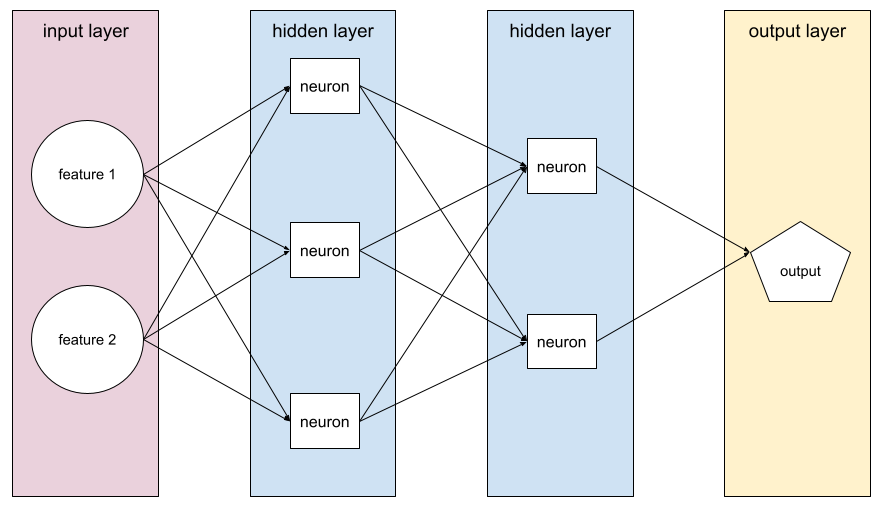

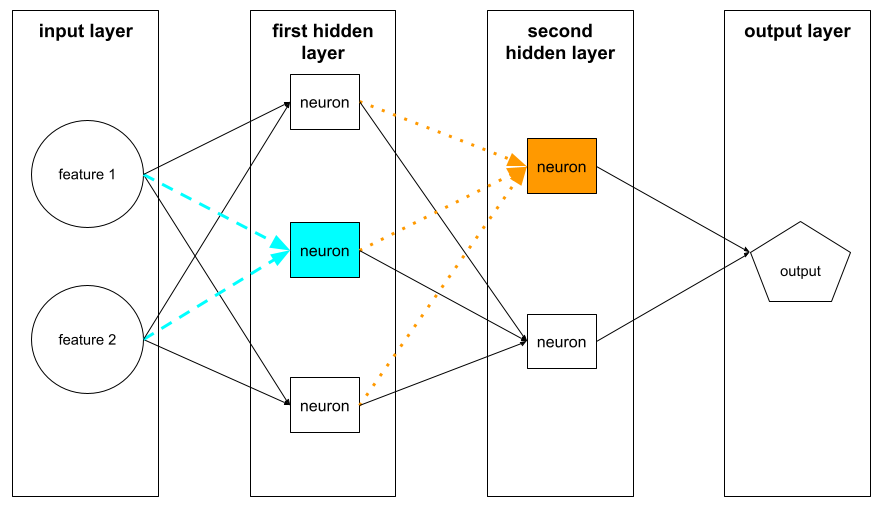

الانتشار العكسي

الخوارزمية التي تنفّذ خوارزمية انحدار التدرّج في الشبكات العصبية

يتضمّن تدريب الشبكة العصبونية العديد من التكرارات للدورة التالية المكوّنة من مرحلتَين:

- أثناء التمرير الأمامي، يعالج النظام دفعة من الأمثلة لإنتاج التوقعات. يقارن النظام كل توقّع بقيمة كل تصنيف. الفرق بين القيمة المتوقّعة وقيمة التصنيف هو الخطأ في هذا المثال. يجمع النظام الخسائر لجميع الأمثلة من أجل احتساب إجمالي الخسارة للدُفعة الحالية.

- أثناء التمرير الخلفي (الانتشار الخلفي)، يقلّل النظام من الفقد من خلال تعديل أوزان جميع الخلايا العصبية في جميع الطبقات المخفية.

غالبًا ما تحتوي الشبكات العصبية على العديد من الخلايا العصبية في العديد من الطبقات المخفية. تساهم كل من هذه الخلايا العصبية في الخسارة الإجمالية بطرق مختلفة. تحدّد عملية الانتشار العكسي ما إذا كان يجب زيادة أو خفض الأوزان المطبَّقة على الخلايا العصبية المحدّدة.

معدّل التعلّم هو عامل ضرب يتحكّم في درجة زيادة أو خفض كل وزن في كل تمرير للخلف. سيؤدي معدل التعلّم الكبير إلى زيادة أو خفض كل وزن بشكل أكبر من معدل التعلّم الصغير.

من الناحية الحسابية، تنفّذ عملية الانتشار العكسي قاعدة السلسلة من الحساب التفاضلي. أي أنّ عملية الانتشار العكسي تحسب المشتق الجزئي للخطأ بالنسبة إلى كل مَعلمة.

قبل سنوات، كان على مطوّري تعلُّم الآلة كتابة تعليمات برمجية لتنفيذ الانتشار الخلفي. تنفّذ واجهات برمجة التطبيقات الحديثة لتعلُّم الآلة، مثل Keras، عملية الانتشار العكسي نيابةً عنك. أخيرًا!

يمكنك الاطّلاع على الشبكات العصبونية في "دورة مكثّفة عن تعلّم الآلة" لمزيد من المعلومات.

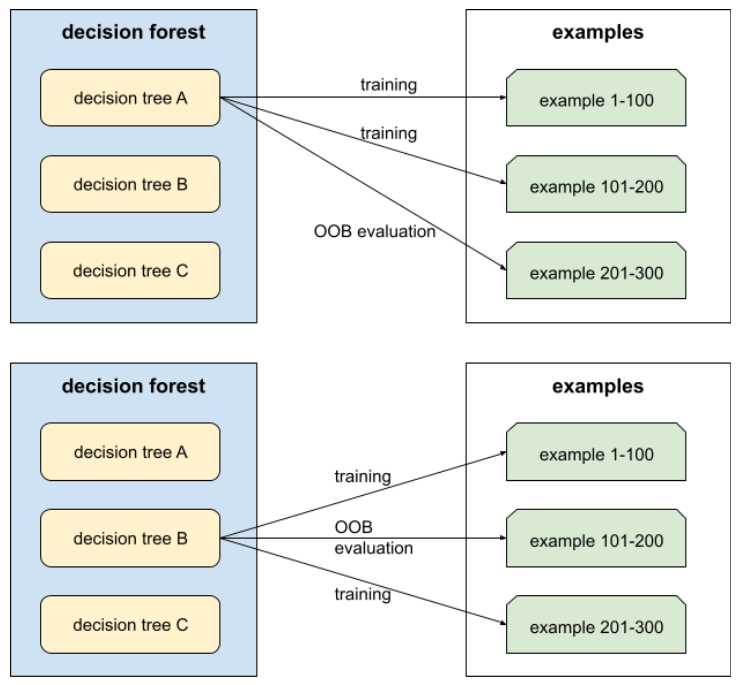

التجميع

يشير ذلك المصطلح إلى طريقة تدريب مجموعة موحّدة يتم فيها تدريب كل نموذج مكوِّن على مجموعة فرعية عشوائية من أمثلة التدريب يتم جمعها مع الاستبدال. على سبيل المثال، الغابة العشوائية هي مجموعة من أشجار القرارات التي يتم تدريبها باستخدام أسلوب التجميع.

يشير مصطلح التجميع إلى تجميع عينات التمهيد.

يمكنك الاطّلاع على الغابات العشوائية في دورة "أشجار القرارات" للحصول على مزيد من المعلومات.

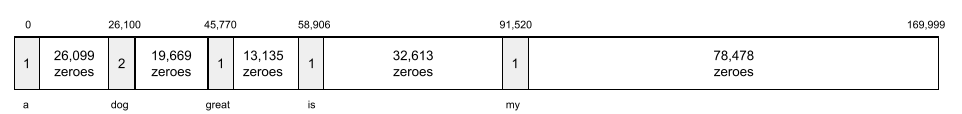

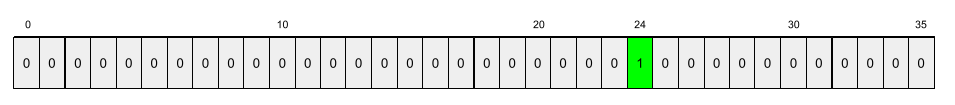

حقيبة الكلمات

تمثيل للكلمات في عبارة أو فقرة، بغض النظر عن الترتيب على سبيل المثال، تمثّل طريقة "مجموعة الكلمات" العبارات الثلاث التالية بشكل مطابق:

- الكلب يقفز

- قفز الكلب

- كلب يقفز

يتم ربط كل كلمة بفهرس في متّجه متفرّق، حيث يتضمّن المتّجه فهرسًا لكل كلمة في المفردات. على سبيل المثال، يتم ربط العبارة الكلب يقفز بمتجه سمات يتضمّن قيمًا غير صفرية في الفهارس الثلاثة التي تتوافق مع الكلمات الكلب ويقفز والـ. يمكن أن تكون القيمة غير الصفرية أيًّا ممّا يلي:

- 1 للإشارة إلى وجود كلمة

- عدد المرّات التي تظهر فيها كلمة في الحقيبة. على سبيل المثال، إذا كانت العبارة الكلب الأحمر الداكن هو كلب ذو فرو أحمر داكن، سيتم تمثيل كل من أحمر داكن وكلب بالرقم 2، بينما سيتم تمثيل الكلمات الأخرى بالرقم 1.

- قيمة أخرى، مثل اللوغاريتم الخاص بعدد مرات ظهور كلمة في الحزمة

خط الأساس

نموذج يُستخدَم كنقطة مرجعية لمقارنة مستوى أداء نموذج آخر (عادةً ما يكون أكثر تعقيدًا). على سبيل المثال، يمكن أن يكون نموذج الانحدار اللوجستي أساسًا جيدًا للنموذج العميق.

بالنسبة إلى مشكلة معيّنة، يساعد خط الأساس مطوّري النماذج في تحديد الحد الأدنى المتوقّع للأداء الذي يجب أن يحقّقه النموذج الجديد ليكون مفيدًا.

النموذج الأساسي

النموذج المدرَّب مسبقًا الذي يمكن استخدامه كنقطة بداية لعملية التحسين بهدف معالجة مهام أو تطبيقات محدّدة.

يمكنك أيضًا الاطّلاع على النموذج المدرَّب مسبقًا والنموذج الأساسي.

دفعة

مجموعة الأمثلة المستخدَمة في إحدى التكرارات التدريبية. يحدّد حجم الدفعة عدد الأمثلة في الدفعة.

راجِع الفترة للحصول على شرح حول كيفية ارتباط الدفعة بفترة.

يمكنك الاطّلاع على الانحدار الخطي: المَعلمات الفائقة في "دورة مكثّفة حول تعلُّم الآلة" للحصول على مزيد من المعلومات.

الاستنتاج المجمّع

عملية استنتاج التوقعات بشأن عدة أمثلة غير مصنّفة مقسّمة إلى مجموعات فرعية أصغر ("دفعات").

يمكن أن تستفيد الاستنتاجات المجمّعة من ميزات التوازي في شرائح الأجهزة المسرّعة. أي أنّ العديد من أدوات التسريع يمكنها في الوقت نفسه استنتاج التوقعات بشأن مجموعات مختلفة من الأمثلة غير المصنّفة، ما يؤدي إلى زيادة كبيرة في عدد الاستنتاجات في الثانية.

يمكنك الاطّلاع على أنظمة تعلُّم الآلة في مرحلة الإنتاج: الاستنتاج الثابت مقابل الاستنتاج الديناميكي في "دورة تدريبية مكثّفة حول تعلُّم الآلة" للحصول على مزيد من المعلومات.

التسوية على دفعات

تسوية الإدخال أو الإخراج لدوال التنشيط في طبقة مخفية يمكن أن يوفّر التوحيد على مستوى المجموعة المزايا التالية:

- زيادة استقرار الشبكات العصبونية من خلال الحماية من أوزان القيم المتطرفة

- فعِّل معدّلات التعلّم الأعلى، ما قد يؤدي إلى تسريع التدريب.

- تقليل التطابق الزائد

حجم الدفعة

عدد الأمثلة في دفعة على سبيل المثال، إذا كان حجم الدفعة 100، سيعالج النموذج 100 مثال لكل تكرار.

في ما يلي استراتيجيات شائعة لحجم الدفعة:

- النزول المتدرّج العشوائي (SGD)، حيث يكون حجم الدفعة 1

- المجموعة الكاملة، حيث يكون حجم المجموعة هو عدد الأمثلة في مجموعة التدريب بأكملها. على سبيل المثال، إذا كانت مجموعة التدريب تحتوي على مليون مثال، سيكون حجم الدفعة مليون مثال. عادةً ما تكون الدفعة الكاملة استراتيجية غير فعّالة.

- الدُفعات الصغيرة التي يتراوح حجم الدفعة فيها عادةً بين 10 و1000. عادةً ما تكون استراتيجية الدُفعات الصغيرة هي الأكثر كفاءة.

يُرجى الاطّلاع على ما يلي لمزيد من المعلومات:

- أنظمة تعلُّم الآلة في مرحلة الإنتاج: الاستنتاج الثابت في مقابل الاستنتاج الديناميكي في "دورة مكثّفة عن تعلُّم الآلة"

- Deep Learning Tuning Playbook

شبكة عصبية بايزية

شبكة عصبية احتمالية تأخذ في الاعتبار عدم اليقين في الأوزان والنتائج. عادةً ما يتوقّع نموذج الانحدار القياسي للشبكة العصبية قيمة عددية، على سبيل المثال، يتوقّع النموذج القياسي سعر منزل يبلغ 853,000 ريال سعودي. في المقابل، تتوقّع الشبكة العصبية البايزية توزيعًا للقيم، فعلى سبيل المثال، يتوقّع نموذج بايزي سعر منزل يبلغ 853,000 دولار أمريكي بانحراف معياري يبلغ 67,200 دولار أمريكي.

تعتمد الشبكة العصبية البايزية على نظرية بايز لحساب حالات عدم اليقين في الأوزان والتوقعات. يمكن أن تكون الشبكة العصبية البايزية مفيدة عندما يكون من المهم تحديد مقدار عدم اليقين، كما هو الحال في النماذج المتعلقة بالأدوية. يمكن أن تساعد الشبكات العصبونية البايزية أيضًا في منع التطابق الزائد.

التحسين البايزي

نموذج الانحدار الاحتمالي هو أسلوب لتحسين دوال الهدف المكلفة حسابيًا، وذلك من خلال تحسين بديل يحدد عدم اليقين باستخدام أسلوب التعلّم البايزي. بما أنّ عملية التحسين المستندة إلى الإحصاء البايزي مكلفة للغاية، يتم استخدامها عادةً لتحسين المهام التي يصعب تقييمها والتي تتضمّن عددًا صغيرًا من المَعلمات، مثل اختيار المَعلمات الفائقة.

معادلة بيلمان

في التعلّم المعزّز، يتم استيفاء الهوية التالية من خلال دالة Q المثالية:

\[Q(s, a) = r(s, a) + \gamma \mathbb{E}_{s'|s,a} \max_{a'} Q(s', a')\]

تطبّق خوارزميات التعلّم المعزّز هذه الهوية لإنشاء تعلّم Q باستخدام قاعدة التعديل التالية:

\[Q(s,a) \gets Q(s,a) + \alpha \left[r(s,a) + \gamma \displaystyle\max_{\substack{a_1}} Q(s',a') - Q(s,a) \right] \]

بالإضافة إلى التعلّم المعزّز، يمكن تطبيق معادلة بيلمان في البرمجة الديناميكية. يمكنك الاطّلاع على مدخل Wikipedia حول معادلة بيلمان.

BERT (تمثيلات الترميز الثنائية الاتجاه من المحولات)

بنية نموذج لتمثيل النص يمكن أن يعمل نموذج BERT مدرَّب كجزء من نموذج أكبر لتصنيف النصوص أو مهام تعلُّم آلة أخرى.

تتضمّن BERT الخصائص التالية:

- يستخدم بنية Transformer، وبالتالي يعتمد على الانتباه الذاتي.

- يستخدم جزء برنامج الترميز في Transformer. مهمة أداة الترميز هي إنتاج تمثيلات نصية جيدة، وليس تنفيذ مهمة محددة مثل التصنيف.

- ثنائي الاتجاه

- تستخدم الإخفاء في التدريب غير الخاضع للإشراف.

تشمل صيغ BERT ما يلي:

يمكنك الاطّلاع على Open Sourcing BERT: State-of-the-Art Pre-training for Natural Language Processing للحصول على نظرة عامة حول BERT.

التحيّز (الأخلاقيات/الإنصاف)

1. الصور النمطية أو التحيز أو المحاباة تجاه بعض الأشياء أو الأشخاص أو المجموعات دون غيرها يمكن أن تؤثّر هذه الانحيازات في جمع البيانات وتفسيرها، وفي تصميم النظام، وفي طريقة تفاعل المستخدمين مع النظام. تشمل أشكال هذا النوع من التحيز ما يلي:

- التحيّز نحو التشغيل الآلي

- الانحياز التأكيدي

- تحيّز المجرب

- الانحياز لتشابه المجموعة

- التحيّز الضمني

- الانحياز لأفراد المجموعة

- الانحياز للتشابه خارج المجموعة

2. خطأ منهجي ناتج عن إجراءات أخذ العيّنات أو إعداد التقارير تشمل أشكال هذا النوع من التحيز ما يلي:

- انحياز في التغطية

- الانحياز لعدم الإجابة

- تحيّز المشاركة

- الانحياز لتكرار التقارير

- انحياز في جمع العيّنات

- الانحياز في الاختيار

يجب عدم الخلط بين هذا المفهوم ومصطلح التحيز في نماذج تعلُّم الآلة أو التحيز في التوقعات.

يمكنك الاطّلاع على الإنصاف: أنواع التحيز في "الدورة التدريبية المكثّفة حول تعلُّم الآلة" للحصول على مزيد من المعلومات.

الانحياز (في الرياضيات) أو مصطلح الانحياز

نقطة تقاطع أو إزاحة من نقطة الأصل التحيّز هو مَعلمة في نماذج تعلُّم الآلة، ويتم تمثيله بأحد الرمزين التاليين:

- b

- w0

على سبيل المثال، التحيز هو b في الصيغة التالية:

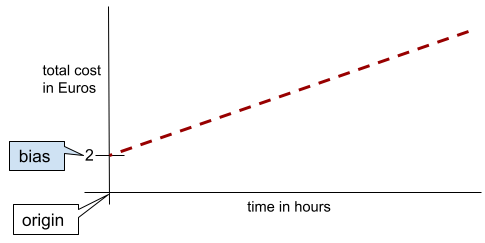

في خط بسيط ثنائي الأبعاد، يشير التحيز إلى "نقطة التقاطع مع المحور الصادي". على سبيل المثال، يكون ميل الخط في الرسم التوضيحي التالي هو 2.

يحدث التحيز لأنّ بعض النماذج لا تبدأ من نقطة الأصل (0,0). على سبيل المثال، لنفترض أنّ تكلفة دخول مدينة ملاهٍ هي 2 يورو، بالإضافة إلى 0.5 يورو لكل ساعة يقضيها الزائر فيها. وبالتالي، فإنّ النموذج الذي يربط التكلفة الإجمالية لديه تحيّز بمقدار 2 لأنّ أدنى تكلفة هي 2 يورو.

يجب عدم الخلط بين التحيز والتحيز في الأخلاق والعدالة أو التحيز في التوقعات.

يمكنك الاطّلاع على الانحدار الخطي في "دورة مكثّفة عن تعلّم الآلة" للحصول على مزيد من المعلومات.

ثنائي الاتجاه

مصطلح يُستخدم لوصف نظام يقيّم النص الذي يسبق والنص الذي يلي جزءًا مستهدفًا من النص. في المقابل، لا يقيّم النظام أحادي الاتجاه سوى النص الذي يسبق القسم المستهدَف من النص.

على سبيل المثال، لنفترض أنّ هناك نموذج لغة مخفيًا يجب أن يحدّد احتمالات الكلمة أو الكلمات التي تمثّل الخط السفلي في السؤال التالي:

ما هي _____ لديك؟

سيكون على نموذج اللغة أحادي الاتجاه أن يستند في احتمالاته إلى السياق الذي توفّره الكلمات "ما" و"هو" و "ال" فقط. في المقابل، يمكن لنموذج لغة ثنائي الاتجاه أن يستمد السياق أيضًا من الكلمتين "مع" و "أنت"، ما قد يساعد النموذج في إنشاء توقّعات أفضل.

نموذج لغوي ثنائي الاتجاه

نموذج لغوي يحدّد احتمال ظهور رمز مميّز معيّن في موضع معيّن ضمن مقتطف من النص استنادًا إلى النص السابق والنص التالي.

bigram

ثنائي الحروف حيث N=2

التصنيف الثنائي

نوع من مهام التصنيف التي تتوقّع إحدى الفئتين المتنافيتين:

على سبيل المثال، يؤدي نموذجا تعلُّم الآلة التاليان التصنيف الثنائي:

- نموذج يحدّد ما إذا كانت الرسائل الإلكترونية رسائل غير مرغوب فيها (الفئة الإيجابية) أو ليست رسائل غير مرغوب فيها (الفئة السلبية).

- نموذج يقيّم الأعراض الطبية لتحديد ما إذا كان الشخص مصابًا بمرض معيّن (الفئة الإيجابية) أو غير مصاب به (الفئة السلبية).

يختلف عن التصنيف المتعدّد الفئات.

راجِع أيضًا الانحدار اللوجستي وحد التصنيف.

يمكنك الاطّلاع على التصنيف في "دورة مكثّفة عن تعلّم الآلة" للحصول على مزيد من المعلومات.

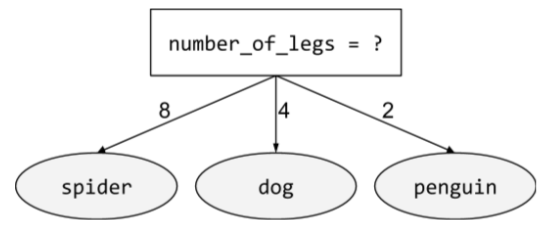

الشرط الثنائي

في شجرة القرار، الشرط الذي يتضمّن نتيجتَين محتمَلتَين فقط، عادةً نعم أو لا. على سبيل المثال، الشرط الثنائي التالي:

temperature >= 100

يختلف عن الحالة غير الثنائية.

اطّلِع على أنواع الشروط في دورة "أشجار القرار" للحصول على مزيد من المعلومات.

تحويل القيم

مرادف لكلمة تحويل القيم

نموذج الصندوق الأسود

النموذج الذي يصعب أو يستحيل على البشر فهم "طريقة تفكيره". وهذا يعني أنّه على الرغم من أنّ البشر يمكنهم معرفة كيف تؤثر الطلبات في الردود، لا يمكنهم تحديد الطريقة التي يحدّد بها نموذج الصندوق الأسود الردّ. بعبارة أخرى، يفتقر نموذج الصندوق الأسود إلى القابلية على التفسير.

معظم النماذج العميقة والنماذج اللغوية الكبيرة هي صناديق سوداء.

BLEU (التقييم الثنائي للترجمة الآلية)

مقياس يتراوح بين 0.0 و1.0 لتقييم الترجمات الآلية، مثلاً من الإسبانية إلى اليابانية.

لحساب النتيجة، تقارن مقاييس BLEU عادةً ترجمة نموذج تعلُّم الآلة (النص الذي تم إنشاؤه) بترجمة خبير بشري (النص المرجعي). تحدّد درجة تطابق العبارات المكونة من N حرف في النص الذي تم إنشاؤه والنص المرجعي درجة BLEU.

المستند الأصلي حول هذا المقياس هو BLEU: a Method for Automatic Evaluation of Machine Translation.

يمكنك الاطّلاع أيضًا على BLEURT.

BLEURT (Bilingual Evaluation Understudy from Transformers)

مقياس لتقييم الترجمات الآلية من لغة إلى أخرى، لا سيما من الإنجليزية وإليها.

بالنسبة إلى الترجمات من الإنجليزية وإليها، تتوافق مقاييس BLEURT بشكل أكبر مع تقييمات البشر مقارنةً بمقاييس BLEU. على عكس BLEU، تؤكّد BLEURT على التشابهات الدلالية (المعنى) ويمكنها استيعاب إعادة الصياغة.

تعتمد مقياس BLEURT على نموذج لغوي كبير مدرَّب مسبقًا (BERT تحديدًا) يتم بعد ذلك ضبطه بدقة باستخدام نصوص من مترجمين بشريين.

المستند الأصلي حول هذا المقياس هو BLEURT: Learning Robust Metrics for Text Generation.

التعزيز

إحدى تقنيات تعلُّم الآلة التي تجمع بشكل متكرّر مجموعة من نماذج التصنيف البسيطة وغير الدقيقة جدًا (المعروفة باسم "المصنّفات الضعيفة") في نموذج تصنيف عالي الدقة (يُعرف باسم "المصنّف القوي") من خلال زيادة وزن الأمثلة التي يصنّفها النموذج حاليًا بشكل خاطئ.

يمكنك الاطّلاع على أشجار القرارات المعزّزة بالتدرّج في دورة "غابات القرارات" للحصول على مزيد من المعلومات.

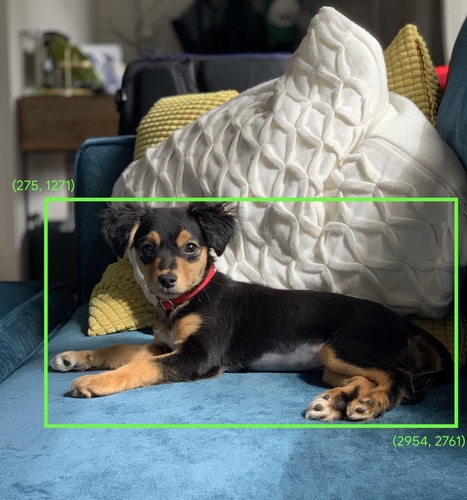

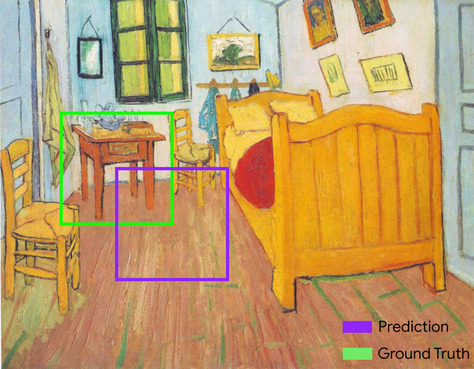

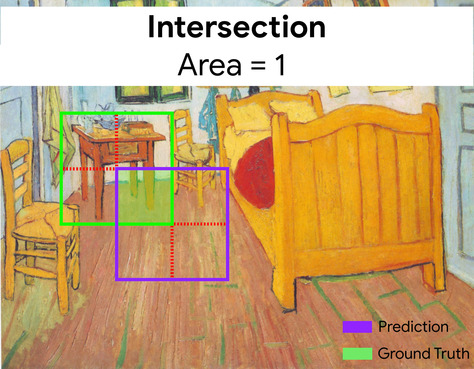

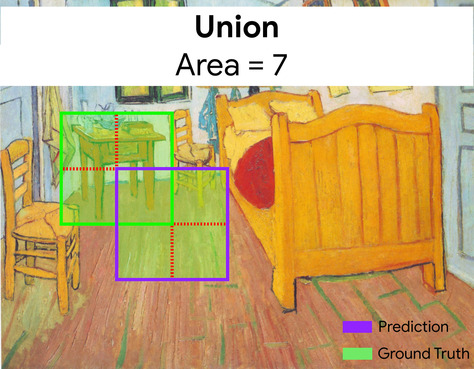

مربّع الحدود

في الصورة، تمثّل الإحداثيتان (x، y) مستطيلاً يحيط بمنطقة مهمة، مثل الكلب في الصورة أدناه.

البث

توسيع شكل عامل في عملية حسابية على المصفوفات إلى أبعاد متوافقة مع هذه العملية على سبيل المثال، يتطلّب الجبر الخطي أن يكون للمعاملَين في عملية إضافة المصفوفة الأبعاد نفسها. وبالتالي، لا يمكنك إضافة مصفوفة ذات شكل (m, n) إلى متجه بطول n. تتيح عملية البث هذه العملية من خلال توسيع المتّجه الذي يبلغ طوله n إلى مصفوفة ذات شكل (m, n) عن طريق تكرار القيم نفسها في كل عمود.

اطّلِع على الوصف التالي للبث في NumPy للحصول على مزيد من التفاصيل.

تصنيف البيانات

تحويل سمة واحدة إلى سمات ثنائية متعددة تُعرف باسم حِزم أو فئات، عادةً ما يكون ذلك استنادًا إلى نطاق قيمة. عادةً ما تكون السمة المقطّعة سمة مستمرة.

على سبيل المثال، بدلاً من تمثيل درجة الحرارة كميزة واحدة مستمرة ذات فاصلة عائمة، يمكنك تقسيم نطاقات درجات الحرارة إلى فئات منفصلة، مثل:

- ستكون درجة الحرارة <= 10 درجات مئوية هي فئة "الطقس البارد".

- ستكون درجات الحرارة بين 11 و24 درجة مئوية ضمن الفئة "معتدلة".

- ستكون درجة الحرارة التي تبلغ 25 درجة مئوية أو أكثر ضمن الفئة "دافئ".

سيتعامل النموذج مع كل قيمة في المجموعة نفسها بشكل مماثل. على سبيل المثال، تندرج القيمتان 13 و22 ضمن الفئة المعتدلة، لذا يتعامل النموذج مع القيمتين بشكل مماثل.

لمزيد من المعلومات، راجِع البيانات الرقمية: التصنيف إلى فئات في "دورة مكثّفة عن تعلّم الآلة".

C

طبقة المعايرة

تعديل ما بعد التوقّع، ويتم إجراؤه عادةً للتعويض عن تحيّز التوقّع. يجب أن تتطابق التوقعات والاحتمالات المعدَّلة مع توزيع مجموعة من التصنيفات التي تمت ملاحظتها.

إنشاء المرشّحين

المجموعة الأولية من الاقتراحات التي يختارها نظام الاقتراحات على سبيل المثال، تخيّل مكتبة تبيع 100,000 عنوان. تنشئ مرحلة إنشاء المرشّحين قائمة أصغر بكثير من الكتب المناسبة لمستخدم معيّن، ولنفترض أنّها تضم 500 كتاب. ولكن حتى 500 كتاب هو عدد كبير جدًا لاقتراحه على المستخدم. تؤدي المراحل اللاحقة والأكثر تكلفة في نظام التوصية (مثل تسجيل النتائج وإعادة الترتيب) إلى تقليل عدد النتائج الـ 500 إلى مجموعة أصغر بكثير وأكثر فائدة من الاقتراحات.

يمكنك الاطّلاع على نظرة عامة حول إنشاء المرشّحين في دورة "أنظمة الاقتراحات" التدريبية للحصول على مزيد من المعلومات.

تحليل العينات المُحتملة

تحسين وقت التدريب الذي يحسب احتمالية لجميع التصنيفات الإيجابية، باستخدام، على سبيل المثال، softmax، ولكن فقط لعينة عشوائية من التصنيفات السلبية على سبيل المثال، إذا كان لدينا مثال مصنّف على أنّه كلب بيغل وكلب، فإنّ أخذ عينات من المرشّحين يحسب الاحتمالات المتوقّعة وحدود الخسارة المقابلة لما يلي:

- بيغل

- dog

- مجموعة فرعية عشوائية من الفئات السلبية المتبقية (على سبيل المثال، قطة ومصاصة وسياج)

الفكرة هي أنّ الفئات السلبية يمكن أن تستفيد من التعزيز السلبي الأقل تكرارًا طالما أنّ الفئات الإيجابية تتلقّى دائمًا تعزيزًا إيجابيًا مناسبًا، وقد تم رصد ذلك تجريبيًا بالفعل.

تكون عملية أخذ عيّنات من المرشّحين أكثر فعالية من حيث الحوسبة مقارنةً بخوارزميات التدريب التي تحتسب التوقّعات لكل الفئات السلبية، لا سيما عندما يكون عدد الفئات السلبية كبيرًا جدًا.

البيانات الفئوية

الميزات التي تتضمّن مجموعة محدّدة من القيم المحتمَلة على سبيل المثال، لنفترض أنّ هناك ميزة فئوية باسم traffic-light-state، والتي يمكن أن تتضمّن إحدى القيم الثلاث التالية فقط:

redyellowgreen

من خلال تمثيل traffic-light-state كميزة فئوية، يمكن للنموذج التعرّف على التأثيرات المختلفة لكل من red وgreen وyellow في سلوك السائق.

يُطلق على الميزات الفئوية أحيانًا اسم الميزات المنفصلة.

يختلف عن البيانات الرقمية.

لمزيد من المعلومات، راجِع استخدام البيانات الفئوية في "الدورة التدريبية المكثّفة حول تعلُّم الآلة".

نموذج لغوي سببي

مرادف نموذج اللغة أحادي الاتجاه

يمكنك الاطّلاع على نموذج اللغة الثنائي الاتجاه للمقارنة بين الطرق المختلفة للتعامل مع الاتجاهات في نماذج اللغة.

المركز

مركز المجموعة كما تحدّده خوارزمية k-means أو خوارزمية k-median على سبيل المثال، إذا كانت قيمة k هي 3، ستعثر الخوارزمية التصنيفية أو خوارزمية تحليل المجموعات على 3 نقاط مركزية.

يمكنك الاطّلاع على خوارزميات التجميع في دورة التجميع للحصول على مزيد من المعلومات.

التجميع العنقودي المستند إلى النقاط المركزية

فئة من خوارزميات التجميع العنقودي التي تنظّم البيانات في مجموعات غير هرمية، وتُعد خوارزمية k-means الأكثر استخدامًا بين خوارزميات التجميع العنقودي المستندة إلى النقاط المركزية.

يختلف ذلك عن خوارزميات التجميع الهرمي.

يمكنك الاطّلاع على خوارزميات التجميع في دورة التجميع للحصول على مزيد من المعلومات.

التلقين بسلسلة أفكار

هندسة الطلبات هي تقنية تشجّع النماذج اللغوية الكبيرة (LLM) على شرح عملية الاستنتاج خطوة بخطوة. على سبيل المثال، اطّلِع على الطلب التالي، مع التركيز بشكل خاص على الجملة الثانية:

كم عدد قوى الجاذبية التي سيشعر بها السائق في سيارة تنتقل من 0 إلى 60 ميلاً في الساعة خلال 7 ثوانٍ؟ في الإجابة، أدرِج جميع العمليات الحسابية ذات الصلة.

من المرجّح أن يكون رد النموذج اللغوي الكبير على النحو التالي:

- عرض سلسلة من صيغ الفيزياء، مع إدخال القيم 0 و60 و7 في الأماكن المناسبة

- اشرح سبب اختيار هذه الصيغ وما تعنيه المتغيّرات المختلفة.

يفرض الطلب المتسلسل على النموذج اللغوي الكبير إجراء جميع العمليات الحسابية، ما قد يؤدي إلى تقديم إجابة أكثر صحة. بالإضافة إلى ذلك، يتيح أسلوب "سلسلة الأفكار" للمستخدم فحص خطوات النموذج اللغوي الكبير لتحديد ما إذا كانت الإجابة منطقية أم لا.

محادثة

محتوى حوار ذهابًا وإيابًا مع نظام تعلُّم آلي، ويكون عادةً نموذجًا لغويًا كبيرًا. تصبح التفاعلات السابقة في المحادثة (ما كتبته وكيف ردّ النموذج اللغوي الكبير) سياقًا للأجزاء اللاحقة من المحادثة.

برنامج الدردشة الآلي هو تطبيق لنموذج لغوي كبير.

نقطة تفتيش

البيانات التي تسجّل حالة المَعلمات الخاصة بالنموذج، سواء أثناء التدريب أو بعد اكتماله على سبيل المثال، أثناء التدريب، يمكنك إجراء ما يلي:

- إيقاف التدريب، ربما عن قصد أو ربما نتيجة حدوث أخطاء معيّنة

- احفظ النقطة المرجعية.

- بعد ذلك، أعِد تحميل نقطة التحقّق، ربما على جهاز مختلف.

- إعادة بدء التدريب

صنف

فئة يمكن أن ينتمي إليها تصنيف. على سبيل المثال:

- في نموذج التصنيف الثنائي الذي يرصد الرسائل غير المرغوب فيها، قد تكون الفئتان هما رسالة غير مرغوب فيها وليست رسالة غير مرغوب فيها.

- في نموذج التصنيف المتعدّد الفئات الذي يحدّد سلالات الكلاب، قد تكون الفئات بودل وبيغل وبَغ وما إلى ذلك.

يتنبأ نموذج التصنيف بفئة. في المقابل، يتنبأ نموذج الانحدار برقم بدلاً من فئة.

يمكنك الاطّلاع على التصنيف في "دورة مكثّفة عن تعلّم الآلة" للحصول على مزيد من المعلومات.

مجموعة بيانات متوازنة الفئات

مجموعة بيانات تحتوي على تصنيفات فئوية يكون فيها عدد مثيلات كل فئة متساويًا تقريبًا. على سبيل المثال، لنفترض مجموعة بيانات نباتية يمكن أن يكون تصنيفها الثنائي إما نباتًا محليًا أو نباتًا غير محلي:

- مجموعة البيانات التي تتضمّن 515 نباتًا أصليًا و485 نباتًا غير أصلي هي مجموعة بيانات متوازنة الفئات.

- مجموعة البيانات التي تتضمّن 875 نباتًا أصليًا و125 نباتًا غير أصلي هي مجموعة بيانات غير متوازنة الفئات.

لا يوجد خط فاصل رسمي بين مجموعات البيانات المتوازنة الفئات ومجموعات البيانات غير المتوازنة الفئات. لا يصبح التمييز مهمًا إلا عندما يتعذّر تقارب نموذج تم تدريبه على مجموعة بيانات غير متوازنة بشكل كبير. راجِع مجموعات البيانات: مجموعات البيانات غير المتوازنة في "دورة مكثّفة عن تعلّم الآلة" للحصول على التفاصيل.

نموذج التصنيف

نموذج يكون توقّعه فئة. على سبيل المثال، كلّ ما يلي هي نماذج تصنيف:

- نموذج يتوقّع لغة الجملة المُدخَلة (هل هي فرنسية؟ الإسبانية؟ الإيطالية؟

- نموذج يتوقّع أنواع الأشجار (قيقب؟ سنديان؟ Baobab?).

- نموذج يتنبأ بالفئة الإيجابية أو السلبية لحالة طبية معيّنة.

في المقابل، تتنبّأ نماذج الانحدار بالأرقام بدلاً من الفئات.

في ما يلي نوعان شائعان من نماذج التصنيف:

عتبة التصنيف

في التصنيف الثنائي، يكون العدد بين 0 و1 الذي يحوّل الناتج الأولي لنموذج الانحدار اللوجستي إلى توقع إما الفئة الإيجابية أو الفئة السلبية. يُرجى العِلم أنّ حدّ التصنيف هو قيمة يختارها الإنسان، وليس قيمة يختارها تدريب النموذج.

يُخرج نموذج الانحدار اللوجستي قيمة أولية بين 0 و1. بعد ذلك:

- إذا كانت هذه القيمة الأولية أكبر من حد التصنيف، سيتم توقّع الفئة الموجبة.

- إذا كانت هذه القيمة الأولية أقل من حد التصنيف، يتم التنبؤ بالفئة السلبية.

على سبيل المثال، لنفترض أنّ حد التصنيف هو 0.8. إذا كانت القيمة الأولية 0.9، يتوقّع النموذج الفئة الموجبة. إذا كانت القيمة الأولية 0.7، يتوقّع النموذج الفئة السلبية.

يؤثر اختيار حد التصنيف بشكل كبير في عدد الموجب الخاطئ و السالب الخاطئ.

لمزيد من المعلومات، يمكنك الاطّلاع على الحدود ومصفوفة الالتباس في "دورة مكثّفة عن تعلّم الآلة".

مصنِّف

مصطلح غير رسمي يشير إلى نموذج التصنيف.

مجموعة بيانات غير متوازنة الفئات

مجموعة بيانات خاصة بالتصنيف يكون فيها العدد الإجمالي للتصنيفات الخاصة بكل فئة مختلفًا بشكل كبير. على سبيل المثال، لنفترض أنّ لديك مجموعة بيانات تصنيف ثنائي مقسّمة إلى فئتَين على النحو التالي:

- مليون تصنيف سلبي

- 10 تصنيفات إيجابية

نسبة التصنيفات السلبية إلى الإيجابية هي 100,000 إلى 1، لذا هذه مجموعة بيانات غير متوازنة الفئات.

في المقابل، مجموعة البيانات التالية متوازنة الفئات لأنّ نسبة التصنيفات السلبية إلى التصنيفات الإيجابية قريبة نسبيًا من 1:

- 517 تصنيفًا سلبيًا

- 483 تصنيفًا إيجابيًا

يمكن أن تكون مجموعات البيانات المتعددة الفئات غير متوازنة الفئات أيضًا. على سبيل المثال، مجموعة البيانات التالية الخاصة بالتصنيف المتعدد الفئات هي أيضًا غير متوازنة الفئات لأنّ إحدى التصنيفات تتضمّن أمثلة أكثر بكثير من التصنيفين الآخرين:

- 1,000,000 تصنيفًا مع الفئة "أخضر"

- 200 تصنيف بالصف "purple"

- 350 تصنيفًا من الفئة "برتقالي"

يمكن أن يواجه تدريب مجموعات البيانات غير المتوازنة الفئات تحديات خاصة. راجِع مجموعات البيانات غير المتوازنة في "دورة مكثّفة عن تعلّم الآلة" للحصول على التفاصيل.

راجِع أيضًا الإنتروبيا وفئة الأغلبية وفئة الأقلية.

القص

أسلوب للتعامل مع القيم الشاذة من خلال تنفيذ أحد الإجراءَين التاليَين أو كليهما:

- تخفيض قيم الميزات التي تتجاوز الحد الأقصى إلى هذا الحد.

- زيادة قيم الميزات التي تقل عن الحد الأدنى إلى هذا الحد الأدنى

على سبيل المثال، لنفترض أنّ <0.5% من قيم ميزة معيّنة تقع خارج النطاق 40-60. في هذه الحالة، يمكنك إجراء ما يلي:

- يجب أن تكون جميع القيم التي تزيد عن 60 (الحدّ الأقصى) هي 60 بالضبط.

- يجب أن تكون جميع القيم الأقل من 40 (الحد الأدنى) هي 40 بالضبط.

يمكن أن تؤدي القيم الشاذة إلى إتلاف النماذج، ما يؤدي أحيانًا إلى تجاوز الأوزان الحد الأقصى أثناء التدريب. يمكن أن تؤدي بعض القيم الشاذة أيضًا إلى تشويه المقاييس بشكل كبير، مثل الدقة. القص هو أسلوب شائع للحد من الضرر.

تفرض عملية اقتطاع التدرّج أن تكون قيم التدرّج ضمن نطاق محدّد أثناء التدريب.

لمزيد من المعلومات، يمكنك الاطّلاع على البيانات الرقمية: التسوية في "الدورة التدريبية المكثّفة حول تعلُّم الآلة".

Cloud TPU

أداة تسريع أجهزة متخصّصة مصمّمة لتسريع مهام تعلُّم الآلة على Google Cloud

التجميع

تجميع الأمثلة ذات الصلة، خاصةً أثناء التعلم غير الخاضع للإشراف بعد تجميع كل الأمثلة، يمكن للمستخدم أن يقدّم بشكل اختياري معنى لكل مجموعة.

تتوفّر العديد من خوارزميات التجميع العنقودي. على سبيل المثال، تجمع خوارزمية k-means الأمثلة استنادًا إلى مدى قربها من نقطة مركزية، كما هو موضّح في الرسم البياني التالي:

يمكن بعد ذلك أن يراجع باحث بشري المجموعات، وأن يصنّف مثلاً المجموعة 1 على أنّها "أشجار قزمة" والمجموعة 2 على أنّها "أشجار كاملة الحجم".

كمثال آخر، لنفترض أنّ هناك خوارزمية تجميع عنقودي تستند إلى المسافة بين مثال ونقطة مركزية، كما هو موضّح أدناه:

يمكنك الاطّلاع على دورة التجميع للحصول على مزيد من المعلومات.

التكيّف المشترك

سلوك غير مرغوب فيه يحدث عندما تتوقّع الخلايا العصبية أنماطًا في بيانات التدريب من خلال الاعتماد بشكل حصري تقريبًا على نواتج خلايا عصبية أخرى محدّدة بدلاً من الاعتماد على سلوك الشبكة ككل. عندما لا تتوفّر الأنماط التي تؤدي إلى التكيّف المشترك في بيانات التحقّق، يؤدي التكيّف المشترك إلى الإفراط في التكيّف. تؤدي تسوية التسرب إلى الحد من التكيّف المشترك، لأنّ التسرب يضمن عدم اعتماد الخلايا العصبية على خلايا عصبية أخرى معيّنة فقط.

الفلترة حسب الاهتمامات الجماعية

تقديم توقّعات بشأن اهتمامات مستخدم معيّن استنادًا إلى اهتمامات العديد من المستخدمين الآخرين يتم استخدام التصفية التعاونية غالبًا في أنظمة التوصية.

يمكنك الاطّلاع على الترشيح التعاوني في دورة "أنظمة الاقتراحات" التدريبية للحصول على مزيد من المعلومات.

نموذج مضغوط

أي نموذج صغير مصمّم للعمل على أجهزة صغيرة ذات موارد حسابية محدودة على سبيل المثال، يمكن تشغيل النماذج المضغوطة على الهواتف الجوّالة أو الأجهزة اللوحية أو الأنظمة المضمّنة.

الحوسبة

(اسم) تشير إلى موارد الحوسبة التي يستخدمها نموذج أو نظام، مثل قدرة المعالجة والذاكرة ومساحة التخزين.

اطّلِع على شرائح تسريع الأداء.

تغيُّر المفهوم

تغيير في العلاقة بين الميزات والتسمية وبمرور الوقت، يؤدي تغيُّر المفهوم إلى خفض جودة النموذج.

أثناء التدريب، يتعرّف النموذج على العلاقة بين الميزات وتصنيفاتها في مجموعة التدريب. إذا كانت التصنيفات في مجموعة التدريب تمثّل العالم الحقيقي بشكل جيد، من المفترض أن يقدّم النموذج توقّعات جيدة في العالم الحقيقي. ومع ذلك، بسبب تغيُّر المفهوم، تميل توقعات النموذج إلى التدهور بمرور الوقت.

على سبيل المثال، لنفترض نموذج تصنيف ثنائي يتنبأ بما إذا كان طراز سيارة معيّن "موفرًا للوقود" أم لا. أي أنّ الميزات يمكن أن تكون:

- وزن السيارة

- ضغط المحرّك

- نوع آليات نقل الطاقة

بينما يكون التصنيف إما:

- موفر للوقود

- غير موفّرة للوقود

ومع ذلك، يتغيّر مفهوم "السيارة الموفّرة للوقود" باستمرار. فطراز السيارة الذي كان يُصنّف على أنّه موفر للوقود في عام 1994، سيُصنّف على الأرجح على أنّه غير موفر للوقود في عام 2024. يميل النموذج الذي يعاني من تغيُّر المفهوم إلى تقديم توقّعات أقل فائدة بمرور الوقت.

قارِن بينها وبين عدم الثبات.

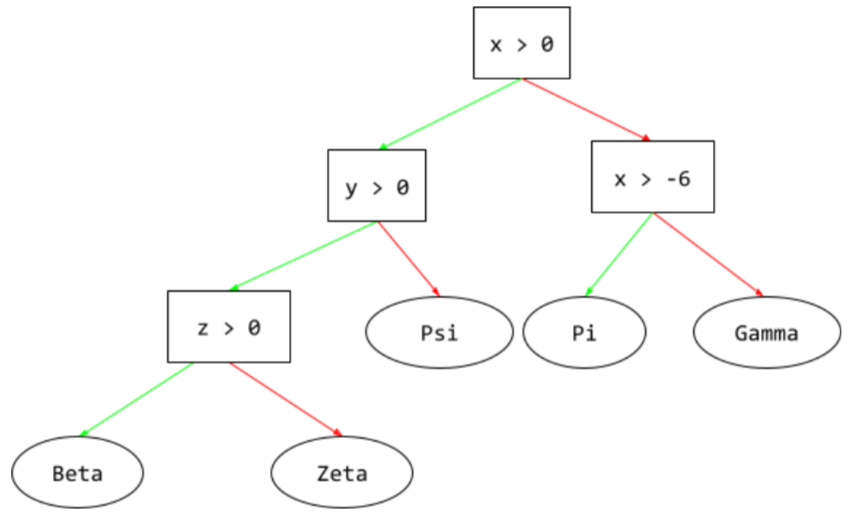

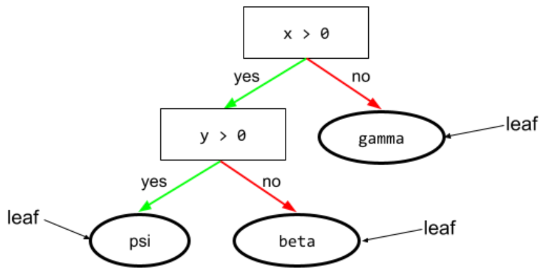

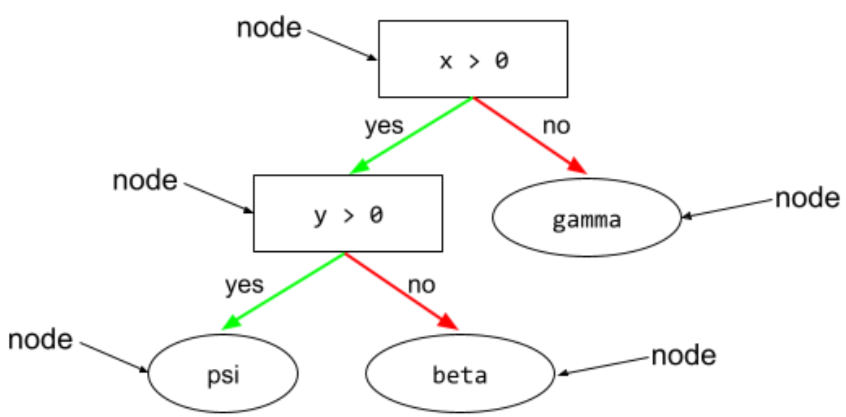

الشرط

في شجرة القرار، يشير ذلك المصطلح إلى أي عقدة تجري اختبارًا. على سبيل المثال، تحتوي شجرة القرارات التالية على شرطَين:

يُطلق على الشرط أيضًا اسم تقسيم أو اختبار.

حالة التباين مع ورقة الشجر

انظر أيضًا:

اطّلِع على أنواع الشروط في دورة "أشجار القرار" للحصول على مزيد من المعلومات.

التلفيق

مرادف لكلمة هلوسة

من المحتمل أنّ مصطلح "التلفيق" هو المصطلح الأكثر دقة من الناحية الفنية مقارنةً بمصطلح "الهلوسة". ومع ذلك، أصبحت الهلوسة شائعة أولاً.

الإعدادات

عملية تحديد قيم السمات الأولية المستخدَمة لتدريب نموذج، بما في ذلك:

- طبقات النموذج

- موقع البيانات

- المعلَمات الفائقة، مثل:

في مشاريع تعلُّم الآلة، يمكن إجراء عملية الإعداد من خلال ملف إعداد خاص أو باستخدام مكتبات الإعداد، مثل ما يلي:

الانحياز التأكيدي

الميل إلى البحث عن المعلومات وتفسيرها وتفضيلها وتذكُّرها بطريقة تؤكد صحة المعتقدات أو الفرضيات الموجودة مسبقًا قد يجمع مطوّرو تعلُّم الآلة البيانات أو يصنّفونها عن غير قصد بطرق تؤثّر في نتيجة تدعم معتقداتهم الحالية. التحيز التأكيدي هو شكل من أشكال التحيز الضمني.

تحيّز المجرب هو شكل من أشكال التحيز التأكيدي، حيث يواصل المجرب تدريب النماذج إلى أن يتم تأكيد فرضية موجودة مسبقًا.

مصفوفة نجاح التوقعات

جدول NxN يلخّص عدد التوقّعات الصحيحة وغير الصحيحة التي قدّمها نموذج التصنيف. على سبيل المثال، إليك مصفوفة الالتباس التالية الخاصة بنموذج تصنيف ثنائي:

| ورم (متوقّع) | غير ورم (متوقّع) | |

|---|---|---|

| ورم (معلومات فعلية) | 18 (TP) | 1 (FN) |

| غير ورمي (معلومات فعلية) | 6 (FP) | 452 (TN) |

تعرض مصفوفة الالتباس السابقة ما يلي:

- من بين التوقعات الـ 19 التي كانت فيها الحقيقة الأساسية هي "ورم"، صنّف النموذج 18 منها بشكل صحيح وصنّف 1 منها بشكل غير صحيح.

- من بين 458 توقّعًا كانت الحقيقة الأساسية فيها هي "غير ورمي"، صنّف النموذج 452 منها بشكل صحيح و6 منها بشكل غير صحيح.

يمكن أن تساعدك مصفوفة الالتباس في تصنيف متعدد الفئات في تحديد أنماط الأخطاء. على سبيل المثال، لنفترض مصفوفة الالتباس التالية لنموذج تصنيف متعدّد الفئات يتضمّن 3 فئات ويصنّف ثلاثة أنواع مختلفة من السوسن (Virginica وVersicolor وSetosa). عندما كانت الحقيقة الأساسية هي Virginica، توضّح مصفوفة الخطأ أنّ النموذج كان أكثر عرضة للتنبؤ بأنّها Versicolor بدلاً من Setosa:

| Setosa (متوقّع) | Versicolor (القيمة المتوقّعة) | Virginica (القيمة المتوقّعة) | |

|---|---|---|---|

| Setosa (المعلومات الفعلية) | 88 | 12 | 0 |

| Versicolor (المعلومات الفعلية) | 6 | 141 | 7 |

| Virginica (المعلومات الفعلية) | 2 | 27 | 109 |

كمثال آخر، يمكن أن تكشف مصفوفة الالتباس أنّ نموذجًا تم تدريبه على التعرّف على الأرقام المكتوبة بخط اليد يميل إلى توقّع الرقم 9 بدلاً من 4، أو توقّع الرقم 1 بدلاً من 7.

تحتوي مصفوفات الالتباس على معلومات كافية لحساب مجموعة متنوعة من مقاييس الأداء، بما في ذلك الدقة والاستدعاء.

تحليل البنية التركيبية

تقسيم الجملة إلى بنى نحوية أصغر ("مكونات") يمكن لجزء لاحق من نظام تعلُّم الآلة، مثل نموذج فهم اللغات الطبيعية، تحليل المكوّنات بسهولة أكبر من الجملة الأصلية. على سبيل المثال، ضع في اعتبارك الجملة التالية:

تبنّى صديقي قطتين.

يمكن أن يقسّم محلّل البنية التركيبية هذه الجملة إلى المكوّنين التاليين:

- صديقي هي عبارة اسمية.

- تبنّيتُ قطتَين هي عبارة فعلية.

ويمكن تقسيم هذه المكوّنات إلى مكوّنات أصغر. على سبيل المثال، عبارة الفعل

تبنّيتُ قطتَين

يمكن تقسيمها إلى:

- adopted هي فعل.

- قطتان هي عبارة اسمية أخرى.

تضمين اللغة حسب السياق

تضمين يقترب من "فهم" الكلمات والعبارات بطرق يفهمها المتحدثون بطلاقة. يمكن أن تفهم عمليات التضمين المستندة إلى السياق التركيب النحوي والدلالات والسياق المعقّد.

على سبيل المثال، ضع في اعتبارك تضمينات الكلمة الإنجليزية cow. يمكن أن تمثّل التضمينات القديمة، مثل word2vec، الكلمات الإنجليزية بطريقة تجعل المسافة في مساحة التضمين بين بقرة وثور مشابهة للمسافة بين نعجة (أنثى الخروف) وكبش (ذكر الخروف) أو بين أنثى وذكر. يمكن أن تتجاوز تضمينات اللغة المستندة إلى السياق ذلك من خلال إدراك أنّ المتحدثين باللغة الإنجليزية يستخدمون أحيانًا كلمة cow بشكل غير رسمي للإشارة إلى البقرة أو الثور.

قدرة الاستيعاب

عدد الرموز المميزة التي يمكن للنموذج معالجتها في طلب معيّن كلما كانت قدرة الاستيعاب أكبر، زادت المعلومات التي يمكن للنموذج استخدامها لتقديم ردود متماسكة ومتّسقة مع الطلب.

خاصية مستمرة

ميزة ذات فاصلة عشرية ونطاق لا نهائي من القيم المحتملة، مثل درجة الحرارة أو الوزن

يجب التمييز بينها وبين الخاصية المحدّدة القيم.

عينة عشوائية

استخدام مجموعة بيانات لم يتم جمعها بشكل علمي لإجراء تجارب سريعة في وقت لاحق، من الضروري التبديل إلى مجموعة بيانات تم جمعها بشكل علمي.

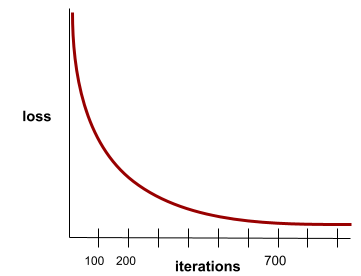

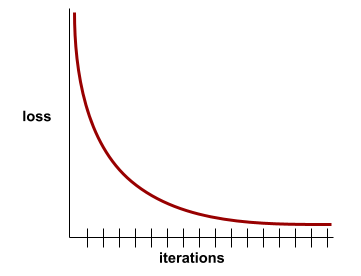

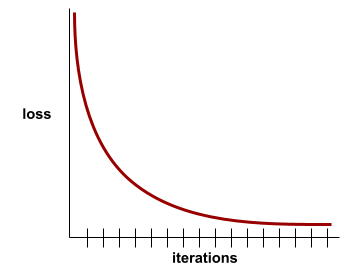

التقارب

هي حالة يتم الوصول إليها عندما تتغير قيم الخسارة بشكل طفيف جدًا أو لا تتغير على الإطلاق مع كل تكرار. على سبيل المثال، يشير منحنى الخسارة التالي إلى التقارب عند حوالي 700 تكرار:

يتقارب النموذج عندما لا يؤدي التدريب الإضافي إلى تحسينه.

في التعلم العميق، تظل قيم الخسارة ثابتة أحيانًا أو قريبة من ذلك لعدة تكرارات قبل أن تنخفض أخيرًا. خلال فترة طويلة من القيم الثابتة للخسارة، قد تشعر مؤقتًا بشكل خاطئ بالتقارب.

اطّلِع أيضًا على الإيقاف المبكر.

لمزيد من المعلومات، يُرجى الاطّلاع على تقارب النماذج ومنحنيات الخسارة في "دورة تدريبية مكثّفة حول تعلُّم الآلة".

البرمجة الحوارية

محادثة متكرّرة بينك وبين نموذج ذكاء اصطناعي توليدي بغرض إنشاء برامج تُصدر طلبًا يصف بعض البرامج. بعد ذلك، يستخدم النموذج هذا الوصف لإنشاء الرمز. بعد ذلك، يمكنك إصدار طلب جديد لمعالجة العيوب في الطلب السابق أو في الرمز الذي تم إنشاؤه، وسينشئ النموذج رمزًا معدَّلاً. ويستمرّان في تبادل الرسائل إلى أن يصبح البرنامج الذي تم إنشاؤه جيدًا بما يكفي.

إنّ ترميز المحادثات هو في الأساس المعنى الأصلي لترميز الأجواء.

يختلف عن الترميز التحديدي.

دالّة محدّبة

الدالة التي تكون فيها المنطقة الواقعة فوق الرسم البياني للدالة مجموعة محدّبة. تتخذ الدالة المحدبة النموذجية شكلًا يشبه الحرف U. على سبيل المثال، الدوال التالية كلها دوال محدّبة:

في المقابل، الدالة التالية ليست محدّبة. لاحظ كيف أنّ المنطقة أعلاه الرسم البياني ليست مجموعة محدّبة:

الدالة المحدّبة تمامًا لها نقطة حد أدنى محلية واحدة فقط، وهي أيضًا نقطة الحد الأدنى العام. الدوال الكلاسيكية على شكل حرف U هي دوال محدّبة تمامًا. ومع ذلك، بعض الدوال المحدّبة (مثل الخطوط المستقيمة) ليست على شكل حرف U.

يمكنك الاطّلاع على التقارب والدوال المحدّبة في "الدورة التدريبية المكثّفة حول تعلُّم الآلة" للحصول على مزيد من المعلومات.

تحسين الدالّة المحدّبة

عملية استخدام تقنيات رياضية، مثل النزول التدريجي، للعثور على الحد الأدنى لدالة محدّبة تركّز الكثير من الأبحاث في مجال تعلُّم الآلة على صياغة مشاكل مختلفة على أنّها مشاكل تحسين محدّبة وعلى حلّ هذه المشاكل بشكل أكثر فعالية.

للاطّلاع على التفاصيل الكاملة، يُرجى الرجوع إلى كتاب Boyd and Vandenberghe، Convex Optimization.

مجموعة محدّبة

مجموعة فرعية من الفضاء الإقليدي، بحيث يظل الخط المرسوم بين أي نقطتين في المجموعة الفرعية ضمن المجموعة الفرعية تمامًا على سبيل المثال، الشكلان التاليان هما مجموعتان محدّبتان:

في المقابل، الشكلان التاليان ليسا مجموعتين محدّبتين:

الالتفاف

في الرياضيات، وبشكل غير رسمي، هي مزيج من دالتين. في تعلُّم الآلة، يجمع الالتفاف بين فلتر الالتفاف ومصفوفة الإدخال من أجل تدريب الأوزان.

في سياق تعلُّم الآلة، يشير مصطلح "الالتفاف" غالبًا إلى طريقة مختصرة للإشارة إلى عملية الالتفاف أو طبقة الالتفاف.

بدون الالتفافات، يجب أن تتعلّم خوارزمية التعلم الآلي وزنًا منفصلاً لكل خلية في موتر كبير. على سبيل المثال، سيتم إجبار خوارزمية تعلُّم الآلة التي يتم تدريبها على صور بدقة 2000 × 2000 على العثور على 4 ملايين وزن منفصل. بفضل الالتفافات، لا يحتاج خوارزمية تعلُّم الآلة إلا إلى العثور على أوزان لكل خلية في فلتر الالتفاف، ما يقلّل بشكل كبير من الذاكرة اللازمة لتدريب النموذج. عند تطبيق فلتر الالتفاف، يتم ببساطة تكراره على مستوى الخلايا بحيث يتم ضرب كل خلية في الفلتر.

يمكنك الاطّلاع على مقدمة عن الشبكات العصبية الالتفافية في دورة تصنيف الصور التدريبية للحصول على مزيد من المعلومات.

فلتر التفافي

أحد العنصرَين في عملية التفافية (المتغير الآخر هو شريحة من مصفوفة إدخال). الفلتر الالتفافي هو مصفوفة لها الترتيب نفسه الخاص بمصفوفة الإدخال، ولكن بشكل أصغر. على سبيل المثال، إذا كانت مصفوفة الإدخال 28x28، يمكن أن يكون الفلتر أي مصفوفة ثنائية الأبعاد أصغر من 28x28.

في معالجة الصور، يتم عادةً ضبط جميع الخلايا في فلتر التفاف على نمط ثابت من الآحاد والأصفار. في تعلُّم الآلة، يتم عادةً إدخال أرقام عشوائية إلى فلاتر الالتفاف، ثم تدريب الشبكة على القيم المثالية.

يمكنك الاطّلاع على الالتفاف في دورة تصنيف الصور التدريبية للحصول على مزيد من المعلومات.

الطبقة الالتفافية

طبقة من شبكة عصبية عميقة يتم فيها تمرير فلتر التفافي على طول مصفوفة إدخال. على سبيل المثال، إليك فلتر التفاف بحجم 3x3:

![مصفوفة 3x3 بالقيم التالية: [[0,1,0], [1,0,1], [0,1,0]]](https://developers.google.cn/static/machine-learning/glossary/images/ConvolutionalFilter33.svg?authuser=0000&hl=ar)

تعرض الصورة المتحركة التالية طبقة التفافية تتألف من 9 عمليات التفافية تتضمّن مصفوفة الإدخال 5x5. لاحظ أنّ كل عملية التفافية تعمل على شريحة مختلفة من مصفوفة الإدخال بحجم 3×3. تتألف مصفوفة 3x3 الناتجة (على اليسار) من نتائج عمليات الالتفاف التسع:

![صورة متحرّكة تعرض مصفوفتَين. المصفوفة الأولى هي مصفوفة 5x5: [[128,97,53,201,198], [35,22,25,200,195],

[37,24,28,197,182], [33,28,92,195,179], [31,40,100,192,177]].

المصفوفة الثانية هي المصفوفة 3x3:

[[181,303,618], [115,338,605], [169,351,560]].

يتم احتساب المصفوفة الثانية من خلال تطبيق فلتر التفاف [0, 1, 0]، [1, 0, 1]، [0, 1, 0] على مجموعات فرعية مختلفة بحجم 3×3 من المصفوفة 5×5.](https://developers.google.cn/static/machine-learning/glossary/images/AnimatedConvolution.gif?authuser=0000&hl=ar)

يمكنك الاطّلاع على الطبقات المتصلة بالكامل في دورة تصنيف الصور التدريبية للحصول على مزيد من المعلومات.

شبكة عصبونية التفافية

شبكة عصبونية يكون فيها طبقة واحدة على الأقل عبارة عن طبقة التفافية تتألف الشبكة العصبية الالتفافية النموذجية من مجموعة من الطبقات التالية:

حققت الشبكات العصبونية الالتفافية نجاحًا كبيرًا في أنواع معيّنة من المشاكل، مثل التعرّف على الصور.

عملية الالتفاف

العملية الرياضية التالية المكوَّنة من خطوتَين:

- الضرب حسب العناصر بين فلتر الالتفاف وشريحة من مصفوفة الإدخال (يحتوي جزء مصفوفة الإدخال على الترتيب والحجم نفسيهما كما هو الحال في فلتر الالتفاف).

- مجموع كل القيم في مصفوفة المنتجات الناتجة

على سبيل المثال، ضع في اعتبارك مصفوفة الإدخال التالية بحجم 5x5:

![المصفوفة 5x5: [[128,97,53,201,198], [35,22,25,200,195],

[37,24,28,197,182], [33,28,92,195,179], [31,40,100,192,177]].](https://developers.google.cn/static/machine-learning/glossary/images/ConvolutionalLayerInputMatrix.svg?authuser=0000&hl=ar)

لنفترض الآن فلتر التفافي 2x2 التالي:

![المصفوفة 2x2: [[1, 0], [0, 1]]](https://developers.google.cn/static/machine-learning/glossary/images/ConvolutionalLayerFilter.svg?authuser=0000&hl=ar)

تتضمّن كل عملية التفاف شريحة واحدة بحجم 2×2 من مصفوفة الإدخال. على سبيل المثال، لنفترض أنّنا نستخدم شريحة 2x2 في أعلى يسار مصفوفة الإدخال. إذًا، تبدو عملية الالتفاف على هذه الشريحة كما يلي:

![تطبيق فلتر التفاف [[1, 0], [0, 1]] على القسم 2x2 في أعلى يمين مصفوفة الإدخال، وهو [[128,97], [35,22]].

يترك فلتر الالتفاف القيمتين 128 و22 كما هما، ولكنّه يضبط القيمتين 97 و35 على صفر. وبالتالي، تؤدي عملية الالتفاف إلى القيمة 150 (128+22).](https://developers.google.cn/static/machine-learning/glossary/images/ConvolutionalLayerOperation.svg?authuser=0000&hl=ar)

تتألف الطبقة الالتفافية من سلسلة من العمليات الالتفافية، كل منها يعمل على شريحة مختلفة من مصفوفة الإدخال.

التكلفة

مرادف لكلمة خسارة

التدريب المشترك

يُعدّ أسلوب التعلّم شبه الموجّه مفيدًا بشكل خاص عندما تكون جميع الشروط التالية صحيحة:

- نسبة الأمثلة غير المصنّفة إلى الأمثلة المصنّفة في مجموعة البيانات مرتفعة.

- هذه مشكلة تصنيف (ثنائي أو متعدد الفئات).

- تحتوي مجموعة البيانات على مجموعتَين مختلفتَين من السمات التنبؤية المستقلة عن بعضها البعض والمتكاملة.

تعمل عملية التدريب المشترك بشكل أساسي على تضخيم الإشارات المستقلة وتحويلها إلى إشارة أقوى. على سبيل المثال، لنفترض أنّ هناك نموذج تصنيف يصنّف السيارات المستعملة الفردية إلى جيدة أو سيئة. قد تركّز إحدى مجموعات الميزات التوقعية على الخصائص المجمّعة، مثل سنة تصنيع السيارة وعلامتها التجارية وطرازها، وقد تركّز مجموعة أخرى من الميزات التوقعية على سجل القيادة الخاص بالمالك السابق وسجل صيانة السيارة.

إنّ الورقة البحثية الأساسية حول التدريب المشترك هي الجمع بين البيانات المصنّفة وغير المصنّفة باستخدام التدريب المشترك من تأليف بلوم وميتشل.

العدالة في حالة عدم توفّر الحقائق

مقياس الإنصاف الذي يتحقّق مما إذا كان نموذج التصنيف يعرض النتيجة نفسها لشخص ما كما يعرضها لشخص آخر مطابق للأول، باستثناء ما يتعلق بواحدة أو أكثر من السمات الحسّاسة. يُعدّ تقييم نموذج التصنيف من حيث العدالة الواقعية الافتراضية إحدى الطرق للكشف عن المصادر المحتملة للتحيّز في النموذج.

يمكنك الاطّلاع على أيّ مما يلي لمزيد من المعلومات:

- الإنصاف: الإنصاف الافتراضي في "دورة مكثّفة حول تعلُّم الآلة"

- When Worlds Collide: Integrating Different Counterfactual Assumptions in Fairness

انحياز في التغطية

اطّلِع على الانحياز في الاختيار.

crash blossom

جملة أو عبارة ذات معنى غامض تشكّل أخطاء "الازدهار المفاجئ" مشكلة كبيرة في فهم اللغة الطبيعية. على سبيل المثال، العنوان الروتين يعطّل بناء ناطحة سحاب هو مثال على جملة مبهمة لأنّ نموذج فهم اللغة الطبيعية قد يفسّر العنوان حرفيًا أو مجازيًا.

ناقد

مرادف شبكة Q العميقة

الإنتروبيا المتقاطعة

تعميم فقدان السجلّ على مشاكل التصنيف المتعدد الفئات يقيس الانتروبيا المتقاطعة الفرق بين توزيعَين للاحتمالات. يمكنك الاطّلاع أيضًا على مقياس الحيرة.

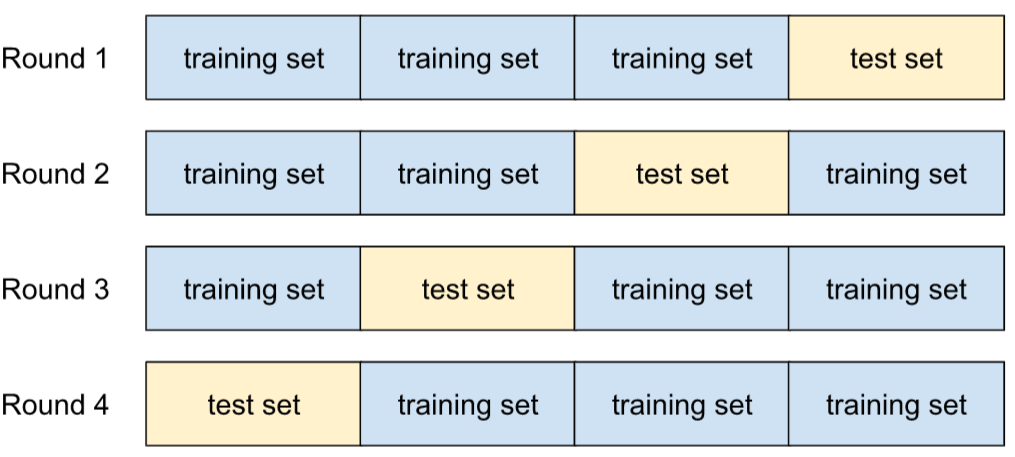

التحقّق المتقاطع

آلية لتقدير مدى قدرة النموذج على التعميم على البيانات الجديدة من خلال اختبار النموذج على مجموعة فرعية واحدة أو أكثر من البيانات غير المتداخلة المحجوبة من مجموعة التدريب

دالة التوزيع التراكمي (CDF)

دالة تحدّد عدد المرّات التي تكون فيها العيّنات أقل من قيمة مستهدَفة أو مساوية لها. على سبيل المثال، لنفترض أنّ هناك توزيعًا طبيعيًا للقيم المستمرة. يخبرك التوزيع التراكمي بأنّ% 50 تقريبًا من العيّنات يجب أن تكون أقل من أو تساوي المتوسط، وأنّ% 84 تقريبًا من العيّنات يجب أن تكون أقل من أو تساوي الانحراف المعياري الواحد فوق المتوسط.

D

تحليل البيانات

فهم البيانات من خلال النظر في العيّنات والقياس والعرض المرئي يمكن أن يكون تحليل البيانات مفيدًا بشكل خاص عند تلقّي مجموعة بيانات لأول مرة، قبل إنشاء النموذج الأول. وهي ضرورية أيضًا لفهم التجارب وتصحيح الأخطاء في النظام.

توسيع نطاق البيانات

زيادة نطاق وعدد أمثلة التدريب بشكل مصطنع من خلال تحويل الأمثلة الحالية لإنشاء أمثلة إضافية على سبيل المثال، لنفترض أنّ الصور هي إحدى الميزات، ولكن مجموعة البيانات لا تحتوي على أمثلة كافية من الصور ليتعلّم النموذج الارتباطات المفيدة. من المفترض أن تضيف عددًا كافيًا من الصور المصنَّفة إلى مجموعة البيانات كي يتم تدريب النموذج بشكل صحيح. إذا لم يكن ذلك ممكنًا، يمكن أن تؤدي عملية زيادة البيانات إلى تدوير كل صورة وتمديدها وعكسها لإنتاج العديد من الصيغ للصورة الأصلية، ما قد يؤدي إلى توفير بيانات مصنّفة كافية لإجراء تدريب ممتاز.

DataFrame

نوع بيانات pandas شائع لتمثيل مجموعات البيانات في الذاكرة.

يشبه DataFrame الجدول أو جدول البيانات. يحتوي كل عمود في DataFrame على اسم (عنوان)، ويتم تحديد كل صف برقم فريد.

يتم تنظيم كل عمود في إطار البيانات على شكل مصفوفة ثنائية الأبعاد، إلا أنّه يمكن تعيين نوع بيانات خاص لكل عمود.

يمكنك أيضًا مراجعة صفحة pandas.DataFrame المرجعية الرسمية.

التوازي على مستوى البيانات

طريقة لتوسيع نطاق التدريب أو الاستدلال عن طريق تكرار نموذج كامل على أجهزة متعددة، ثم تمرير مجموعة فرعية من بيانات الإدخال إلى كل جهاز. يمكن أن تتيح ميزة "التوازي في البيانات" التدريب والاستدلال على أحجام دفعات كبيرة جدًا، ولكنها تتطلّب أن يكون النموذج صغيرًا بما يكفي ليتناسب مع جميع الأجهزة.

تؤدي موازاة البيانات عادةً إلى تسريع التدريب والاستدلال.

يمكنك أيضًا الاطّلاع على التوازي بين النماذج.

Dataset API (tf.data)

واجهة برمجة تطبيقات TensorFlow عالية المستوى لقراءة البيانات وتحويلها إلى نموذج تتطلّبه خوارزمية تعلُّم الآلة

يمثّل كائن tf.data.Dataset تسلسلاً من العناصر، يحتوي كل عنصر فيه على Tensor واحد أو أكثر. يتيح عنصر tf.data.Iterator الوصول إلى عناصر Dataset.

مجموعة البيانات

مجموعة من البيانات الأولية، يتم تنظيمها عادةً (وليس حصريًا) بأحد التنسيقات التالية:

- جدول بيانات

- ملف بتنسيق CSV (قيم مفصولة بفواصل)

فاصل بين الفئات

الفاصل بين الفئات التي تعلّمها نموذج في مشاكل التصنيف الثنائي أو مشاكل التصنيف المتعدد الفئات على سبيل المثال، في الصورة التالية التي تمثّل مشكلة تصنيف ثنائي، الحد الفاصل هو الحد بين الفئة البرتقالية والفئة الزرقاء:

غابة القرارات

نموذج تم إنشاؤه من عدة أشجار قرارات تُجري "غابة القرارات" عملية توقّع من خلال تجميع التوقّعات التي تقدّمها أشجار القرارات. تشمل الأنواع الشائعة من غابات القرارات الغابات العشوائية وأشجار التدرّج المعزّز.

يمكنك الاطّلاع على قسم أشجار القرارات العشوائية في دورة "أشجار القرارات" للحصول على مزيد من المعلومات.

حدّ اتّخاذ القرار

مرادف لحدّ التصنيف

شجرة القرارات

نموذج تعلُّم بإشراف يتألف من مجموعة من الشروط والعُقد الطرفية منظَّمة بشكل هرمي. على سبيل المثال، ما يلي هو شجرة قرارات:

برنامج فك الترميز

بشكل عام، أي نظام تعلُّم آلي يحوّل من تمثيل معالَج أو كثيف أو داخلي إلى تمثيل أكثر أولية أو تفرّقًا أو خارجية.

غالبًا ما تكون أدوات فك الترميز جزءًا من نموذج أكبر، حيث يتم دمجها بشكل متكرر مع أداة ترميز.

في مهام التسلسل إلى التسلسل، يبدأ برنامج الترميز بإدخال الحالة الداخلية التي أنشأها برنامج الترميز ليتوقّع التسلسل التالي.

راجِع المحوّل للتعرّف على تعريف برنامج فك الترميز ضمن بنية المحوّل.

لمزيد من المعلومات، يمكنك الاطّلاع على النماذج اللغوية الكبيرة في "دورة مكثّفة عن تعلّم الآلة".

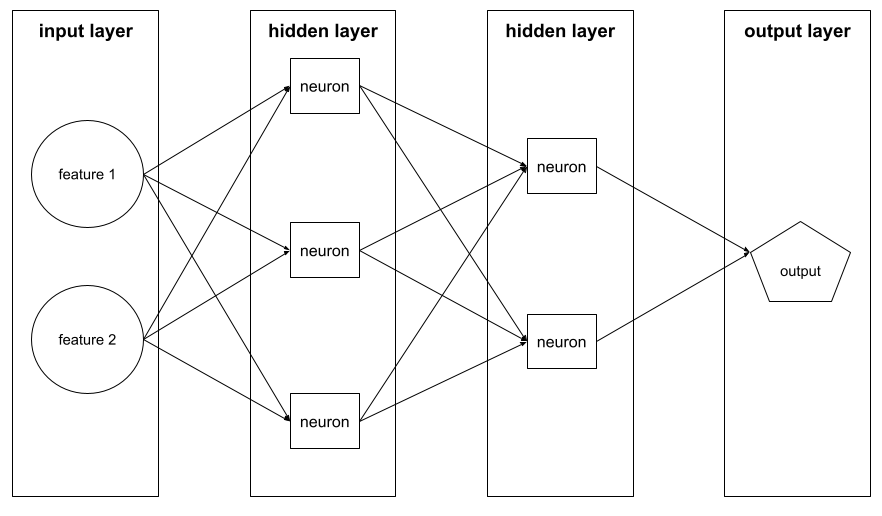

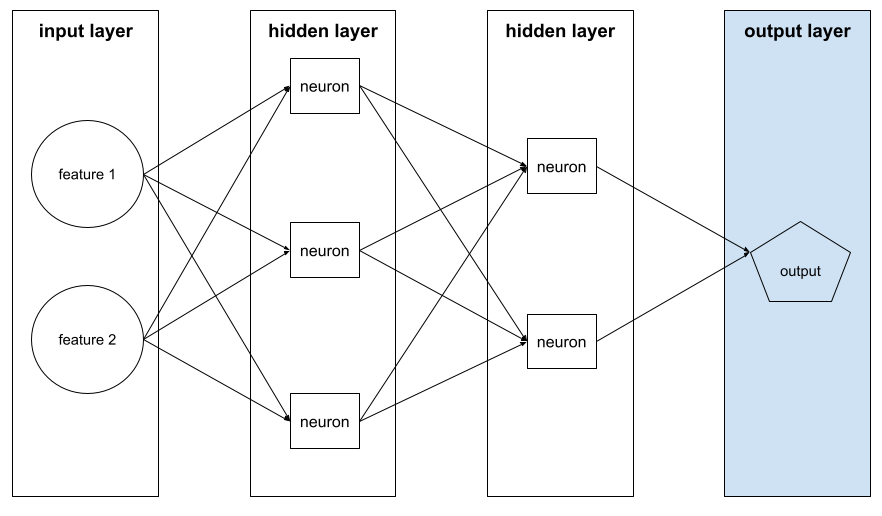

نموذج عميق

شبكة عصبية تحتوي على أكثر من طبقة مخفية

يُطلق على النموذج العميق أيضًا اسم شبكة عصبية عميقة.

يختلف عن النموذج الواسع.

شبكة عصبية عميقة

مرادف للنموذج العميق

شبكة Q العميقة (DQN)

في تعلُّم Q، يتم استخدام شبكة عصبية عميقة لتوقُّع دالات Q.

الناقد هو مرادف لشبكة Deep Q-Network.

التكافؤ الديمغرافي

مقياس العدالة الذي يتم استيفاؤه إذا كانت نتائج تصنيف النموذج لا تعتمد على سمة حساسة معيّنة.

على سبيل المثال، إذا كان كل من سكان ليليبوت وبروبدينغناغ يتقدّمون بطلبات إلى جامعة غلوبدوبدريب، يتم تحقيق التكافؤ الديموغرافي إذا كانت النسبة المئوية للطلاب المقبولين من ليليبوت هي نفسها النسبة المئوية للطلاب المقبولين من بروبدينغناغ، بغض النظر عمّا إذا كانت إحدى المجموعتين أكثر تأهيلاً من الأخرى في المتوسط.

يختلف هذا المقياس عن التكافؤ في الاحتمالات وتكافؤ الفرص، اللذين يسمحان بأن تعتمد نتائج التصنيف بشكل إجمالي على السمات الحسّاسة، ولكنّهما لا يسمحان بأن تعتمد نتائج التصنيف لبعض تصنيفات الحقيقة الأساسية المحدّدة على السمات الحسّاسة. يمكنك الاطّلاع على "مكافحة التمييز باستخدام تكنولوجيا تعلُّم الآلة الأذكى" للحصول على رسم توضيحي يستعرض المفاضلة بين الخيارات عند تحسين التكافؤ الديمغرافي.

يمكنك الاطّلاع على الإنصاف: التكافؤ الديمغرافي في "دورة مكثّفة عن تعلّم الآلة" للحصول على مزيد من المعلومات.

إزالة التشويش

أحد الأساليب الشائعة في التعلّم الذاتي الذي يتضمّن:

يتيح إزالة التشويش التعلّم من أمثلة غير مصنَّفة. تعمل مجموعة البيانات الأصلية كهدف أو تصنيف، وتعمل البيانات المشوّشة كمدخل.

تستخدم بعض نماذج اللغة المقنّعة أسلوب إزالة التشويش على النحو التالي:

- تتم إضافة تشويش بشكل اصطناعي إلى جملة غير مصنّفة من خلال إخفاء بعض الرموز المميزة.

- يحاول النموذج توقّع الرموز المميزة الأصلية.

خاصية كثيفة

ميزة تكون معظم قيمها أو كلها غير صفرية، وعادةً ما تكون Tensor من قيم الفاصلة العائمة. على سبيل المثال، يكون Tensor التالي المكوّن من 10 عناصر كثيفًا لأنّ 9 من قيمه غير صفرية:

| 8 | 3 | 7 | 5 | 2 | 4 | 0 | 4 | 9 | 6 |

يختلف عن الخاصية المتناثرة.

طبقة كثيفة

مرادف الطبقة المكتملة الاتصال

العمق

مجموع ما يلي في شبكة عصبونية:

- عدد الطبقات المخفية

- عدد الطبقات النهائية، وهو عادةً 1

- عدد أي طبقات تضمين

على سبيل المثال، تبلغ عمق الشبكة العصبية التي تتضمّن خمس طبقات مخفية وطبقة إخراج واحدة 6 طبقات.

يُرجى العِلم أنّ طبقة الإدخال لا تؤثر في العمق.

شبكة عصبونية التفافية قابلة للفصل حسب العمق (sepCNN)

بنية شبكة عصبونية التفافية تستند إلى Inception، ولكن يتم فيها استبدال وحدات Inception بعمليات التفاف منفصلة حسب العمق. يُعرف أيضًا باسم Xception.

الالتفاف المنفصل حسب العمق (يُختصر أيضًا إلى الالتفاف المنفصل) هو عملية تفكيك عملية الالتفاف الثلاثية الأبعاد العادية إلى عمليتَي التفاف منفصلتَين أكثر فعالية من الناحية الحسابية: أولاً، عملية التفاف حسب العمق بعمق 1 (n ✕ n ✕ 1)، ثم عملية التفاف نقطية بطول وعرض 1 (1 ✕ 1 ✕ n).

لمزيد من المعلومات، يُرجى الاطّلاع على Xception: Deep Learning with Depthwise Separable Convolutions.

التصنيف المشتق

مرادف للتصنيف التقريبي

جهاز

مصطلح مثقل بالمعاني يتضمّن التعريفَين المحتملَين التاليَين:

- فئة من الأجهزة يمكنها تشغيل جلسة TensorFlow، بما في ذلك وحدات المعالجة المركزية (CPU) ووحدات معالجة الرسومات (GPU) ووحدات معالجة الموتّرات (TPU).

- عند تدريب نموذج تعلُّم آلي على شرائح تسريع (وحدات معالجة الرسومات أو وحدات معالجة الموتّرات)، يكون هذا الجزء من النظام هو المسؤول عن معالجة الموتّرات وعمليات التضمين. يعمل الجهاز باستخدام شرائح تسريع. في المقابل، يعمل المضيف عادةً على وحدة معالجة مركزية.

الخصوصية التفاضلية

في تعلُّم الآلة، يشير ذلك إلى أسلوب إخفاء الهوية لحماية أي بيانات حساسة (مثل المعلومات الشخصية لأحد الأفراد) مضمّنة في مجموعة التدريب الخاصة بأحد النماذج من التعرّض. يضمن هذا النهج ألا يتعلّم النموذج أو يتذكّر الكثير من المعلومات حول فرد معيّن. ويتم ذلك من خلال أخذ عيّنات وإضافة تشويش أثناء تدريب النموذج لإخفاء نقاط البيانات الفردية، ما يقلّل من خطر الكشف عن بيانات التدريب الحسّاسة.

يتم أيضًا استخدام أسلوب "الخصوصية التفاضلية" خارج نطاق تعلُّم الآلة. على سبيل المثال، يستخدم علماء البيانات أحيانًا الخصوصية التفاضلية لحماية خصوصية الأفراد عند احتساب إحصاءات استخدام المنتجات لمختلف الخصائص الديمغرافية.

تخفيض عدد السمات

تقليل عدد السمات المستخدَمة لتمثيل ميزة معيّنة في متّجه الميزات، عادةً من خلال التحويل إلى متّجه تضمين

الأبعاد

مصطلح محمل بأكثر من معنى وله أي من التعريفات التالية:

عدد مستويات الإحداثيات في Tensor على سبيل المثال:

- المقياس العددي ليس له أبعاد، مثل

["Hello"]. - يتضمّن المتّجه سمة واحدة، مثل

[3, 5, 7, 11]. - تحتوي المصفوفة على سمتَين، مثل

[[2, 4, 18], [5, 7, 14]]. يمكنك تحديد خلية معيّنة بشكل فريد في متّجه أحادي البُعد باستخدام إحداثي واحد، بينما تحتاج إلى إحداثيَين لتحديد خلية معيّنة بشكل فريد في مصفوفة ثنائية الأبعاد.

- المقياس العددي ليس له أبعاد، مثل

عدد الإدخالات في متّجه الميزات

عدد العناصر في طبقة التضمين

الطلب المباشر

مرادف للتلقين بلا أمثلة

خاصية محدّدة القيم

الميزة التي تتضمّن مجموعة محدودة من القيم المحتملة على سبيل المثال، السمة التي لا يمكن أن تكون قيمها سوى حيوان أو نبات أو معدن هي سمة منفصلة (أو فئوية).

يختلف عن الخاصية المستمرة.

النموذج التمييزي

نموذج يتوقّع تصنيفات من مجموعة تتضمّن ميزة واحدة أو أكثر من الميزات بشكل أكثر رسمية، تحدّد النماذج التمييزية الاحتمالية الشرطية للناتج بالنظر إلى الميزات والأوزان، أي:

p(output | features, weights)

على سبيل المثال، النموذج الذي يتنبأ بما إذا كانت الرسالة الإلكترونية غير مرغوب فيها من الميزات والأوزان هو نموذج تمييزي.

إنّ الغالبية العظمى من نماذج التعلّم الخاضع للإشراف، بما في ذلك نماذج التصنيف والانحدار، هي نماذج تمييزية.

يختلف عن النموذج التوليدي.

المُميِّز

نظام يحدّد ما إذا كانت الأمثلة حقيقية أو مزيفة.

أو، هو النظام الفرعي ضمن شبكة الخصومة التوليدية الذي يحدّد ما إذا كانت الأمثلة التي أنشأها المولّد حقيقية أو مزيفة.

يمكنك الاطّلاع على المميّز في دورة GAN التدريبية للحصول على مزيد من المعلومات.

التأثير غير المتكافئ

اتّخاذ قرارات بشأن أشخاص تؤثّر بشكل غير متناسب في مجموعات فرعية مختلفة من السكان يشير ذلك عادةً إلى الحالات التي تؤدي فيها عملية اتخاذ القرارات المستندة إلى الخوارزميات إلى إلحاق الضرر ببعض المجموعات الفرعية أو إفادتها أكثر من غيرها.

على سبيل المثال، لنفترض أنّ خوارزمية تحدّد أهلية شخص من ليليبوت للحصول على قرض لشراء منزل صغير، ومن المرجّح أن تصنّفه على أنّه "غير مؤهّل" إذا كان عنوانه البريدي يتضمّن رمزًا بريديًا معيّنًا. إذا كان من المرجّح أن يكون لدى سكان ليليبوت الذين يستخدمون نظام Big-Endian عناوين بريدية تتضمّن هذا الرمز البريدي أكثر من سكان ليليبوت الذين يستخدمون نظام Little-Endian، قد تؤدي هذه الخوارزمية إلى تأثير متفاوت.

يختلف ذلك عن المعاملة غير المتكافئة، التي تركّز على التفاوتات الناتجة عندما تكون خصائص المجموعة الفرعية مدخلات صريحة في عملية اتخاذ القرار المستندة إلى الخوارزميات.

المعاملة غير المتكافئة

إدخال السمات الحسّاسة الخاصة بالأشخاص في عملية اتخاذ القرار المستندة إلى الخوارزميات، ما يؤدي إلى معاملة المجموعات الفرعية المختلفة من الأشخاص بشكل مختلف

على سبيل المثال، لنفترض أنّ هناك خوارزمية تحدّد أهلية الأشخاص للحصول على قرض لشراء منزل صغير استنادًا إلى البيانات التي يقدّمونها في طلب القرض. إذا كانت الخوارزمية تستخدم انتماء أحد الأشخاص إلى Lilliputian كإدخال Big-Endian أو Little-Endian، فإنّها تمارس معاملة مختلفة على هذا الأساس.

يختلف ذلك عن التأثير غير المتكافئ الذي يركّز على التفاوتات في التأثيرات المجتمعية للقرارات الخوارزمية على المجموعات الفرعية، بغض النظر عمّا إذا كانت هذه المجموعات الفرعية مدخلات للنموذج.

التقطير

عملية تقليل حجم نموذج (يُعرف باسم النموذج الرئيسي) إلى نموذج أصغر (يُعرف باسم النموذج الفرعي) يحاكي توقّعات النموذج الأصلي بأكبر قدر ممكن من الدقة التقطير مفيد لأنّ النموذج الأصغر حجمًا يتضمّن ميزتَين رئيسيتَين مقارنةً بالنموذج الأكبر حجمًا (المعلّم):

- وقت استنتاج أسرع

- تقليل استخدام الذاكرة والطاقة

ومع ذلك، لا تكون توقعات الطالب جيدة عادةً مثل توقعات المعلّم.

تدرّب عملية التقطير نموذج الطالب على تقليل دالة الخسارة استنادًا إلى الفرق بين نتائج التوقعات التي يقدّمها نموذج الطالب ونموذج المعلّم.

قارِن بين التقطير والمصطلحات التالية:

لمزيد من المعلومات، يمكنك الاطّلاع على النماذج اللغوية الكبيرة: الضبط الدقيق والتقطير وهندسة الطلبات في "دورة مكثّفة عن تعلّم الآلة".

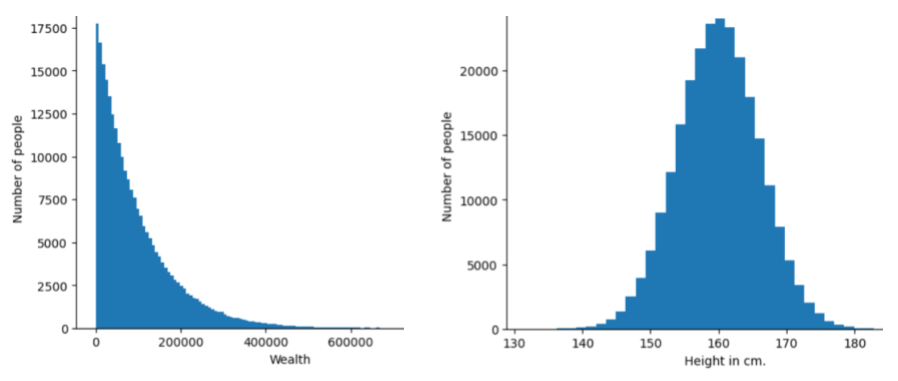

distribution

تمثّل هذه السمة عدد المرات التي تظهر فيها القيم المختلفة للميزة أو التصنيف ونطاقها. يعرض التوزيع مدى احتمالية ظهور قيمة معيّنة.

تعرض الصورة التالية المدرّجات التكرارية لتوزيعَين مختلفَين:

- على اليمين، يظهر توزيع قانون القوة للثروة مقابل عدد الأشخاص الذين يملكون هذه الثروة.

- على اليسار، يظهر التوزيع الطبيعي للطول مقابل عدد الأشخاص الذين يبلغ طولهم هذا المقدار.

يمكن أن يساعدك فهم توزيع كل ميزة وتصنيف في تحديد كيفية تسوية القيم ورصد القيم الشاذة.

تشير عبارة خارج التوزيع إلى قيمة لا تظهر في مجموعة البيانات أو تظهر بشكل نادر جدًا. على سبيل المثال، ستُعتبر صورة لكوكب زحل خارج نطاق التوزيع لمجموعة بيانات تتألف من صور قطط.

التجميع من الأعلى إلى الأسفل

راجِع مقالة التجميع الهرمي.

تصغير نطاق العيّنات

مصطلح عام يمكن أن يشير إلى أحد المعنيَين التاليَين:

- تقليل كمية المعلومات في ميزة بهدف تدريب نموذج بشكل أكثر فعالية على سبيل المثال، قبل تدريب نموذج للتعرّف على الصور، يتم تقليل دقة الصور العالية الدقة إلى تنسيق أقل دقة.

- التدريب على نسبة منخفضة بشكل غير متناسب من أمثلة الفئة الممثَّلة بشكل مفرط، وذلك بهدف تحسين تدريب النموذج على الفئات الممثَّلة بشكل ناقص على سبيل المثال، في مجموعة بيانات غير متوازنة الفئات، تميل النماذج إلى التعرّف على الكثير من المعلومات حول الفئة الأكبر، ولكن ليس بالقدر الكافي حول الفئة الأصغر. تساعد عملية تقليل عدد العيّنات في تحقيق التوازن بين مقدار التدريب على الفئات الأغلبية والأقلية.

لمزيد من المعلومات، راجِع مجموعات البيانات: مجموعات البيانات غير المتوازنة في "دورة مكثّفة عن تعلّم الآلة".

DQN

اختصار شبكة Q العميقة

تسوية الإسقاط

أحد أشكال التسوية المفيدة في تدريب الشبكات العصبونية. تزيل عملية التسوية باستخدام تقنية Dropout مجموعة عشوائية من عدد ثابت من الوحدات في إحدى طبقات الشبكة خلال خطوة واحدة من التدرّج. وكلما زاد عدد الوحدات التي تم تجاهلها، زادت قوة التسوية. وهذا يشبه تدريب الشبكة على محاكاة مجموعة كبيرة بشكل كبير من الشبكات الأصغر. للحصول على التفاصيل الكاملة، يُرجى الاطّلاع على Dropout: A Simple Way to Prevent Neural Networks from Overfitting.

ديناميكي

شيء يتم إجراؤه بشكل متكرّر أو مستمر في مجال تعلُّم الآلة، يُعدّ المصطلحان ديناميكي وعلى الإنترنت مترادفين. في ما يلي الاستخدامات الشائعة للديناميكية والإنترنت في تعلّم الآلة:

- النموذج الديناميكي (أو النموذج المباشر) هو نموذج تتم إعادة تدريبه بشكل متكرر أو مستمر.

- التدريب الديناميكي (أو التدريب على الإنترنت) هو عملية التدريب بشكل متكرر أو مستمر.

- الاستدلال الديناميكي (أو الاستدلال المباشر) هو عملية إنشاء توقعات عند الطلب.

نموذج ديناميكي

نموذج يتم إعادة تدريبه بشكل متكرر (ربما بشكل مستمر). النموذج الديناميكي هو "متعلّم مدى الحياة" يتكيّف باستمرار مع البيانات المتطوّرة. يُعرف النموذج الديناميكي أيضًا باسم النموذج المباشر.

يختلف عن النموذج الثابت.

E

التنفيذ الفوري

بيئة برمجة في TensorFlow يتم فيها تنفيذ العمليات على الفور. في المقابل، لا يتم تنفيذ العمليات التي يتم استدعاؤها في تنفيذ الرسم البياني إلا بعد تقييمها بشكل صريح. التنفيذ الفوري هو واجهة إلزامية، تشبه إلى حد كبير الرموز البرمجية في معظم لغات البرمجة. وبشكل عام، يكون تصحيح أخطاء برامج التنفيذ الفوري أسهل بكثير من تصحيح أخطاء برامج التنفيذ البياني.

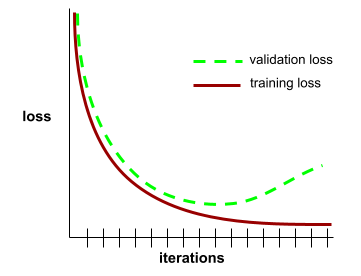

الإيقاف المبكر

إحدى طرق التسوية التي تتضمّن إنهاء التدريب قبل أن يتوقف معدّل انخفاض خسارة التدريب. في عملية الإيقاف المبكر، يتم إيقاف تدريب النموذج عمدًا عندما يبدأ معدل الخطأ في مجموعة بيانات التحقّق من الصحة في الارتفاع، أي عندما يتدهور أداء التعميم.

يختلف ذلك عن الخروج المبكر.

مسافة نقل التراب (EMD)

مقياس للتشابه النسبي بين توزيعَين كلّما كانت مسافة نقل التراب أقل، تشابهت التوزيعات أكثر.

مسافة التعديل

مقياس لمدى تشابه سلسلتَي نص مع بعضهما البعض. في التعلّم الآلي، تكون مسافة التعديل مفيدة للأسباب التالية:

- يسهل احتساب مسافة التعديل.

- يمكن أن تقارن مسافة التعديل بين سلسلتَين معروفتَين بأنّهما متشابهتَين.

- يمكن أن تحدّد مسافة التعديل درجة تشابه السلاسل المختلفة مع سلسلة معيّنة.

تتوفّر عدة تعريفات لمسافة التعديل، ويستخدم كل منها عمليات مختلفة على السلاسل. يمكنك الاطّلاع على مسافة Levenshtein للحصول على مثال.

ترميز آينشتاين

تمثّل هذه السلسلة طريقة فعّالة لوصف كيفية دمج موترَين. يتم دمج الموترات عن طريق ضرب عناصر أحد الموترات في عناصر الموتر الآخر ثم جمع النواتج. تستخدم صيغة Einsum رموزًا لتحديد محاور كل موتر، ويتم إعادة ترتيب هذه الرموز نفسها لتحديد شكل الموتر الناتج الجديد.

توفّر حزمة NumPy عملية تنفيذ شائعة للدالة Einsum.

طبقة التضمين

طبقة مخفية خاصة يتم تدريبها على سمة فئوية ذات أبعاد عالية من أجل التعلّم تدريجيًا لمتجه تضمين ذي أبعاد منخفضة. تتيح طبقة التضمين للشبكة العصبونية التدريب بكفاءة أكبر بكثير من التدريب على الميزة الفئوية العالية الأبعاد فقط.

على سبيل المثال، يتيح Earth حاليًا حوالي 73,000 نوع من الأشجار. لنفترض أنّ نوع الشجرة هو سمة في نموذجك، وبالتالي تتضمّن طبقة الإدخال في نموذجك متجهًا ذا ترميز ساخن بطول 73,000 عنصر.

على سبيل المثال، قد يتم تمثيل baobab على النحو التالي:

تكون مصفوفة تضم 73,000 عنصر طويلة جدًا. إذا لم تضِف طبقة تضمين إلى النموذج، سيستغرق التدريب وقتًا طويلاً جدًا بسبب ضرب 72,999 صفرًا. لنفترض أنّك اخترت أن تتكوّن طبقة التضمين من 12 سمة. وبالتالي، ستتعلّم طبقة التضمين تدريجيًا متجه تضمين جديدًا لكل نوع من أنواع الأشجار.

في حالات معيّنة، يكون التجزئة بديلاً معقولاً لطبقة التضمين.

يمكنك الاطّلاع على التضمينات في "دورة مكثّفة عن تعلّم الآلة" للحصول على مزيد من المعلومات.

مساحة التضمين

مساحة المتجهات ذات الأبعاد d التي يتم ربط الميزات من مساحة المتجهات ذات الأبعاد الأعلى بها. يتم تدريب مساحة التضمين على رصد البنية ذات الصلة بالتطبيق المقصود.

الضرب النقطي بين تضمينَين هو مقياس لتشابههما.

متّجه التضمين

بشكل عام، هي مصفوفة من الأرقام ذات الفاصلة العائمة مأخوذة من أي طبقة مخفية تصف المدخلات إلى تلك الطبقة المخفية. في كثير من الأحيان، يكون متّجه التضمين عبارة عن مصفوفة من الأرقام النقطية العائمة التي تم تدريبها في طبقة تضمين. على سبيل المثال، لنفترض أنّ طبقة التضمين يجب أن تتعرّف على متجه تضمين لكل نوع من أنواع الأشجار البالغ عددها 73,000 نوع على الأرض. ربما تكون المصفوفة التالية هي متّجه التضمين لشجرة باوباب:

متجه التضمين ليس مجموعة من الأرقام العشوائية. تحدّد طبقة التضمين هذه القيم من خلال التدريب، بطريقة مشابهة للطريقة التي تتعلّم بها الشبكة العصبية الأوزان الأخرى أثناء التدريب. كل عنصر من عناصر المصفوفة هو تقييم لبعض خصائص أنواع الأشجار. أي عنصر يمثّل سمة أي نوع من الأشجار؟ ويصعب على البشر تحديد ذلك.

الجزء المميّز رياضيًا في متّجه التضمين هو أنّ العناصر المتشابهة تتضمّن مجموعات متشابهة من الأرقام النقطية العائمة. على سبيل المثال، تتضمّن أنواع الأشجار المتشابهة مجموعة أرقام فاصلة عائمة أكثر تشابهًا من أنواع الأشجار غير المتشابهة. أشجار الخشب الأحمر وأشجار السكويا هي أنواع أشجار مرتبطة ببعضها، لذا سيكون لديها مجموعة أكثر تشابهًا من الأرقام ذات الفاصلة العائمة مقارنةً بأشجار الخشب الأحمر وأشجار جوز الهند. ستتغيّر الأرقام في متجه التضمين في كل مرة تعيد فيها تدريب النموذج، حتى إذا أعدت تدريبه باستخدام إدخال مطابق.

دالة التوزيع التراكمي التجريبية (eCDF أو EDF)

دالة التوزيع التراكمي استنادًا إلى القياسات التجريبية من مجموعة بيانات حقيقية قيمة الدالة عند أي نقطة على طول المحور س هي جزء الملاحظات في مجموعة البيانات التي تكون أقل من أو تساوي القيمة المحددة.

تقليص المخاطر التجريبية (ERM)

اختيار الدالة التي تقلّل الخسارة إلى الحدّ الأدنى في مجموعة التدريب يختلف ذلك عن تقليص المخاطر البنيوية.

برنامج تشفير

بشكل عام، أي نظام تعلّم آلي يحوّل البيانات من تمثيل أولي أو متفرّق أو خارجي إلى تمثيل أكثر معالجة أو كثافة أو داخلية.

غالبًا ما تكون أجهزة الترميز جزءًا من نموذج أكبر، حيث يتم دمجها بشكل متكرّر مع جهاز فك ترميز. تجمع بعض أدوات التحويل بين برامج الترميز وبرامج فك الترميز، بينما تستخدم أدوات التحويل الأخرى برنامج الترميز فقط أو برنامج فك الترميز فقط.

تستخدم بعض الأنظمة ناتج أداة الترميز كمدخل إلى شبكة تصنيف أو انحدار.

في مهام التسلسل إلى التسلسل، يأخذ برنامج الترميز تسلسلاً من الإدخالات ويعرض حالة داخلية (متجه). بعد ذلك، يستخدم برنامج الترميز هذه الحالة الداخلية للتنبؤ بالتسلسل التالي.

راجِع المحوّل للتعرّف على تعريف برنامج الترميز في بنية المحوّل.

لمزيد من المعلومات، يمكنك الاطّلاع على النماذج اللغوية الكبيرة: ما هو النموذج اللغوي الكبير؟ في "دورة مكثّفة عن تعلُّم الآلة".

نقاط النهاية

موقع جغرافي يمكن الوصول إليه عبر الشبكة (عادةً ما يكون عنوان URL) حيث يمكن الوصول إلى الخدمة.

مجموعة موحّدة

مجموعة من النماذج التي تم تدريبها بشكل مستقل ويتم حساب متوسط أو تجميع التوقعات التي تقدّمها. في كثير من الحالات، ينتج عن المجموعة توقعات أفضل من النموذج الفردي. على سبيل المثال، الغابة العشوائية هي مجموعة نماذج تم إنشاؤها من عدة أشجار قرارات. يُرجى العِلم أنّ بعض غابات القرارات ليست مجموعات.

لمزيد من المعلومات، يمكنك الاطّلاع على Random Forest في "دورة مكثّفة عن تعلّم الآلة".

الإنتروبيا

في نظرية المعلومات، القصور هو وصف لمدى عدم القدرة على التنبؤ بتوزيع الاحتمالات. ويمكن تعريف القصور أيضًا بأنه مقدار المعلومات التي يحتوي عليها كل مثال. يكون التوزيع ذا أعلى إنتروبيا ممكنة عندما تكون جميع قيم المتغيّر العشوائي متساوية الاحتمالية.

إنّ إنتروبيا مجموعة تتضمّن قيمتَين محتملتَين هما "0" و "1" (على سبيل المثال، التصنيفات في مسألة تصنيف ثنائي) تخضع للصيغة التالية:

H = -p log p - q log q = -p log p - (1-p) * log (1-p)

where:

- H هو القصور.

- p هي نسبة الأمثلة التي تكون فيها القيمة "1".

- q هي نسبة الأمثلة التي تكون فيها القيمة "0". يُرجى العِلم أنّ q = (1 - p)

- log هو بشكل عام log2. في هذه الحالة، وحدة الإنتروبيا هي بت.

على سبيل المثال، لنفترض ما يلي:

- تحتوي 100 عينة على القيمة "1"

- تحتوي 300 عينة على القيمة "0"

وبالتالي، تكون قيمة القصور كما يلي:

- p = 0.25

- q = 0.75

- H = (-0.25)log2(0.25) - (0.75)log2(0.75) = 0.81 بت لكل مثال

ستكون قيمة الإنتروبيا لمجموعة متوازنة تمامًا (على سبيل المثال، 200 من القيمة "0" و200 من القيمة "1") هي 1.0 بت لكل مثال. وكلما أصبحت المجموعة أكثر عدم توازن، اقترب القصور فيها من 0.0.

في أشجار القرارات، يساعد الانتروبيا في صياغة تحصيل المعلومات لمساعدة المقسّم في اختيار الشروط أثناء نمو شجرة قرارات التصنيف.

مقارنة الإنتروبيا بما يلي:

- مقياس جيني للتفاوت

- دالة الخسارة الإنتروبيا المتداخلة

يُطلق على القصور غالبًا اسم قصور شانون.

لمزيد من المعلومات، راجِع أداة التقسيم التام للتصنيف الثنائي باستخدام الميزات الرقمية في دورة "غابات القرارات".

بيئة

في التعلّم المعزّز، يشير مصطلح البيئة إلى العالم الذي يتضمّن الوكيل ويسمح له بمراقبة حالته. على سبيل المثال، يمكن أن يكون العالم الممثَّل لعبة مثل الشطرنج أو عالمًا ماديًا مثل المتاهة. عندما ينفّذ العميل إجراءً على البيئة، تنتقل البيئة بين الحالات.

حلقة

في التعلّم المعزّز، كل محاولة متكررة يقوم بها الوكيل لتعلّم بيئة.

حقبة

هي عملية تدريب كاملة على مجموعة التدريب بحيث تتم معالجة كل مثال مرة واحدة.

يمثّل العصر N/حجم الدفعة

تكرارات التدريب، حيث يمثّل N

إجمالي عدد الأمثلة.

على سبيل المثال، لنفترض ما يلي:

- تتألف مجموعة البيانات من 1,000 مثال.

- يبلغ حجم الدفعة 50 مثالاً.

لذلك، تتطلّب الحقبة الواحدة 20 تكرارًا:

1 epoch = (N/batch size) = (1,000 / 50) = 20 iterations

يمكنك الاطّلاع على الانحدار الخطي: المَعلمات الفائقة في "دورة مكثّفة حول تعلُّم الآلة" للحصول على مزيد من المعلومات.

سياسة إبسيلون الجشعة

في التعلّم المعزّز، السياسة التي تتّبع إما سياسة عشوائية باحتمالية إبسيلون أو سياسة جشعة في الحالات الأخرى. على سبيل المثال، إذا كانت قيمة إبسيلون 0.9، ستتّبع السياسة سياسة عشوائية بنسبة% 90 من الوقت وسياسة جشعة بنسبة% 10 من الوقت.

على مدار حلقات متتالية، تقلّل الخوارزمية قيمة إبسيلون من أجل الانتقال من اتّباع سياسة عشوائية إلى اتّباع سياسة جشعة. من خلال تغيير السياسة، يستكشف الوكيل البيئة أولاً بشكل عشوائي ثم يستغل نتائج الاستكشاف العشوائي بشكل نهم.

تكافؤ الفرص

مقياس الإنصاف لتقييم ما إذا كان النموذج يتوقّع النتيجة المطلوبة بشكل جيد وبالمقدار نفسه لجميع قيم السمة الحسّاسة. بعبارة أخرى، إذا كانت النتيجة المرغوبة لنموذج هي الفئة الموجبة، سيكون الهدف هو أن يكون معدّل الإيجابية الحقيقية هو نفسه لجميع المجموعات.

يرتبط تكافؤ الفرص بتكافؤ الاحتمالات، الذي يتطلّب أن يكون كلّ من معدلات الموجب الصائب ومعدلات الموجب الخاطئ متطابقًا لجميع المجموعات.

لنفترض أنّ جامعة Glubbdubdrib تقبل طلابًا من Lilliput وBrobdingnag في برنامج رياضيات صارم. تقدّم المدارس الثانوية في ليليبوت منهجًا دراسيًا قويًا في الرياضيات، ومعظم الطلاب مؤهّلون للالتحاق بالبرنامج الجامعي. لا تقدّم المدارس الثانوية في بروبدينغناغ دروسًا في الرياضيات على الإطلاق، ونتيجةً لذلك، يكون عدد الطلاب المؤهّلين أقل بكثير. تتحقّق المساواة في الفرص بالنسبة إلى التصنيف المفضّل "مقبول" فيما يتعلّق بالجنسية (ليليبوتية أو بروبدينغناغية) إذا كان الطلاب المؤهّلون متساوون في فرص القبول بغض النظر عمّا إذا كانوا ليليبوتايين أو بروبدينغناغيين.

على سبيل المثال، لنفترض أنّ 100 شخص من ليليبوت و100 شخص من بروبدينغناغ يقدّمون طلبات التحاق بجامعة غلوبدبدريب، ويتم اتخاذ قرارات القبول على النحو التالي:

الجدول 1. مقدّمو الطلبات من ليليبوت (90% منهم مؤهّلون)

| مؤهَّل | غير معرَّف | |

|---|---|---|

| تم قبول الطلب | 45 | 3 |

| تم الرفض | 45 | 7 |

| المجموع | 90 | 10 |

|

النسبة المئوية للطلاب المؤهّلين المقبولين: 45/90 =%50 النسبة المئوية للطلاب غير المؤهّلين المرفوضين: 7/10 =%70 النسبة المئوية الإجمالية للطلاب المقبولين من ليليبوت: (45+3)/100 = %48 |

||

الجدول 2. مقدّمو الطلبات من Brobdingnagian (10% مؤهَّلون):

| مؤهَّل | غير معرَّف | |

|---|---|---|

| تم قبول الطلب | 5 | 9 |

| تم الرفض | 5 | 81 |

| المجموع | 10 | 90 |

|

نسبة الطلاب المؤهّلين المقبولين: 5/10 =%50 نسبة الطلاب غير المؤهّلين المرفوضين: 81/90 =%90 النسبة الإجمالية للطلاب المقبولين من Brobdingnagian: (5+9)/100 = %14 |

||

تستوفي الأمثلة السابقة شرط تكافؤ الفرص لقبول الطلاب المؤهّلين، لأنّ كلّاً من سكان ليليبوت وبروبدينغناغ المؤهّلين لديهم فرصة بنسبة% 50 للقبول.

على الرغم من استيفاء شرط تكافؤ الفرص، لا يتم استيفاء مقياسَي العدالة التاليَين:

- التكافؤ الديمغرافي: يتم قبول سكان ليليبوت وبروبدينغناغ في الجامعة بمعدلات مختلفة، إذ يتم قبول% 48 من الطلاب من ليليبوت، ولكن يتم قبول% 14 فقط من الطلاب من بروبدينغناغ.

- تكافؤ الفرص: على الرغم من أنّ الطلاب المؤهَّلين من ليليبوت وبروبدينغناغ لديهم فرصة متساوية للقبول، لا يتم استيفاء الشرط الإضافي الذي ينص على أنّ الطلاب غير المؤهَّلين من ليليبوت وبروبدينغناغ لديهم فرصة متساوية للرفض. تبلغ نسبة الرفض لدى Lilliputians غير المؤهّلين% 70، بينما تبلغ نسبة الرفض لدى Brobdingnagians غير المؤهّلين% 90.

يمكنك الاطّلاع على الإنصاف: تكافؤ الفرص في "دورة مكثّفة عن تعلّم الآلة" للحصول على مزيد من المعلومات.

المعدّلات المتساوية

مقياس عدالة لتقييم ما إذا كان النموذج يتنبأ بالنتائج بشكل جيد وبالمثل لجميع قيم السمة الحسّاسة فيما يتعلق بكل من الفئة الموجبة والفئة السالبة، وليس فئة واحدة أو الأخرى حصريًا. بعبارة أخرى، يجب أن يكون كل من معدّل الموجب الصائب ومعدّل السالب الخاطئ متساويَين بالنسبة إلى جميع المجموعات.

تتعلّق تكافؤ الفرص بالمساواة في الفرص، التي تركّز فقط على معدّلات الخطأ لفئة واحدة (موجبة أو سالبة).

على سبيل المثال، لنفترض أنّ جامعة Glubbdubdrib تقبل الطلاب من Lilliput وBrobdingnag في برنامج رياضيات صارم. تقدّم المدارس الثانوية في ليليبوت منهجًا دراسيًا قويًا في الرياضيات، ومعظم الطلاب مؤهّلون للالتحاق بالبرنامج الجامعي. لا تقدّم المدارس الثانوية في بروبدينغناغ دروسًا في الرياضيات على الإطلاق، ونتيجةً لذلك، يكون عدد الطلاب المؤهّلين أقل بكثير. يتم استيفاء شرط تكافؤ الفرص إذا كان احتمال قبول المتقدّمين المؤهّلين في البرنامج متساويًا بغض النظر عن حجمهم، وإذا كان احتمال رفض المتقدّمين غير المؤهّلين متساويًا بغض النظر عن حجمهم.

لنفترض أنّ 100 شخص من ليليبوت و100 شخص من بروبدينغناغ يقدّمون طلبات إلى جامعة غلوبدوبدريب، ويتم اتخاذ قرارات القبول على النحو التالي:

الجدول 3. مقدّمو الطلبات من ليليبوت (90% منهم مؤهّلون)

| مؤهَّل | غير معرَّف | |

|---|---|---|

| تم قبول الطلب | 45 | 2 |

| تم الرفض | 45 | 8 |

| المجموع | 90 | 10 |

|

نسبة الطلاب المؤهّلين المقبولين: 45/90 =%50 نسبة الطلاب غير المؤهّلين المرفوضين: 8/10 =%80 النسبة الإجمالية للطلاب المقبولين من Lilliputian: (45+2)/100 = %47 |

||

الجدول 4. مقدّمو الطلبات من Brobdingnagian (10% مؤهَّلون):

| مؤهَّل | غير معرَّف | |

|---|---|---|

| تم قبول الطلب | 5 | 18 |

| تم الرفض | 5 | 72 |