Los mensajes multimodales son un tipo de instrucciones para modelos grandes de lenguaje (LLM) que combinan varios formatos de tipo de entrada. Cuando hablamos de formatos, nos referimos a entradas como texto o imágenes. Los mensajes multimodales y los LLM que los admiten permiten una variedad de casos de uso interesantes, como clasificación de imágenes, reconocimiento de escritura a mano, traducción y otras situaciones creativas.

En este documento, nos enfocaremos en los tipos de instrucciones que se pueden lograr cuando se ingresa imagen y texto en el modelo de Gemini y se recibe una respuesta de solo texto a través de 8 ejemplos interesantes.

¿Qué es una instrucción multimodal?

Actualmente, Gemini ahora puede recibir solicitudes con una combinación de entrada de texto o imagen y mostrar una respuesta de solo texto. El texto se puede usar para proporcionar contexto a la imagen o con el fin de solicitar que el modelo opere o genere una respuesta sobre la imagen.

Por ejemplo, la siguiente es una instrucción multimodal:

“¿De qué color es el gato?”

El texto de esta instrucción proporciona contexto para la imagen, ya que aclara que hay un gato en la imagen y que nos interesa principalmente el gato y su color.

3 instrucciones multimodales simples

Los siguientes son tres ejemplos muy sencillos de cómo proporcionar una imagen junto con texto a un LLM y aceptar una respuesta de solo texto. Exploraremos los conceptos para reconocer un tipo de entidad en una imagen, clasificar las entidades en una imagen sin conocimientos predeterminados y, por último, veremos un ejemplo de cómo combinar el reconocimiento con el cálculo.

Clasificación

"¿Esta imagen contiene un gato? Responde con verdadero o falso".

Respuesta de Gemini:

True

Este es un ejemplo muy simple que destaca la capacidad del LLM de reconocer la existencia de algo en una imagen o no y de responder al desarrollador de manera booleana. Este enfoque puede ser útil en la detección de contenido específico con el filtrado o con otros fines.

Vale la pena señalar que los modelos de reconocimiento de imágenes dedicados pueden ser potencialmente más eficaces en tareas muy específicas. Sin embargo, crear modelos de AA personalizados requiere tiempo y experiencia. Las soluciones que usan Gemini se pueden compilar más rápido. Por lo tanto, es importante comparar la calidad de las respuestas disponibles entre diferentes modelos y decidir en función de estas compensaciones.

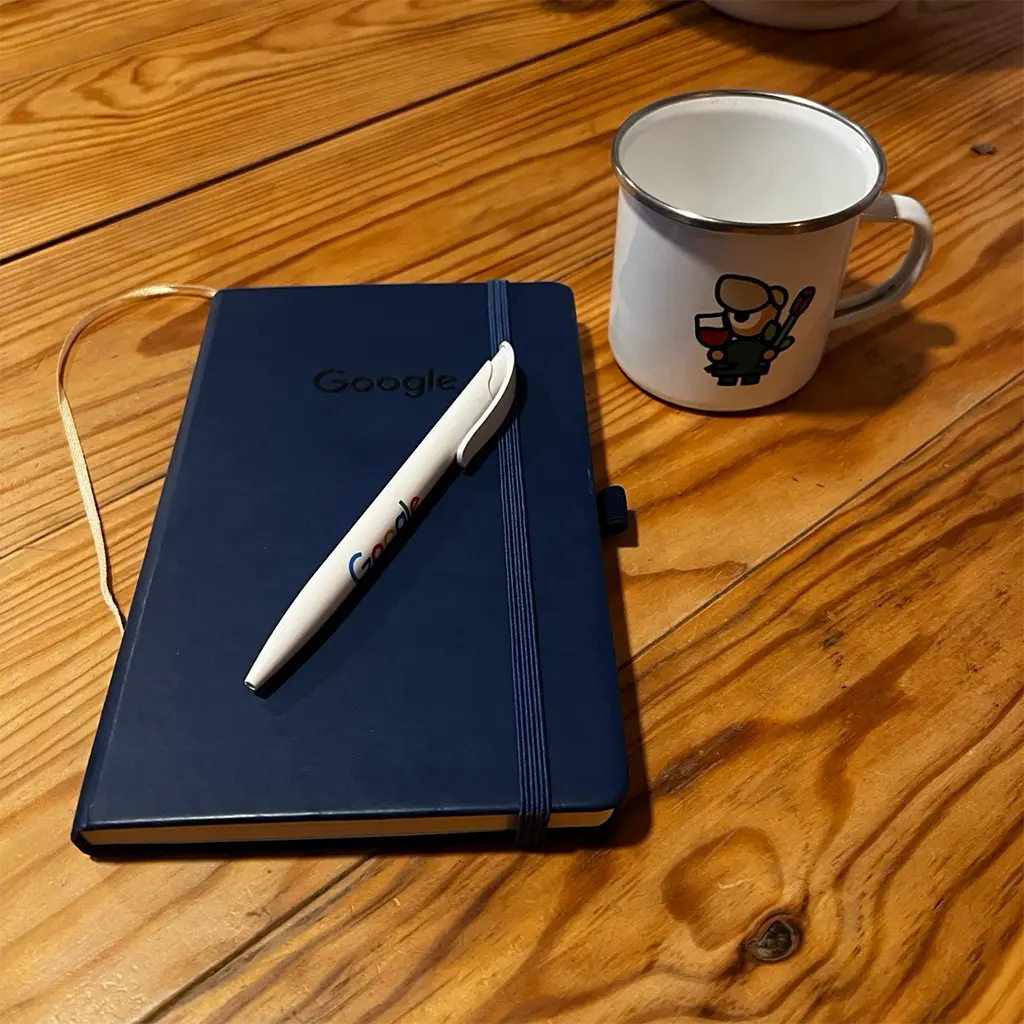

Reconocimiento

“Dame una lista de todos los aspectos importantes de esta foto”.

Respuesta de Gemini:

- Un notebook de Google

- Una pluma de Google

- Una taza

En el ejemplo anterior, se destaca el hecho de que podemos solicitar una pregunta abierta al LLM sobre el contenido que aparece en la imagen. Con Gemini, el proceso de clasificación de imágenes no requiere modelos diferentes para distintos tipos de objetos (es decir, libros o tazas). En cambio, con un solo modelo, identificamos todos los elementos significativos en un solo pase.

Recuento

"Cuenta la cantidad de gatos en esta imagen. Dame solo el número final en la respuesta.

Solo dime un número".

Respuesta de Gemini:

3

En este ejemplo, contenemos la solicitud a solo un tipo de objeto particular y especificamos que queremos que se cuente en la foto. Además, solicitamos que la respuesta se incluya en una respuesta numérica pura en la instrucción. Sin embargo, la calidad puede variar según la cantidad de objetos en la imagen que se deban contar. Como Gemini es un modelo multimodal de uso general, su precisión más allá de los números pequeños puede ser limitada.

5 instrucciones multimodales avanzadas

A continuación, revisaremos algunos ejemplos interesantes de formas más avanzadas en las que se pueden utilizar las instrucciones multimodales con entrada de texto y de imagen.

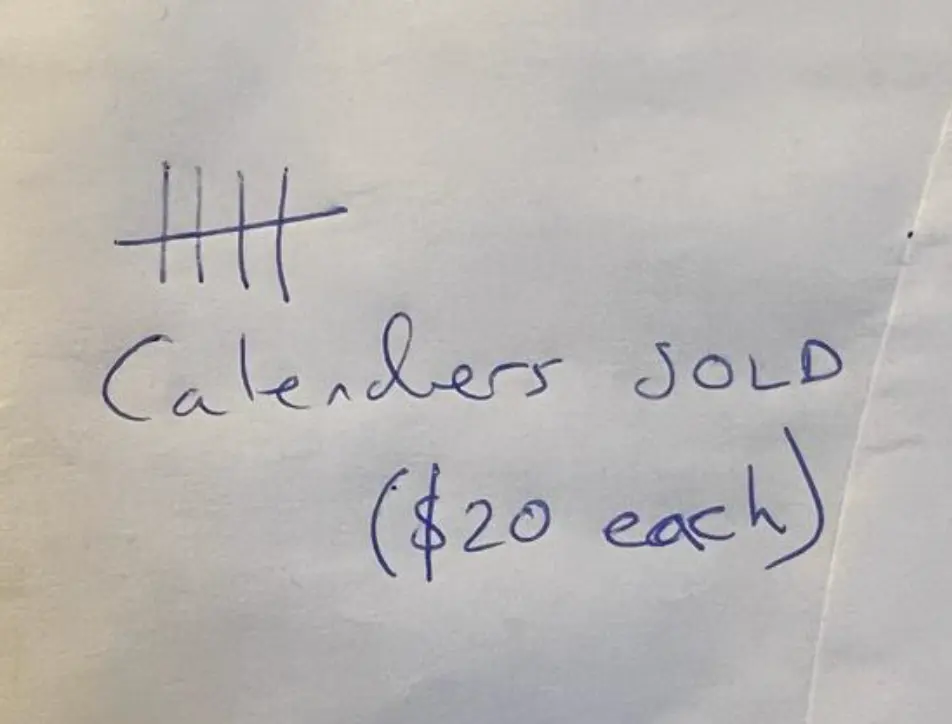

Reconocimiento, razonamiento y cálculo de texto

"¿Cuánto dinero ganamos en total hoy? Explica tu razonamiento".

Respuesta de Gemini:

El importe total de dinero que se gana hoy es de USD 100.

Esto se debe a que la nota indica que se vendieron 5 calendarios a USD 20 cada uno. 5 x USD 20 = USD 100.

Esta imagen y mensaje más avanzados muestran varias funciones de Gemini a la vez. El primero es el reconocimiento de escritura a mano. La IA reconoció que el texto escrito en inglés hacía referencia a cuántos calendarios se vendieron y a qué precio se vendió cada uno. Además, con nuestra indicación que indica el concepto de aumentar los números, la IA reconoció la notación para un recuento de 5 puntos (es decir, 4 líneas verticales y un solo tachado horizontal). Por último, con nuestra instrucción que guía a la IA en los pasos del cálculo podemos recibir una explicación de cómo la IA calculó los ingresos.

Contexto mundial y razonamiento

"¿Qué hora del día se muestra en esta imagen dentro de 24 horas?".

Respuesta de Gemini:

19:30

En este ejemplo, se destaca la capacidad del modelo para reconocer la iluminación de una escena e inferir información temporal de las imágenes en un período determinado.

Interpretación y creatividad

"Escribe un haiku sobre esta foto".

Respuesta de Gemini:

Un banco junto al lago,

Una vista de las montañas más allá,

Un momento de paz.

Aquí vemos el poder de Gemini para narrar historias y formas más creativas de usar la IA generativa. Si proporcionas una imagen como punto de partida, podemos sorprendernos con el punto en el que la IA toma la historia o con qué características de la imagen decide integrarla en particular con la historia. Las instrucciones de texto puro para la generación de historias a menudo se limitan a nuestra propia idea inicial, pero una foto del mundo real puede servir como un potente punto de partida para el proceso de pensamiento de la IA.

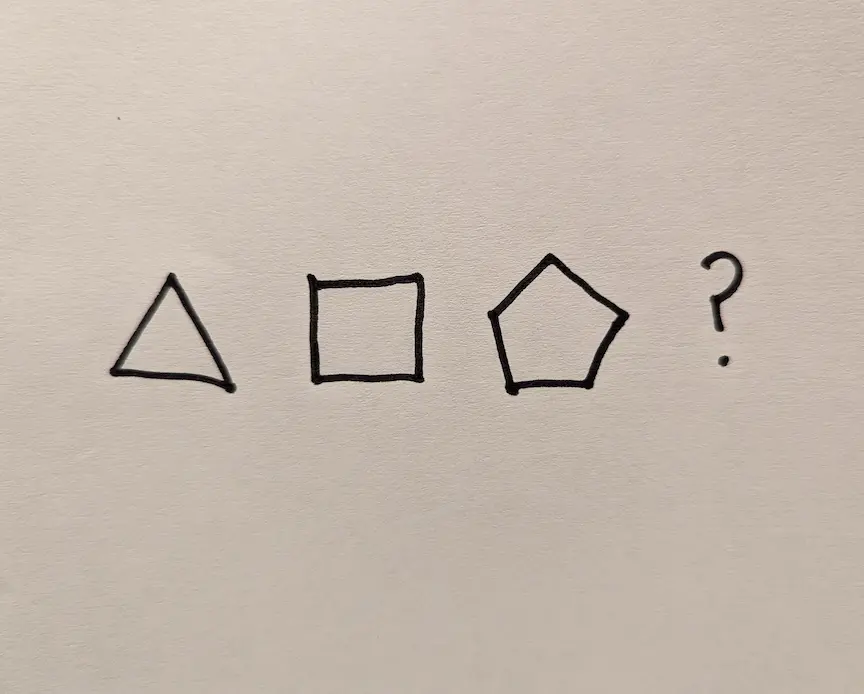

Progresión lógica

"¿Qué sigue? Explica tu razonamiento".

Respuesta de Gemini:

El triángulo tiene 3 lados, el cuadrado tiene 4 lados y el pentágono tiene 5 lados. El número de lados aumenta en 1 para cada forma. Por lo tanto, la siguiente forma debería tener 6 lados, que es un hexágono.

Este ejemplo combina una vez más varias habilidades de Gemini. No solo reconoce las formas, sino que también entiende que, si bien las formas son levemente dibujadas, están destinadas a ser formas distintas vinculadas matemáticamente con atributos específicos (p.ej., 3 lados, 4 lados, 5 lados).

Además, la presencia del signo de interrogación no confunde a Gémini en su interpretación de la progresión lógica de las formas geométricas. En cambio, Gemini "ve" que esta es una progresión matemática de 3, 4 a 5 y que, por lo tanto, la última forma tendría 6 lados y propone un hexágono.

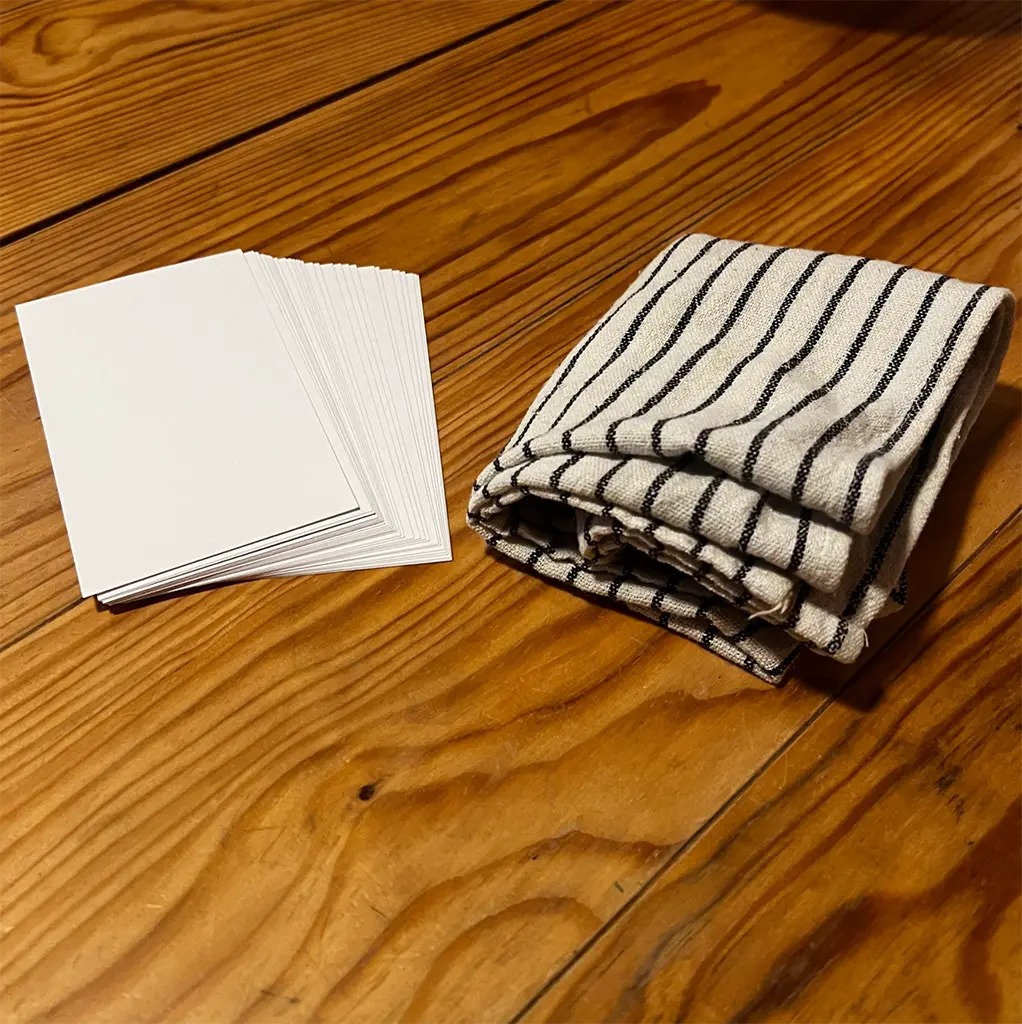

Interpretación y comprensión mundiales

¿En cuál de las siguientes opciones sería mejor escribir? ¿Cuál sería mejor para hacer una bufanda?

Respuesta de Gemini:

Sería mejor para escribir en el papel porque es una superficie lisa y la tinta no se filtra. La tela sería mejor para hacer una bufanda, porque es suave y te mantiene abrigado.

Aquí utilizamos Gemini de una manera muy creativa. La IA no solo entiende las imágenes, sino que también infiere los atributos y la física del mundo real a partir de lo que ve. El razonamiento se basa en la comprensión visual de los materiales de los objetos y en cómo interactúan con los propósitos descritos en la instrucción.

Conclusión

Estos son solo algunos ejemplos de las formas en que se pueden usar los mensajes multimodales. Con los LLM, puedes usar instrucciones multimodales no solo para comprender imágenes y texto, sino también para formar nuevas ideas o extraer información de ellas. Te recomendamos que experimentes con diferentes tipos de mensajes multimodales y veas lo que puedes crear.