Les requêtes multimodales sont un type de requêtes destinées aux grands modèles de langage (LLM) qui combinent plusieurs formats de types d'entrée. Les formats font référence à des entrées telles que du texte ou des images. Les requêtes multimodales et les LLM compatibles offrent divers cas d'utilisation intéressants, tels que la classification d'images, la reconnaissance de l'écriture manuscrite, la traduction et d'autres scénarios créatifs.

Dans ce document, nous allons nous concentrer sur les types de requêtes qui peuvent être réalisées lors de la saisie de texte et d'images dans le modèle Gemini, et de la réception d'une réponse textuelle uniquement. Pour cela, nous allons étudier huit exemples intéressants.

Qu'est-ce qu'une requête multimodale ?

Aujourd'hui, Gemini peut désormais être invité avec une combinaison d'entrées de texte et/ou d'image et renvoyer une réponse textuelle uniquement. Le texte peut être utilisé pour fournir du contexte à l'image, ou pour demander au modèle de fonctionner ou de générer une réponse à propos de l'image.

Par exemple, voici une requête multimodale:

"De quelle couleur est le chat ?"

Le texte de cette requête fournit du contexte à l'image en précisant qu'il y a un chat dans l'image et que nous ne nous intéressons surtout qu'au chat et à sa couleur.

3 invites multimodales simples

Voici trois exemples très simples qui montrent comment fournir une image avec du texte à un LLM et accepter une réponse en texte seul. Nous explorerons les concepts de reconnaissance d'un type d'entité dans une image, la classification d'entités dans une image sans connaissances prédéterminées, et enfin un exemple combinant la reconnaissance et le calcul.

Classification

"Cette image contient-elle un chat ? Répondez par "true" ou "false".

Réponse de Gemini:

True

Cet exemple très simple met en évidence la capacité du LLM à reconnaître ou non l'existence d'un élément dans une image, et à répondre au développeur de manière booléenne. Cette approche peut être utile pour détecter un contenu spécifique à des fins de filtrage ou à d'autres fins.

Il convient de noter que les modèles de reconnaissance d'image dédiés peuvent être potentiellement plus efficaces pour des tâches très spécifiques. Cependant, la création de modèles de ML personnalisés demande du temps et de l'expertise. Les solutions qui utilisent Gemini peuvent être créées plus rapidement. Par conséquent, il est important de comparer la qualité des réponses disponibles entre différents modèles et de décider en fonction de ces compromis.

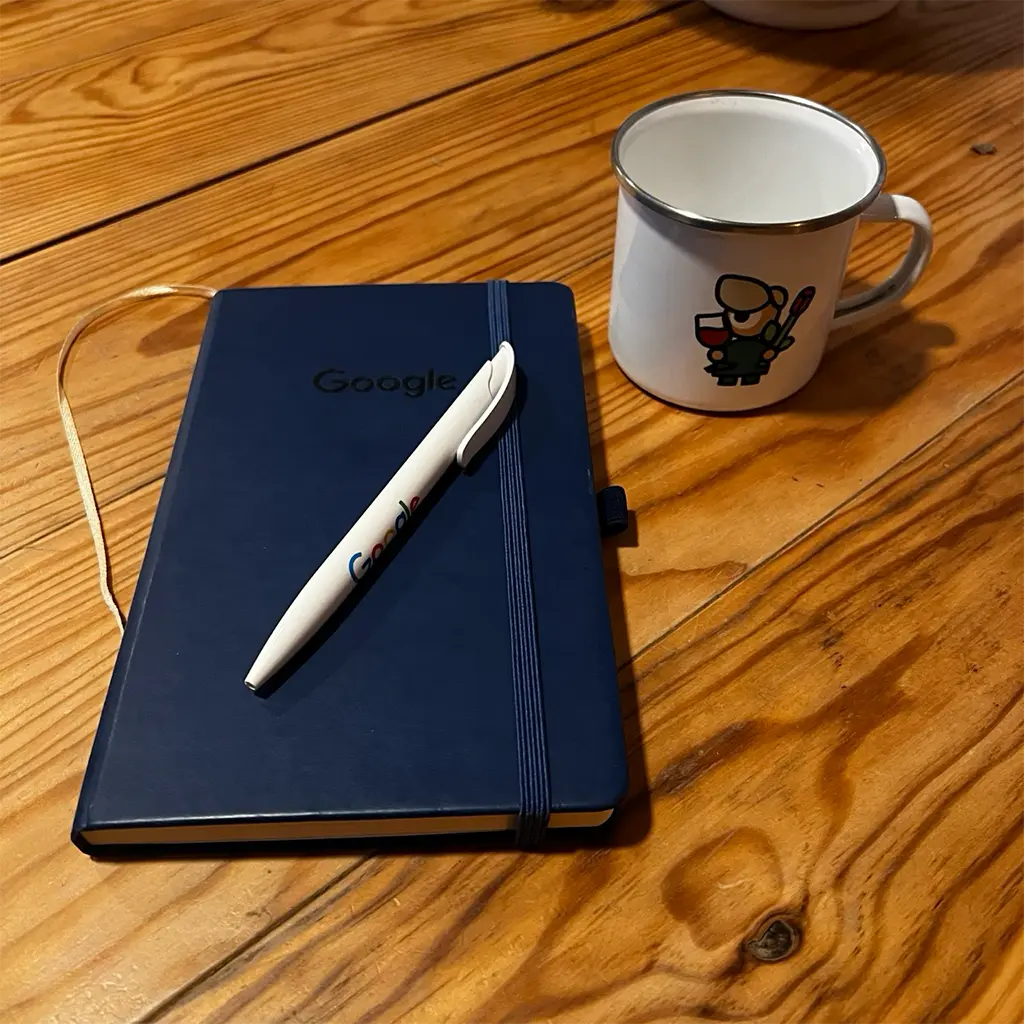

Reconnaissance

"Donne-moi la liste des éléments importants de cette photo."

Réponse de Gemini:

- Un bloc-notes Google

- Un stylo Google

- Une tasse

L'exemple ci-dessus met en évidence le fait que nous pouvons demander une question ouverte au LLM concernant le contenu qui apparaît dans l'image. Avec Gemini, le processus de classification d'images ne nécessite pas différents modèles pour les différents types d'objets (par exemple, livres ou mugs). Au lieu de cela, à l'aide d'un seul modèle, nous avons identifié tous les éléments importants d'une même étape.

Comptage

"Comptez le nombre de chats sur cette photo. Donnez-moi uniquement le

chiffre final dans la réponse.

Ne me donnez qu'un numéro"

Réponse de Gemini:

3

Dans cet exemple, nous ne contiendrons la requête qu'à un objet de type particulier et spécifions que nous voulons qu'elle soit comptabilisée dans l'image. De plus, nous avons demandé que la réponse soit limitée à une réponse numérique pures dans la requête. Toutefois, la qualité peut varier en fonction du nombre d'objets de l'image à comptabiliser. Gemini étant un modèle multimodal à usage général, sa précision au-delà des petits nombres peut être limitée.

5 invites multimodales avancées

Nous allons maintenant passer en revue quelques exemples intéressants de moyens plus avancés d'utiliser les requêtes multimodales avec saisie de texte et d'image.

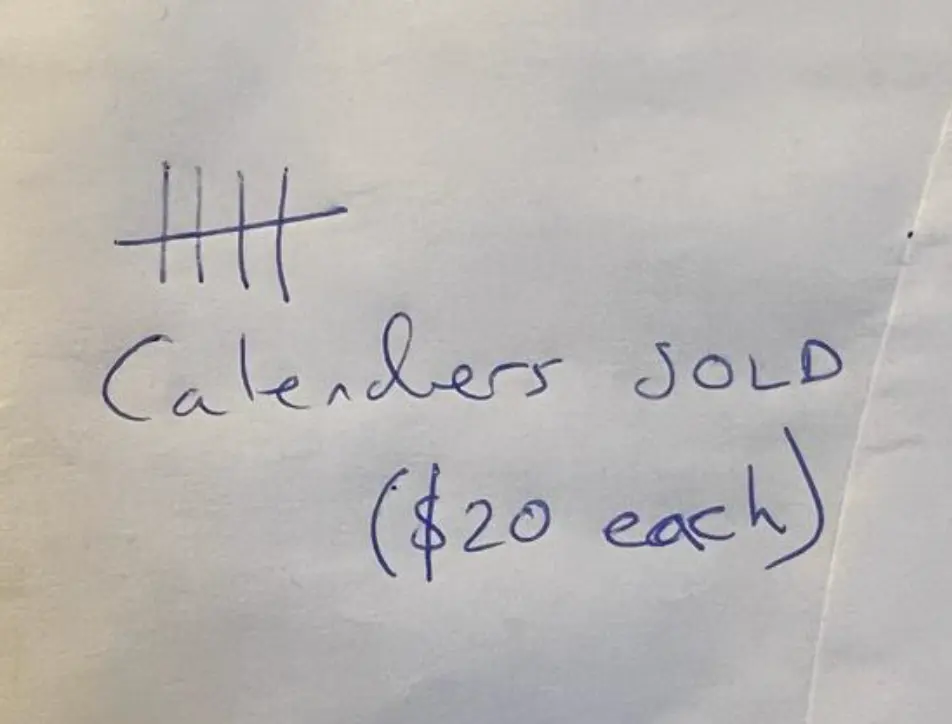

Reconnaissance, raisonnement et calcul de texte

"Combien d'argent avons-nous gagnés aujourd'hui ? Expliquez votre raisonnement."

Réponse de Gemini:

Le montant total des revenus d’aujourd’hui s’élève à 100 €.

En effet, la note indique que cinq calendriers ont été vendus à 20 $chacun. 5 x 20 $= 100 $.

Cette requête et cette image plus avancées illustrent simultanément plusieurs fonctionnalités de Gemini. Premièrement, la reconnaissance de l'écriture manuscrite. L'IA a reconnu que le texte écrit en anglais faisait référence au nombre de calendriers vendus et au prix de vente de chacun d'eux. De plus, notre requête indiquant le concept de comptage des nombres, l'IA a reconnu la notation pour un décompte à 5 points (c'est-à-dire quatre lignes verticales et un seul barré horizontal). Enfin, nous guidons l'IA dans les étapes de calcul pour découvrir comment l'IA a calculé les revenus.

Contexte mondial et raisonnement

"À quelle heure de la journée se trouve-t-il sur cette image au format 24 heures ?"

Réponse de Gemini:

19:30

Cet exemple met en évidence la capacité du modèle à reconnaître la luminosité d'une scène et à déduire les informations temporelles des images au cours d'une période donnée.

Interprétation et créativité

"Écris un haïku à propos de cette photo."

Réponse de Gemini:

Un banc au bord du lac,

Une vue sur les montagnes au loin,

Un moment de paix.

Nous voyons ici toute la puissance de Gemini pour la narration et des façons plus créatives d'utiliser l'IA générative. En fournissant une image comme point de départ, nous pouvons nous surprendre en découvrant où l'IA prend l'intrigue ou quelles caractéristiques de l'image l'IA décide d'intégrer en particulier à l'histoire. Les requêtes en texte pur pour générer des histoires sont souvent limitées à notre idée initiale, mais une photo du monde réel peut servir de point de départ puissant pour le processus de réflexion de l'IA.

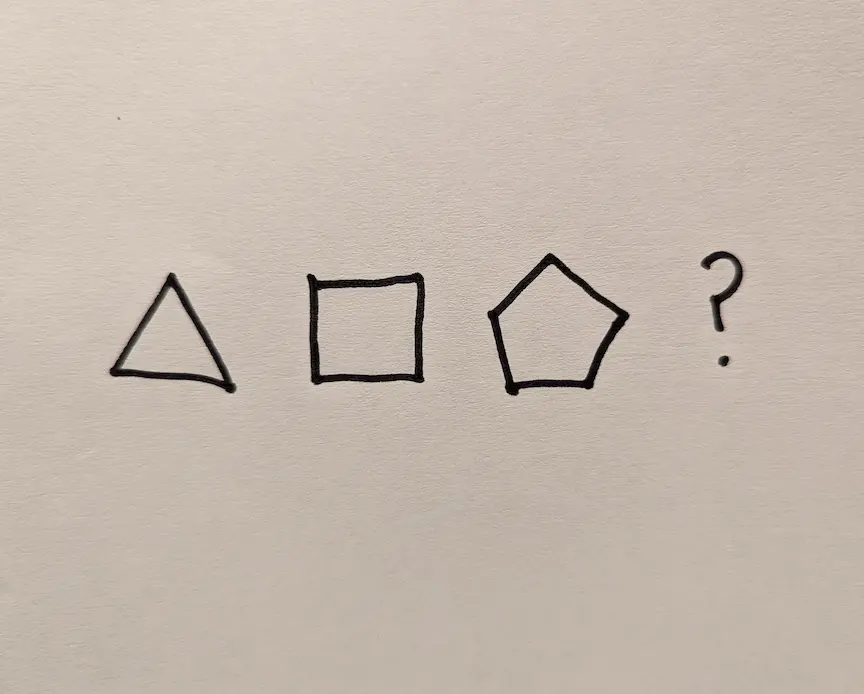

Progression logique

"Que se passe-t-il ensuite ? Expliquez votre raisonnement"

Réponse de Gemini:

Le triangle a trois côtés, le carré quatre côtés et le pentagone cinq côtés. Le nombre de côtés augmente de 1 pour chaque forme. Par conséquent, la forme suivante doit avoir six côtés, ce qui correspond à un hexagone.

Là encore, cet exemple combine plusieurs compétences de Gemini. Non seulement il reconnaît les formes, mais il comprend que celles-ci, bien que légèrement dessinées, sont destinées à être des formes mathématiquement liées et distinctes avec des attributs spécifiques (par exemple, 3 côtés, 4 côtés, 5 côtés).

De plus, la présence du point d'interrogation ne perturbe pas Gemini dans son interprétation de la progression logique des formes géométriques. Au lieu de cela, Gemini « voit » qu'il s'agit d'une progression mathématique de 3, 4 à 5 et que, par conséquent, la dernière forme serait à 6 faces et propose donc un hexagone.

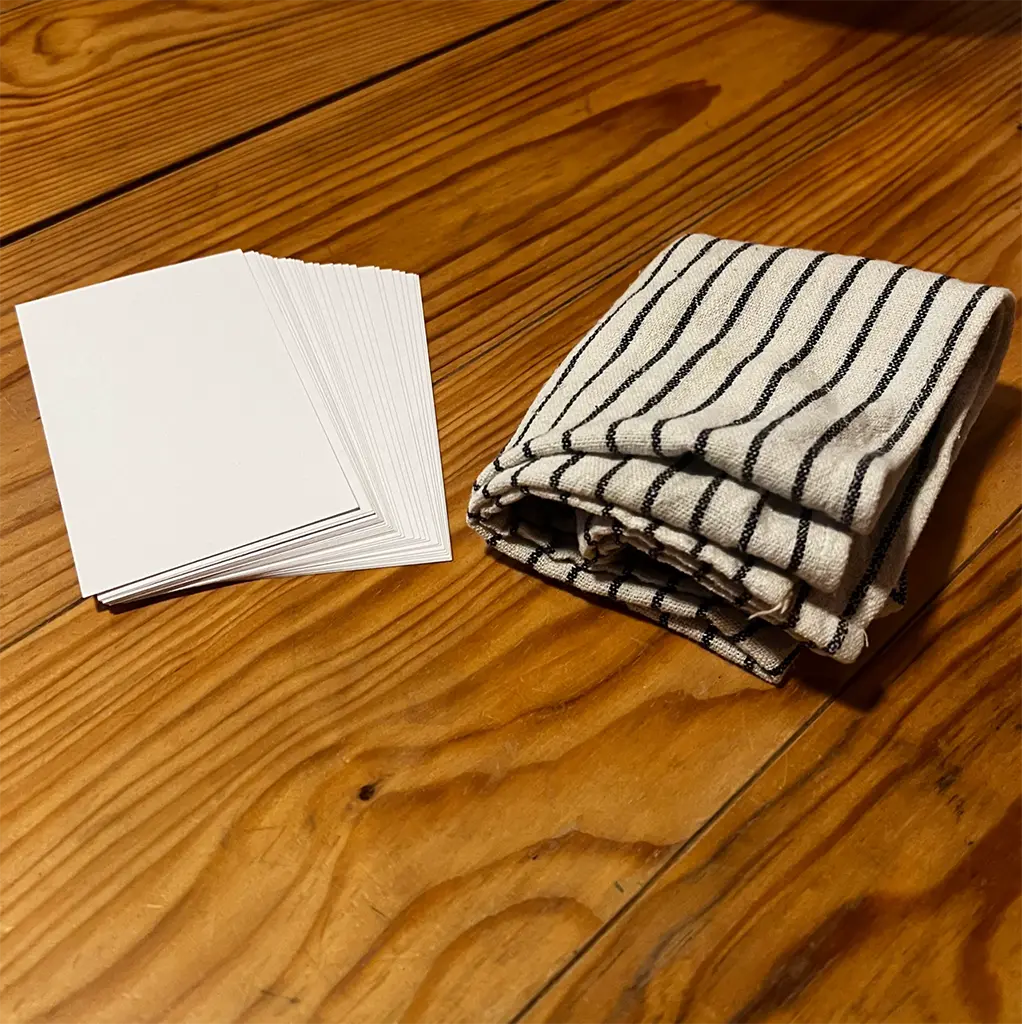

Interprétation et compréhension du monde

Quel serait le meilleur moyen d'écrire ? Laquelle de ces écharpes conviendrait mieux ?

Réponse de Gemini:

Le papier est plus adapté à l'écriture, car il s'agit d'une surface lisse et l'encre ne perdent pas. Le tissu est plus adapté à une écharpe, car il est doux et vous tiendra au chaud.

Ici, nous utilisons Gemini d'une manière très inventive. Non seulement l'IA comprend les images, mais elle en déduit aussi les attributs et la physique réelle à partir de ce qu'elle voit. Le raisonnement est basé sur la compréhension visuelle des matériaux des objets et de la manière dont ils interagissent avec les objectifs décrits dans la requête.

Conclusion

Ce ne sont là que quelques exemples d'utilisation des requêtes multimodales. Avec les LLM, vous pouvez utiliser des requêtes multimodales non seulement pour comprendre du texte et des images, mais aussi pour formuler de nouvelles idées ou en extraire des éléments de compréhension. Nous vous encourageons à tester différents types de requêtes multimodales et à voir ce que vous pouvez créer.