تحتوي هذه الصفحة على مصطلحات مسرد الذكاء الاصطناعي التوليدي. للاطّلاع على جميع مصطلحات المسرد، يُرجى النقر هنا.

A

التكيّف

مرادف لعملية الضبط أو الضبط الدقيق

وكيل

برنامج يمكنه تحليل مدخلات المستخدم المتعددة الوسائط من أجل التخطيط وتنفيذ الإجراءات نيابةً عن المستخدم.

في التعلّم التعزيزي، الوكيل هو الكيان الذي يستخدم سياسة لتحقيق أقصى عائد متوقّع من الانتقال بين الحالات الخاصة بالبيئة.

يستند إلى الذكاء الاصطناعي الوكيل

تمثّل هذه السمة صيغة الصفة من الوكيل. تشير كلمة "وكيل" إلى الصفات التي يتمتّع بها الوكلاء (مثل الاستقلالية).

سير العمل المستند إلى الوكيل

هي عملية ديناميكية يخطّط فيها الوكيل وينفّذ الإجراءات بشكل مستقل لتحقيق هدف. قد تتضمّن العملية الاستدلال واستخدام أدوات خارجية وتصحيح الخطة ذاتيًا.

AI slop

محتوى من إنشاء نظام ذكاء اصطناعي توليدي يركّز على الكمية أكثر من الجودة على سبيل المثال، تكون صفحة الويب التي تتضمّن محتوًى سطحيًا من إنشاء الذكاء الاصطناعي مليئة بمحتوى منخفض الجودة من إنشاء الذكاء الاصطناعي وبكلفة منخفضة.

التقييم التلقائي

استخدام برامج للحكم على جودة نتائج النموذج

عندما يكون ناتج النموذج بسيطًا نسبيًا، يمكن لنص برمجي أو برنامج مقارنة ناتج النموذج بالردّ المثالي. يُطلق على هذا النوع من التقييم التلقائي أحيانًا اسم التقييم الآلي. غالبًا ما تكون مقاييس مثل ROUGE أو BLEU مفيدة للتقييم الآلي.

عندما تكون نتائج النموذج معقّدة أو لا تتضمّن إجابة صحيحة واحدة، يتم أحيانًا إجراء التقييم التلقائي من خلال برنامج منفصل للتعلم الآلي يُعرف باسم المقيّم التلقائي.

يختلف ذلك عن التقييم من جانب المستخدمين.

تقييم Autorater

آلية مختلطة لتقييم جودة نتائج نموذج الذكاء الاصطناعي التوليدي تجمع بين التقييم البشري والتقييم الآلي أداة التقييم التلقائي هي نموذج لتعلُّم الآلة تم تدريبه على بيانات تم إنشاؤها من خلال التقييم البشري. من الناحية المثالية، يتعلّم نظام التقييم الآلي محاكاة أداء المقيِّم البشري.تتوفّر أدوات تقييم تلقائي جاهزة، ولكن أفضلها هي تلك التي تم تحسينها وتخصيصها للمهمة التي تريد تقييمها.

نموذج الانحدار التلقائي

نموذج يستنتج توقّعًا استنادًا إلى توقّعاته السابقة. على سبيل المثال، تتوقّع نماذج اللغة ذات الانحدار الذاتي الرمز المميز التالي استنادًا إلى الرموز المميزة التي تم توقّعها سابقًا. جميع النماذج اللغوية الكبيرة المستندة إلى بنية Transformer هي نماذج ذات انحدار تلقائي.

في المقابل، لا تكون نماذج الصور المستندة إلى الشبكات العدائية التوليدية (GAN) عادةً ذات انحدار تلقائي لأنّها تنشئ صورة في تمريرة واحدة للأمام وليس بشكل متكرّر على خطوات. ومع ذلك، فإنّ بعض نماذج إنشاء الصور تعتمد على الانحدار التلقائي لأنّها تنشئ الصور على عدة خطوات.

B

النموذج الأساسي

نموذج مدرَّب مسبقًا يمكن استخدامه كنقطة بداية للتحسين بهدف معالجة مهام أو تطبيقات محدّدة.

اطّلِع أيضًا على النموذج المدرَّب مسبقًا والنموذج الأساسي.

C

توجيه سلسلة الأفكار

تقنية هندسة الطلبات التي تشجّع النموذج اللغوي الكبير (LLM) على شرح عملية الاستنتاج خطوة بخطوة. على سبيل المثال، اطّلِع على الطلب التالي، مع التركيز بشكل خاص على الجملة الثانية:

كم عدد قوى الجاذبية التي سيشعر بها السائق في سيارة تنتقل من 0 إلى 60 ميلاً في الساعة خلال 7 ثوانٍ؟ في الإجابة، أدرِج جميع العمليات الحسابية ذات الصلة.

من المرجّح أن يتضمّن رد النموذج اللغوي الكبير ما يلي:

- عرض سلسلة من صيغ الفيزياء، مع إدخال القيم 0 و60 و7 في الأماكن المناسبة

- اشرح سبب اختيار هذه الصيغ وما تعنيه المتغيّرات المختلفة.

يفرض الطلب المستند إلى سلسلة الأفكار على النموذج اللغوي الكبير إجراء جميع العمليات الحسابية، ما قد يؤدي إلى تقديم إجابة أكثر صحة. بالإضافة إلى ذلك، يتيح أسلوب "سلسلة الأفكار" للمستخدم فحص خطوات النموذج اللغوي الكبير لتحديد ما إذا كانت الإجابة منطقية أم لا.

محادثة

محتوى حوار ذهابًا وإيابًا مع نظام تعلُّم آلي، ويكون عادةً نموذجًا لغويًا كبيرًا تصبح التفاعلات السابقة في المحادثة (ما كتبته وكيف ردّ النموذج اللغوي الكبير) سياقًا للأجزاء اللاحقة من المحادثة.

روبوت الدردشة هو تطبيق لنموذج لغوي كبير.

تضمين اللغة حسب السياق

تضمين يقترب من "فهم" الكلمات والعبارات بطرق يفهمها المتحدثون بطلاقة. يمكن أن تفهم عمليات التضمين المستندة إلى السياق التركيب النحوي والدلالات والسياق المعقّد.

على سبيل المثال، ضع في اعتبارك تضمينات الكلمة الإنجليزية cow. يمكن أن تمثّل التضمينات القديمة، مثل word2vec، الكلمات الإنجليزية بطريقة تجعل المسافة في مساحة التضمين بين بقرة وثور مشابهة للمسافة بين نعجة (أنثى الخروف) وكبش (ذكر الخروف) أو بين أنثى وذكر. يمكن أن تتجاوز تضمينات اللغة المستندة إلى السياق ذلك من خلال إدراك أنّ المتحدثين باللغة الإنجليزية يستخدمون أحيانًا كلمة cow بشكل غير رسمي للإشارة إلى البقرة أو الثور.

قدرة الاستيعاب

عدد الرموز المميزة التي يمكن للنموذج معالجتها في طلب معيّن كلما كانت قدرة الاستيعاب أكبر، زادت المعلومات التي يمكن للنموذج استخدامها لتقديم ردود متسقة وذات صلة بالطلب.

الترميز الحواري

محادثة متكررة بينك وبين نموذج ذكاء اصطناعي توليدي بغرض إنشاء برامج تُصدر طلبًا يصف بعض البرامج. بعد ذلك، يستخدم النموذج هذا الوصف لإنشاء الرمز. بعد ذلك، تقدّم طلبًا جديدًا لمعالجة العيوب في الطلب السابق أو في الرمز البرمجي الذي تم إنشاؤه، وينشئ النموذج رمزًا برمجيًا معدَّلاً. ويستمرّان في تبادل الرسائل إلى أن يصبح البرنامج الذي تم إنشاؤه جيدًا بما يكفي.

البرمجة الوصفية هي في الأساس المعنى الأصلي للبرمجة الوصفية.

يختلف عن الترميز التحديدي.

D

توجيه الطلبات مباشرةً

مرادف للتلقين بلا أمثلة

التقطير

عملية تقليل حجم نموذج واحد (يُعرف باسم النموذج الرئيسي) إلى نموذج أصغر (يُعرف باسم النموذج الفرعي) يحاكي توقّعات النموذج الأصلي بأكبر قدر ممكن من الدقة التقطير مفيد لأنّ النموذج الأصغر حجمًا يتضمّن ميزتَين رئيسيتَين مقارنةً بالنموذج الأكبر حجمًا (المعلّم):

- وقت استنتاج أسرع

- تقليل استخدام الذاكرة والطاقة

ومع ذلك، لا تكون توقعات الطالب جيدة عادةً مثل توقعات المعلّم.

تدرّب عملية التقطير نموذج الطالب على تقليل دالة الخسارة استنادًا إلى الفرق بين نتائج التوقعات التي يقدّمها نموذج الطالب ونموذج المعلّم.

قارِن بين التقطير والمصطلحات التالية:

لمزيد من المعلومات، يمكنك الاطّلاع على النماذج اللغوية الكبيرة: الضبط الدقيق والتقطير وهندسة الطلبات في "دورة مكثّفة عن تعلّم الآلة".

E

التقييمات

تُستخدَم في المقام الأول كاختصار لتقييمات النماذج اللغوية الكبيرة. بشكل عام، التقييمات هي اختصار لأي شكل من أشكال التقييم.

التقييم

تشير هذه العملية إلى قياس جودة نموذج أو مقارنة نماذج مختلفة ببعضها.

لتقييم نموذج تعلُّم الآلة المُوجّه، يتم عادةً مقارنته بمجموعة التحقّق ومجموعة الاختبار. يتضمّن تقييم النماذج اللغوية الكبيرة عادةً تقييمات أوسع للجودة والأمان.

F

الواقعية

في عالم تعلُّم الآلة، تشير هذه السمة إلى نموذج يستند في نتائجه إلى بيانات واقعية. الحقيقة هي مفهوم وليست مقياسًا. على سبيل المثال، لنفترض أنّك أرسلت الطلب التالي إلى نموذج لغوي كبير:

ما هي الصيغة الكيميائية لملح الطعام؟

سيجيب النموذج الذي يحسّن صحة المعلومات على النحو التالي:

NaCl

قد يكون من المغري افتراض أنّ جميع النماذج يجب أن تستند إلى الوقائع. ومع ذلك، يجب أن تؤدي بعض الطلبات، مثل ما يلي، إلى تحسين الإبداع بدلاً من الدقة في نموذج الذكاء الاصطناعي التوليدي.

أريد سماع قصيدة مضحكة عن رائد فضاء ويسروع.

ومن غير المرجّح أن تكون الرباعية الناتجة مستندة إلى الواقع.

التباين مع الأساس

التدهور السريع

التدريب هو أسلوب لتحسين أداء نماذج اللغات الكبيرة. يتضمّن التدهور السريع خفض معدّل التعلّم بسرعة أثناء التدريب. تساعد هذه الاستراتيجية في منع التطابق الزائد مع بيانات التدريب، وتحسّن التعميم.

التلقين ببضعة أمثلة

الطلب الذي يحتوي على أكثر من مثال واحد (بضع أمثلة) يوضّح كيفية استجابة النموذج اللغوي الكبير. على سبيل المثال، يتضمّن الطلب الطويل التالي مثالَين يوضّحان للنموذج اللغوي الكبير كيفية الإجابة عن طلب بحث.

| أجزاء من طلب واحد | ملاحظات |

|---|---|

| ما هي العملة الرسمية للبلد المحدّد؟ | السؤال الذي تريد أن تجيب عنه النماذج اللغوية الكبيرة |

| فرنسا: يورو | إليك مثالاً. |

| المملكة المتحدة: الجنيه الإسترليني | مثال آخر. |

| الهند: | طلب البحث الفعلي |

يؤدي التلقين ببضعة أمثلة بشكل عام إلى نتائج أفضل من التلقين بلا أمثلة و التلقين بمثال واحد. ومع ذلك، يتطلّب التلقين ببضعة أمثلة تلقينًا أطول.

التلقين ببضعة أمثلة هو شكل من أشكال التعلّم ببضع فُرَص يتم تطبيقه على التعلّم المستند إلى الطلبات.

يمكنك الاطّلاع على هندسة المطالبات في "دورة مكثّفة عن تعلّم الآلة" للحصول على مزيد من المعلومات.

الضبط الدقيق

عملية تدريب ثانية خاصة بمهمة معيّنة يتم إجراؤها على نموذج مدرَّب مسبقًا لتحسين مَعلماته لحالة استخدام معيّنة. على سبيل المثال، يكون تسلسل التدريب الكامل لبعض النماذج اللغوية الكبيرة على النحو التالي:

- التدريب المُسبَق: يتم تدريب نموذج لغوي كبير على مجموعة بيانات عامة ضخمة، مثل جميع صفحات ويكيبيديا باللغة الإنجليزية.

- الضبط الدقيق: تدريب النموذج المدرَّب مسبقًا لتنفيذ مهمة محدّدة، مثل الردّ على الاستفسارات الطبية يتضمّن الضبط الدقيق عادةً مئات أو آلاف الأمثلة التي تركّز على المهمة المحدّدة.

كمثال آخر، يكون تسلسل التدريب الكامل لنموذج صور كبير على النحو التالي:

- التدريب المُسبَق: يتم تدريب نموذج كبير للصور على مجموعة بيانات عامة ضخمة من الصور، مثل جميع الصور في Wikimedia Commons.

- الضبط الدقيق: تدريب النموذج المدرَّب مسبقًا لتنفيذ مهمة محدّدة، مثل إنشاء صور لحيتان الأوركا

يمكن أن يتضمّن الضبط الدقيق أي مجموعة من الاستراتيجيات التالية:

- تعديل جميع المعلَمات الحالية للنموذج المدرَّب مسبقًا يُعرف ذلك أحيانًا باسم الضبط الدقيق الكامل.

- تعديل بعض المَعلمات الحالية للنموذج المدرَّب مسبقًا (عادةً، الطبقات الأقرب إلى طبقة الإخراج)، مع الحفاظ على المَعلمات الحالية الأخرى بدون تغيير (عادةً، الطبقات الأقرب إلى طبقة الإدخال) اطّلِع على الضبط الفعّال من حيث المَعلمات.

- إضافة المزيد من الطبقات، عادةً ما تكون فوق الطبقات الحالية الأقرب إلى طبقة الإخراج

الضبط الدقيق هو أحد أشكال التعلم النقلي. وبالتالي، قد تستخدم عملية الضبط الدقيق دالة خسارة أو نوع نموذج مختلفَين عن تلك المستخدَمة لتدريب النموذج المدرَّب مسبقًا. على سبيل المثال، يمكنك ضبط نموذج كبير للصور مدرَّب مسبقًا بدقة لإنشاء نموذج انحدار يعرض عدد الطيور في صورة مُدخَلة.

قارِن بين الضبط الدقيق والمصطلحات التالية:

يمكنك الاطّلاع على الضبط الدقيق في "دورة مكثّفة عن تعلّم الآلة" للحصول على مزيد من المعلومات.

نموذج الفلاش

مجموعة من نماذج Gemini الصغيرة نسبيًا والمحسَّنة لتحقيق سرعة عالية ووقت استجابة منخفض. تم تصميم نماذج Flash لمجموعة كبيرة من التطبيقات التي تتطلّب ردودًا سريعة ومعدل نقل بيانات مرتفعًا.

نموذج أساسي

نموذج مدرَّب مسبقًا كبير جدًا تم تدريبه على مجموعة تدريب هائلة ومتنوّعة. يمكن للنموذج الأساسي تنفيذ ما يلي:

- الاستجابة بشكل جيد لمجموعة كبيرة من الطلبات

- يمكن استخدامه كنموذج أساسي لإجراء المزيد من عمليات الضبط الدقيق أو التخصيص الأخرى.

بعبارة أخرى، يكون النموذج الأساسي فعّالاً جدًا بشكل عام، ولكن يمكن تخصيصه بشكل أكبر ليصبح أكثر فائدةً في مهمة معيّنة.

نسبة النجاحات

مقياس لتقييم النص الذي تم إنشاؤه بواسطة نموذج تعلُّم آلي نسبة النجاح هي عدد مخرجات النصوص التي تم إنشاؤها "بنجاح" مقسومًا على إجمالي عدد مخرجات النصوص التي تم إنشاؤها. على سبيل المثال، إذا أنشأ نموذج لغة كبير 10 أجزاء من الرمز، ونجح خمسة منها، ستكون نسبة النجاح 50%.

على الرغم من أنّ مقياس "نسبة النجاح" مفيد بشكل عام في الإحصاء، إلا أنّه في تعلُّم الآلة، يكون هذا المقياس مفيدًا بشكل أساسي لقياس المهام التي يمكن التحقّق منها، مثل إنشاء الرموز البرمجية أو حلّ المسائل الرياضية.

G

Gemini

منظومة متكاملة تضمّ أحدث تكنولوجيات الذكاء الاصطناعي من Google تشمل عناصر هذا النظام البيئي ما يلي:

- نماذج Gemini المختلفة

- هي واجهة محادثة تفاعلية مع أحد نماذج Gemini. يكتب المستخدمون طلبات ويردّ Gemini عليها.

- واجهات Gemini API المختلفة

- منتجات مختلفة للأنشطة التجارية تستند إلى نماذج Gemini، مثل Gemini في Google Cloud

نماذج Gemini

نماذج متعددة الوسائط مستندة إلى Transformer من Google تم تصميم نماذج Gemini خصيصًا للاندماج مع الوكلاء.

يمكن للمستخدمين التفاعل مع نماذج Gemini بطرق متنوعة، بما في ذلك من خلال واجهة حوار تفاعلية ومن خلال حِزم تطوير البرامج (SDK).

Gemma

مجموعة من النماذج المفتوحة والخفيفة تم إنشاؤها بالاستناد إلى الأبحاث والتكنولوجيا نفسها التي استُخدمَت لإنشاء نماذج Gemini تتوفّر عدة نماذج مختلفة من Gemma، يقدّم كل منها ميزات مختلفة، مثل الرؤية والتعليمات البرمجية واتّباع التعليمات. لمزيد من التفاصيل، يُرجى الاطّلاع على Gemma.

الذكاء الاصطناعي التوليدي أو الذكاء الاصطناعي التوليدي

اختصار الذكاء الاصطناعي التوليدي

النص الذي يتم إنشاؤه

بشكل عام، يشير إلى النص الذي ينتجه نموذج تعلُّم الآلة. عند تقييم النماذج اللغوية الكبيرة، تقارن بعض المقاييس النص الذي تم إنشاؤه بالنص المرجعي. على سبيل المثال، لنفترض أنّك تحاول تحديد مدى فعالية نموذج تعلّم آلي في الترجمة من الفرنسية إلى الهولندية. في هذه الحالة:

- النص الذي تم إنشاؤه هو الترجمة الهولندية التي يعرضها نموذج تعلُّم الآلة.

- النص المرجعي هو الترجمة الهولندية التي يقدّمها مترجم بشري (أو برنامج).

يُرجى العِلم أنّ بعض استراتيجيات التقييم لا تتضمّن نصًا مرجعيًا.

الذكاء الاصطناعي التوليدي

مجال تحويلي ناشئ بدون تعريف رسمي مع ذلك، يتفق معظم الخبراء على أنّ نماذج الذكاء الاصطناعي التوليدي يمكنها إنشاء محتوى يتضمّن كل ما يلي:

- معقّد

- متماسك

- الصورة الأصلية

تشمل أمثلة الذكاء الاصطناعي التوليدي ما يلي:

- النماذج اللغوية الكبيرة، التي يمكنها إنشاء نصوص أصلية معقّدة والإجابة عن الأسئلة

- نموذج إنشاء الصور الذي يمكنه إنتاج صور فريدة

- نماذج إنشاء المحتوى الصوتي والموسيقي، والتي يمكنها تأليف موسيقى أصلية أو إنشاء محتوى صوتي واقعي

- نماذج إنشاء الفيديوهات التي يمكنها إنشاء فيديوهات أصلية

يمكن لبعض التقنيات السابقة، بما في ذلك شبكات الذاكرة الطويلة المدى (LSTM) والشبكات العصبية المتكررة (RNN)، إنشاء محتوى أصلي ومتماسك أيضًا. يرى بعض الخبراء أنّ هذه التكنولوجيات السابقة هي ذكاء اصطناعي توليدي، بينما يرى آخرون أنّ الذكاء الاصطناعي التوليدي الحقيقي يتطلّب نواتج أكثر تعقيدًا من تلك التي يمكن أن تنتجها التكنولوجيات السابقة.

يختلف ذلك عن تعلُّم الآلة التوقّعي.

ردّ ذهبي

ردّ معروف بأنّه جيد. على سبيل المثال، إذا كان لديك الطلب التالي:

2 + 2

من المفترض أن تكون الإجابة المثالية هي:

4

GPT (Generative Pre-trained Transformer)

هي مجموعة من النماذج اللغوية الكبيرة المستندة إلى Transformer، والتي طوّرتها شركة OpenAI.

يمكن أن تنطبق صيغ GPT على وسائط متعددة، بما في ذلك:

- إنشاء الصور (مثل ImageGPT)

- تحويل النصوص إلى صور (على سبيل المثال، DALL-E)

H

النتائج غير الصحيحة

هي إنتاج نموذج ذكاء اصطناعي توليدي لنتائج تبدو معقولة ولكنّها غير صحيحة من الناحية الواقعية، ويدّعي النموذج أنّه يقدّم تأكيدًا بشأن العالم الواقعي. على سبيل المثال، إذا ادّعى نموذج ذكاء اصطناعي توليدي أنّ باراك أوباما توفي في عام 1865، يكون هذا النموذج يهلوس.

التقييم البشري

عملية يقيّم فيها الأشخاص جودة نتائج نموذج تعلُّم الآلة، مثل أن يقيّم أشخاص يتحدثون لغتين جودة نموذج ترجمة يستند إلى تعلُّم الآلة. ويكون التقييم البشري مفيدًا بشكل خاص في تقييم النماذج التي لا تتضمّن إجابة صحيحة واحدة.

يختلف ذلك عن التقييم التلقائي والتقييم التلقائي باستخدام أداة Autorater.

المشاركة البشرية (HITL)

عبارة اصطلاحية غير محددة المعنى بدقة يمكن أن تشير إلى أي مما يلي:

- سياسة تقييم نتائج الذكاء الاصطناعي التوليدي بشكل نقدي أو متشكّك.

- هي استراتيجية أو نظام لضمان مساهمة المستخدمين في تحديد سلوك النموذج وتقييمه وتحسينه. يسمح إبقاء الإنسان في عملية الذكاء الاصطناعي للاستفادة من الذكاء الآلي والذكاء البشري معًا. على سبيل المثال، النظام الذي ينشئ فيه الذكاء الاصطناعي رموزًا برمجية يراجعها مهندسو البرمجيات هو نظام يتضمّن تدخّل الإنسان.

I

التعلّم داخل السياق

مرادف للتلقين ببضعة أمثلة

الاستنتاج

في عملية تعلُّم الآلة التقليدية، يتم إجراء التوقعات من خلال تطبيق نموذج مدرَّب على أمثلة غير مصنَّفة. يمكنك الاطّلاع على التعلم الخاضع للإشراف في دورة "مقدمة في تعلُّم الآلة" لمعرفة المزيد.

في النماذج اللغوية الكبيرة، الاستدلال هو عملية استخدام نموذج مُدرَّب لإنشاء رد على طلب.

للاستدلال معنى مختلف إلى حد ما في الإحصاء. يمكنك الاطّلاع على مقالة الاستدلال الإحصائي على ويكيبيديا للحصول على التفاصيل.

ضبط التعليمات

نوع من الضبط الدقيق يحسّن قدرة نموذج الذكاء الاصطناعي التوليدي على اتّباع التعليمات. تتضمّن عملية ضبط التعليمات تدريب نموذج على سلسلة من طلبات التعليمات، تغطي عادةً مجموعة واسعة من المهام. يميل النموذج الناتج الذي تم ضبطه وفقًا للتعليمات إلى تقديم ردود مفيدة على الطلبات بلا أمثلة في مجموعة متنوعة من المهام.

مقارنة مع:

L

النموذج اللغوي الكبير

كحدّ أدنى، نموذج لغوي يحتوي على عدد كبير جدًا من المَعلمات بشكل غير رسمي، أي نموذج لغة مستند إلى Transformer، مثل Gemini أو GPT

لمزيد من المعلومات، يمكنك الاطّلاع على النماذج اللغوية الكبيرة (LLM) في "دورة مكثّفة عن تعلّم الآلة".

وقت الاستجابة

الوقت الذي يستغرقه النموذج لمعالجة الإدخال وإنشاء ردّ يستغرق إنشاء الردود ذات وقت الاستجابة العالي وقتًا أطول من إنشاء الردود ذات وقت الاستجابة المنخفض.

تشمل العوامل التي تؤثر في وقت الاستجابة في النماذج اللغوية الكبيرة ما يلي:

- أطوال الرموز المميزة للإدخال والإخراج

- مدى تعقيد النموذج

- البنية الأساسية التي يعمل عليها النموذج

يُعدّ تحسين وقت الاستجابة أمرًا بالغ الأهمية لإنشاء تطبيقات سريعة الاستجابة وسهلة الاستخدام.

LLM

اختصار النموذج اللغوي الكبير

تقييمات النماذج اللغوية الكبيرة

مجموعة من المقاييس ومقاييس الأداء لتقييم أداء النماذج اللغوية الكبيرة (LLM). بشكل عام، تتضمّن عمليات تقييم النماذج اللغوية الكبيرة ما يلي:

- مساعدة الباحثين في تحديد المجالات التي تحتاج فيها النماذج اللغوية الكبيرة إلى تحسين

- وهي مفيدة في مقارنة النماذج اللغوية الكبيرة المختلفة وتحديد أفضل نموذج لغوي كبير لمهمة معيّنة.

- المساعدة في ضمان أنّ استخدام النماذج اللغوية الكبيرة آمن وأخلاقي

لمزيد من المعلومات، يمكنك الاطّلاع على النماذج اللغوية الكبيرة (LLM) في "دورة مكثّفة عن تعلُّم الآلة".

LoRA

اختصار Low-Rank Adaptability

Low-Rank Adaptability (LoRA)

أسلوب فعّال من حيث عدد المَعلمات لعملية الضبط الدقيق، حيث يتم "تجميد" الأوزان المُدرَّبة مسبقًا للنموذج (بحيث لا يمكن تعديلها بعد ذلك)، ثم يتم إدراج مجموعة صغيرة من الأوزان القابلة للتدريب في النموذج. تكون مجموعة الأوزان القابلة للتدريب هذه (المعروفة أيضًا باسم "مصفوفات التعديل") أصغر بكثير من النموذج الأساسي، وبالتالي تكون عملية تدريبها أسرع بكثير.

توفّر LoRA المزايا التالية:

- يحسّن جودة توقّعات النموذج للمجال الذي يتم فيه تطبيق الضبط الدقيق.

- يتم الضبط بشكل أسرع من التقنيات التي تتطلّب ضبط جميع مَعلمات النموذج.

- يقلّل هذا الخيار من تكلفة الاستدلال الحسابية من خلال السماح بعرض نماذج متخصّصة متعددة في الوقت نفسه، مع مشاركة النموذج الأساسي نفسه.

M

الترجمة الآلية

استخدام برنامج (عادةً، نموذج تعلُّم آلة) لتحويل نص من لغة بشرية إلى أخرى، مثلاً من الإنجليزية إلى اليابانية

متوسط الدقة عند k (mAP@k)

المتوسط الإحصائي لكل نتائج متوسط الدقة عند k في مجموعة بيانات التحقّق. يُستخدم مقياس متوسط الدقة عند k لتقييم جودة المحتوى المقترح الذي يقدّمه نظام التوصية.

على الرغم من أنّ عبارة "المتوسط الحسابي" تبدو مكرّرة، إلا أنّ اسم المقياس مناسب. ففي النهاية، يعثر هذا المقياس على متوسط قيم متوسط الدقة عند k المتعددة.

mixture of experts

هي طريقة تهدف إلى زيادة كفاءة الشبكة العصبية من خلال استخدام مجموعة فرعية فقط من مَعلماتها (المعروفة باسم الخبير) لمعالجة رمز إدخال أو مثال معيّن. توجّه شبكة البوابة كل رمز مميز أو مثال إلى الخبراء المناسبين.

للاطّلاع على التفاصيل، يُرجى الرجوع إلى إحدى الورقتَين التاليتَين:

- الشبكات العصبونية الضخمة بشكل غير معقول: طبقة "مزيج الخبراء" ذات البوابات المتفرقة

- Mixture-of-Experts with Expert Choice Routing

MMIT

الاختصار الخاص بـ النماذج المتعددة الوسائط التي تم ضبطها وفقًا للتعليمات

التسلسل الهرمي للنماذج

نظام يختار النموذج المثالي لاستعلام استنتاج معيّن.

لنفترض أنّ لديك مجموعة من النماذج تتراوح بين نماذج كبيرة جدًا (تتضمّن الكثير من المَعلمات) ونماذج أصغر بكثير (تتضمّن عددًا أقل بكثير من المَعلمات). تستهلك النماذج الكبيرة جدًا موارد حوسبة أكبر في وقت الاستدلال مقارنةً بالنماذج الأصغر. ومع ذلك، يمكن للنماذج الكبيرة جدًا عادةً استنتاج طلبات أكثر تعقيدًا من النماذج الأصغر. يحدّد تسلسل النماذج مدى تعقيد طلب الاستنتاج، ثم يختار النموذج المناسب لتنفيذ الاستنتاج. الدافع الرئيسي لتسلسل النماذج هو تقليل تكاليف الاستدلال من خلال اختيار نماذج أصغر بشكل عام، واختيار نموذج أكبر للاستعلامات الأكثر تعقيدًا فقط.

لنفترض أنّ نموذجًا صغيرًا يعمل على هاتف، وأنّ إصدارًا أكبر من هذا النموذج يعمل على خادم بعيد. يؤدي تسلسل النماذج الجيد إلى خفض التكلفة ووقت الاستجابة من خلال السماح للنموذج الأصغر بمعالجة الطلبات البسيطة واستدعاء النموذج البعيد فقط لمعالجة الطلبات المعقّدة.

يمكنك الاطّلاع أيضًا على موجه النماذج.

جهاز توجيه نموذجي

الخوارزمية التي تحدّد النموذج المثالي للاستدلال في النماذج المتتالية عادةً ما يكون موجّه النماذج نموذجًا لتعلُّم الآلة يتعلّم تدريجيًا كيفية اختيار أفضل نموذج لمدخلات معيّنة. في المقابل، قد يكون موجّه النماذج في بعض الأحيان خوارزمية أبسط لا تستند إلى تعلُّم الآلة.

MOE

اختصار مزيج الخبراء

MT

اختصار الترجمة الآلية

لا

Nano

نموذج Gemini صغير نسبيًا مصمَّم للاستخدام على الأجهزة. لمزيد من التفاصيل، يمكنك الاطّلاع على Gemini Nano.

يمكنك أيضًا الاطّلاع على Pro وUltra.

لا توجد إجابة صحيحة واحدة (NORA)

طلب يتضمّن عدة ردود صحيحة على سبيل المثال، لا يوجد إجابة صحيحة واحدة للطلب التالي:

أريد سماع نكتة مضحكة عن الأفيال.

تقييم الردود على الأسئلة التي لا تتضمّن إجابة صحيحة واحدة يكون عادةً أكثر ذاتية من تقييم الأسئلة التي تتضمّن إجابة صحيحة واحدة. على سبيل المثال، يتطلّب تقييم نكتة عن الفيل طريقة منهجية لتحديد مدى طرافتها.

NORA

اختصار لا توجد إجابة صحيحة واحدة

NotebookLM

أداة مستندة إلى Gemini تتيح للمستخدمين تحميل المستندات ثم استخدام طلبات لطرح أسئلة حول هذه المستندات أو تلخيصها أو تنظيمها. على سبيل المثال، يمكن لمؤلف تحميل عدة قصص قصيرة والطلب من NotebookLM العثور على المواضيع المشتركة بينها أو تحديد القصة التي يمكن تحويلها إلى فيلم ناجح.

O

إجابة صحيحة واحدة (ORA)

طلب يتضمّن إجابة صحيحة واحدة على سبيل المثال، فكِّر في الطلب التالي:

صواب أم خطأ: كوكب زحل أكبر من كوكب المريخ.

الرد الصحيح الوحيد هو صحيح.

يُرجى الرجوع إلى لا توجد إجابة صحيحة.

التلقين بمثال واحد

طلب يتضمّن مثالاً واحدًا يوضّح طريقة استجابة النموذج اللغوي الكبير. على سبيل المثال، يتضمّن الطلب التالي مثالاً واحدًا يوضّح للنموذج اللغوي الكبير كيفية الإجابة عن طلب بحث.

| أجزاء من طلب واحد | ملاحظات |

|---|---|

| ما هي العملة الرسمية للبلد المحدّد؟ | السؤال الذي تريد أن تجيب عنه النماذج اللغوية الكبيرة |

| فرنسا: يورو | إليك مثالاً. |

| الهند: | طلب البحث الفعلي |

قارِن بين الطلب لمرة واحدة والمصطلحات التالية:

ORA

الاختصار إجابة صحيحة واحدة

P

الضبط الفعّال من حيث المعلَمات

مجموعة من الأساليب لضبط نموذج لغوي كبير مدرَّب مسبقًا (PLM) بشكل أكثر فعالية من الضبط الكامل. تتيح عملية الضبط الدقيق الفعّالة من حيث عدد المَعلمات عادةً ضبط عدد أقل بكثير من المَعلمات مقارنةً بعملية الضبط الدقيق الكامل، ولكنها تنتج بشكل عام نموذجًا لغويًا كبيرًا يؤدي الوظيفة نفسها (أو الوظيفة نفسها تقريبًا) التي يؤديها النموذج اللغوي الكبير الذي تم إنشاؤه من خلال عملية الضبط الدقيق الكامل.

مقارنة الضبط الفعّال من حيث المَعلَمات بما يلي:

يُعرف الضبط الفعّال من حيث المَعلمات أيضًا باسم الضبط الدقيق الفعّال من حيث المَعلمات.

Pax

إطار برمجي مصمّم لتدريب نماذج الشبكات العصبية الكبيرة الحجم التي تمتد على شرائح وحدات معالجة الموتّرات أو شرائح تسريع أو شرائح أو وحدات متعددة.

يستند Pax إلى Flax، الذي يستند إلى JAX.

PLM

اختصار النموذج اللغوي المدرَّب مسبقًا

نموذج محسَّن بعد التدريب

مصطلح غير محدّد بدقة يشير عادةً إلى نموذج مُدرَّب مسبقًا خضع لبعض عمليات المعالجة اللاحقة، مثل واحدة أو أكثر مما يلي:

نموذج مدرَّب مسبقًا

على الرغم من أنّ هذا المصطلح يمكن أن يشير إلى أي نموذج أو متّجه تضمين تم تدريبه، يشير النموذج المُدرَّب مسبقًا الآن عادةً إلى نموذج لغوي كبير أو شكل آخر من أشكال الذكاء الاصطناعي التوليدي المُدرَّب.

يمكنك أيضًا الاطّلاع على النموذج الأساسي والنموذج الأولي.

التدريب المُسبَق

التدريب الأوّلي للنموذج على مجموعة بيانات كبيرة بعض النماذج المدرَّبة مسبقًا هي نماذج ضخمة وغير دقيقة، ويجب عادةً تحسينها من خلال تدريب إضافي. على سبيل المثال، قد يدرّب خبراء تعلُّم الآلة نموذج لغة كبيرًا مسبقًا على مجموعة بيانات نصية ضخمة، مثل جميع صفحات ويكيبيديا باللغة الإنجليزية. بعد التدريب المُسبَق، يمكن تحسين النموذج الناتج بشكل أكبر من خلال أي من التقنيات التالية:

Pro

نموذج Gemini يتضمّن عددًا أقل من المَعلمات مقارنةً بنموذج Ultra، ولكن عددًا أكبر من المَعلمات مقارنةً بنموذج Nano. يمكنك الاطّلاع على مقالة Gemini Pro لمزيد من التفاصيل.

prompt

أي نص يتم إدخاله كمدخل إلى نموذج لغوي كبير لإعداد النموذج ليعمل بطريقة معيّنة. يمكن أن تكون الطلبات قصيرة مثل عبارة أو طويلة بشكل عشوائي (على سبيل المثال، النص الكامل لرواية). تندرج الطلبات ضمن فئات متعددة، بما في ذلك الفئات الموضّحة في الجدول التالي:

| فئة الطلب | مثال | ملاحظات |

|---|---|---|

| السؤال | ما هي سرعة طيران الحمام؟ | |

| مدرسة تعليم | اكتب قصيدة مضحكة عن المراجحة. | طلب يطلب من النموذج اللغوي الكبير تنفيذ إجراء معيّن. |

| مثال | ترجمة رمز Markdown إلى HTML على سبيل المثال:

Markdown: * عنصر قائمة HTML: <ul> <li>عنصر قائمة</li> </ul> |

الجملة الأولى في مثال الطلب هذا هي تعليمات. ويشكّل الجزء المتبقي من الطلب المثال. |

| الدور | اشرح سبب استخدام خوارزمية انحدار التدرّج في تدريب تعلُّم الآلة، وذلك من منظور حامل شهادة دكتوراه في الفيزياء. | الجزء الأول من الجملة هو تعليمات، أما العبارة "للحصول على درجة الدكتوراه في الفيزياء" فهي جزء الدور. |

| إدخال جزئي لإكماله من قِبل النموذج | يسكن رئيس وزراء المملكة المتحدة في | يمكن أن ينتهي طلب الإدخال الجزئي بشكل مفاجئ (كما هو الحال في هذا المثال) أو ينتهي بشرطة سفلية. |

يمكن لنموذج الذكاء الاصطناعي التوليدي الاستجابة لطلب باستخدام نص أو رمز برمجي أو صور أو تضمينات أو فيديوهات أو أي شيء آخر تقريبًا.

التعلّم المستند إلى الطلبات

إحدى إمكانات بعض النماذج التي تتيح لها تعديل سلوكها استجابةً لإدخال نص عشوائي (طلبات). في نموذج التعلّم النموذجي المستند إلى الطلبات، يستجيب النموذج اللغوي الكبير لطلب من خلال إنشاء نص. على سبيل المثال، لنفترض أنّ المستخدم يُدخل الطلب التالي:

لخِّص قانون "نيوتن" الثالث للحركة.

لا يتم تدريب النموذج القادر على التعلّم المستند إلى الطلبات بشكل خاص للإجابة عن الطلب السابق. بدلاً من ذلك، "يعرف" النموذج الكثير من الحقائق حول الفيزياء، والكثير حول قواعد اللغة العامة، والكثير حول ما يشكّل إجابات مفيدة بشكل عام. هذه المعرفة كافية لتقديم إجابة (نأمل أن تكون) مفيدة. تتيح الملاحظات الإضافية من المستخدمين ("كانت الإجابة معقّدة جدًا" أو "ما هي التفاعلات؟") لبعض أنظمة التعلّم المستندة إلى الطلبات تحسين فائدة إجاباتها تدريجيًا.

تصميم الطلبات

مرادف لهندسة الطلبات

هندسة الطلبات

فن إنشاء طلبات تؤدي إلى الحصول على ردود مرغوبة من نموذج لغوي كبير يُجري البشر عملية هندسة الطلبات. تُعد كتابة طلبات منظَّمة بشكل جيد جزءًا أساسيًا من ضمان الحصول على ردود مفيدة من نموذج لغوي كبير. تعتمد هندسة الطلبات على عدة عوامل، بما في ذلك:

- مجموعة البيانات المستخدَمة في التدريب المُسبَق وربما في الضبط الدقيق للنموذج اللغوي الكبير

- تمثّل هذه السمة درجة الحرارة وغيرها من مَعلمات فك الترميز التي يستخدمها النموذج لإنشاء الردود.

تصميم الطلبات هو مرادف لهندسة الطلبات.

يمكنك الاطّلاع على مقدمة حول تصميم الطلبات لمزيد من التفاصيل حول كتابة طلبات مفيدة.

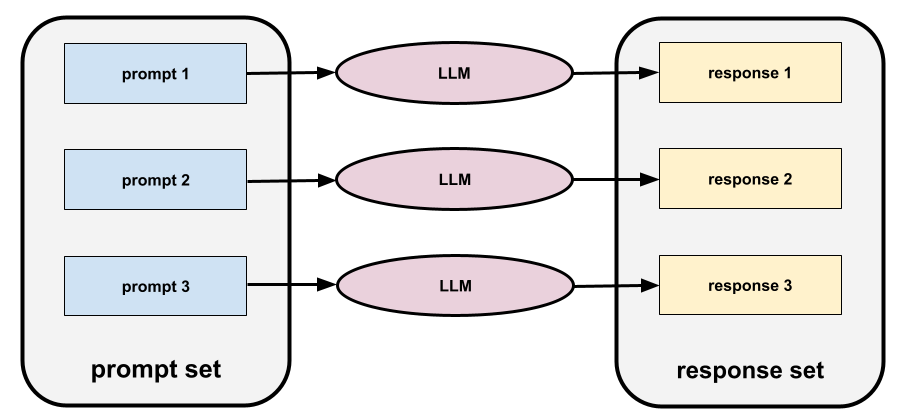

مجموعة الطلبات

مجموعة من الطلبات لتقييم نموذج لغوي كبير على سبيل المثال، يوضّح الرسم التوضيحي التالي مجموعة طلبات تتألف من ثلاثة طلبات:

تتألف مجموعات الطلبات الجيدة من مجموعة "واسعة" بما يكفي من الطلبات لتقييم سلامة النماذج اللغوية الكبيرة ومدى فائدتها بشكل شامل.

يمكنك الاطّلاع أيضًا على مجموعة الردود.

تعديل الطلبات

آلية ضبط فعّال للمَعلمات تتعلّم "بادئة" يضيفها النظام إلى الطلب الفعلي.

إحدى طرق تعديل الطلبات، والتي تُعرف أحيانًا باسم تعديل البادئة، هي إضافة البادئة في كل طبقة. في المقابل، لا يضيف معظم عمليات ضبط الطلبات سوى بادئة إلى طبقة الإدخال.

R

النص المرجعي

ردّ خبير على طلب على سبيل المثال، إذا كان الطلب كما يلي:

ترجِم السؤال "ما اسمك؟" من الإنجليزية إلى الفرنسية.

قد يكون ردّ الخبير على النحو التالي:

Comment vous appelez-vous?

تقيس مقاييس مختلفة (مثل ROUGE) مدى تطابق النص المرجعي مع النص الذي أنشأه نموذج تعلُّم الآلة.

التأمّل

استراتيجية لتحسين جودة سير العمل المستند إلى الوكلاء من خلال فحص (التفكير في) ناتج إحدى الخطوات قبل تمرير هذا الناتج إلى الخطوة التالية.

غالبًا ما يكون المدقّق هو LLM نفسه الذي أنشأ الرد (مع أنّه قد يكون نموذجًا لغويًا كبيرًا مختلفًا). كيف يمكن للنموذج اللغوي الكبير نفسه الذي أنشأ الرد أن يكون حكمًا عادلاً على رده؟ يكمن "الحل" في وضع النموذج اللغوي الكبير في حالة ذهنية تحليلية (تأملية). تشبه هذه العملية الكاتب الذي يستخدم عقلية إبداعية لكتابة مسودة أولية ثم ينتقل إلى عقلية نقدية لتعديلها.

على سبيل المثال، تخيَّل سير عمل قائمًا على الذكاء الاصطناعي التوليدي تكون خطوته الأولى هي إنشاء نص لأكواب القهوة. قد يكون الطلب لهذه الخطوة كما يلي:

أنت شخص مبدع. أنشئ نصًا فكاهيًا أصليًا يتألف من أقل من 50 حرفًا ومناسبًا لكوب قهوة.

تخيَّل الآن مطالبة التأمّل التالية:

أنت من محبّي القهوة. هل تجد الردّ السابق مضحكًا؟

بعد ذلك، قد لا تسمح سير العمل إلا بمرور النصوص التي تحصل على درجة انعكاس عالية إلى المرحلة التالية.

التعلّم المعزّز من الردود البشرية (RLHF)

استخدام ملاحظات من مقيّمين بشريين لتحسين جودة ردود النموذج على سبيل المثال، يمكن لآلية RLHF أن تطلب من المستخدمين تقييم جودة ردّ النموذج باستخدام إيموجي 👍 أو 👎. يمكن للنظام بعد ذلك تعديل ردوده المستقبلية استنادًا إلى هذه الملاحظات.

رد

النص أو الصور أو المقاطع الصوتية أو الفيديوهات التي يستنتجها نموذج الذكاء الاصطناعي التوليدي بعبارة أخرى، الطلب هو المعلومات التي يتم إدخالها في نموذج الذكاء الاصطناعي التوليدي، والرد هو الناتج.

مجموعة الردود

مجموعة الردود التي يعرضها النموذج اللغوي الكبير استجابةً لمجموعة طلبات

التلقين حسب الدور

الطلب هو عبارة عن إدخال يبدأ عادةً بالضمير أنت، ويطلب من نموذج الذكاء الاصطناعي التوليدي التظاهر بأنّه شخص معيّن أو يؤدي دورًا معيّنًا عند إنشاء الردّ. يمكن أن يساعد تحديد الدور في الطلب نموذج الذكاء الاصطناعي التوليدي في اتّخاذ "العقلية" المناسبة لإنشاء ردّ أكثر فائدة. على سبيل المثال، قد تكون أي من الطلبات التالية المتعلقة بالأدوار مناسبة حسب نوع الرد الذي تبحث عنه:

أنت حاصل على درجة الدكتوراه في علوم الكمبيوتر.

أنت مهندس برامج يستمتع بتقديم شروحات صبورة حول لغة Python للطلاب الجدد في مجال البرمجة.

أنت بطل أكشن يمتلك مجموعة مهارات برمجة مميزة. أريد التأكّد من أنّك ستعثر على عنصر معيّن في قائمة Python.

S

ضبط الطلبات الليّنة

هي تقنية تتيح تحسين نموذج لغوي كبير لأداء مهمة معيّنة، بدون الحاجة إلى تحسين مكثّف للموارد. بدلاً من إعادة تدريب جميع الأوزان في النموذج، تعمل ميزة "ضبط المطالبات السلس" على تعديل مطالبة تلقائيًا لتحقيق الهدف نفسه.

عند تقديم طلب نصي، تعمل عملية ضبط الطلب المرن عادةً على إلحاق تضمينات رموز مميزة إضافية بالطلب، وتستخدم الانتشار الخلفي لتحسين الإدخال.

يحتوي الطلب "الصعب" على رموز مميّزة فعلية بدلاً من تضمينات الرموز المميّزة.

الترميز المواصفاتي

عملية كتابة ملف وصيانته بلغة طبيعية (مثل الإنجليزية) يصف البرنامج. يمكنك بعد ذلك أن تطلب من نموذج ذكاء اصطناعي توليدي أو مهندس برمجيات آخر إنشاء البرنامج الذي يتوافق مع هذا الوصف.

يتطلّب الرمز البرمجي الذي يتم إنشاؤه تلقائيًا عادةً تكرارًا. في الترميز التحديدي، يتم تكرار ملف الوصف. في المقابل، في الترميز الحواري، يمكنك تكرار العملية داخل مربّع الطلب. في الواقع، يتضمّن إنشاء الرموز البرمجية تلقائيًا أحيانًا مزيجًا من كل من الترميز التحديدي والترميز الحواري.

T

درجة الحرارة

المَعلمة الفائقة التي تتحكّم في درجة العشوائية في ردود النموذج. تؤدي درجات الحرارة المرتفعة إلى ناتج أكثر عشوائية، بينما تؤدي درجات الحرارة المنخفضة إلى ناتج أقل عشوائية.

يعتمد اختيار درجة الحرارة الأفضل على التطبيق المحدّد و/أو قيم السلسلة.

U

Ultra

نموذج Gemini الذي يتضمّن أكبر عدد من المَعلمات يمكنك الاطّلاع على مقالة Gemini Ultra لمزيد من التفاصيل.

يمكنك الاطّلاع أيضًا على Pro وNano.

V

الذروة

منصة Google Cloud للذكاء الاصطناعي وتعلُّم الآلة توفّر Vertex أدوات وبنية تحتية لإنشاء تطبيقات الذكاء الاصطناعي وتفعيلها وإدارتها، بما في ذلك إمكانية الوصول إلى نماذج Gemini.البرمجة الوصفية

إصدار طلب إلى نموذج ذكاء اصطناعي توليدي لإنشاء برنامج وهذا يعني أنّ طلباتك تصف الغرض من البرنامج وميزاته، ويحوّلها نموذج الذكاء الاصطناعي التوليدي إلى رمز مصدر. لا يتطابق الرمز البرمجي الذي تم إنشاؤه دائمًا مع نواياك، لذا يتطلّب الترميز المستند إلى الإحساس عادةً تكرارًا.

صاغ أندريه كارباثي مصطلح "الترميز حسب الأجواء" في منشور X هذا. في منشور X، وصفها كارباثي بأنّها "نوع جديد من الترميز... حيث تستسلم تمامًا للأجواء...". لذلك، كان المصطلح يشير في الأصل إلى نهج متساهل عن قصد في إنشاء البرامج، حيث قد لا يتم حتى فحص الرمز البرمجي الذي تم إنشاؤه. ومع ذلك، تطوّر هذا المصطلح بسرعة في العديد من الأوساط ليصبح يشير الآن إلى أي شكل من أشكال الترميز من إنشاء الذكاء الاصطناعي.

للحصول على وصف أكثر تفصيلاً حول ترميز الأجواء، يمكنك الاطّلاع على المقالة ما هي البرمجة الوصفية؟.

بالإضافة إلى ذلك، قارِن بين ترميز المشاعر و:

Z

التلقين بلا أمثلة

طلب لا يقدّم مثالاً على الطريقة التي تريد أن يردّ بها النموذج اللغوي الكبير. على سبيل المثال:

| أجزاء من طلب واحد | ملاحظات |

|---|---|

| ما هي العملة الرسمية للبلد المحدّد؟ | السؤال الذي تريد أن تجيب عنه النماذج اللغوية الكبيرة |

| الهند: | طلب البحث الفعلي |

قد يردّ النموذج اللغوي الكبير بأي مما يلي:

- روبية

- INR

- ر.ه.

- الروبية الهندية

- الروبية

- الروبية الهندية

جميع الإجابات صحيحة، ولكن قد تفضّل تنسيقًا معيّنًا.

قارِن بين الطلب بدون أمثلة والمصطلحات التالية: