2024 年 8 月 に、機械学習集中講座の改良された新しいバージョンがリリースされます。今後の情報にご注目ください。

線形回帰 は、一連の点に最も適した直線またはハイパープレーンを見つける方法です。このモジュールでは、線形回帰に対する機械学習アプローチの土台を築く前に、直線回帰を直感的に探索します。

学習目標

オンライン フィッティングの記憶をリフレッシュします。

機械学習の重みとバイアスを、ラインフィッティングの傾きとオフセットに関係付けます。

「損失」について理解します(特に損失と二乗)。

ML への降順

データから学ぶ

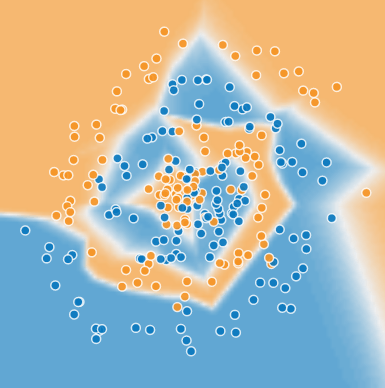

データから学習するための複雑な方法が多数ある

しかし、最初はシンプルで使い慣れたものから始めてもよいでしょう。

簡単なことから始めることで、広く使える方法の扉を開く

回帰向けの便利な損失関数

特定の例の L2 損失

= 予測とラベルの差の二乗

=(観測 - 予測)2

=(y - y')2

データセットの L2 損失の定義

$$ L_2Loss = \sum_{(x,y)\in D} (y - prediction(x))^2 $$

\(\sum \text{:We're summing over all examples in the training set.}\)

\(D \text{: Sometimes useful to average over all examples,}\)

\(\text{so divide by} {\|D\|}.\)

この動画講義の吹き替えは、機械学習の技術を使用して生成されました。吹き替え技術の改善にご協力ください。上の [フィードバックを送信] をクリックしてバグレポートと提案を送信してください。

音声を英語に切り替えるには、ページの左下にあるプルダウン メニューから [English] を選択します。