为了训练模型,我们需要一种降低模型损失的好方法。迭代方法是一种广泛用于减少损失的方法,而且简单高效,就像爬山一样。

降低损失

如何减少损失?

- 超参数是用于调整模型训练方式的配置设置。

- (y - y')2 相对于权重和偏差的导数可让我们了解指定样本的损失是如何变化的

- 易于计算和凸形

- 因此,我们会反复采取一些小步 来最大限度减少损失

- 我们将这些小步称为梯度步(但它们实际上是负梯度步)

- 这种策略称为梯度下降法

梯度下降法方框图

- 尝试进行梯度下降法练习

- 完成练习后,按“播放”图标 ▶ 即可继续学习

权重初始化

- 对于凸形问题,权重可以从任何位置开始(例如,所有值均为 0)

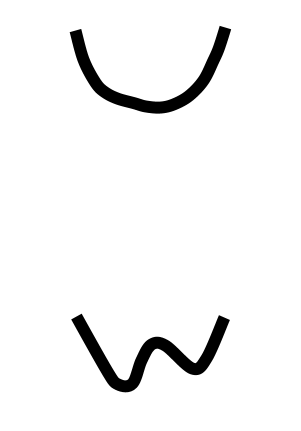

- 凸形:想象一个碗的形状

- 只有一个最低点

权重初始化

- 对于凸形问题,权重可以从任何位置开始(例如,所有值均为 0)

- 凸形:想象一个碗的形状

- 只有一个最低点

- 借鉴:不适用于神经网络

- 非凸形:想象一个蛋宝箱

- 有多个最小值

- 高度依赖于初始值

SGD 和小批量梯度下降法

- 可以在每一步计算整个数据集的梯度,但事实证明没有必要这样做

- 计算小数据样本的梯度效果很好

- 每一步都获得一个新的随机样本

- 随机梯度下降法:一次抽取一个样本

- 小批次梯度下降法:10-1000 作为批次

- 损失和梯度在整个批次中求平均值