किसी मॉडल को ट्रेनिंग देने के लिए, हमें उसे कम करने का कोई बेहतर तरीका चाहिए. नुकसान को कम करने के लिए, दोहराव वाला तरीका सबसे ज़्यादा इस्तेमाल किया जाने वाला तरीका है. यह पहाड़ी पर चलने जितना ही आसान और कुशल है.

नुकसान कम करना

हम नुकसान को कैसे कम कर सकते हैं?

- हाइपर पैरामीटर वे कॉन्फ़िगरेशन सेटिंग होती हैं जिनका इस्तेमाल, मॉडल को ट्रेनिंग देने के तरीके को ट्यून करने के लिए किया जाता है.

- वज़न और पक्षपात के हिसाब से (y - y')2 का डेरिवेटिव हमें यह बताता है कि दिए गए उदाहरण से होने वाले नुकसान में किस तरह बदलाव हुआ है

- कंप्यूट करने और उत्तल बनाने में आसान

- इसलिए, हम बार-बार उस दिशा में छोटे-छोटे कदम उठाते हैं जिससे नुकसान को कम किया जा सके

- हम इन्हें ग्रेडिएंट कदम कहते हैं (हालांकि, ये असल में नेगेटिव ग्रेडिएंट कदम हैं)

- इस रणनीति को ग्रेडिएंट डिसेंट कहा जाता है

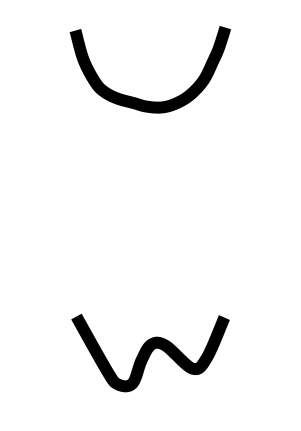

ग्रेडिएंट वंशानुक्रम का ब्लॉक डायग्राम

- ग्रेडिएंट डीसेंट एक्सरसाइज़ आज़माएं

- व्यायाम समाप्त होने के बाद, जारी रखने के लिए चलाएं ▶ दबाएं

वेट की शुरुआत

- उत्तल समस्याओं के लिए, भार कहीं से भी शुरू हो सकते हैं (जैसे, सभी 0 से)

- उत्तल: कटोरे के आकार के बारे में सोचें

- सिर्फ़ एक कम से कम

वेट की शुरुआत

- उत्तल समस्याओं के लिए, भार कहीं से भी शुरू हो सकते हैं (जैसे, सभी 0 से)

- उत्तल: कटोरे के आकार के बारे में सोचें

- सिर्फ़ एक कम से कम

- पूर्वाग्रह: न्यूरल नेट के लिए सही नहीं

- बिना उत्तल: अंडे की टोकरी के बारे में सोचें

- कम से कम एक से ज़्यादा

- शुरुआती वैल्यू पर ज़्यादा निर्भरता

SGD और मिनी-बैच ग्रेडिएंट डिसेंट

- हर चरण पर पूरे डेटा सेट में ग्रेडिएंट का पता लगाया जा सकता है. हालांकि, ऐसा करना ज़रूरी नहीं है

- छोटे डेटा सैंपल पर, ग्रेडिएंट का इस्तेमाल करके अच्छी तरह से काम किया जा सकता है

- हर कदम पर, एक रैंडम सैंपल पाएं

- स्टोकास्टिक ग्रेडिएंट वंश: एक बार में एक उदाहरण

- मिनी-बैच ग्रेडिएंट डिसेंट: 10 से 1,000 बैच

- ऐप्लिकेशन के नुकसान और ग्रेडिएंट का औसत, बैच के हिसाब से तय किया जाता है