이 페이지에서는 '결정 트리' 단원에서 다룬 자료에 관한 일련의 객관식 연습문제를 풀어 보도록 합니다.

질문 1

결정 트리의 추론은 예시를 라우팅하여 실행됩니다.

리프에서 루트로 이동합니다.

모든 추론은 루트 (첫 번째 조건)에서 시작됩니다.

한 리프에서 다른 리프로 이동합니다.

모든 추론은 리프가 아닌 루트에서 시작됩니다.

루트에서 리프까지

잘하셨습니다.

질문 2

모든 조건에 단일 지형지물이 포함되나요?

예.

경사 지형지물은 여러 지형지물을 테스트합니다.

아니요.

축에 정렬된 조건은 단일 지형지물만 포함하지만 경사 조건은 여러 지형지물을 포함합니다.

질문 3

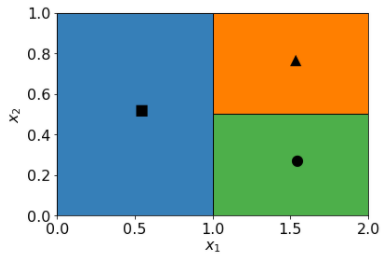

두 특성 x1과 x2에 대한 다음 예측 맵을 고려해 보겠습니다.

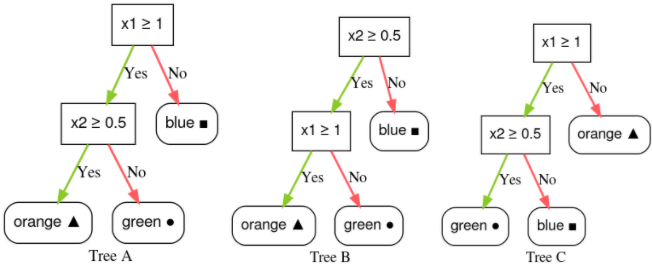

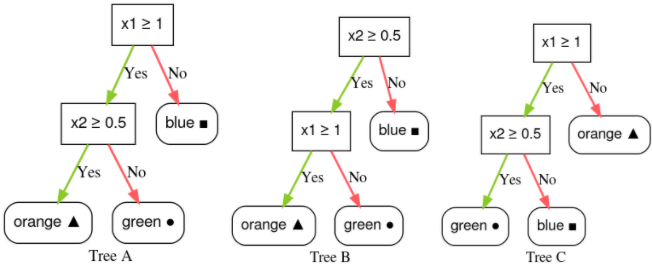

다음 결정 트리 중 예측 지도와 일치하는 것은 무엇인가요?

결정 트리 A

예.

결정 트리 B

x2 ≥ 0.5 조건이 '아니요'인 경우 잎이 파란색일 수도 있고 아닐 수도 있으므로 잘못된 조건입니다.

결정 트리 C

x1이 1.0보다 크지 않으면 리프가 '주황색'이 아닌 '파란색'이어야 하므로 잘못된 리프입니다.