นี่คือวัว

รูปที่ 19 วัว

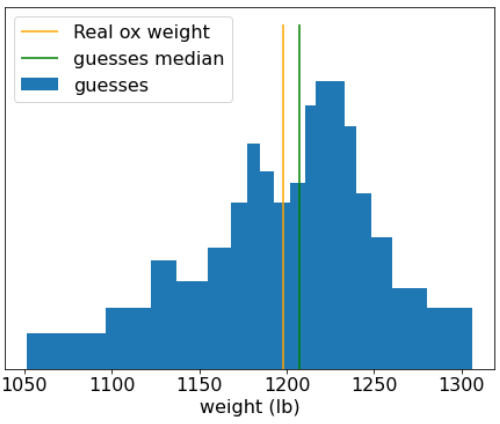

ในปี 1906 มีการจัดการแข่งขันการตัดสินน้ำหนักในอังกฤษ ผู้เข้าร่วม 787 คนคาดเดาน้ำหนักของวัว ข้อผิดพลาดมัธยฐานของการคาดคะเนแต่ละรายการคือ 16.8 กก. (ข้อผิดพลาด 3.1%) อย่างไรก็ตาม ค่ามัธยฐานโดยรวมของการคาดคะเนอยู่ห่างจากน้ำหนักจริงของวัว (1,198 ปอนด์) เพียง 4 กก.ซึ่งมีความคลาดเคลื่อนเพียง 0.7%

รูปที่ 20 ฮิสโตแกรมของการคาดคะเนน้ำหนักแต่ละรายการ

เกร็ดเล็กเกร็ดน้อยนี้แสดงให้เห็นถึงภูมิปัญญาของมวลชน: ในบางสถานการณ์ ความคิดเห็นของมวลชนจะให้การตัดสินที่ดีมาก

ในทางคณิตศาสตร์ เราสามารถประมาณภูมิปัญญาของมวลชนได้ด้วยทฤษฎีบททางสถิติส่วนกลาง ดังนี้ โดยทั่วไปแล้ว ความคลาดเคลื่อนกำลังสองระหว่างค่าหนึ่งๆ กับค่าเฉลี่ยของค่าประมาณ N ค่าที่มีสัญญาณรบกวนสำหรับค่านี้จะมีแนวโน้มเป็น 0 โดยมีปัจจัย 1/N อย่างไรก็ตาม หากตัวแปรไม่อิสระ ค่าความแปรปรวนจะมากกว่า

ในแมชชีนเลิร์นนิง ชุดค่าผสมคือคอลเล็กชันโมเดลที่มีการคาดการณ์โดยเฉลี่ย (หรือรวบรวมข้อมูลด้วยวิธีใดวิธีหนึ่ง) หากโมเดลการรวมมีความแตกต่างกันมากพอโดยไม่แย่เกินไป โดยทั่วไปแล้วคุณภาพของการรวมจะดีกว่าคุณภาพของโมเดลแต่ละรายการ การรวมกลุ่มต้องใช้เวลาในการฝึกและเวลาในการอนุมานมากกว่าโมเดลเดียว ท้ายที่สุดแล้ว คุณต้องทำการเทรนและการอนุมานกับโมเดลหลายรายการแทนที่จะทำกับโมเดลเดียว

โดยทั่วไปแล้ว โมเดลแต่ละรายการควรเป็นอิสระต่อกันเพื่อให้การรวมโมเดลทำงานได้ดีที่สุด ตัวอย่างเช่น ชุดค่าผสมที่ประกอบด้วยโมเดลเดียวกันทั้งหมด 10 รายการ (กล่าวคือ ไม่ได้เป็นอิสระเลย) จะมีประสิทธิภาพไม่ดีกว่าโมเดลแต่ละรายการ ในทางกลับกัน การบังคับให้โมเดลเป็นแบบอิสระอาจทำให้โมเดลทำงานได้แย่ลง การรวมกลุ่มที่มีประสิทธิภาพต้องอาศัยการหาจุดสมดุลระหว่างความเป็นอิสระของโมเดลกับคุณภาพของโมเดลย่อย