בעיות רבות דורשות אומדן הסתברות כפלט. רגרסיה לוגיסטית היא מנגנון יעיל ביותר לחישוב ההסתברות. באופן מעשי, תוכלו להשתמש בהסתברות שמוחזרת באחת משתי השיטות הבאות:

- "As is"

- בוצע המרה לקטגוריה בינארית.

נשקול איך אנחנו משתמשים בהסתברות". נניח שאנחנו יוצרים מודל רגרסיה לוגיסטית כדי לחזות את ההסתברות שהכלב נובח באמצע הלילה. אנחנו קוראים להסתברות:

\[p(bark | night)\]

אם מודל הרגרסיה הלוגיסטית חוזה את \(p(bark | night) = 0.05\), הבעלים של הכלב צריך להיות ערנות בערך כ-18 פעמים:

\[\begin{align} startled &= p(bark | night) \cdot nights \\ &= 0.05 \cdot 365 \\ &~= 18 \end{align} \]

במקרים רבים, צריך למפות את פלט הרגרסיה הלוגיסטית לפתרון לבעיה של סיווג בינארי, שבה המטרה היא לחזות בצורה נכונה אחת מתוך שתי תוויות אפשריות (למשל, "spam" או " לא ספאם"). מודול מאוחר יותר מתמקד בנושא הזה.

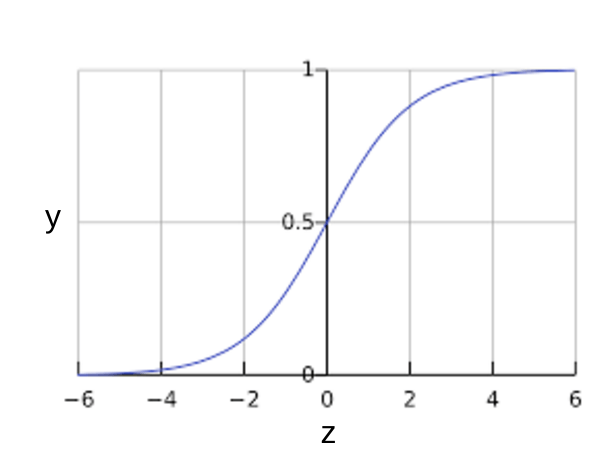

יכול להיות שלא ברור לכם איך מודל רגרסיה לוגיסטי יכול להבטיח שהפלט תמיד יהיה בין 0 ל-1. בזמן אמת, פונקציה sigmoid, שהוגדרה כך, יוצרת פלט עם אותם מאפיינים:

הפונקציה sigmoid מספקת את התרשים הבא:

איור 1: פונקציה של Sigmoid.

אם \(z\) הוא מייצג את הפלט של השכבה הלינארית של מודל שעבר רגרסיה לוגיסטית, \(sigmoid(z)\) יפיק ערך (הסתברות) בין 0 ל-1. במונחים מתמטיים:

כאשר:

- \(y'\) פלט של רגרסיה לוגיסטית בדוגמה מסוימת.

- \(z = b + w_1x_1 + w_2x_2 + \ldots + w_Nx_N\)

- הערכים \(w\) הם המשקל של המודל& \(b\) הוא ההטיה.

- ערכי \(x\) הם ערכי התכונות של דוגמה מסוימת.

שימו לב ש \(z\) מכונה גם log-odds כי ההיפוך של הסיגמויד \(z\) ניתן להגדיר אותו בתור יומן ההסתברות של \(1\) (למשל, "כלב נובח" חלקי ההסתברות \(0\) של התווית (למשל, "dog do't Bark" :

זוהי הפונקציה של sigmoid עם תוויות ML:

איור 2: פלט רגרסיה לוגיסטית.