通过语音输入,你可以创建真正的免触摸操作界面。玻璃 为您提供了三种使用语音输入的方式。

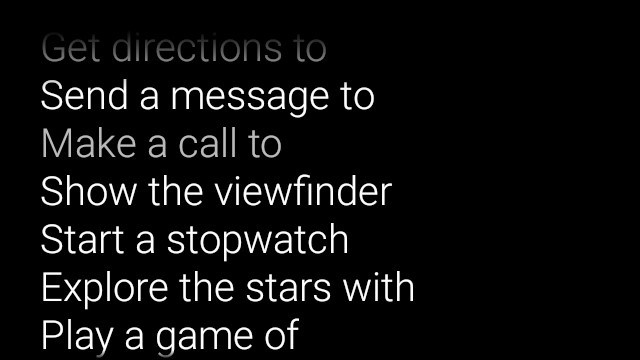

通过首页卡片启动 Glassware 的主要语音指令(情境语音) 命令可以在 activity 中执行操作,而系统的语音 识别 activity 可让您接收来自用户的自由格式的语音输入。

主要语音指令

这些语音指令会从主屏幕卡片(时钟卡片)启动 Glassware。当您 声明主语音指令后,Glass 会自动创建一个触摸菜单项 作为后备选项,用户可以点击 首页卡片。

如需在 ok glass 语音主菜单中添加语音指令,请执行以下操作:

在以下位置为语音指令创建 XML 资源: 使用某个现有语音指令的

res/xml/<my_voice_trigger>.xml定义于VoiceTriggers.Command。 例如,这里展示了如何使用“开始跑步”选项。<?xml version="1.0" encoding="utf-8"?> <trigger command="START_A_RUN" />创建一条语音命令来提示用户再说一句 短语,请在相应文本中添加一个

input元素。例如,如果您是 点击“发布更新”即可<?xml version="1.0" encoding="utf-8"?> <trigger command="POST_AN_UPDATE"> <input prompt="@string/glass_voice_prompt" /> </trigger>使用

com.google.android.glass.action.VOICE_TRIGGERAndroid 清单。intent 过滤器会启动您的 activity 或服务 如果系统检测到用户说出您的语音指令,就会出现这种情况。<?xml version="1.0" encoding="utf-8"?> <application ...> <activity | service ...> <intent-filter> <action android:name= "com.google.android.glass.action.VOICE_TRIGGER" /> </intent-filter> <meta-data android:name="com.google.android.glass.VoiceTrigger" android:resource="@xml/my_voice_trigger" /> </activity | service> // ... </application>为您的 activity 或服务声明

android:icon属性。 这样,Glass 就会在以下位置显示您的 Glassware 图标: 好的,玻璃触摸菜单。<activity |service android:icon="@drawable/my_icon" ...> ... </activity | service>如果您的语音指令使用语音提示并启动了 activity,请获取 任何包含以下代码的转写文本(例如

onResume()):ArrayList<String> voiceResults = getIntent().getExtras() .getStringArrayList(RecognizerIntent.EXTRA_RESULTS);如果语音指令启动了服务,则 intent extra 中可用

onStartCommand()回调:@Override public int onStartCommand(Intent intent, int flags, int startId) { ArrayList<String> voiceResults = intent.getExtras() .getStringArrayList(RecognizerIntent.EXTRA_RESULTS); // ... }

设置限制

如果您需要使用以下任一或所有功能来启动 Glassware,

请在 res/xml/<my_voice_trigger>.xml 资源中指定它们。

如果这些功能不可用,Glass 会停用以下语音指令:

cameranetworkmicrophone<trigger command="POST_AN_UPDATE"> <constraints camera="true" network="true" /> </trigger>

情境语音指令

情境语音指令可让用户通过 activity 执行操作。 您可以使用标准 Android 菜单 API 构建上下文语音命令, 用户可以使用语音指令(而不是轻触)调用菜单项。

如需为特定 activity 启用上下文语音指令,请执行以下操作:

致电

getWindow().requestFeature(WindowUtils.FEATURE_VOICE_COMMANDS)即可启用上下文语音指令。通过此功能 启用后,屏幕的页脚区域会显示“ok glass”菜单 。替换

onCreatePanelMenu()并处理WindowUtils.FEATURE_VOICE_COMMANDS已启用。启用后,您可以在此处执行一次性菜单设置,例如膨胀 菜单资源或调用Menu.add()方法创建语音菜单系统。替换

onMenuItemSelected()在用户说出语音指令时处理这些语音指令。用户完成操作后 选择菜单项后,系统会自动说出“ok, glass”语音指令 重新出现在屏幕的页脚部分,准备接受新的语音 命令,只要该 activity 保持焦点即可。以下代码会启用上下文语音指令,扩充菜单资源 并在用户说出语音指令时处理语音指令:

public class ContextualMenuActivity extends Activity { @Override protected void onCreate(Bundle bundle) { super.onCreate(bundle); // Requests a voice menu on this activity. As for any other // window feature, be sure to request this before // setContentView() is called getWindow().requestFeature(WindowUtils.FEATURE_VOICE_COMMANDS); setContentView(R.layout.activity_main); } @Override public boolean onCreatePanelMenu(int featureId, Menu menu) { if (featureId == WindowUtils.FEATURE_VOICE_COMMANDS) { getMenuInflater().inflate(R.menu.main, menu); return true; } // Pass through to super to setup touch menu. return super.onCreatePanelMenu(featureId, menu); } @Override public boolean onCreateOptionsMenu(Menu menu) { getMenuInflater().inflate(R.menu.main, menu); return true; } @Override public boolean onMenuItemSelected(int featureId, MenuItem item) { if (featureId == WindowUtils.FEATURE_VOICE_COMMANDS) { switch (item.getItemId()) { case R.id.dogs_menu_item: // handle top-level dogs menu item break; case R.id.cats_menu_item: // handle top-level cats menu item break; case R.id.lab_menu_item: // handle second-level labrador menu item break; case R.id.golden_menu_item: // handle second-level golden menu item break; case R.id.calico_menu_item: // handle second-level calico menu item break; case R.id.cheshire_menu_item: // handle second-level cheshire menu item break; default: return true; } return true; } // Good practice to pass through to super if not handled return super.onMenuItemSelected(featureId, item); } }下面是上一个 activity 使用的菜单资源示例。 请注意如何为分层语音创建嵌套菜单项 菜单系统。在以下示例中,第一个菜单项可以 访问形式为:ok glass, Show me dogs, Labrador。

<menu xmlns:android="http://schemas.android.com/apk/res/android"> <!-- Use the constants defined in the ContextualMenus.Command enum--> <item android:id="@+id/dogs_menu_item" android:title="@string/show_me_dogs"> <menu> <item android:id="@+id/lab_menu_item" android:title="@string/labrador" /> <item android:id="@+id/golden_menu_item" android:title="@string/golden" /> </menu> </item> <item android:id="@+id/cats_menu_item" android:title="@string/show_me_cats"> <menu> <item android:id="@+id/cheshire_menu_item" android:title="@string/cheshire" /> <item android:id="@+id/calico_menu_item" android:title="@string/calico" /> </menu> </item> </menu><menu xmlns:android="http://schemas.android.com/apk/res/android"> <!-- Use the constants defined in the ContextualMenus.Command enum--> <item android:id="@+id/play_menu_item" android:title="PLAY_MUSIC" /> <item android:id="@+id/pause_menu_item" android:title="PAUSE_MUSIC" /> </menu>(可选)覆盖

onPreparePanel()、 检查WindowUtils.FEATURE_VOICE_COMMANDS已启用。 启用后,您可以在此处执行其他逻辑来设置菜单系统, 例如根据某些条件添加和移除某些菜单项。您可以 同时开启和关闭上下文语音菜单(返回true) (返回false)。例如:private boolean mVoiceMenuEnabled; ... @Override public boolean onPreparePanel(int featureId, View view, Menu menu) { if (featureId == WindowUtils.FEATURE_VOICE_COMMANDS) { // toggle this boolean on and off based on some criteria return mVoiceMenuEnabled; } // Good practice to call through to super for other cases return super.onPreparePanel(featureId, view, menu); }

同时支持语音菜单和触摸菜单

由于上下文语音指令使用现有的 Android 菜单 API, 就可以针对触摸菜单重复使用已有的大量代码和资源 同时支持这两种类型的菜单。

您只需检查 Window.FEATURE_OPTIONS_PANEL 功能即可

除了您已经学习的WindowUtils.FEATURE_VOICE_COMMANDS功能之外

需要检查几种方法,然后添加逻辑来打开

菜单。

例如,您可以更改之前的活动记录 添加对触摸菜单的支持的示例(更改会附注在注释中):

// 1. Check for Window.FEATURE_OPTIONS_PANEL

// to inflate the same menu resource for touch menus.

@Override

public boolean onCreatePanelMenu(int featureId, Menu menu) {

if (featureId == WindowUtils.FEATURE_VOICE_COMMANDS ||

featureId == Window.FEATURE_OPTIONS_PANEL) {

...

}

// 2. Check for Window.FEATURE_OPTIONS_PANEL

// to handle touch menu item selections.

@Override

public boolean onMenuItemSelected(int featureId, MenuItem item) {

if (featureId == WindowUtils.FEATURE_VOICE_COMMANDS ||

featureId == Window.FEATURE_OPTIONS_PANEL) {

...

}

完成这些更改后,只需点按或说出 Ok glass,即可开启此设置 菜单。

使用不公开列出的语音指令进行开发

如果您想分发 Glassware,必须使用已获批准的主服务

语音指令

VoiceTriggers.Command

和已获批的上下文相关语音指令

ContextualMenus.Command。

如果您想使用 GDK 中未提供的语音指令,

您可以在 AndroidManifest.xml 文件中请求 Android 权限:

<uses-permission

android:name="com.google.android.glass.permission.DEVELOPMENT" />

使用未列出的主要语音指令

在

res/values/strings.xml中声明一个字符串值,该字符串定义了 语音触发器的名称。(可选)声明语音提示 在启动 Glassware 之前显示语音识别 Glassware<?xml version="1.0" encoding="utf-8"?> <resources> <string name="glass_voice_trigger">read me a story</string> <string name="glass_voice_prompt">what story?</string> </resources>在以下位置为语音触发器创建 XML 资源:

res/xml/<my_voice_trigger>.xml。对于不公开的语音指令,你应该使用keyword属性,而不是用于获得批准的command属性 语音指令。keyword属性应为对字符串的引用 定义语音指令的资源对于启动 activity 或服务,只需指定trigger元素即可:<?xml version="1.0" encoding="utf-8"?> <trigger keyword="@string/glass_voice_trigger" />创建语音触发器来提示用户再说一句 包括输入元素 以及:

<?xml version="1.0" encoding="utf-8"?> <trigger keyword="@string/glass_voice_trigger"> <input prompt="@string/glass_voice_prompt" /> </trigger>

使用未列出的上下文相关语音指令

创建菜单项时,可以使用任意文本作为菜单项的标题。 例如:

<menu xmlns:android="http://schemas.android.com/apk/res/android">

<!-- Use the constants defined in the ContextualMenus.Command enum-->

<item

android:id="@+id/pizza_menu_item"

android:title="@string/find_pizza" />

</menu>

启动语音识别

语音识别 Glassware 会等待用户说话,并返回 生成并转写文本如需启动 activity,请执行以下操作:

- 调用

startActivityForResult()与ACTION_RECOGNIZE_SPEECHintent 相关联。 启动 activity 时支持以下 intent extra: <ph type="x-smartling-placeholder"> 替换

onActivityResult()回调以从EXTRA_RESULTSintent extra。当用户结束讲话时,系统会调用此回调。private static final int SPEECH_REQUEST = 0; private void displaySpeechRecognizer() { Intent intent = new Intent(RecognizerIntent.ACTION_RECOGNIZE_SPEECH); startActivityForResult(intent, SPEECH_REQUEST); } @Override protected void onActivityResult(int requestCode, int resultCode, Intent data) { if (requestCode == SPEECH_REQUEST && resultCode == RESULT_OK) { List<String> results = data.getStringArrayListExtra( RecognizerIntent.EXTRA_RESULTS); String spokenText = results.get(0); // Do something with spokenText. } super.onActivityResult(requestCode, resultCode, data); }