هنگام ارزیابی یک مدل، معیارهای محاسبه شده در برابر کل تست یا مجموعه اعتبارسنجی، همیشه تصویر دقیقی از منصفانه بودن مدل ارائه نمی دهد. عملکرد عالی مدل به طور کلی برای اکثر نمونه ها ممکن است عملکرد ضعیف را در زیرمجموعه اقلیتی از نمونه ها پنهان کند، که می تواند منجر به پیش بینی های مدل مغرضانه شود. استفاده از معیارهای عملکرد کلی مانند دقت ، یادآوری ، و دقت لزوماً این مسائل را آشکار نمی کند.

میتوانیم مدل پذیرش خود را مجدداً بررسی کنیم و با رعایت انصاف، تکنیکهای جدیدی را برای ارزیابی پیشبینیهای آن برای سوگیری بررسی کنیم.

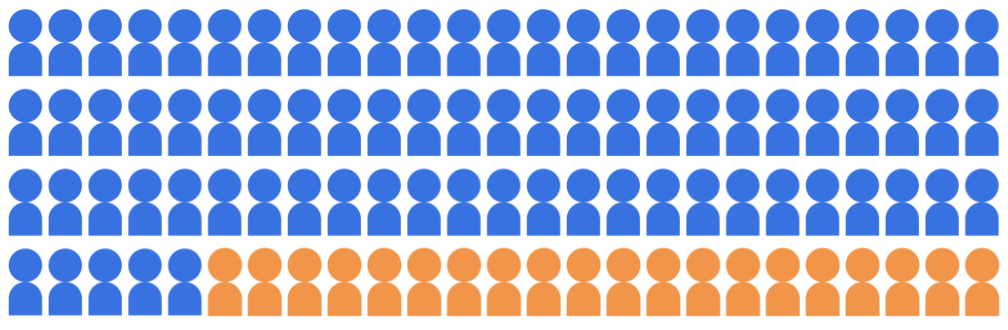

فرض کنید مدل طبقه بندی پذیرش، 20 دانشجو را برای پذیرش در دانشگاه از بین 100 داوطلب انتخاب می کند که به دو گروه جمعیتی تعلق دارند: گروه اکثریت (آبی، 80 دانشجو) و گروه اقلیت (نارنجی، 20 دانشجو).

این مدل باید دانشآموزان واجد شرایط را به شیوهای بپذیرد که برای داوطلبان هر دو گروه جمعیتی منصفانه باشد.

چگونه باید پیش بینی های مدل را برای عدالت ارزیابی کنیم؟ معیارهای مختلفی وجود دارد که میتوانیم در نظر بگیریم، که هر یک تعریف ریاضی متفاوتی از «انصاف» ارائه میکنند. در بخشهای بعدی، سه مورد از این معیارهای انصاف را به طور عمیق بررسی خواهیم کرد: برابری جمعیتی، برابری فرصتها و انصاف خلاف واقع.