Przewodniki dotyczące poszczególnych platform

Android (Kotlin/Java)

Android NDK (C)

Unity (AR Foundation)

Unreal Engine

Kluczowym elementem tworzenia realistycznych wrażeń AR jest odpowiednie oświetlenie. Jeśli wirtualny obiekt nie ma cienia lub ma błyszczący materiał, który nie odbija otoczenia, użytkownicy mogą zauważyć, że coś jest nie tak, nawet jeśli nie są w stanie wyjaśnić, dlaczego. Dzieje się tak, ponieważ ludzie podświadomie odbierają sygnały dotyczące oświetlenia obiektów w ich otoczeniu. Interfejs Lighting Estimation API analizuje dane obrazy pod kątem takich wskazówek, dostarczając szczegółowych informacji o oświetleniu sceny. Następnie możesz użyć tych informacji podczas renderowania obiektów wirtualnych, aby oświetlić je w tych samych warunkach co sceny, w których się znajdują, co pozwoli utrzymać użytkowników w ciągłym kontakcie z reklamą i zaangażować ich uwagę.

Wskazówki dotyczące oświetlenia

Interfejs Lighting Estimation API udostępnia szczegółowe dane, które umożliwiają symulowanie różnych wskazówek oświetleniowych podczas renderowania obiektów wirtualnych. Są to cienie, światło otoczenia, cieniowanie, odbicia światła i odbicia.

Cienie

Cienie są często kierunkowe i pokazują widzom, skąd pochodzą źródła światła.

Jasność otoczenia

Jasność otoczenia to ogólne światło rozproszone docierające z otoczenia, które sprawia, że wszystko jest widoczne.

Cieniowanie

Shading to intensywność światła. Na przykład różne części tego samego obiektu mogą mieć różne poziomy cieniowania w tej samej scenie, w zależności od kąta w stosunku do widza i odległości od źródła światła.

Wyróżnienia odbicia

Punktowe odbicia to błyszczące fragmenty powierzchni, które odbijają światło bezpośrednio od źródła. Podświetlenia obiektu zmieniają się w zależności od pozycji widza w scenie.

Refleksje

Światło odbija się od powierzchni w różny sposób w zależności od tego, czy powierzchnia ma właściwości specular (silnie odbijające) czy diffuse (nieodbijające). Na przykład metalowa kula będzie bardzo połyskliwa i odbywać będzie odbicia otoczenia, a kula pomalowana na matową szarość będzie rozproszona. Większość rzeczywistych obiektów ma kombinację tych właściwości – pomyśl o porysowanej kuli do kręgli lub często używanej karcie kredytowej.

Odbijające powierzchnie również odzwierciedlają kolory otoczenia. Kolor obiektu może być bezpośrednio zależny od koloru otoczenia. Na przykład biała piłka w niebieskim pokoju będzie miała niebieskawy odcień.

Tryb HDR dla otoczenia

Te tryby korzystają z osobnych interfejsów API, które umożliwiają szczegółową i realistyczną ocenę oświetlenia kierunkowego, cieni, odbić światła i odbić.

Tryb HDR środowiska korzysta z systemów uczących się, aby analizować obrazy z kamery w czasie rzeczywistym i syntezować oświetlenie otoczenia, co umożliwia realistyczne renderowanie obiektów wirtualnych.

Ten tryb oszacowania oświetlenia zapewnia:

Główne światło kierunkowe. Reprezentuje główne źródło światła. Może służyć do tworzenia cieni.

Ambient Spherical Harmonics. Reprezentuje pozostałą energię światła otoczenia w scenie.

Cubemapa HDR. Można go używać do renderowania odbić w błyszczących metalowych obiektach.

Możesz używać tych interfejsów API w różnych kombinacjach, ale są one zaprojektowane tak, aby stosować je razem, co daje najbardziej realistyczny efekt.

Główne światło kierunkowe

Interfejs API głównego światła kierunkowego oblicza kierunek i natężenie głównego źródła światła w scenie. Dzięki tym informacjom obiekty wirtualne w scenie mogą wyświetlać odpowiednio umieszczone punkty odbicia światła oraz rzucać cienie w kierunku zgodnym z innymi widocznymi obiektami rzeczywistymi.

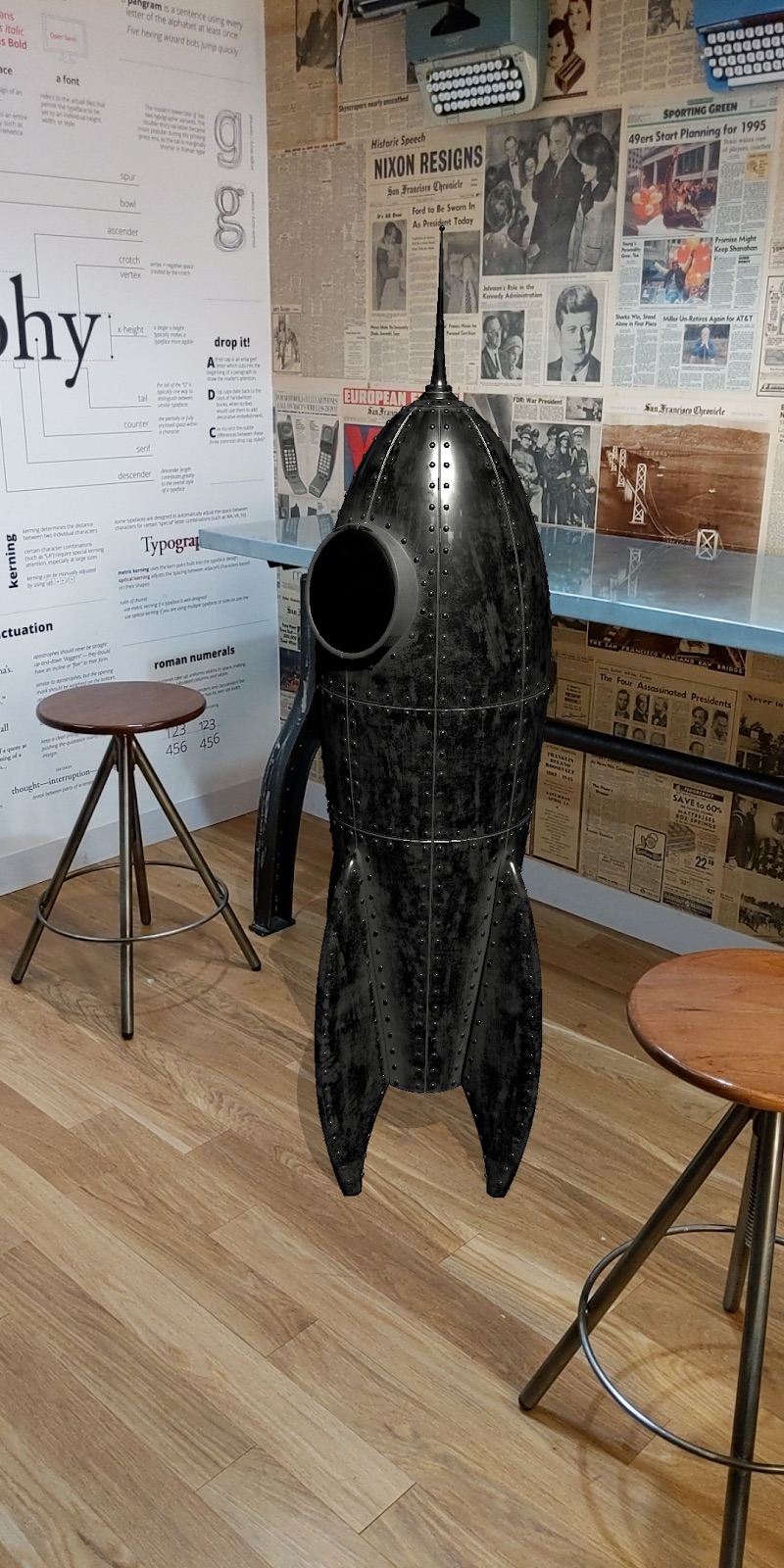

Aby zobaczyć, jak to działa, spójrz na te 2 obrazy tej samej wirtualnej rakiety. Na obrazie po lewej stronie widać cień pod rakietą, ale jego kierunek nie pasuje do innych cieni w scenie. W rakiecie po prawej stronie cień wskazuje w właściwym kierunku. To subtelna, ale ważna różnica, która sprawia, że rakieta jest lepiej osadzona w scenie, ponieważ kierunek i intensywność cienia lepiej pasują do innych cieni w scenie.

Gdy główne źródło światła lub oświetlony obiekt jest w ruchu, punkt odbicia światła na obiekcie dostosowuje swoją pozycję w czasie rzeczywistym w stosunku do źródła światła.

Długość i kierunek cieni kierunkowych zmieniają się w zależności od położenia głównego źródła światła, tak jak w rzeczywistym świecie. Aby zilustrować ten efekt, weź pod uwagę te 2 manekiny – jeden wirtualny, a drugi prawdziwy. Manekin po lewej stronie jest wirtualny.

Harmoniki sferyczne otoczenia

Oprócz energii światła w głównym świetle kierunkowym ARCore udostępnia harmoniczne sferyczne, które reprezentują ogólne światło otoczenia docierające ze wszystkich kierunków w scenie. Użyj tych informacji podczas renderowania, aby dodać subtelne wskazówki, które pomogą w określeniu definicji obiektów wirtualnych.

Popatrz na te 2 obrazy tego samego modelu rakiety. Rakieta po lewej stronie jest renderowana przy użyciu informacji o szacowaniu oświetlenia wykrytym przez główny interfejs API światła kierunkowego. Rakieta po prawej stronie jest renderowana przy użyciu informacji wykrytych przez interfejsy API głównego światła kierunkowego i harmonicznych sferycznych. Druga rakieta jest wyraźnie lepiej widoczna i płynniej wkomponowuje się w scenę.

HDR Cubemap

Użyj mapy sześciennej HDR, aby renderować realistyczne odbicia na wirtualnych obiektach o średnim lub wysokim połysku, takich jak błyszczące metalowe powierzchnie. Cubemap wpływa też na cieniowanie i wygląd obiektów. Na przykład materiał obiektu odbijającego światło otoczonego niebieskim otoczeniem będzie odbijać niebieskie odcienie. Obliczenie mapy HDR wymaga niewielkiej ilości dodatkowego przetwarzania przez procesor.

To, czy należy użyć mapy HDR, zależy od tego, jak obiekt odbija otoczenie. Wirtualna rakieta jest metalowa, więc ma silny komponent odbicia, który bezpośrednio odzwierciedla otoczenie. Dzięki temu korzysta z mapy sześciennej. Z drugiej strony obiekt wirtualny wykonany z matowego materiału w szarym kolorze nie ma w ogóle komponentu odbłysku. Jego kolor zależy głównie od komponentu podstawowego, a nie od mapy sześcien.

Do renderowania rakiety poniżej użyto wszystkich 3 interfejsów API Environmental HDR. Cubemapa HDR umożliwia wskazówki dotyczące odbić i dalsze podświetlanie, które w pełni osadzają obiekt w scenie.

Oto ten sam model rakiety w różnych warunkach oświetleniowych. Wszystkie te sceny zostały wyrenderowane przy użyciu informacji z 3 interfejsów API z zastosowaniem cieni kierunkowych.

Tryb intensywności otoczenia

Tryb natężenia otoczenia określa średnią natężenie pikseli i skali korekty kolorów dla danego obrazu. Jest to ogólne ustawienie przeznaczone do zastosowań, w których precyzyjne oświetlenie nie jest kluczowe, np. obiekty z wbudowanym oświetleniem.

Intensywność piksela

Rejestruje średnią intensywność oświetlenia w pikselach w danej scenie. Możesz zastosować to oświetlenie do całego wirtualnego obiektu.

Kolor

Wykrywa balans bieli dla każdego pojedynczego kadru. Następnie możesz skorygować kolory wirtualnego obiektu, aby lepiej wkomponował się w kolorystykę sceny.

sondy środowiskowe;

Sondy środowiskowe porządkują widoki z kamery 360 stopni w tekstury środowiska, takie jak mapy sześcienne. Tekstur tych można następnie używać do realistycznego oświetlenia wirtualnych obiektów, takich jak wirtualna metalowa kula, która „odbija” pomieszczenie, w którym się znajduje.