คู่มือเฉพาะแพลตฟอร์ม

Android (Kotlin/Java)

Android NDK (C)

Unity (AR Foundation)

Unreal Engine

ประสบการณ์ Augmented Reality ส่วนใหญ่เป็น "แบบเรียลไทม์" ซึ่งกำหนดให้ผู้ใช้ต้องอยู่ในสถานที่หนึ่งๆ ณ เวลาหนึ่งๆ โดยตั้งค่าโทรศัพท์ไว้ในโหมด AR พิเศษและเปิดแอป AR ไว้ เช่น หากผู้ใช้ต้องการดูว่าโซฟา AR มีลักษณะอย่างไรในห้องนั่งเล่น ผู้ใช้จะต้อง "วาง" โซฟาในสภาพแวดล้อมบนหน้าจอขณะที่อยู่ในห้อง

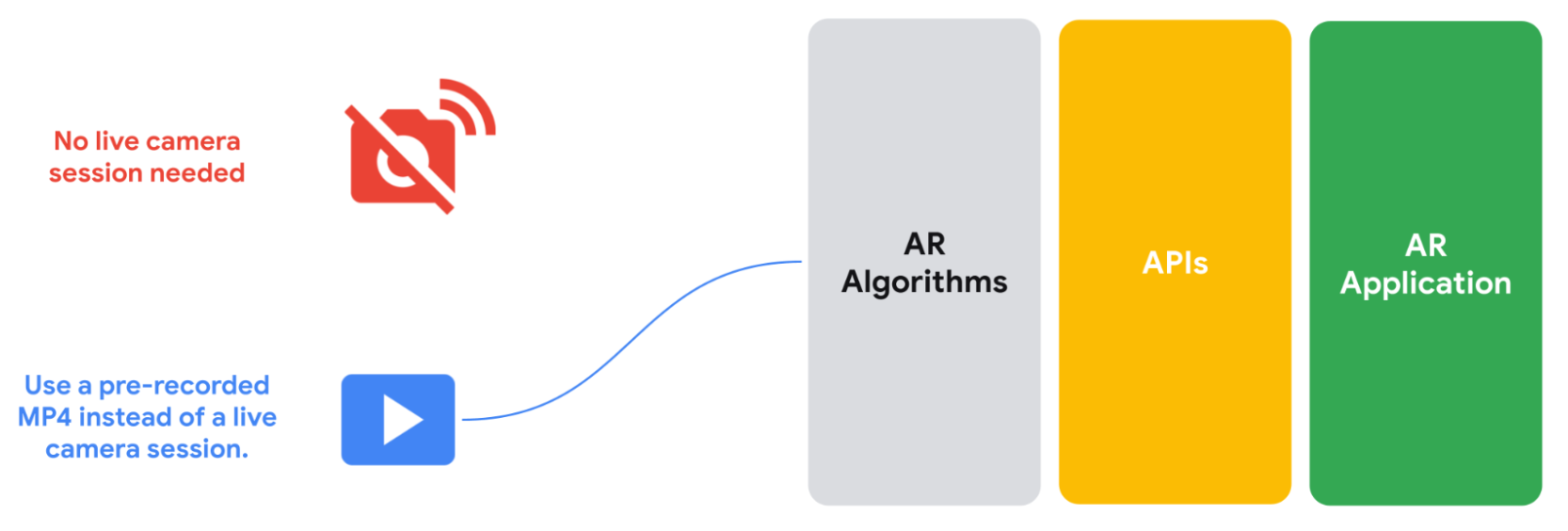

Recording and Playback API ไม่จำเป็นต้องเป็นแบบ "เรียลไทม์" คุณจึงสร้างประสบการณ์ AR ที่รับชมได้ทุกที่ทุกเวลา Recording API จะจัดเก็บสตรีมวิดีโอของกล้อง ข้อมูล IMU หรือข้อมูลเมตาที่กำหนดเองอื่นๆ ที่คุณเลือกบันทึกไว้ในไฟล์ MP4 จากนั้นคุณสามารถส่งวิดีโอที่บันทึกไว้เหล่านี้ไปยัง ARCore ผ่าน Playback API ซึ่งจะถือว่า MP4 เหมือนกับฟีดเซสชันแบบสด คุณยังคงใช้เซสชันกล้องสดได้ แต่ API ใหม่นี้จะช่วยให้แอปพลิเคชัน AR เลือกใช้ MP4 ที่บันทึกไว้ล่วงหน้าแทนเซสชันสดได้

ผู้ใช้ปลายทางก็ใช้ประโยชน์จากฟีเจอร์นี้ได้เช่นกัน ไม่ว่าผู้ใช้จะอยู่ที่ไหนในโลกก็สามารถเรียกดูวิดีโอที่บันทึกด้วย Recording and Playback API จากแกลเลอรีในเครื่อง และแก้ไขหรือเล่นวัตถุ เอฟเฟกต์ และฟิลเตอร์ AR ฟีเจอร์นี้ช่วยให้ผู้ใช้เลือกซื้อผ่าน AR ได้ขณะนั่งรถไฟไปทำงานหรือนอนเล่นอยู่บนเตียง

กรณีการใช้งานสําหรับการพัฒนาด้วย Recording and Playback API

Recording and Playback API ช่วยลดข้อจำกัดด้านเวลาและพื้นที่ในการสร้างแอป AR ต่อไปนี้คือตัวอย่างวิธีใช้เครื่องมือนี้ในโปรเจ็กต์ของคุณเอง

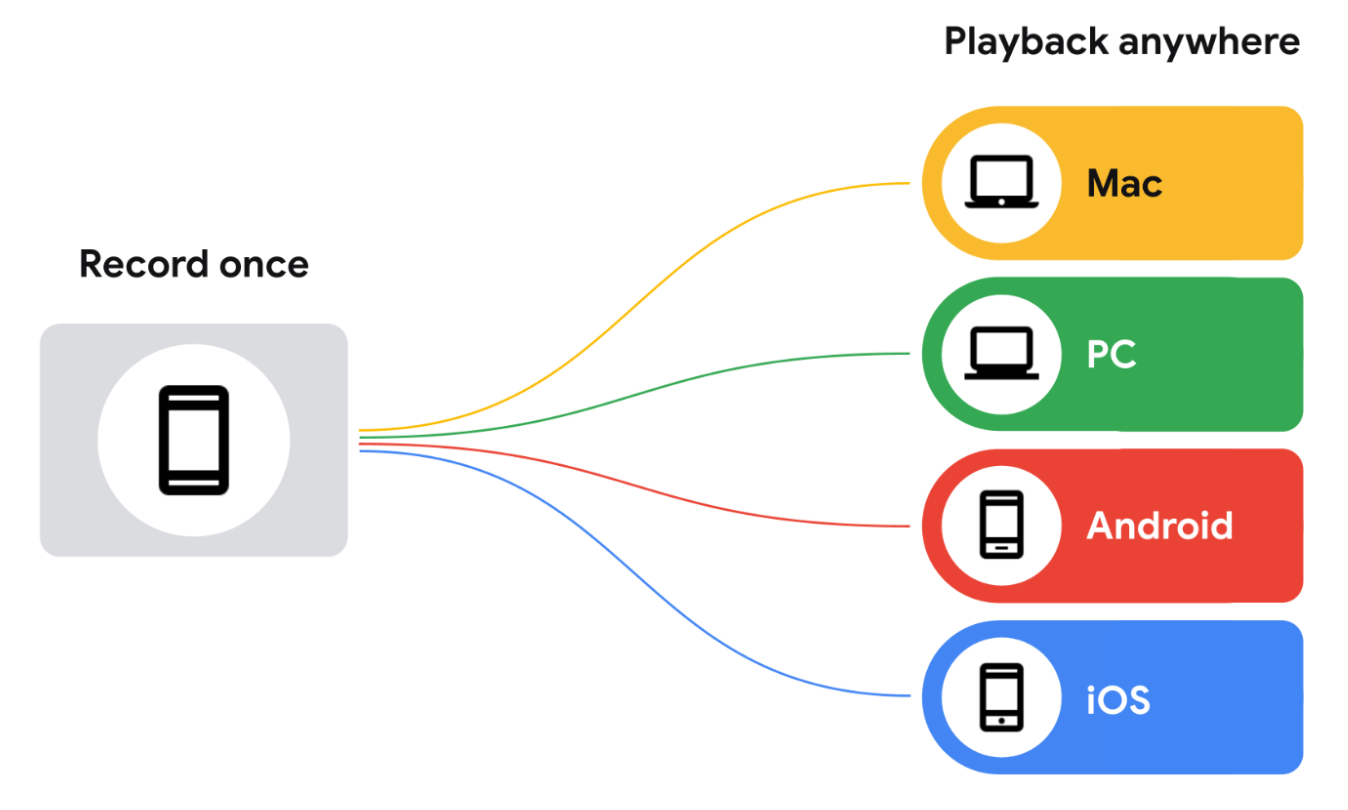

บันทึกเพียงครั้งเดียว แล้วทดสอบได้ทุกที่

คุณสามารถบันทึกวิดีโอโดยใช้ Recording API แล้วเล่นวิดีโอนั้นซ้ำโดยใช้อุปกรณ์ที่เข้ากันได้แทนที่จะต้องไปที่สถานที่จริงทุกครั้งที่ต้องการทดสอบฟีเจอร์ AR กำลังสร้างประสบการณ์ในห้างสรรพสินค้าใช่ไหม คุณไม่จำเป็นต้องไปที่ส่วนนี้ทุกครั้งที่ต้องการทดสอบการเปลี่ยนแปลง เพียงบันทึกการเข้าชมเพียงครั้งเดียว จากนั้นจึงแก้ไขและปรับปรุงได้จากโต๊ะทำงานของคุณเอง

ลดเวลาในการวนซ้ำ

คุณบันทึกวิดีโอเพียงครั้งเดียวและเล่นซ้ำในอุปกรณ์ต่างๆ หลายเครื่องได้ในช่วงการปรับปรุง แทนที่จะต้องบันทึกวิดีโอสำหรับอุปกรณ์ Android ทุกเครื่องที่ต้องการรองรับและสำหรับสถานการณ์การทดสอบแต่ละรายการ

ลดภาระการทดสอบด้วยตนเองในทีมพัฒนา

ใช้ประโยชน์จากชุดข้อมูลที่บันทึกไว้ล่วงหน้าขณะเปิดตัวฟีเจอร์ใหม่ๆ ที่รวมเอาการปรับปรุงการติดตามล่าสุดจาก ARCore หรือใช้ชุดข้อมูลที่กำหนดเองสำหรับฟีเจอร์ใหม่ทุกรายการแทน

ความเข้ากันได้ของอุปกรณ์

คุณจะต้องมี ARCore เพื่อบันทึกข้อมูลด้วย Recording and Playback API แต่ไม่จำเป็นต้องใช้เพื่อเล่นซ้ำ MP4 ที่บันทึกโดยใช้ฟีเจอร์นี้โดยพื้นฐานแล้วคือไฟล์วิดีโอที่มีข้อมูลเพิ่มเติมซึ่งดูได้โดยใช้โปรแกรมเล่นวิดีโอใดก็ได้ คุณสามารถตรวจสอบไฟล์เหล่านี้ได้ด้วย ExoPlayer ของ Android หรือโปรแกรมเล่นที่เข้ากันได้ซึ่งทั้งแยกข้อมูล MP4 และจัดการข้อมูลเพิ่มเติมที่ ARCore เพิ่มเข้ามาได้

วิธีบันทึกข้อมูลวิดีโอและ AR เพื่อการเล่น

ARCore จะบันทึกเซสชันที่บันทึกไว้เป็นไฟล์ MP4 ในอุปกรณ์เป้าหมาย ไฟล์เหล่านี้มีแทร็กวิดีโอหลายแทร็กและข้อมูลอื่นๆ อีกมากมาย เมื่อบันทึกเซสชันเหล่านี้แล้ว คุณสามารถกำหนดให้แอปใช้ข้อมูลนี้แทนเซสชันกล้องสดได้

ไฟล์บันทึกเสียงมีข้อมูลอะไรบ้าง

ARCore จะบันทึกข้อมูลต่อไปนี้ในวิดีโอ H.264 โดยคุณจะเข้าถึงวิดีโอนี้ได้บนโปรแกรมเล่นวิดีโอที่รองรับ MP4 และเปลี่ยนแทร็กได้ แทร็กที่มีความละเอียดสูงสุดจะเป็นแทร็กแรกในรายการ เนื่องจากโปรแกรมเล่นวิดีโอที่เข้ากันได้กับ MP4 บางโปรแกรมจะเล่นแทร็กแรกในรายการโดยอัตโนมัติโดยไม่อนุญาตให้คุณเลือกแทร็กวิดีโอที่จะเล่น

แทร็กวิดีโอหลัก (แทร็กรูปภาพ CPU)

ไฟล์วิดีโอหลักจะบันทึกสภาพแวดล้อมหรือฉากไว้สำหรับการเล่นในภายหลัง โดยค่าเริ่มต้น ARCore จะบันทึกภาพ CPU ขนาด 640x480 (VGA) ที่ใช้สำหรับการติดตามการเคลื่อนไหวเป็นสตรีมวิดีโอหลัก

ARCore จะไม่จับภาพพื้นผิว GPU (ความละเอียดสูง) ที่แสดงผลบนหน้าจอเป็นภาพจากกล้องที่ส่งผ่าน

หากต้องการให้สตรีมรูปภาพความละเอียดสูงพร้อมใช้งานระหว่างการเล่น คุณต้องกำหนดค่ากล้องที่ให้รูปภาพ CPU ที่มีความละเอียดที่ต้องการ ในกรณีนี้

- ARCore จะขอทั้งรูปภาพ CPU ขนาด 640x480 (VGA) ที่จําเป็นสําหรับการติดตามการเคลื่อนไหวและรูปภาพ CPU ความละเอียดสูงที่ระบุโดยการกำหนดค่ากล้องที่กําหนดค่าไว้

- การจับภาพสตรีมรูปภาพ CPU รายการที่ 2 อาจส่งผลต่อประสิทธิภาพของแอป และอุปกรณ์แต่ละเครื่องอาจได้รับผลกระทบแตกต่างกัน

- ในระหว่างการเล่น ARCore จะใช้ภาพความละเอียดสูงของ CPU ที่บันทึกไว้ระหว่างการบันทึกเป็นพื้นผิว GPU ในระหว่างการเล่น

- รูปภาพ CPU ความละเอียดสูงจะกลายเป็นสตรีมวิดีโอเริ่มต้นในการบันทึก MP4

การกำหนดค่ากล้องที่เลือกระหว่างการบันทึกจะเป็นตัวกำหนดรูปภาพ CPU และสตรีมวิดีโอหลักในการบันทึก หากคุณไม่ได้เลือกการกำหนดค่ากล้องที่มีรูปภาพ CPU ความละเอียดสูง วิดีโอนี้จะเป็นแทร็กแรกในไฟล์และจะเล่นโดยค่าเริ่มต้น ไม่ว่าคุณจะใช้วิดีโอเพลเยอร์ใดก็ตาม

ภาพแผนที่ความลึกของกล้อง

ไฟล์นี้เป็นไฟล์วิดีโอที่แสดงแผนที่ความลึกของกล้อง ซึ่งบันทึกจากเซ็นเซอร์ความลึกของฮาร์ดแวร์ของอุปกรณ์ เช่น เซ็นเซอร์ Time-of-Flight (หรือเซ็นเซอร์ ToF) และแปลงเป็นค่าช่อง RGB วิดีโอนี้ควรใช้เพื่อวัตถุประสงค์ในการดูตัวอย่างเท่านั้น

เหตุการณ์การเรียก API

ARCore จะบันทึกค่าที่วัดได้จากเซ็นเซอร์เครื่องวัดการหมุนและตัวตรวจวัดความเร่งของอุปกรณ์ รวมถึงบันทึกข้อมูลอื่นๆ ซึ่งข้อมูลบางอย่างอาจละเอียดอ่อน ดังนี้

- เวอร์ชันรูปแบบชุดข้อมูล

- เวอร์ชัน ARCore SDK

- เวอร์ชันบริการ Google Play สำหรับ AR

- ลายนิ้วมือของอุปกรณ์ (เอาต์พุตของ

adb shell getprop ro.build.fingerprint) - ข้อมูลเพิ่มเติมเกี่ยวกับเซ็นเซอร์ที่ใช้สำหรับการติดตาม AR

- เมื่อใช้ ARCore Geospatial API ตำแหน่งโดยประมาณของอุปกรณ์ การอ่านค่าจากเครื่องวัดค่าความเข้มข้นของสนามแม่เหล็ก และการอ่านค่าจากเข็มทิศ